- •1. Эконометрическая модель и проблемы эконометрического моделирования

- •1.1. Общие понятия

- •1.2. Экономическая модель

- •1.3. Эконометрическая модель

- •1.4. Элементы эконометрической модели и их свойства

- •1.5. Задачи эконометрики

- •1.6. Эконометрика и её место в ряду математических и экономических дисциплин

- •1.7. Резюме по теме.

- •1.8. Вопросы для повторения

- •2. Элементы теории вероятностей и математической статистики

- •2.1. Дискретные, непрерывные случайные величины

- •2.2. Зависимые случайные величины

- •2.3. Понятия генеральной совокупности и выборки (выборочной совокупности)

- •2.4. Оценки параметров генеральной совокупности. Несмещённость и состоятельность оценок

- •2.5. Резюме по теме

- •2.6. Вопросы для повторения

- •3. Модели и методы регрессионного анализа

- •3.1. Основные понятия регрессионного анализа

- •3.2. Линейная парная регрессия

- •3.2.1. Определения

- •3.2.2. Принцип, метод наименьших квадратов

- •3.2.3. Свойства оценок параметров парной линейной регрессии

- •3.2.4. Анализ статистической значимости коэффициентов линейной регрессии

- •3.3. Нелинейная регрессия

- •3.4. Характеристики парной регрессии

- •3.5. Множественная регрессия

- •3.6. Гомо- и гетероскедастичность остатков

- •Методы определения гетероскедастичности

- •Тест ранговой корреляции Спирмена

- •3.7. Резюме по теме.

- •3.8. Вопросы для повторения

- •4. Анализ временных рядов

- •4.1. Общие понятия

- •4.2. Понятие временного ряда

- •4.3. Основные понятия и модели анализа временных рядов

- •4.4. Трендовые модели генерации значений временного ряда.

- •4.5. Фильтрация и сглаживание временного ряда

- •4.5.1. Медианная фильтрация (сглаживание)

- •Проверка гипотезы о наличии тренда во временном ряде

- •4.6. Методы сглаживания временного ряда

- •4.6.1. Общие понятия

- •4.6.2. Аналитические методы

- •4.6.3. Метод скользящего среднего

- •4.6.4. Метод экспоненциально взвешенного скользящего среднего (метод Брауна)

- •4.7. Стационарные временные ряды

- •4.7.1. Основные понятия

- •4.7.2. Корреляционная функция

- •4.7.3. Использование автокорреляции для выявления структуры временного ряда

- •4.8. Модели авторегрессии стационарных временных рядов и их идентификация

- •4.8.1. Основные понятия

- •4.8.2. Модель авторегрессии 1-го порядка

- •4.8.3. Модель авторегрессии второго порядка

- •4.8.4. Оценивание параметров моделей авторегрессии. Метод инструментальных переменных.

- •4.9. Моделирование сезонных и циклических колебаний

- •4.9.1. Расчет сезонной компоненты и построение модели временного ряда

- •4.9.2. Использование сезонных фиктивных компонент при моделировании сезонных колебаний

- •4.10. Специфика изучения взаимосвязей по временным рядам. Исключение сезонных колебаний. Исключение тенденции.

- •4.10.1. Метод отклонений от тренда

- •4.10.2. Метод последовательных разностей

- •4.11. Резюме по теме.

- •4.12. Вопросы для повторения

- •5. Системы одновременных уравнений

- •5.1. Модель спроса и предложения

- •5.2. Структурная и приведённая форма системы

- •5.3. Идентифицируемость систем одновременных уравнений

- •5.4. Резюме по теме.

- •5.5. Вопросы для повторения

- •Задачник

- •Примеры решения типовых задач

- •Задачи для самостоятельного решения

- •Варианты задач

- •Нелинейные модели регрессии и их линеаризация

- •Решение типовых задач

- •Задачи для самостоятельного решения.

- •Варианты задач

- •Решение типовых задач.

- •Постановка задачи

- •Варианты для самостоятельного решения.

3.2. Линейная парная регрессия

3.2.1. Определения

Парной линейной регрессией называется зависимость

![]()

выборочного условного математического ожидания от переменной х. Термин «парная» означает зависимость двух переменных Y, X. Термин «линейная» означает их линейную зависимость.

Условное выборочное математическое ожидание – это выборочное среднее значение величины Y при условии, что переменная X приняла значение х.

Модель наблюдения

![]() ,

,

b0 – оценка свободного члена 0,

b1 – оценка углового коэффициента 1.

3.2.2. Принцип, метод наименьших квадратов

Согласно принципу наименьших квадратов неизвестные параметры b0, b1 выбираются таким образом, чтобы была минимальна сумма квадратов невязок или остатков

![]() .

.

Следует

отметить, что для оценки

параметров b0, b1 возможны

и другие подходы. Например, можно находить

эти параметры при минимизации суммы

абсолютных величин невязок .

Однако вычислительные процедуры,

соответствующие принципу наименьших

квадратов существенно проще. Эти

вычислительные процедуры получили

название «Метод наименьших квадратов»

(МНК).

Исходя из необходимого условия экстремума функции двух переменных S(b0,b1) приравниваем к нулю её частные производные

![]() ;

;

![]() ;

;

откуда после преобразований получим систему нормальных уравнений для определения параметров линейной регрессии:

![]()

![]()

Теперь разделим обе части уравнений на n, получим систему нормальных уравнений в виде

![]() ;

;

![]() ,

,

где ![]()

Подставляя значение

![]()

из первого уравнения системы в уравнение регрессии, получим

![]() ;

;

![]()

Коэффициент b1 называется выборочным угловым коэффициентом регрессии У по Х.

Коэффициент b1 показывает, на сколько единиц в среднем изменяется выборочное условное среднее при увеличении переменной Х на одну единицу.

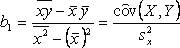

Из нормальной системы получаем

,

,

где sx2 – выборочная дисперсия переменной Х;

![]() –

выборочная

ковариация величин X,Y;

–

выборочная

ковариация величин X,Y;

величину b0 можно найти через коэффициент b1:

![]() .

.

Через коэффициент b1 также можно выразить выборочный коэффициент корреляции

3.2.3. Свойства оценок параметров парной линейной регрессии

Для того чтобы полученные МНК оценки а и b обладали желательными свойствами, необходимо, чтобы выполнялись следующие условия:

1) величина i, является случайной переменной;

2) математическое ожидание i равно нулю: М(е) = 0;

3) дисперсия i постоянна: D(i) = D(i) = а2 для всех i;

4) значения i независимы между собой.

По теореме Гаусса-Маркова

если условия 1)-4) выполняются, то оценки, сделанные с помощью МНК, обладают следующими свойствами:

1) Оценки являются несмещенными, т.е. математическое ожидание оценки каждого параметра равно его истинному значению: М(b0) = 0; М(b1) = 1. Это вытекает из того, что М(i)=0, и говорит об отсутствии систематической ошибки в определении положения линии регрессии.

2) Оценки состоятельны, так как дисперсия оценок параметров при возрастании числа наблюдений стремится к нулю: limD(b0) = 0; limD(b1) = 0. Иначе говоря, если п достаточно велико, то практически наверняка b0 близко к 0, ab1 близко к 1: надежность оценки при увеличении выборки растет.

3) Оценки эффективны, они имеют наименьшую дисперсию по сравнению с любыми другими оценками данного параметра, линейными относительно величин уi. В англоязычной литературе такие оценки называются BLUE (BestLinear Unbiased Estimators - наилучшие линейные несмещенные оценки).

Перечисленные свойства не зависят от конкретного вида распределения величин i, тем не менее обычно предполагается, что они распределены нормально N(0;y2). Эта предпосылка необходима для проверки статистической значимости сделанных оценок и определения для них доверительных интервалов. При ее выполнении оценки МНК имеют наименьшую дисперсию не только среди линейных, но среди всех несмещенных оценок.

Если предположения 3) и 4) нарушены, то есть дисперсия возмущений непостоянна и/или значения i связаны друг с другом, то свойства несмещенности и состоятельности сохраняются, но свойство эффективности - нет.