- •3. Вероятность на дискретном пространстве элементарных исходов. Классическое определение вероятности. Свойства вероятности.

- •4.Элементы комбинаторики и схемы выбора.

- •5. Геометрическая вероятность. Свойства вероятности.

- •7. Формула полной вероятности и формула Байеса.

- •8. Схема незовисимых испытаний Бернулли,формула Бернулли.Общая теорема о повторении опытов.

- •9. Общая теорема о повторении опытов. Наиболее вероятное число успехов в схеме Бернулли. Номер первого успешного испытания.

- •10. Предельные теоремы в схеме Бернулли. Локальная предельная теорема Муавра-Лапласа. Интегральная теорема Муавра-Лапласа.

- •11. Предельные теоремы в схеме Бернулли. Теорема Пуассона. Закон больших чисел в форме Бернулли.

- •12. Случайные величины и распределения вероятностей. Свойства функции распределения вероятностей.

- •13.Классификация случайных величин. Дискретные распределения (примеры основных распределений)

- •I.Дискретные распределения

- •14. .Классификация случайных величин. Абсолютно непрерывные распределения(примеры основных распределений).

- •I. . Абсолютно непрерывные распределения.

- •15.Нормальное распределение и его свойства.

- •16.Основные распределения случайных величин, применяемые в статистике.

- •17.Мат.Ожидание и его свойства.

- •18.Дисперсия и её свойства

- •20 Числовые характеристики системы двух случайных величин.Ковариация.

- •19.Мода,медиана,моменты,ассиметрия,эксцесс

- •21.Числовые характеристики системы двух случайных величин .Коэффициент корреляции.

- •22.Определение случайной последовательности . Определение сходимости по вероятности .Неравенство Маркова. Неравенство Чебышева.

- •24.Центральная предельная теорема для одинаково распределенных независимых слагаемых. (цпт)

- •25.Определение и описание случайного процесса

- •26.Статистические средние характеристики случайных процессов(сп).

- •27.Стационарные случайные процессы(сп)

- •28.Предмет мат. Статистики

- •29.Средние величины

- •30. Показатели вариации, моменты.

- •31. Статистические оценки параметров распределения. Методы нахождения оценок.

- •32.Метод моментов.

- •34.Интервальные оценки.

27.Стационарные случайные процессы(сп)

Определение 1:СП ξ(t) называется стационарным в узком смысле или строго стационарным,если его конечная функция распределения инвариантна отнасительно сдвигов всех моментов времени на одну и ту же величину τ.F(x1,t1;x2,t2;…;xn,tn)<F(x1,t1+ τ; x2,t2+ τ;…;xn,tn+ τ)(1)n=1,2,3,…Другими словами вероятносные свойства стационарного СП не зависят от начала наблюдений.

При n=1 условие стационарности дает F(x1,t1)= F(x1,t1+ τ) =>p(x1,t1)=p( x1,t1+ τ).Подогая τ=-t1 получим,что F(x1,t1)= F(x1), p(x1,t1)= p(x1) т.е.одномерное распределение стационарного процесса не зависит от времени.А адномерное распределение определяет среднее значение и дисперсии СП,следовательно для строго стационарного СП среднее и дисперсия не зависят от времени:mξ(t)=mξ=const,Дξ(t)=Дξ=const

При n=2 из условия стационарности (1) следует,что F(x1,t1;x2,t2)= F(x1,t1+ τ; x2,t2+ τ).Тоже самое справедливо для плотности распределения вероятностей пологая τ=-t1 получим,что F(x1,t1;x2,t2)= F(x1,; x2,t2-t1),т.е. двумерное распределение строго стационарное СП зависит от разности маментов времени t2-t1.С помощью двумерного распределения коррядяционная функция СП,эначит она для стационарного зависит лишь от разности моментов времени,т.е.одного аргумента: Fξ(t1,t2)= Fξ(t2-t1)

Определение 2:СП назовем стационарным в широком смысле,если его среднее значение и дисперсия не зависят от времени, коррядяционная функция зависит лишь от разности моментов времени.

28.Предмет мат. Статистики

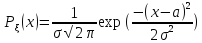

Мат. статистика занимается занимается изучением методов сбора и обработки опытных данных для получения научных и прак. выводов.Мат.статистика(МС)-является разделом математики,очень близким к теории вероятности(ТВ),но МС решает задачи в некотором смысле противоположные задачам ТВ,при этом пользуясь теорией и методами ТВ.Например,в ТВ решалась след.задача:Задана нормальная случайная величина с плотностью распределения вероятностей

.Тогда можно решать

задачи о вычислении мат.ожидания данной

СВ,дисперсии или вероятности попадания

в интервал (α,р),но

при этом параметры а и σ2

считаются известными.Задичи МС в

некотором смысле прямо противоположны

этим задачам:в статистике рассматриваются

данные некоторых опытов или наблюдений,тоесть

известны значения,которые в результате

опытов изучаемая СВ.И по этим статистическим

данным можно получить свединия о

параметрах,характеристиках распределения

СВ или о характере самих

распределений.Наример,можно поставить

задачу о праверке гипотезы,что изучаемая

СВ имеет нормальное распределение,или

найти оценки неизвестных параметров а

и σ2.В

МС обьектом исследования являются

nданныя

эксперемента.

.Тогда можно решать

задачи о вычислении мат.ожидания данной

СВ,дисперсии или вероятности попадания

в интервал (α,р),но

при этом параметры а и σ2

считаются известными.Задичи МС в

некотором смысле прямо противоположны

этим задачам:в статистике рассматриваются

данные некоторых опытов или наблюдений,тоесть

известны значения,которые в результате

опытов изучаемая СВ.И по этим статистическим

данным можно получить свединия о

параметрах,характеристиках распределения

СВ или о характере самих

распределений.Наример,можно поставить

задачу о праверке гипотезы,что изучаемая

СВ имеет нормальное распределение,или

найти оценки неизвестных параметров а

и σ2.В

МС обьектом исследования являются

nданныя

эксперемента.

Вариационные ряды и их графическое изображение

Установление статистических закономерностей,присущих случайным явлениям основано на изучении статистических данных.Стат.данныя-свединья о том,какие значения принял в результате наблюдения интересующий нас признак или СВξ.Генеральной совакупностью называется совокупность обьектов или категория людей,все элементы которой подлежат изучению при статистическом анализе.Пусть исследуется успеваемость студентов 2-го курса вузов Беларуси.Тогда ген.совакупностью будут все студенты 2-го курса вузов Беларуси.На практике изучения всего набора элементов генер.совакупности оказывается затрудительным,поэтому изучают лишь часть этой совакупности.

Выборачной совакупностью или выборкой Х называют часть обьектов генеральной совакупности использумаего для исследования т.е Х={х1,х2,…,хn}.При этом отдельные значения хi называются элементами выборки или вариантами.Число Обьектов в выборке называют обьектом выборки о бозночаются обычно n.Например,если при исследовании успеваемости студентов отобраны 2000 студентов,то n=2000

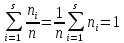

Вариационным рядом называют совакупность вариантов упорядоченности по возрастанию значений.Рассмотрим часто используемыя методы предстовления стат.данных:Дискретным вариационным рядом называют таблицу,которая в 1-й строке содержит все значения(неповторяющиеся)изучаемого признака,упорядоченные по возрастанию,а во второй строке числа их повторений: n1+n2+n3+…+ns=n

|

Х |

х1 |

х2 |

х3 |

… |

хs |

|

n |

n1 |

n2 |

n3 |

… |

ns |

наз. Относительной частатой.Дискретный

вариационный ряд как правило используется

при изучении дискретных СВ.При изучении

непрерывных признаков пользуются

интервальным вариационным рядом.Так

же использование интервальных рядов

целесообразно при изучении выборок

большого обьема.

наз. Относительной частатой.Дискретный

вариационный ряд как правило используется

при изучении дискретных СВ.При изучении

непрерывных признаков пользуются

интервальным вариационным рядом.Так

же использование интервальных рядов

целесообразно при изучении выборок

большого обьема.Интервал

I=[x1,xn]разбивают

на S

промежутков одинаковой длины .При

этом считают

что,каждый из промежутков содержит свой левый конец,но лишь последний промежуток содержит и свой правый конец.Для каждого из промежутка Ii подсчитывают число элементов выборки,попавших в него,результат представляют в виде таблицы:

|

Х |

[x1,x2] |

[x2,x3] |

… |

[xs,xs+1] |

|

n |

n1 |

n2 |

… |

ns |

Число

интервалов определяется по формуле:

S=1+3,322

lg

n,n-число

выборки тогда величина частичного

интервала: = .Для графического изображения вариационных

рядов используется полигон и

гистограмма.Полигон-ломаная,отрезки

которой последовательно соединяют

точки с координатами(хi,ni)((xi,ni/n)),i=1,S.Как

правило полигон служит для изображения

вариационного ряда.При построении

полигона для интервального ряда в

качестве хi

используют

середины интервалов.Гистограмма-ступенчатая

фигура из прямоугольников с

основаниями,равными интервалу Ii=[xi,xi+1]

и высотами равными плотности частоты

.Для графического изображения вариационных

рядов используется полигон и

гистограмма.Полигон-ломаная,отрезки

которой последовательно соединяют

точки с координатами(хi,ni)((xi,ni/n)),i=1,S.Как

правило полигон служит для изображения

вариационного ряда.При построении

полигона для интервального ряда в

качестве хi

используют

середины интервалов.Гистограмма-ступенчатая

фигура из прямоугольников с

основаниями,равными интервалу Ii=[xi,xi+1]

и высотами равными плотности частоты .Сумарная площадь всех прямоугольников

гистограммы равна

.Сумарная площадь всех прямоугольников

гистограммы равна .Гистограмма

используется для предстовления

интервальных вариационных рядов.Гистограмма

является статистическим аналогом кривой

плотности распределения вероятностейpξ(x).Эмпирической

функцией

распределения

называется

функция Fn(x)=

.Гистограмма

используется для предстовления

интервальных вариационных рядов.Гистограмма

является статистическим аналогом кривой

плотности распределения вероятностейpξ(x).Эмпирической

функцией

распределения

называется

функция Fn(x)= ,где

,где -накопленая

частота,равная числу выриантов меньших,чем

х;n-число

выборки.

Эмпирическая

функция распределения Fn(x)

является статист. аналогом теоретической

функции распределения Fξ(x)генеральной

совакупности.Функция Fn(x)

обладает всеми свойствами распределения:

-накопленая

частота,равная числу выриантов меньших,чем

х;n-число

выборки.

Эмпирическая

функция распределения Fn(x)

является статист. аналогом теоретической

функции распределения Fξ(x)генеральной

совакупности.Функция Fn(x)

обладает всеми свойствами распределения:

0≤ Fn(x)≤1

Fn(x)-неубывающая функция

Fn(x)=0,при х≤хmin; Fn(x)=1, при х≥хmax

Эмпирическая функция распределения служит для оценки вида теоритической функции распределения случайного признака,полигон и гистограмма-для оценки вида теоритической плотности распределения.