- •1.Метод наименьших квадратов: алгоритм метода; условия применения.

- •2.Типы переменных в эконометрических моделях. Структурная и приведённая формы спецификации эконометрических моделей.

- •3. Статистические свойства оценок параметров парной регрессионной модели

- •4. Этапы построения эконометрических моделей.

- •5.Порядок оценивания линейной эконометрической модели из изолированного уравнения в Excel. Смысл выходной статистической информации сервиса Регрессия. (10) стр 41

- •6.Спецификация и оценивание мнк эконометрических моделей нелинейных по параметрам. (30) стр.24-25,

- •7. Классическая парная регресионная модель. Спецификация модели. Теорема Гаусса-Маркова.

- •8. Метод наименьших квадратов: алгоритм метода, условия применения.

- •9.Идентификация отдельных уравнений системы одновременных уравнений: порядковое условие. (30)

- •Необходимое условие идентифицируемости

- •10.Оценка параметров парной регрессионной модели методом наименьших квадратов. (10)

- •11.Фиктивные переменные: определение, назначение, типы.

- •12.Автокорреляция случайного возмущения. Причины. Последствия.

- •13.Алгоритм проверки значимости регрессора в парной регрессионной модели.

- •14.Интервальная оценка ожидаемого значения зависимой переменной в парной регрессионной модели.

- •15. Тест Чоу на наличие структурных изменений в регрессионной модели. (20) стр. 59,60

- •16. Алгоритм проверки адекватности парной регрессионной модели. (20) стр. 37, 79

- •17. Коэффициент детерминации в парной регрессионной модели.

- •18. Оценка параметров множественной регрессионной модели методом наименьших квадратов.

- •20. Гетероскедастичность случайного возмущения. Причины. Последствия. Тест gq(20)

- •21.Фиктивная переменная наклона: назначение; спецификация регрессионной модели с фиктивной переменной наклона; значение параметра при фиктивной переменной. (20) стр.65

- •22..Алгоритм теста Дарбина-Уотсона на наличие (отсутствие) автокорреляции случайных возмущений. (20) стр 33

- •23. Структурная и приведённая формы спецификации эконометрических моделей.

- •24. Гетероскедастичность случайного возмущения. Причины. Последствия. Алгоритм теста Голдфельда-Квандта на наличие или отсутствие гетероскедастичности случайных возмущений.

- •Алгоритм теста Голдфелда-Квандта на наличие (отсутствие) гетероскедастичности случайных возмущений.

- •25. Спецификация и оценивание мнк эконометрических моделей нелинейных по параметрам.

- •26. Способы корректировки гетероскедастичности. Метод взвешенных наименьших квадратов

- •27.Проблема мультиколлинеарности в моделях множественной регрессии.Признаки мультиколлениарности.

- •28.Что такое логит,тобит,пробит.

- •29. Что такое Метод наибольшего правдоподобия стр. 62.

- •30. Что такое стационарный процесс?

- •31.Свойства временных рядов.

- •32.Модели ar и var .

- •33. Идентифицируемость системы.

- •34. Настройка модели с системой одновременных уравнений.

- •35.Что такое метод Монте-Карло стр 53

- •36.Оценить качество модели по f, gq, dw (линейнные).Стр.33, 28-29

- •37. Оценка погрешностей параметров эконометрической модели методом Монте-Карло .

- •38. Отражение в модели влияния неучтённых факторов. Предпосылки теоремы Гаусса-Маркова.

- •39.Модели временных рядов. Свойства рядов цен акций на бирже (20) с.93.

- •40. Ожидаемое значение случайной переменной, её дисперсия и среднее квадратическое отклонение. (20) с.12-21

- •41. Оценка параметров парной регрессионной модели методом наименьших квадратов с использованием сервиса Поиск решения.

- •42. Проверка статистических гипотез, t-статистика Стьюдента, доверительная вероятность и доверительный интервал, критические значения статистики Стьюдента. Что такое “толстые хвосты”?

- •43.Проблема мультиколлинеарности в моделях множественной регрессии. Признаки мультиколлинеарности

- •44. Частные коэффициенты детерминации.

- •46. Экономический смысл коэффициентов линейного и степенного уравнений регрессии.

- •47.Оценка коэффициентов модели Самуэльсона-Хикса

- •48. Ошибки от включения в модель незначимых переменных или исключения значимых.С.80

- •49. Исследование множественной регрессионной модели с.74-79.

- •50. Мультиколлинеарность: чем плоха, как обнаружить и как бороться.

- •51. Признаки стационарности стохастического процесса. Что такое «Белый шум»? с.100

- •52. Структурная и приведённая формы спецификации эконометрических моделей.

- •53. Алгоритм проверки значимости регрессора в парной регрессионной модели. По t-статистике, по f-статистике.

- •54.Свойства рядов цен на фондовом рынке. Принципы построения портфеля Марковица с.93,102

- •55.Динамическая модель из одновременных линейных уравнений (привести пример) с.105.

- •56. Метод наибольшего правдоподобия: принципы и целесообразность использования

- •57. Этапы исследования модели множественной регрессии с.74-79.

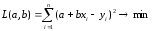

10.Оценка параметров парной регрессионной модели методом наименьших квадратов. (10)

Для оценки параметров линейной или линеаризованной модели применяется метод наименьших квадратов (МНК). Суть метода состоит в следующем: к реальным данным подбирается функция и её параметры, чтобы разности (отклонения, остатки) между реальными и вычисленными значениями у были минимальны. Но разностей много, поэтому минимизируется сумма квадратов этих разностей:

![]()

Рис.3.1. Отклонения реальных у от оценённой функции регрессии.

Как правило, вычисления проводятся на компьютере с использованием различных сервисов и программ. Далее мы рассмотрим технологию МНК, которую использовали при ручном вычислении параметров парной линейной регрессии.

Сумма квадратов остатков, зависящая от параметров a и b

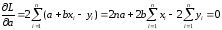

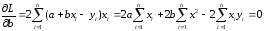

где n – количество измерений. Эта функция достигает минимума в точке, где её частные производные по a и по b равны нулю:

или

an + bx = y

ax + bx2 =xy

Это называется система нормальных уравнений. В ней два уравнения и два неизвестных a и b, а коэффициенты получаются суммированием х, у и т.д. Решать её можно разными способами. В данном случае использован сервис Excel Поиск решения для настройки линейной модели по данным X и Y, представленным в Таблице 3.1. Коэффициенты системы нормальных уравнений расположены в виде матрицы (верхние строки таблицы 3.2), неизвестные a и b задаются произвольно и умножаются на коэффициенты (нижние строки). В окне Поиска решения задаются: Целевая ячейка – первая сумма, Значение равно 247 (y), Изменяя ячейки – a и b, Ограничения: вторая сумма равна 3901 (xy). Исходные данные X и Y приведены в Таблице 3.1. результаты расчёта в Таблице 3.2.

Таблица 3.1. Таблица 3.2.

|

X |

Y |

X2 |

XY |

|

10 |

12 |

100 |

120 |

|

11 |

15 |

121 |

165 |

|

12 |

18 |

144 |

216 |

|

13 |

16 |

169 |

208 |

|

14 |

24 |

196 |

336 |

|

15 |

22 |

225 |

330 |

|

16 |

27 |

256 |

432 |

|

17 |

28 |

289 |

476 |

|

18 |

25 |

324 |

450 |

|

19 |

32 |

361 |

608 |

|

20 |

28 |

400 |

560 |

|

|

|

|

|

|

Суммы 165 |

247 |

2585 |

3901 |

|

11 |

165 |

247 |

|

165 |

2585 |

3901 |

|

|

|

|

|

a |

b |

|

|

-4,27 |

1,78 |

|

|

|

|

Суммы по строкам |

|

-47,00 |

294,00 |

246,9999 |

|

-705,00 |

4606,00 |

3901 |

Теперь можно построить функцию регрессии Ŷ , сравнить её с Y и использовать для прогноза.

В принципе, МНК с Поиском решения можно использовать непосредственно. Для этого надо задать произвольные коэффициенты a и b, построить по ним функцию Ŷ = a + bX, вычислить остатки e = Y – Ŷ и их квадраты, сумму e2.

В окне Поиска решения установить Целевая ячейка e2 минимум, Изменяя ячейки a и b, ограничений нет.

Таблица 3.3.

|

X |

Y |

Ŷ |

Остатки e |

e2 |

|

10 |

12 |

13,545 |

-1,545 |

2,388 |

|

11 |

15 |

15,327 |

-0,327 |

0,107 |

|

12 |

18 |

17,109 |

0,890 |

0,793 |

|

13 |

16 |

18,890 |

-2,890 |

8,357 |

|

14 |

24 |

20,672 |

3,327 |

11,070 |

|

15 |

22 |

22,454 |

-0,454 |

0,206 |

|

16 |

27 |

24,236 |

2,763 |

7,637 |

|

17 |

28 |

26,018 |

1,981 |

3,927 |

|

18 |

25 |

27,8 |

-2,8 |

7,840 |

|

19 |

32 |

29,581 |

2,418 |

5,847 |

|

20 |

28 |

31,363 |

-3,363 |

11,314 |

|

|

|

|

|

|

|

|

|

Суммы |

1E-06 |

59,490 |

|

|

|

|

|

|

|

Дисперсии |

40,872 |

34,923 |

5,949 |

|

|

|

|

|

|

|

|

R2 |

0,854 |

|

a |

b |

|

F |

52,833 |

|

-4,27 |

1,78 |