- •1.Метод наименьших квадратов: алгоритм метода; условия применения.

- •2.Типы переменных в эконометрических моделях. Структурная и приведённая формы спецификации эконометрических моделей.

- •3. Статистические свойства оценок параметров парной регрессионной модели

- •4. Этапы построения эконометрических моделей.

- •5.Порядок оценивания линейной эконометрической модели из изолированного уравнения в Excel. Смысл выходной статистической информации сервиса Регрессия. (10) стр 41

- •6.Спецификация и оценивание мнк эконометрических моделей нелинейных по параметрам. (30) стр.24-25,

- •7. Классическая парная регресионная модель. Спецификация модели. Теорема Гаусса-Маркова.

- •8. Метод наименьших квадратов: алгоритм метода, условия применения.

- •9.Идентификация отдельных уравнений системы одновременных уравнений: порядковое условие. (30)

- •Необходимое условие идентифицируемости

- •10.Оценка параметров парной регрессионной модели методом наименьших квадратов. (10)

- •11.Фиктивные переменные: определение, назначение, типы.

- •12.Автокорреляция случайного возмущения. Причины. Последствия.

- •13.Алгоритм проверки значимости регрессора в парной регрессионной модели.

- •14.Интервальная оценка ожидаемого значения зависимой переменной в парной регрессионной модели.

- •15. Тест Чоу на наличие структурных изменений в регрессионной модели. (20) стр. 59,60

- •16. Алгоритм проверки адекватности парной регрессионной модели. (20) стр. 37, 79

- •17. Коэффициент детерминации в парной регрессионной модели.

- •18. Оценка параметров множественной регрессионной модели методом наименьших квадратов.

- •20. Гетероскедастичность случайного возмущения. Причины. Последствия. Тест gq(20)

- •21.Фиктивная переменная наклона: назначение; спецификация регрессионной модели с фиктивной переменной наклона; значение параметра при фиктивной переменной. (20) стр.65

- •22..Алгоритм теста Дарбина-Уотсона на наличие (отсутствие) автокорреляции случайных возмущений. (20) стр 33

- •23. Структурная и приведённая формы спецификации эконометрических моделей.

- •24. Гетероскедастичность случайного возмущения. Причины. Последствия. Алгоритм теста Голдфельда-Квандта на наличие или отсутствие гетероскедастичности случайных возмущений.

- •Алгоритм теста Голдфелда-Квандта на наличие (отсутствие) гетероскедастичности случайных возмущений.

- •25. Спецификация и оценивание мнк эконометрических моделей нелинейных по параметрам.

- •26. Способы корректировки гетероскедастичности. Метод взвешенных наименьших квадратов

- •27.Проблема мультиколлинеарности в моделях множественной регрессии.Признаки мультиколлениарности.

- •28.Что такое логит,тобит,пробит.

- •29. Что такое Метод наибольшего правдоподобия стр. 62.

- •30. Что такое стационарный процесс?

- •31.Свойства временных рядов.

- •32.Модели ar и var .

- •33. Идентифицируемость системы.

- •34. Настройка модели с системой одновременных уравнений.

- •35.Что такое метод Монте-Карло стр 53

- •36.Оценить качество модели по f, gq, dw (линейнные).Стр.33, 28-29

- •37. Оценка погрешностей параметров эконометрической модели методом Монте-Карло .

- •38. Отражение в модели влияния неучтённых факторов. Предпосылки теоремы Гаусса-Маркова.

- •39.Модели временных рядов. Свойства рядов цен акций на бирже (20) с.93.

- •40. Ожидаемое значение случайной переменной, её дисперсия и среднее квадратическое отклонение. (20) с.12-21

- •41. Оценка параметров парной регрессионной модели методом наименьших квадратов с использованием сервиса Поиск решения.

- •42. Проверка статистических гипотез, t-статистика Стьюдента, доверительная вероятность и доверительный интервал, критические значения статистики Стьюдента. Что такое “толстые хвосты”?

- •43.Проблема мультиколлинеарности в моделях множественной регрессии. Признаки мультиколлинеарности

- •44. Частные коэффициенты детерминации.

- •46. Экономический смысл коэффициентов линейного и степенного уравнений регрессии.

- •47.Оценка коэффициентов модели Самуэльсона-Хикса

- •48. Ошибки от включения в модель незначимых переменных или исключения значимых.С.80

- •49. Исследование множественной регрессионной модели с.74-79.

- •50. Мультиколлинеарность: чем плоха, как обнаружить и как бороться.

- •51. Признаки стационарности стохастического процесса. Что такое «Белый шум»? с.100

- •52. Структурная и приведённая формы спецификации эконометрических моделей.

- •53. Алгоритм проверки значимости регрессора в парной регрессионной модели. По t-статистике, по f-статистике.

- •54.Свойства рядов цен на фондовом рынке. Принципы построения портфеля Марковица с.93,102

- •55.Динамическая модель из одновременных линейных уравнений (привести пример) с.105.

- •56. Метод наибольшего правдоподобия: принципы и целесообразность использования

- •57. Этапы исследования модели множественной регрессии с.74-79.

42. Проверка статистических гипотез, t-статистика Стьюдента, доверительная вероятность и доверительный интервал, критические значения статистики Стьюдента. Что такое “толстые хвосты”?

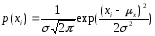

Инженеры считают, что размеры деталей подчиняются закону нормального распределения (ЗНР), выведенного К.Гауссом

Как видите, в функции Гаусса всего два параметра: математическое ожидание µх и стандартное отклонение , которые сравнительно легко оценить по выборке, используя формулы (2.4) и (2.5 ). Эти формулы реализованы в Excel в функциях соответственно СРЗНАЧ, ДИСП и СТАНДОТКЛОН, категория «Статистические». Зная параметры гауссианы, можно вычислить процент деталей в различных диапазонах х (квантили), используя таблицы или функцию НОРМРАСП Excel. Поэтому закон нормального распределения широко применяется при проектировании машин и механизмов. Например, можно вычислить количество событий (деталей) в диапазоне {Е(х) -2, Е(х) +2}. Это примерно 95%, то есть в “хвостах” останется по 2,5%. В данном случае р = 0,95 – доверительная вероятность, а {Е(х) -2, Е(х) +2} - соответствующий доверительный интервал.

На

Рисунке 2.2 показано применение функции

НОРМРАСП. Площадь левого хвоста гауссианы

(Рисунок 2.1) от -

![]() до -1,96 (почти 2) равна 0,024997895, то есть

2,5%.

до -1,96 (почти 2) равна 0,024997895, то есть

2,5%.

В общем виде это утверждение выглядит следующим образом:

для уровня значимости = 1– р доверительный интервал равен

{Е(х) – tкрит, Е(х) + tкрит}, где tкрит – критические значения статистики Стьюдента t = Е(х)/. В нашем примере – доля деталей в одном или двух “хвостах”. При уменьшении числа замеров надёжность оценки Е(х) и дисперсии падают, и доверительный интервал надо расширять. Поэтому критические значения статистики Стьюдента зависят от уровня значимости (доверительной вероятности) и количества замеров (степеней свободы). Распределение Стьюдента tкрит(, n) приведено во всех учебниках и практикумах по математической статистике и эконометрике. В Excel имеется функция СТЬЮДРАСП(tкрит, n, число хвостов (1 или 2)), которая возвращает долю событий в одном или двух “хвостах”. Для практических целей достаточно запомнить, что при числе замеров больше 30 и р=95% tкрит примерно равно 2 (при “бесконечном” числе замеров – 1,96).

Для принятия гипотезы о влиянии регрессора на эндогенную переменную используются таблицы критических значений t-статистики Стьюдента. Для b t=b/Sb . Предполагается, что при числе измерений больше 20 истинные значения коэффициентов уравнения регрессии и лежат в интервалах {a-2Sa , b+2 Sb } и {b-2Sb , b+2 Sa } с доверительной вероятностью 95%.

43.Проблема мультиколлинеарности в моделях множественной регрессии. Признаки мультиколлинеарности

Множественная регрессия позволяет построить и проверить модель линейной связи между зависимой (эндогенной) и несколькими независимыми (экзогенными) переменными: y = f(x1,...,xр ), где у - зависимая переменная (результативный признак); х1,...,хр - независимые переменные (факторы). Множественная линейная регрессионная модель имеет вид: y=a+b1x1+b2x2+…+bpxp+ε Факторы, включаемые во множественную регрессию, должны отвечать следующим требованиям:

1. быть количественно измеримы. При включении качественного фактора нужно придать ему количественную определенность

2. не должны быть коррелированы между собой и тем более и годиться в точной функциональной связи.

Включение в модель факторов с высокой интеркорреляцией, когда ryx1 < rx1x2 может повлечь за собой неустойчивость и ненадежность оценок коэффициентов регрессии. Поскольку одним из условий построения уравнения множественной регрессии является независимость действия факторов, коллинеарность факторов нарушает это условие. Если факторы явно коллинеарны, то они дублируют друг друга и один из них рекомендуется исключить из регрессии. Предпочтение при этом отдается фактору, который при достаточно тесной связи с результатом имеет наименьшую тесноту связи с другими факторами

Признаки мультиколлинеарности.

1.В модели с двумя переменными одним из признаков мультиколлинеарности является близкое к единице значение коэффициента парной корреляции. Если значение хотя бы одного из коэффициентов парной корреляции больше, чем 0,8, то мультиколлинеарность представляет собой серьезную проблему. Однако в модели с числом независимых переменных больше двух, парный коэффициент корреляции может принимать небольшое значение даже в случае наличия мультиколлинеарности. В этом случае лучше рассматривать частные коэффициенты корреляции. 2. Для проверки мультиколлинеарности можно рассмотреть детерминант матрицы коэффициентов парной корреляции |r|. Этот детерминант называется детерминантом корреляции |r| ∈(0; 1). Если |r| = 0, то существует полная мультиколлинеарность. Если |r|=1, то мультиколлинеарность отсутствует. Чем ближе |r| к нулю, тем более вероятно наличие мультиколлинеарности. 3. Если оценки имеют большие стандартные ошибки, невысокую значимость, но модель в целом значима (имеет высокий коэффициент детерминации), то это свидетельствует о наличие мультиколлинеарности. 4. Если введение в модель новой независимой переменной приводит к существенному изменению.