- •О.К. Мурга

- •Оглавление

- •1. Методы одномерной оптимизации 6

- •2. Методы безусловной оптимизации 13

- •3. Методы оптимизации при наличии ограничений 35

- •4. Приближённое решение задачи оптимального управления 53

- •Введение

- •1. Методы одномерной оптимизации

- •1.1. Методы перебора

- •1.1.1. Метод равномерного поиска

- •1.1.2. Метод поразрядного поиска

- •1.2. Методы исключения отрезков

- •1.2.1. Метод дихотомии

- •1.2.2. Метод золотого сечения

- •1.3. Сравнительный анализ методов одномерного поиска

- •1.4. Порядок выполнения лабораторной работы

- •1.5. Задания для лабораторной работы.

- •2. Методы безусловной оптимизации

- •2.1. Прямые методы безусловной оптимизации

- •2.1.1. Поиск по правильному симплексу

- •2.1.2. Поиск по деформируемому многограннику

- •Влияние параметров алгоритма на эффективность поиска

- •2.1.3. Типовой пример.

- •2.1.4. Порядок выполнения лабораторной работы

- •2.1.5. Задания для лабораторной работы

- •2.2 Методы покоординатного спуска

- •2.2.1 Метод циклического покоординатного спуска

- •2.2.2. Метод Зейделя.

- •2.2.3. Метод Хука-Дживса

- •2.2.4. Метод Пауэлла.

- •2.2.5. Типовые примеры

- •2.2.6. Порядок выполнения лабораторной работы

- •2.2.7. Задания для лабораторной работы

- •2.3. Градиентные методы

- •2.3.1. Метод градиентного спуска

- •2.3.2. Метод наискорейшего спуска

- •2.3.3. Типовой пример

- •2.3.4. Порядок выполнения лабораторной работы

- •2.3.5. Задания для лабораторной работы

- •3. Методы оптимизации при наличии ограничений

- •3.1. Методы последовательной безусловной оптимизации

- •3.1.1. Метод штрафных функций

- •3.1.2. Метод барьерных функций

- •3.1.3. Комбинированный метод штрафных функций

- •3.1.4. Типовой пример

- •3.1.5. Задание для лабораторной работы

- •3.2. Метод возможных направлений

- •3.2.1. Постановка задачи выпуклого программирования

- •3.2.2. Описание метода возможных направлений

- •3.2.3. Построение начального приближения

- •3.2.4. Выбор наилучшего подходящего направления

- •3.2.5. Определение длины шага

- •3.2.6. Типовой пример

- •3.2.7. Задания для лабораторной работы

- •3.3. Метод случайного поиска

- •3.3.1. Поиск с возвратом при неудачном шаге

- •3.3.2. Алгоритм наилучшей пробы

- •3.3.3. Алгоритм статистичекого градиента

- •3.3.4. Порядок выполнения работы

- •3.3.5. Задания для лабораторной работы

- •4. Приближённое решение задачи оптимального управления

- •4.1. Постановка задачи оптимального управления

- •4.2. Градиентный метод решения задачи оптимального управления

- •4.2.1. Описание градиентного метода в функциональном пространстве.

- •4.2.2. Алгоритм метода.

- •4.2.3. Порядок выполнения лабораторной работы.

- •4.2.4. Задания для лабораторной работы.

- •Список литературы

1.3. Сравнительный анализ методов одномерного поиска

Эффективность прямых методов обычно оценивают или по объему вычислений, обеспечивающему заданную точность, или по гарантированной точности, достигнутой в результате выполнения заданного объема вычислений.

Поскольку при реализации методов одномерного поиска определение значений функции f(х) требует несравненно больших затрат, чем выполнение таких вспомогательных операций, как вычисление точек перебора, сравнение значений функции и т.п., то объем вычислений можно оценить количеством N вычислений значений функции f(х).

Метод считается тем эффективнее, чем меньше N, гарантирующее заданную точность определения точки х* минимума функции f(х). Для сравнения рассматриваемых методов по этому признаку рекомендуется составить таблицу значений N(e) в зависимости от требуемой точности определения х*.

При сравнении методов по точности более эффективным считается тот из рассматриваемых методов, который обеспечивает достижение меньшего значения e(N) при одинаковом объеме вычислений. Для получения вывода о точности рекомендуется составить таблицу значений достигнутой точности e(N) в зависимости от количества N найденных значений функции f(х) для указанных методов.

1.4. Порядок выполнения лабораторной работы

Кратко описать изучаемые методы одномерного поиска.

Решить задачу (1.1) классическим методом.

Выполнить программную реализацию каждого алгоритма.

Провести расчеты указанной в индивидуальном задании (см. пункт 1.5) задачи при различных значениях параметров алгоритмов с целью получения результатов, достаточных для сравнения изучаемых методов.

Выполнить сравнительный анализ (см. пункт 1.3) изучаемых методов, составив для этого таблицы значений N(e) и en(N).

Сформулировать вывод о сравнительной эффективности изучаемых методов. Содержание работы отразить в отчете.

1.5. Задания для лабораторной работы.

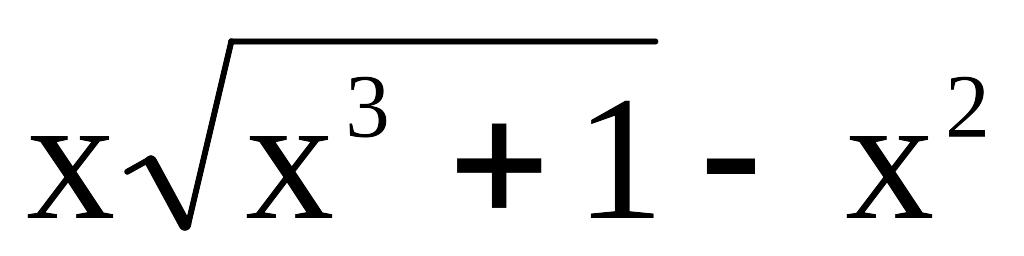

Минимизировать функцию f(х)=

на отрезке [-1;2].

на отрезке [-1;2].Минимизировать функцию f(х)= x

на

отрезке [0,1;3].

на

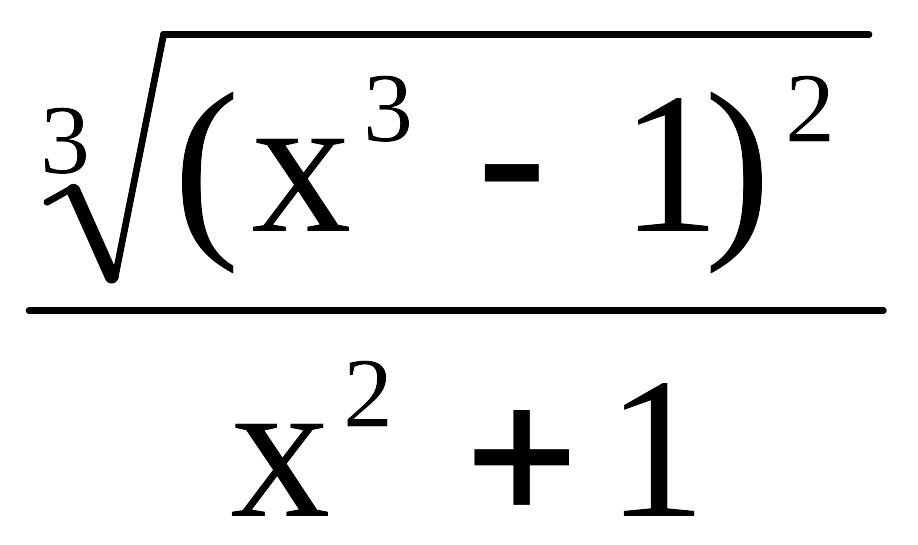

отрезке [0,1;3].Минимизировать функцию f(х)=

на

отрезке [0;2].

на

отрезке [0;2].Минимизировать функцию f(х)= x ln(x+1) на отрезке [-0,3;2].

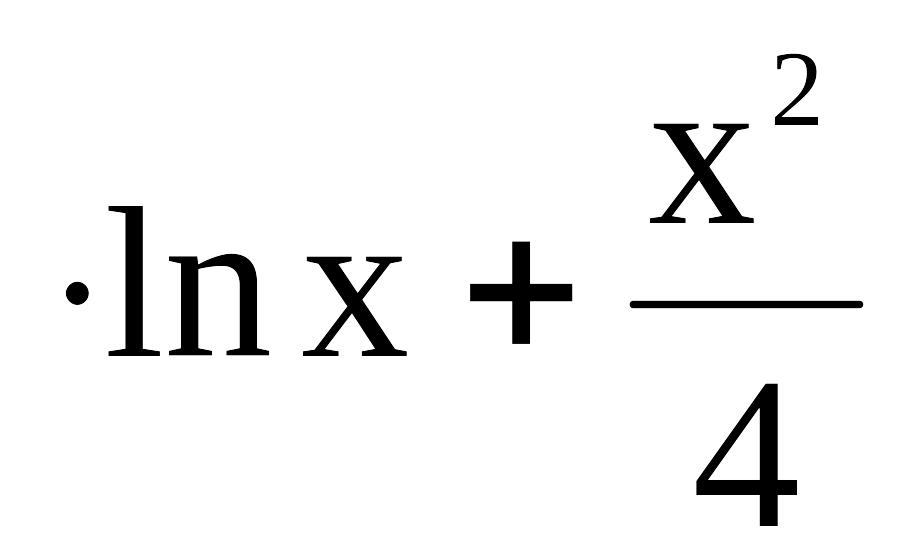

Минимизировать функцию f(х)=

на отрезке [0;3].

на отрезке [0;3].Минимизировать функцию f(x)= x3 3 sin x на отрезке [0;1].

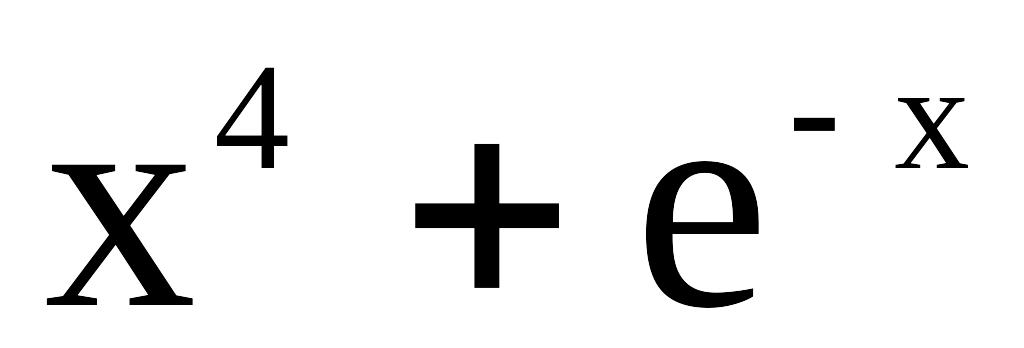

Минимизировать функцию f(x)=

на отрезке [0,5;2].

на отрезке [0,5;2].Минимизировать функцию f(x)= x4+x2+x+1 на отрезке [-1;0].

2. Методы безусловной оптимизации

![]()

Задачи безусловной оптимизации сводятся к поиску точек минимума функции многих переменных на всём пространстве соответствующей размерности. Функции многих переменных f(X)=f(x1,x2,...,xn) будем рассматривать как функции, заданные в точках Х n-мерного евклидова пространства En. Изучим основные методы решения задач безусловной минимизации вида

min{f(X) | XÎ En }. (2.1)

Если функция f(x) дважды дифференцируема, то задачу (2.1) можно решить классическим методом с помощью необходимых и достаточных условий безусловного экстремума. При этом из необходимого условия

![]() или

или

![]()

![]() (2.2)

(2.2)

находим

все стационарные точки функции f(x).

Среди них, используя достаточные условия,

находим точки локального минимума, в

которых матрица вторых производных

![]() положительно определена. Сравнивая

значения функции в этих точках, определяем

точку глобального минимума.

положительно определена. Сравнивая

значения функции в этих точках, определяем

точку глобального минимума.

Однако, аналитически решить систему уравнений (2.2) не всегда возможно. Кроме того, функция f(x) может быть не только недифференцируемой, но даже не аналитически заданной. Поэтому классический метод имеет ограниченное применение и для решения задачи (2.1) на практике разрабатывают приближённые численные методы. Простейшие из них, называемые прямыми методами, предполагают лишь возможность вычисления или измерения значений функции и не требуют вычисления её производных.

Рассмотрим основные из этих прямых методов, использующие итерационные процедуры вида

Xk+1=F(Xk, Xk-1,…, X0), X0Î En, (2.3)

в которых выбор нового приближения к точке минимума определяется сравнением значений функции f(X) в нескольких точках пространства En.