- •Учреждение образования «Высший государственный колледж связи»

- •Теория электросвязи

- •Раздел 1. Основы анализа сигналов.

- •1.1. Основные элементы функционального анализа сигналов. Норма и метрика.

- •1.2 Ортогональные сигналы. Ортонормированный базис. Обобщенный ряд Фурье

- •Раздел 2. Основы спектрального анализа сигналов

- •2.1 Теоремы о спектрах

- •2.3. Спектры модулированных сигналов.

- •2.3.1 Спектры амплитудно модулированных сигналов

- •2.3.2 Спектр сигналов с угловой модуляцией

- •Раздел 3. Аналитический сигнал и преобразования Гильберта

- •3.1 Аналитический сигнал. Основные понятия и определения. Спектр аналитического сигнала.

- •3.2 Преобразования Гильберта и его свойства. Применение пре образования Гильберта.

- •Раздел 4. Основы корреляционного анализа сигналов

- •4.1. Автокорреляционная функция сигналов

- •4.2. Взаимокорреляционная функция двух сигналов

- •Раздел 5. Основные элементы цифровой обработки сигналов

- •5.1. Дискретное преобразование Фурье

- •5.2. Быстрое преобразование Фурье

- •Раздел 6. Математические модели приема сигналов на фоне помех

- •6.1. Стационарные и эргодические случайные процессы.

- •6.2. Спектральное представление стационарных случайных процессов. Теорема Винера-Хинчина

- •Раздел 7. Математические модели приема сигналов на фоне помех (окончание)

- •7.1 Типовые модели случайных сигналов

- •7.2 Узкополосные случайные сигналы

- •Раздел 8. Основные сведения о шумоподобных сигналах

- •8.1 Шумоподобные сигналы и их свойства. Применение шумоподобных сигналов.

- •Раздел 9. Основы теории разделения сигналов

- •9.1 Основные положения линейной теории сигналов.

- •9.2 Структурная схема системы многоканальной передачи информации.

- •Раздел 10. Основные положения теории передачи информации

- •10.1 Информационные характеристики дискретных сообщений и сигналов

- •10.2 Взаимная информация

- •10.3. Информация в непрерывных сигналах. Дифференциальная энтропия.

- •10.4. Пропускная способность канала связи

- •10.5. Информация в непрерывных сообщениях. Эпсилон-энтропия

- •Раздел 11. Принципы оптимальной обработки сигналов на фоне помех

- •11.1. Задача оптимального приёма дискретных сообщений

- •11.2. Элементы теории решений

- •11.3. Критерии оптимизации приёма дискретных сообщений

- •11.4 Алгоритм оптимального приёма при полностью известных сигналах. (Когерентный приём)

- •Раздел 12. Принципы оптимальной обработки сигналов на фоне помех (продолжение)

- •16.5 Реализация алгоритма оптимального приема на основе корреляторов

- •12.2 Реализация алгоритма оптимального приёма на основе согласованных фильтров. Свойства согласованного фильтра

- •12.3 Потенциальная помехоустойчивость систем с различными видами манипуляции

- •Раздел 13. Принципы оптимальной обработки сигналов на фоне помех (окончание)

- •13.1 Оптимальный прием дискретных сообщений с неопределенной фазой (Некогерентный прием).

- •13.2 Помехоустойчивость систем с различными видами дискретной модуляции при некогерентном приеме

- •13.3 Прием дискретных сообщений в каналах с замираниями

- •Раздел 14. Основы цифровой обработки сигналов

- •14.1 Основные принципы цифровой фильтрации. Характеристики и свойства цифровых фильтров.

- •14.2 Алгоритм линейной цифровой фильтрации.

- •Тема 15. Основы цифровой обработки сигналов (окончание)

- •15.1 Трансверсальные цифровые фильтры.

- •15.2 Рекурсивные цф. Устойчивость цифровых фильтров

- •Раздел 16. Введение в вейвлет-преобразования сигналов

- •16.1 Понятие вейвлет-преобразования. Основные вейвлеты, применяемые в системах связи.

- •16.2 Дискретный вейвлет-анализ.

- •16.3 Непрерывное вейвлет-преобразование

- •Содержание.

10.3. Информация в непрерывных сигналах. Дифференциальная энтропия.

Обобщим теперь

понятия энтропии и взаимной информации

на ансамбли непрерывных сигналов. Пусть

-

случайная величина (сечение или отсчёт

случайного сигнала), определённая в

некоторой непрерывной области, и её

распределение вероятностей характеризуется

плотностью

-

случайная величина (сечение или отсчёт

случайного сигнала), определённая в

некоторой непрерывной области, и её

распределение вероятностей характеризуется

плотностью .

.

Разобьём область

значений

на небольшие интервалы протяжённостью

на небольшие интервалы протяжённостью .

Вероятность того, что

.

Вероятность того, что лежит в интервале

лежит в интервале ,

, +

+ ,

то есть

,

то есть ,

приблизительно равна

,

приблизительно равна , причём приближение тем точнее, чем

меньше интервал

, причём приближение тем точнее, чем

меньше интервал .

Степень неожиданности такого события

равна

.

Степень неожиданности такого события

равна .

Если значения

.

Если значения в пределах конечного интервала

в пределах конечного интервала заменить значениями

заменить значениями в начале интервала, то непрерывный

ансамбль заменится дискретным, а его

энтропия определится как:

в начале интервала, то непрерывный

ансамбль заменится дискретным, а его

энтропия определится как:

Будем теперь

увеличивать точность определения

значения

,

уменьшая интервал

,

уменьшая интервал .

В пределе, при

.

В пределе, при должна получиться энтропия непрерывной

случайной величины:

должна получиться энтропия непрерывной

случайной величины:

(10.17) Второй

член в полученном выражении стремится

к

и совершенно не зависит от распределения

вероятностей

и совершенно не зависит от распределения

вероятностей .

Это значение , что собственная информация

любой непрерывной случайной величины

бесконечно велика. Тем не менее, взаимная

информация между двумя непрерывными

ансамблями, как правило, остаётся

конечной. Такова будет, в частности,

взаимная информация между переданным

и принятым сигналами, так что по каналу

связи информация передаётся с конечной

скоростью.

.

Это значение , что собственная информация

любой непрерывной случайной величины

бесконечно велика. Тем не менее, взаимная

информация между двумя непрерывными

ансамблями, как правило, остаётся

конечной. Такова будет, в частности,

взаимная информация между переданным

и принятым сигналами, так что по каналу

связи информация передаётся с конечной

скоростью.

Обратим внимание

на первый член в данной формуле. Он

является конечным и определяется

плотностью распределения вероятности

. Его называют дифференциальной энтропией

и обозначают

. Его называют дифференциальной энтропией

и обозначают :

:

(10.18)

(10.18)

Попытаемся теперь

определить взаимную информацию между

двумя непрерывными случайными величинами

и

и .

Разбив области определения

.

Разбив области определения и

и соответственно на небольшие интервалы

соответственно на небольшие интервалы и

и ,

заменим эти непрерывные величины

дискретными так же, как это делалось

при выводе формулы

,

заменим эти непрерывные величины

дискретными так же, как это делалось

при выводе формулы .

Исходя из этого выражения можно

определить взаимную информацию между

непрерывными величинами

.

Исходя из этого выражения можно

определить взаимную информацию между

непрерывными величинами и

и :

:

(10.19)

(10.19)

При этом никаких

явных бесконечностей не появилось, и

действительно, в обычных случаях взаимная

информация оказывается конечной. С

помощью простых преобразований её можно

представить и в таком виде:

(10.20)

(10.20)

Здесь

- определённая ранее дифференциальная

энтропия

- определённая ранее дифференциальная

энтропия ,

а

,

а -

условная дифференциальная энтропия.

Легко убедиться, что основные свойства

взаимной информации остаются справедливыми

и в данном случае.

-

условная дифференциальная энтропия.

Легко убедиться, что основные свойства

взаимной информации остаются справедливыми

и в данном случае.

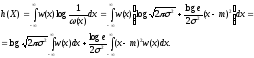

В качестве

примера найдём дифференциальную энтропию

случайной величины

с нормальным распределением вероятности:

с нормальным распределением вероятности:

,

(10.21)

,

(10.21)

где

математическое

ожидание, а

математическое

ожидание, а -

дисперсия

-

дисперсия .

.

Подставив (10.21) в (10.18), найдём:

Первый интеграл

по общему свойству плотности вероятности

равен 1, а второй – по определению

дисперсии равен

.

Окончательно

.

Окончательно

(10.22)

(10.22)

Таким образом, дифференциальная энтропия гауссовской случайной величины не зависит от её математического ожидания и монотонно возрастает с увеличением дисперсии.

В заключение

укажем одно важное свойство нормального

распределения: из всех непрерывных

случайных величин

с одинаковой дисперсией

с одинаковой дисперсией наибольшую дифференциальную энтропию

имеет величина с нормальным распределением.

наибольшую дифференциальную энтропию

имеет величина с нормальным распределением.