- •А.В. Данеев, о.Г. Деменченок информатика. Базовый курс

- •230100.62 «Информатика и вычислительная техника»

- •Содержание

- •Введение

- •Основные понятия информатики

- •Информация и ее свойства

- •Меры измерения информации

- •Системы счисления

- •Перевод числа из десятичной системы в двоичную

- •Перевод числа из двоичной системы в десятичную

- •Выполнение арифметических операций в двоичной системе

- •Показатели качества информации

- •Вопросы для контроля

- •Алгоритмизация

- •Понятие алгоритма

- •Этапы решения задач

- •1. Постановка задачи

- •2. Разработка алгоритма

- •3. Реализация алгоритма

- •4. Выполнение алгоритма и получение результатов

- •5. Анализ полученных результатов

- •Способы описания алгоритмов

- •Языки программирования

- •Виды алгоритмов

- •Циклический алгоритм

- •Вопросы для контроля

- •Аппаратное обеспечение

- •Классификация эвм

- •Классификация эвм

- •По элементной базе

- •По назначению

- •Состав персонального компьютера

- •Компьютера

- •(Simm-модуль)

- •(Dimm-модуль)

- •(Rimm-модуль)

- •Габаритные размеры (форм-фактор)

- •Физические характеристики

- •Стандарты записи дисков dvd

- •Формат оптических носителей Blu-Ray

- •Классификация по способу формирования изображения

- •Размеры экранов

- •Воздействие на здоровье

- •Оптическое разрешение

- •Глубина цвета

- •Динамический диапазон (диапазон оптических плотностей)

- •Принтер

- •Работа с клавиатурой

- •A) алфавитно-цифровых клавиш; b) функциональных клавиш; c) клавиш перемещения курсора; d) цифровых клавиш

- •Вопросы для контроля

- •Программное обеспечение

- •Структура программного обеспечения

- •Системное программное обеспечение

- •Прикладное программное обеспечение

- •Средства программирования

- •Файловая система

- •Сравнение файловых систем ntfs с fat и fat32

- •Вопросы для контроля

- •Текстовые процессоры

- •Средства обработки текстовой информации

- •Экран текстового процессора microsoft word

- •Операции с документами

- •Набор и редактирование текста

- •Операции с фрагментами текста

- •Форматирование текста

- •Вопросы для контроля

- •Графические редакторы

- •Векторная графика

- •Точечная (растровая) графика

- •Основные параметры изображения

- •Типы изображений

- •Черно-белые (штриховые) изображения

- •Полутоновые изображения

- •Индексированный цвет

- •Полноцветные изображения

- •Цветовые модели

- •Форматы файлов

- •Получение изображений

- •Вопросы для контроля

- •Электронные таблицы

- •Структура электронной таблицы

- •Ввод данных

- •Редактирование и форматирование данных

- •Технология интервального прогнозирования

- •Вопросы для контроля

- •Защита информации понятие информационной безопасности

- •Потенциальные угрозы и каналы утечки информации

- •Цели и задачи систем компьютерной безопасности

- •Принципы построения систем защиты компьютерной информации

- •Средства обеспечения безопасности информации

- •Характеристика средств защиты информации

- •Обеспечение защиты информации

- •Основы криптографии

- •Классификация криптосистем

- •Стандарты симметричных криптосистем

- •Гост 28147-89 - отечественный стандарт шифрования

- •Асимметричные криптосистемы

- •Отечественный стандарт цифровой подписи

- •Аппаратно-программные комплексы

- •Разграничение доступа

- •Вопросы для контроля

- •Автоматизация решения прикладных задач

- •Начальные сведения о vba

- •Использование макросов в vba

- •Запись макроса

- •Выполнение макроса

- •Редактирование макроса

- •Ограниченность макросов

- •Основы программирования на языке vba

- •Объектная модель vba

- •Applicaion.Workbooks("Книга1").Worksheets("Лист1").Range("Al")

- •Работа с объектами

- •MsgBox "Ячейка содержит значение " & Range("Al").Value

- •Объект.Метод

- •Workbooks("Примеры").Open

- •Вопросы для контроля

- •Системы управления базами данных

- •Основные понятия

- •Архитектура базы данных. Физическая и логическая независимость

- •Microsoft access как субд реляционного типа

- •Вопросы для контроля

- •Компьютерные сетевые технологии

- •Понятие, назначение и история развития компьютерных сетей

- •Каналы связи

- •Аппаратное и программное обеспечение компьютерных сетей

- •Классификация, архитектура и топология компьютерных сетей

- •Характеристика процесса передачи данных

- •Особенности организации лвс

- •Требования, предъявляемые к компьютерным сетям

- •Глобальная сеть internet

- •Система адресации в Internet

- •Способы организации передачи информации

- •Вопросы для контроля

- •Заключение

- •Библиографический список

Меры измерения информации

Для измерения информации вводятся два параметра: количество информации I и объем данных Vд.

Эти параметры имеют разные выражения и интерпретацию в зависимости от рассматриваемой формы адекватности.

Синтаксическая мера информации. Эта мера количества информации оперирует с обезличенной информацией, не выражающей смыслового отношения к объекту.

Объем данных Vд в сообщении измеряется количеством символов (разрядов) в этом сообщении. В качестве такой единицы принято количество информации, связанной с опытом, состоящим в выборе одного из двух равновероятных исходов.

Рассмотрим простой пример. Используя электрическое устройство, можно включать и выключать свет в комнате. Следовательно, выключатель может иметь два равновероятных состояния – «включен» или «выключен». Такая единица количества информации получила название «бит». Изменение состояния происходит по управляющему сигналу, содержащему информацию в 1 бит.

Бит (от англ. binary digit – двоичное число) – это единица измерения информации, равная количеству информации, получаемой из опыта с одним из двух равновероятных исходов.

Двоичное представление информации соответствует алфавиту из всего двух символов нуля и единицы. При таком представлении буквы, цифры и другие символы изображаются двоичными словами последовательностями нулей и единиц.

Например, для чисел с фиксированной точкой каждый бит в машинном слове соответствует определенному двоичному разряду, т. е. его значение (0 или 1) умножается на определенную степень числа 2. Для целых чисел младший разряд соответствует нулевой степени числа 2. Например, двоичное число 101 соответствует в десятичной системе 5:

1012 = 120 + 021 + 122 = 1 + 0 + 4 = 510.

Используют и более крупную единицу информации – байт.

Байт – единица информации, эквивалентная одному символу из 256 возможных, что в двоичной системе соответствует восьмиразрядному двоичному слову (или 8 бит).

Объем информации в 1024 (210 = 1024) байта носит название килобайт (кб). Используются и еще более крупные единицы информации: мегабайт (1024 кбайта), гигабайт (1024 Мбайта), терабайт (1024 Гбайта), петабайт (1024 Тбайта).

Получение информации о какой-либо системе всегда связано с изменением степени неосведомленности получателя о состоянии этой системы. Рассмотрим это понятие.

Пусть до получения информации потребитель имеет некоторые предварительные сведения о системе α. Мерой его неосведомленности о системе является функция H(α), которая в то же время служит и мерой неопределенности состояния системы.

Энтропия H(α) – мера неопределенности состояния системы.

После получения некоторого сообщения β получатель приобрел некоторую дополнительную информацию Iβ(α), уменьшившую его априорную неосведомленность так, что неопределенность состояния системы стала Hβ(α).

Тогда количество информации о системе, полученной в сообщении β, определяется:

Iβ(α) = H(α) Hβ(α),

т. е. количество информации измеряется изменением (уменьшением) неопределенности состояния системы.

Для задач такого рода американский ученый Клод Шеннон предложил в 1948 году формулу определения количества информации:

![]() ,

,

где N – число возможных состояний системы; Pi – вероятность того, что система находится в i-м состоянии.

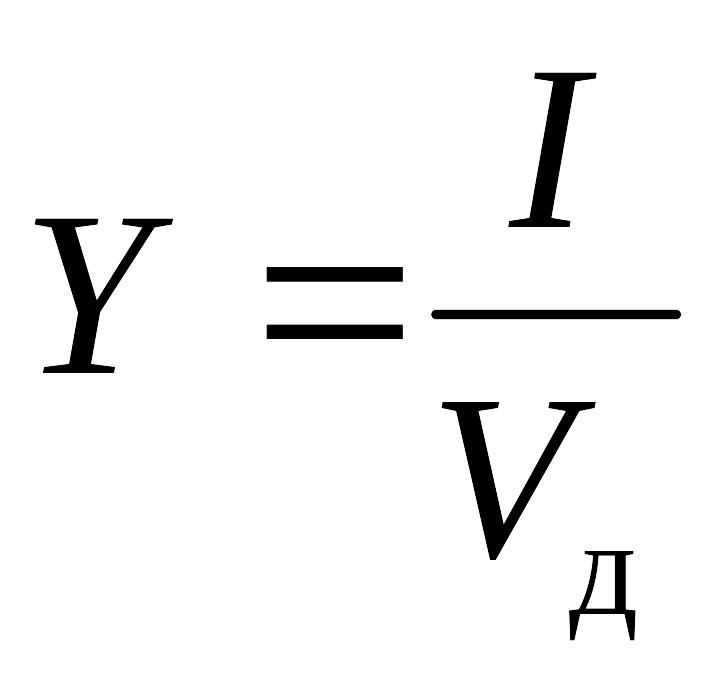

Коэффициент (степень) информативности (лаконичность) сообщения определяется отношением количества информации к объему данных, т. е.

,

,

причем 0 < Y < 1.

С увеличением Y уменьшаются объемы работы по преобразованию информации (данных) в системе. Поэтому стремятся к повышению информативности, для чего разрабатываются специальные методы оптимального кодирования информации.

Семантическая мера информации. Для измерения смыслового содержания информации, т. е. ее количества на семантическом уровне, наибольшее признание получила тезаурусная мера, которая связывает семантические свойства информации со способностью пользователя принимать поступившее сообщение. Для этого используется понятие тезаурус пользователя.

Тезаурус – это совокупность сведений, которыми располагает пользователь или система.

В зависимости от соотношений между смысловым содержанием информации S и тезаурусом пользователя Sp изменяется количество семантической информации Ic, воспринимаемой пользователем и включаемой им в дальнейшем в свой тезаурус (рис. 1).

Ic

Ic

Imax

Imax

Sp

Sp

Sopt

Рис. 1. Зависимость количества семантической информации, воспринимаемой потребителем, от его тезауруса, Ic = f(Sp)

Рассмотрим два предельных случая, когда количество семантической информации Ic равно 0:

при Sp 0 пользователь не понимает и, следовательно, не воспринимает поступающую информацию (так, сообщение, составленное на японском языке, не несет никакой новой информации человеку, не знающему этого языка);

при Sp пользователь все знает, и поступающее сообщение не содержит никакой новой информации.

Максимальное количество семантической информации Ic потребитель приобретает при согласовании ее смыслового содержания S со своим тезаурусом Sp (Sp = Sopt), когда поступающая информация понятна пользователю и несет ему ранее не известные (отсутствующие в его тезаурусе) сведения.

Следовательно, количество семантической информации в сообщении, количество новых знаний, получаемых пользователем, является величиной относительной. Информация есть характеристика не сообщения, а соотношения между сообщением и его потребителем. Без наличия потребителя, хотя бы потенциального, говорить об информации бессмысленно.

Прагматическая мера информации. Эта мера определяет полезность информации (ценность) для достижения пользователем поставленной цели. Эта мера также величина относительная, обусловленная особенностями использования этой информации в той или иной системе. Ценность информации целесообразно измерять в тех же самых единицах (или близких к ним), в которых измеряется целевая функция.

Например, в экономической системе прагматические свойства (ценность) информации можно определить приростом экономического эффекта функционирования, достигнутым благодаря использованию этой информации для управления системой:

In()=П(/) – П(),

где In() – ценность информационного сообщения для системы управления , П() – априорный ожидаемый экономический эффект функционирования системы управления ; П(/) – ожидаемый эффект функционирования системы при условии, что для управления будет использована информация, содержащаяся в сообщении .