- •1. Основные определения: информация, сообщение, система связи, сигнал, алфавит.

- •2. Функциональная система цифровой системы связи.

- •3. Преимущества и недостатки цифровой связи

- •4.Четырехуровневая коммуникационная система

- •5. Эталонная модель (osi): стек протоколов

- •6. Уровни модели взаимодействия открытых систем osi

- •Блочная диаграмма типичной системы цифровой связи от источника к передатчику

- •Блочная диаграмма типичной системы цифровой связи от приемника к потребителю информации

- •9. Отображение цифрового сигнала в виде аналоговой функции времени

- •10. Сигнал как реализация процесса. Классификация процессов

- •12. Полигармонические и почти периодические процессы

- •13. Определение случайного процесса

- •14. Процесс стационарный в широком смысле

- •15. Процесс стационарный в узком смысле

- •16. Случайные эргодические процессы, гауссов процесс

- •17. Процессы авторегрессии

- •18. Ковариационная и корреляционная матрицы случайного процесса, автоковариационная и автокорреляционная функции

- •19. Оценивание ковариационной и корреляционной матриц случайного процесса и автоковариационной и автокорреляционной функций

- •20. Случайные нестационарные процессы, характеристики случайных процессов

- •21. Классификация шумов в системах связи.

- •22. Определение спектральной плотности мощности. Теорема Винера-Хинчина.

- •23. Непрерывное преобразования Фурье

- •24. Финитное преобразование Фурье

- •25. Дискретное преобразование Фурье (дпф).

- •26. Свойства дпф.

- •27. Оценивание спектральной плотности с помощью дпф

- •28. Модель белого шума.

- •29. Линейные системы с постоянными параметрами.

- •Характеристики линейных систем с постоянными параметрами.

- •31. Последовательное включение систем с постоянными параметрами.

- •32. Связь спектральных плотностей входного и выходного процессов линейной системы с постоянными параметрами.

- •3 5. Узкополосные и широкополосные сигналы.

- •36. Критерии определения ширины полосы.

- •Форматирование текстовой информации в системах dcs.

- •38. Теорема о дискретном представлении. Критерий Найквиста. Инженерный критерий Найквиста.

- •Дискретизация с помощью идеальных единичных импульсов (идеальная дискретизация).

- •Естественная дискретизация.

- •41.Дискретизация по методу «выборка-хранение».

- •42.Квантование амплитуды и характеристики.

- •45.Шум квантования.

- •46.Импульсно кодовая модуляция квантованных выборок аналогового сигнала.

- •47.Кодирование источников определения.

- •48.Дискретные источники и их характеристики.

- •49.Типы дискретных источников.

- •50.Свойства кодов.

- •51. Показатели кодирования

- •52. Кодирование источников без памяти: код шеннона-фано

- •54. Кодирование источников с памятью: методы подавления нулей и групповое кодирование

- •55. Кодирование источников с памятью: методы подстановки образцов и дифференциальное сжатие

- •56. Униполярные и биполярные сигналы pcm

- •57. Сигналы рсм в кодировке nrz (nrz-l, nrz-m, nrz-s)

- •58. Кодировки nrz-ami и rz-ami

- •59. Фазовое кодирование

- •60. Кодирование модуляцией задержки

- •61. Многоуровневое кодирование рсм. Достоинства и недостатки

- •62. Искажение сигналов шумом awgn

- •63. Межсимвольная интерференция

- •64. Обобщенная схема передачи узкополосного сигнала

- •65. Основные этапы демодуляции/обнаружения

- •68. Униполярная передача двоичных сигналов

- •69. Биполярная передача двоичных сигналов

- •70. Эквивалентная модель системы dcs

- •71. Импульсы Найквиста

- •72. Компенсация искажений с помощью выравнивания

- •73. Виды выравнивания и типы эквалайзеров.

- •74. Дискретный канал без памяти

- •75. Теорема кодирования канала

- •76. Теорема о пропускной способности канала

- •Зачем нужна широкополосная модуляция?

- •78, 79. Амплитудная и частотная модуляция (ask и fsk)

- •80. Частотная манипуляция и бинарная частотная манипуляция

- •81. Бинарная фазовая манипуляция, квадратурная фазовая манипуляция

- •82. Амплитудно-фазовая манипуляция (арк)

- •83. Определение полосовой демодуляции и ее виды

- •84. Ресурс связи и способы его распределения

- •85. Сигналы, ортогональные во времени и по частоте

- •86. Уплотнение/множественный доступ с частотным разделением

- •87. Множественный доступ с временным разделением

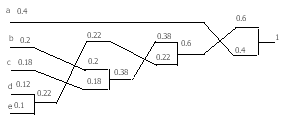

52. Кодирование источников без памяти: код шеннона-фано

Все кодируемые символы исх. алфавита перечисляются в порядке уменьшения их вероятностей. Все символы делятся на М примерно равновероятных групп. Верхней группе ставится в соответствие 0, нижней – 1. Затем обе группы снова разбиваются на М подгрупп, верхней группе ставится в соответствие 0, нижней – 1. Такое разбиение продолжается до тех пор, пока в таблице не исчезнут префиксно зависимые кодовые слова.

53. КОДИРОВАНИЕ ИСТОЧНИКОВ БЕЗ ПАМЯТИ: КОД ХАФФМАНА

Таблица кодирования строится как процесс формирования дерева (дерево кодирования Хаффмана). Исх. символы изображаются

Этим символам ставятся в соответствие листья сформир.дерева. К листу направляется ветвь, возле кот. записываются вероятности листа. 2 самые нижние ветви формируют вершину ветвления, к кот. направл. ветвь с суммарной вероятностью. Далее формируется след. уровень дерева, в кот. нижележащие вершины упорядочены по вероятности. После построения дерева ветви, исходящие из каждой вершины ветвления, снабжаются двоичным решением. Верхняя ветвь – 1, нижняя – 0(или наоборот). Такой алгоритм формирования дерева наз. методом пузырька, т.к. после каждого «объединения» двух вершин полученная вершина-родитель поднимается до уровня, соответсв. суммарной вероятности. Для построения кода осущ-ся переход (спуск по дереву) от корня к каждому листу. При переходе в код заносятся попавшиеся двоич.решения.

54. Кодирование источников с памятью: методы подавления нулей и групповое кодирование

Кодирование Хаффмана в чистом виде не применяется, т.к. у него есть недостатки. Во-первых, нужно знать вероятности, приписываемые отд. символам источника. Во-вторых, если алфавит очень велик, то велико и дерево кодирования, которое передается файлам кода в виде заголовка. В-третьих, в коде обычно часто встречаются повторяющиеся комбинации символов кода. Например, графич. файл может иметь коды миллиона пикселей, расположенных рядом. При этом части кодов таких пикселей совпадают.

В методе подавления нулей последовательность часто повторяющихся символов заменяется лексемой, кот. может состоять из 2 частей: самого повтор. символа и числа его повторений. Обычно в качестве такого символа выбирается 0. Если в двоич. коде сообщения появляется 37 нулей, то они заменяются лексемой <37>.

Групповое кодирование – это расширенное подавление нулей, при котором заменяются числом повторений группы смежных символов. Если лексема формируется из числа повторения нулей и единиц, то код 111111000000111 имеет вид 663.

55. Кодирование источников с памятью: методы подстановки образцов и дифференциальное сжатие

В методе подстановки

образцов часто повторяющиеся комбинации

кода заменяются метасимволами. Например,

нач.кодовые комбинации посылаются

пользователю и формируют так называемый

словарь образцов. При поступлении

очередной кодовой комбинации для нее

ищется в словаре образцов элемент. В

случае его нахождения вместо посылаемой

комбинации посылается метасимвол,

состоящий из 3 компонентов: адрес

(порядковый номер образца в словаре),

кол-во выбираемых из образца символов

(совпадающим с нач.кода), добавляется

новый символ. Он не только пересылается,

но и добавляется в словарь образцов.

Дифференциальное сжатие используется

при передаче аналоговых сигналов. До

передачи выборки анал.сигналы квантуются.

Само квантование уже является сжатием.

При обычной передаче квантуются выборки

Xs(n).

При диффер.сжатии квантованию подвергаются

разность текущего и предыдущего отсчетов

: d(n)=xs(n)-xs(n-1).

Таким обр. посылаются квантованные

значения dq(n).

Т.к. амплитуды остатков d(n)

значительно меньше амплитуд исх.сигнала

xs(n),

то для их передачи (dq(n))

требуется значительно меньшая полоса

частот: ![]() =

dq(n)+

=

dq(n)+

![]() . Такое

сжатие наз-ся дифференциально-импульсно-кодвой

модуляцией (ДИКМ или DPCM).

. Такое

сжатие наз-ся дифференциально-импульсно-кодвой

модуляцией (ДИКМ или DPCM).