- •1.Хранилище данных.

- •2. Система поддержки принятия решений (сппр). Ссылка Система поддержки принятия решений

- •3. Отличия cппp и оlтр-систем.

- •4. Семантический слой в хранилище данных.

- •5. Основные требования к хранилищу данных.

- •6. Свойства хранилища данных.

- •7. Структурная схема хранилища данных.

- •8. Хранилище данных - детализированные и агрегированные данные.

- •9. Хранилище данных - метаданные, бизнес-метаданные, технический уровень.

- •10. Хранилище данных - регламентированные, нерегламентированные запросы.

- •11. Оперативный анализ данных - olap систем.

- •12. Реляционные olap системы - структурная схема, функционал.

- •13. Многомерные olap системы -структурная схема, функционал.

- •14. Гибридные olap системы - структурная схема, функционал.

- •15. Виртуальные olap системы - структурная схема, функционал.

- •20. Структура многомерного куба, привести пример.

- •25. Недостатки многомерного olap-подхода.

- •26. Операции над измерениями - сечение, привести пример.

- •27. Операции над измерениями - транспонирование, привести пример.

- •38. Централизованное хд с витринами данных - структурная схема, функционал.

- •39. Аналитические платформы - структурная схема, функционал.

- •40. Data Mining - предназначение, полный цикл функционирования.

- •41. Data Мining - классификация, задачи, привести пример.

- •42. Data Мining - признаки классификации, основной, второстепенный.

- •43. Data Мining - признаки классификации, простой, сложный.

- •44. Data Мining - этапы классификации.

- •45. Классификация с помощью деревьев решений, пример.

- •46. Классификация при помощи искусственных нейронных сетей, пример.

- •47. Классификации - бинарная, многоклассовая, пример.

- •48. Характеристики для оценки методов классификации.

- •49. Классификация - ошибки I и II рода, предназначение, пример.

- •50. Классификация - балансировка уровня ошибок I и II рода, предназначение, пример.

- •51. Data Mining - кластеризация, задачи, привести пример.

- •52. Data Mining - кластеризация, типы кластеров.

- •53. Data Мining - сравнение задач классификации и кластеризации, пример.

- •54. Data Mining - линейная регрессия, модель, предназначение, пример.

- •55. Data Мining - логистическая регрессия, модель, предназначение, пример.

- •56. Data Мining - генетические алгоритмы, предназначение, пример.

- •57. Data Мining - машинное обучение, обучающая выборка.

- •58. Data Mining - машинное обучение, тестовая выборка.

- •59. Data Мining - машинное обучение, эффект переобучения.

- •60. Data Мining - машинное обучение, ошибки обучения и обобщения.

52. Data Mining - кластеризация, типы кластеров.

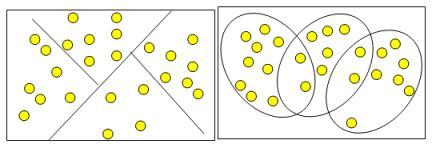

Кластеры могут быть непересекающимися, или эксклюзивными (non-overlapping, exclusive), и пересекающимися (overlapping) [22]. Схематическое изображение непересекающихся и пересекающихся кластеров дано на рис. 5.8.

Рис. 5.8. Непересекающиеся и пересекающиеся кластеры

Следует отметить, что в результате применения различных методов кластерного анализа могут быть получены кластеры различной формы. Например, возможны кластеры "цепочного" типа, когда кластеры представлены длинными "цепочками", кластеры удлиненной формы и т.д., а некоторые методы могут создавать кластеры произвольной формы.

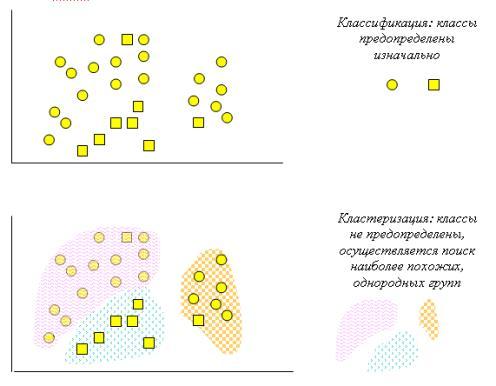

53. Data Мining - сравнение задач классификации и кластеризации, пример.

|

Характеристика |

Классификация |

Кластеризация |

|

Контролируемость обучения |

Контролируемое обучение |

Неконтролируемое обучение |

|

Стратегия |

Обучение с учителем |

Обучение без учителя |

|

Наличие метки класса |

Обучающее множество сопровождается меткой, указывающей класс, к которому относится наблюдение |

Метки класса обучающего множества неизвестны |

|

Основание для классификации |

Новые данные классифицируются на основании обучающего множества |

Дано множество данных с целью установления существования классов или кластеров данных |

Рис. Сравнение задач классификации и кластеризации

54. Data Mining - линейная регрессия, модель, предназначение, пример.

Линейная регрессия (англ. Linear regression) — используемая в статистике регрессионная модель зависимости одной (объясняемой, зависимой) переменной y от другой или нескольких других переменных (факторов, регрессоров, независимых переменных) x с линейной функцией зависимости.

Задача линейной регрессии заключается в нахождении коэффициентов уравнения линейной регрессии, которое имеет вид:

y=bo + b1x1 + b2x2 + …+ bnxn (1)

где y — выходная (зависимая) переменная модели;

x1, x2 …xn — входные (независимые) переменные;

bi — коэффициенты линейной регрессии, называемые также параметрами модели (b0 — свободный член).

Задача линейной регрессии заключается в подборе коэффициентов bi, уравнения (1) таким образом, чтобы на заданный входной вектор X = (x1, x2 …xn ) регрессионная модель формировала желаемое выходное значение y.

Одним из наиболее востребованных приложений линейной регрессии является прогнозирование. В этом случае входными переменными модели х-, являются наблюдения из прошлого (предикторы), а y — прогнозируемое значение. Несмотря на свою универсальность, линейная регрессионная модель не всегда пригодна для качественного предсказания зависимой переменной. Когда для решения задачи строят модель линейной регрессии, на значения зависимой переменной обычно не налагают никаких ограничений. Но на практике такие ограничения могут быть весьма существенными. Например, выходная переменная может быть категориальной или бинарной. В таких случаях приходится использовать различные специальные модификации регрессии, одной из которых является логистическая регрессия.

55. Data Мining - логистическая регрессия, модель, предназначение, пример.

Логистическая регрессия предназначена для предсказания зависимой переменной, принимающей значения в интервале от 0 до 1. Такая ситуация характерна для задач оценки вероятности некоторого события на основе значений независимых переменных. Кроме того, логистическая регрессия используется для решения задач бинарной классификации, в которых выходная переменная может принимать только два значения — 0 или 1, «Да» или «Нет» и т. д.

Таким образом, логистическая регрессия служит не для предсказания значений зависимой переменной, а скорее для оценки вероятности того, что зависимая переменная примет заданное значение.

Предположим, что выходная переменная у может принимать два возможных значения — 0 и 1. Основываясь на доступных данных, можно вычислить вероятности их появления: Р(у = 0) = 1 - р; Р(у = 1) =р. Иными словами, вероятность появления одного значения равна 1 минус вероятность появления другого, поскольку одно из них появится обязательно и их общая вероятность равна 1. Для определения этих вероятностей используется логистическая регрессия:

log(p/(l-p)) = β0 +( β1x1 + β2x2 +... + βnxn) (2)

Правая часть формулы (2) эквивалентна обычному уравнению линейной регрессии (1). Однако вместо непрерывной выходной переменной у в левой части отношения вероятностей двух взаимоисключающих событий (в нашем приоре — вероятность появления 0 и вероятность появления 1).

функция вида log(p/(l-p)) называется логит - преобразованием и обозначается logit(р). Использование логит - преобразования позволяет ограничить диапазон изменения выходной переменной в пределах [0; 1].