- •Компьютерные технологии в науке и образовании

- •Часть 2 Экспертные системы

- •Содержание

- •Лекция 1

- •2.1 Введение в экспертные системы.

- •2.1.1 Назначения и основные свойства экспертных систем

- •Состав и взаимодействие участников построения и эксплуатации экспертных систем

- •Преимущества использования экспертных систем

- •Особенности построения и организации экспертных систем

- •2.1.5 Основные режимы работы экспертных систем

- •2.1.6 Отличие экспертных систем от традиционных программ

- •2.1.7 Технология разработки экспертных систем

- •Лекция 2

- •2.2 Выявление знаний от экспертов.

- •2.2.1 Экспертное оценивание как процесс измерения.

- •Связь эмпирических и числовых систем.

- •Методы измерения степени влияния объектов.

- •2.2.3.1 Метод ранжирования.

- •Метод парных сравнений.

- •Метод непосредственной оценки.

- •Один из подходов к формированию и оценке компетентности группы экспертов.

- •Характеристика и режимы работы группы экспертов.

- •Лекция 3

- •2.3 Обработка экспертных оценок.

- •2.3.1 Задачи обработки.

- •2.3.2 Групповая экспертная оценка объектов при непосредственном оценивании.

- •Обработка парных сравнений.

- •Определение обобщенных ранжировок.

- •Замечания к определению групповых оценок.

- •Лекция 4

- •2.4 Экспертные системы с неопределенными знаниями.

- •2.4.1 Неопределенности в эс и проблемы порождаемые ими.

- •Теория субъективных вероятностей.

- •Байесовское оценивание.

- •Теорема Байеса как основа управления неопределенностью.

- •Лекция 5

- •2.5 Логический вывод на основе субъективной вероятности.

- •2.5.1 Простейший логический вывод

- •Распространение вероятностей в эс

- •Последовательное распространение вероятностей

- •Экспертные системы, использующие субъективные вероятности

- •Лекция 6

- •2.6 Байесовские сети доверия как средство разработки эс.

- •2.6.1 Основные понятия и определения

- •2.6.2 Пример построения простейшей байесовской сети доверия

- •Процесс рассуждения (вывода) в байесовских сетях доверия

- •Байесовские сети доверия как одно из направлений современных экспертных систем

- •Представление знаний с использованием байесовской сети доверия и условная независимость событий

- •Лекция 7

- •2.7 Диаграммы влияния.

- •2.7.1 Назначение и основные компоненты диаграмм влияния

- •2.7.2 Пример построения простейшей диаграммы влияния

- •Диаграммы влияния с несколькими вершинами решения

- •Лекция 8

- •2.8 Сети доверия с условными гауссовскими переменнами.

- •2.8.1 Непрерывные случайные величины

- •Непрерывные гауссовские переменные

- •Числовые характеристики случайных величин

- •Совместное использование дискретных и непрерывных переменных в байесовских сетях доверия

- •Логический вывод в байесовских сетях доверия с непрерывными и дискретными состояниями

- •Лекция 9

- •2.9 Экспертные системы на основе теории Демстера–Шеффера (тдш).

- •2.9.1 Предпосылки возникновения новой теории.

- •2.9.2 Основы теории Демстера–Шеффера

- •2.9.3 Меры доверия и правдоподобия в тдш

- •2.9.4 Отличие тдш от теории вероятностей

- •2.9.5 Связь между тдш и классической теорией вероятностей

- •2.9.6 Комбинация функций доверия

Распространение вероятностей в эс

Вероятности событий распространяются по БЗ экспертной системы на основе правила Байеса для вычисления всех апостериорных вероятностей гипотез при условии наблюдаемых свидетельств. Эти апостериорные вероятности дают ранжированную информацию о потенциально истинной гипотезе. Рассмотрим пример, иллюстрирующий этот процесс.

Пример.Предположим, что в некоторой БЗ имеется всего три взаимно независимых гипотезы:H1,H2,H3, которые имеют априорные вероятности:p(H1),p(H2),p(H3), соответственно. Правила БЗ содержат два условно независимых свидетельства, которые поддерживают исходные гипотезы в различной степени. Априорные и условные вероятности всех гипотез и свидетельств этого примера имеют следующие значения:

|

|

1 |

2 |

3 |

|

p(Hi) |

0,5 |

0,3 |

0,2 |

|

p(E1|Hi) |

0,4 |

0,8 |

0,3 |

|

p(E2|Hi) |

0,7 |

0,9 |

0,0 |

H1 - “средняя надежность фирмы”,

H2 - “высокая надежность фирмы”,

H3 - “низкая надежность фирмы”.

Событиями, являющимися условно независимыми свидетельствами, поддерживающими исходные гипотезы являются: Е1 – “наличие прибыли у фирмы” иЕ2– “своевременный расчет с бюджетом”.

В процессе сбора фактов вероятности гипотез будут повышаться, если факты поддерживают их или уменьшаться, если опровергают их. Предположим, что мы имеем только одно свидетельство E1( то есть с вероятностью единица наступил фактE1). НаблюдаяE1мы вычисляем апостериорные вероятности для гипотез согласно формуле Байеса для одного свидетельства:

.

.

Таким образом

![]() ,

,

![]() ,

,

![]()

После того как E1произошло доверие к гипотезамH1иH3понизилось, в то время как доверие кH2возросло. В тех случаях, когда имеются факты, подтверждающие как событиеE1, так и событиеE2, то апостериорные вероятности исходных гипотез также могут быть вычислены по правилу Байеса:

.

.

Так как события E1иE2условно независимые при данных гипотезахHi, то формулу Байеса можно переписать в виде:

.

.

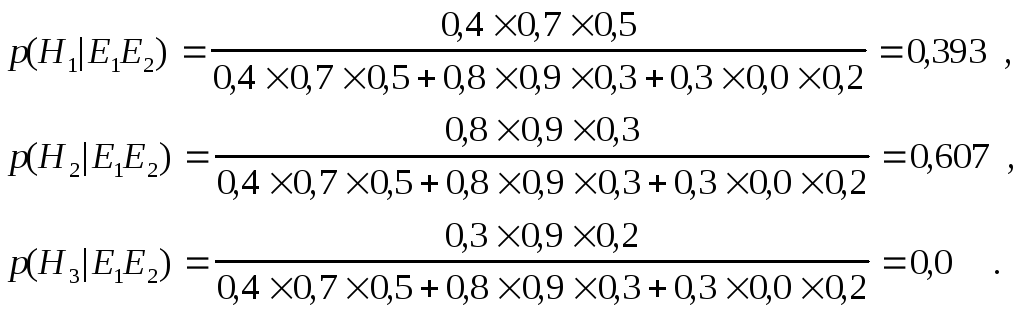

Откуда

Хотя исходным ранжированием было H1,H2, иH3, толькоH1иH2остались после получения свидетельствE1иE2. При этомH1, более вероятно, чемH2.На этом примере мы рассмотрели процесс распространения вероятностей по элементам ЭС при поступлении в неё тех или иных свидетельств.

Последовательное распространение вероятностей

Однако реально, распространение вероятностей происходит поэтапно с суммированием отдельных свидетельств и их влияния на условную вероятность по мере поступления отдельных Ei. Это можно сделать, используя априорные и апостериорные вероятности, следующим образом:

Задаём p(Hi)– априорную вероятность событийHi.

Для полученных свидетельств Ejзаписываем p(Ej| Hi ).

С учётом теоремы Байеса подсчитываем p(Hi |Ej )в зависимости от исходаEj, то есть вычисляем апостериорную вероятность событияHi.

Теперь можно не обращать внимания на все наступившие Ejи переобозначить текущую апостериорную вероятность событияHi, как новую априорную вероятностьHi. Итак, пустьp(Hi)равнаp(Hi|Ej)в зависимости от значенияEj.

Затем выберем новое свидетельство для рассмотрения и перейдём к п.2.

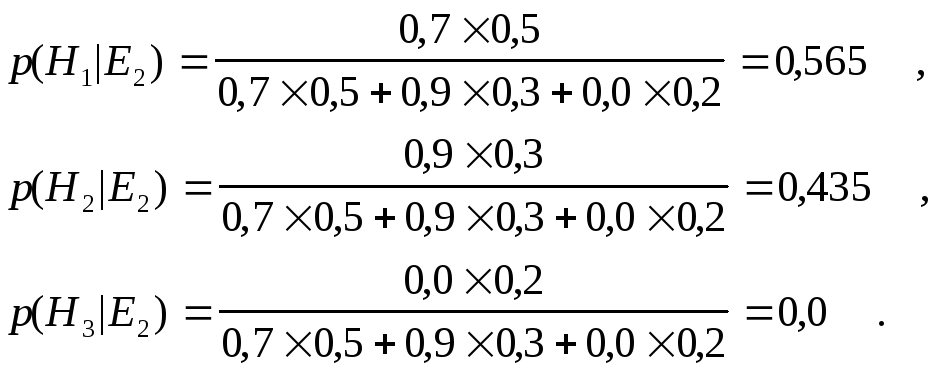

Проиллюстрируем эту последовательность на приведенном выше примере в предположении, что сначала поступило свидетельство E2. Тогда:

Полученные вероятности можно принять за новые апостериорные вероятности гипотез H1,H2, иH3, то есть:

![]()

И если теперь дополнительно поступит свидетельство E2, то новые апостериорные вероятности гипотез могут быть вычислены только на основе вновь поступившего свидетельства:

Из приведенного примера видно, что итерационная процедура последовательного распределения вероятностей по мере поступления свидетельств позволяет получить результаты аналогичные непосредственному применению правила Байеса для случая одновременного двух поступивших свидетельств.

p(

) i

p(

) i