- •1.Понятие случайного события.

- •2.Статистическое определение вер-ти.

- •3.Несовместные и совместные события. Сумма событий. Теорема сложения вероятностей (с доказательством). Пример.

- •4. Полная группа событий. Противоположные события. Соотношение между вероятностями противоположных событий (с выводом). Примеры.

- •5. Зависимые и независимые события. Произведение событий. Понятие условной вероятности. Теорема умножения вероятностей (с доказательством). Примеры.

- •6. Формулы полной вероятности и Байеса (с доказательством). Примеры.

- •7. Повторные независимые испытания. Формула Бернулли (с выводом). Примеры.

- •8. Локальная теорема Муавра—Лапласа, условия ее применимости. Свойства функции f(X). Пример.

- •9. Асимптотическая формула Пуассона и условия ее применимости.

- •10. Интегральная теорема Муавра—Лапласа и условия ее применимости. Функция Лапласа ф(х) и ее свойства. Пример.

- •11. Следствия из интегральной теоремы Муавра—Лапласа (с выводом). Примеры.

- •12. Понятие случайной величины и ее описание. Дискретная случайная величина и ее закон (ряд) распределения. Независимые случайные величины. Примеры.

- •14. Математическое ожидание дискретной случайной величины и его свойства (с выводом). Примеры.

- •15. Дисперсия дискретной случайной величины и ее свойства (с выводом). Примеры.

- •16. Математическое ожидание и дисперсия числа и частости наступлений события в п повторных независимых испытаниях (с выводом).

- •17. Случайная величина, распределенная по биномиальному закону, ее математическое ожидание и дисперсия. Закон распределения Пуассона.

- •18. Функция распределения случайной величины, ее определение, свойства и график.

- •19. Непрерывная случайная величина (нсв). Вероятность отдельно взятого значения нсв. Математическое ожидание и дисперсия нсв.

- •20. Плотность вероятности непрерывной случайной величины, ее определение, свойства и график.

- •25. Понятие двумерной (n-мерной) случайной величины. Примеры. Таблица ее распределения. Одномерные распределения ее составляющих. Условные распределения и их нахождение по таблице распределения

- •26. Ковариация и коэффициент корреляции случайных величин. Связь между некоррелированностью и независимостью случайных величин.

- •28. Неравенство Маркова (лемма Чебышева) (с выводом). Пример.

- •29. Неравенство Чебышева (с выводом) и его частные случаи для случайной величины, распределенной по биномиальному закону, и для частости события.

- •30. Неравенство Чебышева для средней арифметической случайных величин (с выводом).

- •31. Теорема Чебышева (с доказательством), ее значение и следствие. Пример.

- •32. Закон больших чисел. Теорема Бернулли (с доказательством) и ее значение. Пример.

- •33. Вариационный ряд, его разновидности. Средняя арифметическая и дисперсия ряда. Упрощенный способ их расчета.

- •35. Понятие об оценке параметров генеральной совокупности. Свойства оценок: несмещенность, состоятельность, эффективность.

- •36. Оценка генеральной доли по собственно-случайной выборке. Несмещенность и состоятельность выборочной доли.

- •37. Оценка генеральной средней по собственно-случайной выборке. Несмещенность и состоятельность выборочной средней.

- •38. Оценка генеральной дисперсии по собственно-случайной выборке. Смещенность и состоятельность выборочной дисперсии (без вывода). Исправленная выборочная дисперсия.

- •39. Понятие об интервальном оценивании. Доверительная вероятность и доверительный интервал. Предельная ошибка выборки. Ошибки репрезентативности выборки (случайные и систематические).

- •41. Формула доверительной вероятности при оценке генеральной средней. Средняя квадратическая ошибка повторной и бесповторной выборок и построение доверительного интервала для генеральной средней.

- •42. Определение необходимого объема повторной и бесповторной выборок при оценке генеральной средней и доли.

- •43. Статистическая гипотеза и статистический критерий. Ошибки 1-го и 2-го рода. Уровень значимости и мощность критерия. Принцип практической уверенности.

- •44. Построение теоретического закона распределения по опытным данным. Понятие о критериях согласия.

- •45. Критерий согласия- Пирсона и схема его применения.

- •46. Функциональная, статистическая и корреляционная зависимости. Различия между ними. Основные задачи теории корреляции.

20. Плотность вероятности непрерывной случайной величины, ее определение, свойства и график.

Опр.Плотность вер-ти н.с.в.Х наз-ся производная её фун-и распределения.

1.плотность не отрицательна

φ(x)≥0

2. Фун-я распред.н.с.в.Х выражается через плотность вре-ти по фор-ле

F(X)=∫x-∞φ(t)dt

3. ∫+∞-∞φ(t)dt=1

4. вер-ть попадания в заданный интервал

P(x1≤X≤x2)=∫x2x2φ(t)dt

25. Понятие двумерной (n-мерной) случайной величины. Примеры. Таблица ее распределения. Одномерные распределения ее составляющих. Условные распределения и их нахождение по таблице распределения

Опр. Вектор Z=(x,y) компоненты Х и У которые яв-ся случ-ми величинами назыв-ся случайным вектором, или двумерной случайной величиной. Например: X-рост чел-ка; У-вес чел-ка это двумерные непрерывные величины.

Для дискретных с.в.рассматривают табл.распределения:

|

x\Y |

Y1 |

… |

yn |

|

X1 |

P11 |

|

P1m |

|

: |

|

|

|

|

xn |

Pn1 |

|

pnm |

pij=P(x=xi,y=yj)

![]()

Одномерное распр.компон.:

![]()

pi=P(X=xi)=

![]()

![]()

p’j=P(Y=yj)=

=![]()

Из одномерного распред.Х и Y двумерное распределение нельзя!Для исследования зависимости X, Y применяют условные распределения.

Опр. Пусть Х приняло значение xi. Услов.распред.Y.При усл.что Х прин.знаение xi, наз-ся условным вер-стей:

![]()

Аналогично Py=yj(X=xi)=Pij/Pj

По

услов.распред опр.м.о.:

![]()

![]()

Т.о.услов.м.о. каждому значению одной компоненты ставит в соответствие услов. м.о. другой компоненты,т.е. задаёт числовую функцию на множестве значений 1ой компоненты. Эта фун-я, наз-ся фун-й регрессии.

26. Ковариация и коэффициент корреляции случайных величин. Связь между некоррелированностью и независимостью случайных величин.

Для кол-енного описания связи между двум.с.в.,вводят ковариацию и коэф.корреляции.

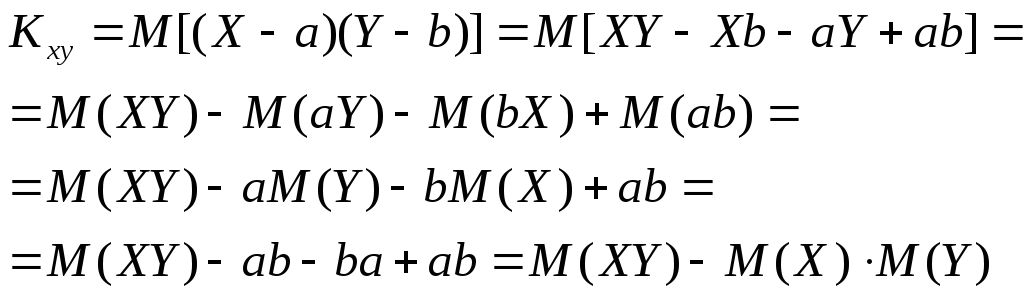

Опр. Ковариация Kxy с.в.X и Y;наз-ся м.о.произведения отклонения этих с.в.от своих м.о.

![]()

Т.ф-ля д/выч.ковариации

Ковариация XY равна м.о.их произведения минус произ.их м.о.

Kxy=M(XY)- M(X)M(Y)

Док. Пусть M((X)=a M(Y)=b тогда

Следствие.сли X Y назависимы, то их ковариация равна нулю

К недостаткам ковариации относят то,что это размерная величина и поэтому харак-ет не только степень связи между компонентами, но и разброс значений компонентов. Поэтому вводят коэф.кор.

Опр.Коэф.кор.двух.с.в.(X,Y) наз-ся отношение их ковариации к произведению средних квадратических отклонений этих с.в.

![]()

![]()

Св-ва:1. [-1,1] -1≤ρxy≤1

2. Если X Y независ. То ρxy=0

3.

Если

![]() , то между вел.X

Y

сущ.функциональная зависимость

, то между вел.X

Y

сущ.функциональная зависимость

При

ρ=1

![]()

При

ρ=1

![]()

Для того что бы найти коэф.кор.по табл.распр.двум.с.в.надо:

1.

![]()

2. найти одномер.распр.X Y

3. по одномер распр найти: M(X),M(Y),D(X),D(Y)

4.Найти коэф.кор.по ф-ле:

![]()

Заменяя в последнем выражении входящие величины на их выборочные оценки, получаем формулу для вычисления выборочного коэфф-нта корреляции r:

![]()

![]()

![]() -выбо-

-выбо-

рочная

ковариация, т.к.

![]() ,

,![]() ;

;![]() ;

;

![]() ,

«+»,если

,

«+»,если

![]() ;

«-» если

;

«-» если

![]() .Если

r>0,то

связь между переменной называется

прямой.Если r<0-

связь называется обратной. Связь между

переменными признается тесной, если

|r|0,7;

умеренной если 0,4|r|0,7;

слабой если |r|<0,4.

Основное св-во коэфф-та корреляции:

|r|1.;

Предельное

значение коэфф-та корреляции:

1) |r|=1,т.и

т.т.к. byx*bxy=1

=> прямые регрессии совпадают. 2) r=0

т.и т.т.к. µ=0

byx=0

и bxy=0

=> прямые регрессии перпендикулярны.;

Если r=0

то говорят, что между переменными х и у

отсутствует линейная корреляционная

зависимость.

.Если

r>0,то

связь между переменной называется

прямой.Если r<0-

связь называется обратной. Связь между

переменными признается тесной, если

|r|0,7;

умеренной если 0,4|r|0,7;

слабой если |r|<0,4.

Основное св-во коэфф-та корреляции:

|r|1.;

Предельное

значение коэфф-та корреляции:

1) |r|=1,т.и

т.т.к. byx*bxy=1

=> прямые регрессии совпадают. 2) r=0

т.и т.т.к. µ=0

byx=0

и bxy=0

=> прямые регрессии перпендикулярны.;

Если r=0

то говорят, что между переменными х и у

отсутствует линейная корреляционная

зависимость.