- •Линейные пространства векторов. Скалярное произведение. Понятие базиса и линейной независимости элементов линейного пространства. Преобразования базиса.

- •Определение матрицы. Операции с матрицами (умножение на скаляр, сложение, умножение матриц, транспонирование матриц). Обратная матрица и методы ее получения. Функции от матриц.

- •Производные. Необходимое и достаточное условие дифференцируемости функции. Частные производные. Полный дифференциал. Производная и дифференциал сложной функции.

- •Градиент функции. Производные по направлению. Необходимые и достаточные условия экстремума функции многих переменных. Условные экстремумы. Метод множителей Лагранжа.

- •Задачи аппроксимации функций (интерполяция, экстраполяция, приближение в среднем). Способы построения интерполяционного полинома. Аппроксимации на основе ортогональных базисов. Понятие сплайна.

- •Численные методы оптимизации: методы Ньютона и секущей, методы покоординатного и градиентного спуска. Улучшение сходимости градиентных методов.

- •Численные методы оптимизации, основанные на случайных числах. Метод Монте-Карло, линейный случайный поиск, метод оптимизации отжигом.

- •Прямые и итерационные методы решения систем линейных алгебраических уравнений. Методы для систем с матрицами специального вида (ленточные, треугольные, положительно-определенные).

- •Линейные пространства функций (примеры). Скалярное произведение и норма. Операторы над линейными пространствами функций. Функционалы. Собственные числа и функции оператора в пространстве l2.

- •Определение вероятности. Вероятностная модель и вероятностное пространство. Вероятность случайного события и методы ее статистического оценивания по выборке.

- •Модель случайной величины. Закон, функция, плотность распределения. Квантили и моменты распределений, методы их статистического оценивания по выборке.

- •Вероятностные и толерантные интервалы: сходства и различия. Понятия точечного и интервального оценивания. Доверительные интервалы. Несмещенные и эффективные оценки.

- •Параметрическое оценивание распределений случайной величины. Метод моментов. Метод наибольшего правдоподобия и его численная реализация. Способы проверки качества параметрического оценивания.

- •Статистические гипотезы и статистические критерии. Односторонние и двусторонние критерии. Критерии согласия. Параметрические критерии. Ошибки первого и второго рода. Мощность критерия.

- •Модель многомерной случайной величины. Совместные и условные распределения. Условные моменты распределений и их оценивание по выборке. Многомерное распределение Гаусса и его свойства.

- •Случайные процессы и временные ряды. Понятие стационарности. Ковариационная (корреляционная функция). Теорема Карунена-Лоэва. Спектральная плотность случайных процессов.

- •Алгоритмы на графах. Алгоритмы обхода (поиска на) графах. Обнаружение кратчайшего пути и минимального цикла в графе. Построение остовного дерева.

- •Основные понятия машинного обучения. Отличие машинного обучения от статистики. Методы на обучении с учителем. Методы на обучении без учителя. Метрики качества алгоритмов машинного обучения.

- •Цикл обучения. Понятия обучающей и тестовой выборки. Отложенная выборка. Кросс-валидация. Понятия недообучения и переобучения. Дилемма смещения и разброса. Размерность Вапника-Червоненкиса.

- •Понятия классификации и кластеризации. Метрические, иерархические, вероятностные методы классификации и кластеризации. Dbscan и kNn. Оценка качества классификации и кластеризации.

- •Понятие искусственной нейронной сети. Типы нейронных сетей. Понятие стохастического градиента для обучения нейронной сети. Многослойный перцептрон. Сверточные нейронные сети.

- •Методы снижения размерности данных. Метод главных компонент. Метод канонических корреляций. Методы факторного анализа. Нелинейные методы снижения размерности.

- •Принцип повышения размерности пространства. Метод опорных векторов. Понятие и свойства ядра. Метод Kernel-Trick.

- •Построение списка решений и дерева решений. Редукция деревьев решений. Понятие бэггинга и бустинга для деревьев решений. Случайный лес и способы его построения.

- •Обучение с подкреплением. Модели агентов и отклика среды. Задачи, решаемые обучением с подкреплением.

- •Ассоциативный анализ и задача о "покупательской корзине". Алгоритмы аprior и fp-Growth.

- •Способы представления знаний. Модели графов знаний. Полнота графов знаний. Методы прямого и обратного вывода по графам знаний. Онтологическая модель и средства ее реализации.

- •Экспертные методы в принятии решений. Принятие решений при многих критериях. Множество Парето. Экспертные системы поддержки принятия решений.

- •Методы машинного обучения для анализа текстовой информации. Понятие эмбеддинга. Методы построения и использования эмбеддингов при работе с текстом.

- •Генеративные методы машинного обучения. Генеративно-состязательные сети. Вариационные автокодировщики. Байесовские сети. Принципы работы, оценка качества.

Задачи аппроксимации функций (интерполяция, экстраполяция, приближение в среднем). Способы построения интерполяционного полинома. Аппроксимации на основе ортогональных базисов. Понятие сплайна.

Задачи аппроксимации функций. Интерполяция – это способ нахождения промежуточных значений величины по имеющемуся дискретному набору известных значений.

Экстраполяция – процесс оценки значения за пределами диапазона известных значений.

Экстраполяция опирается на предположения о поведении данных за пределами известного диапазона. Другими словами, интерполяция используется для оценки значений между известными точками данных, а экстраполяция - для оценки значений за пределами известных точек данных.

Приближение в среднем – вероятно, является обобщением для целого класса аппроксимирующих функций, когда предположение о новом неизвестном значении наблюдения, лежащего в указанном диапазоне, определяется как значение аппроксимирующей функции, проходящей между узлов интерполяции.

Отличие интерполяционного многочлена от аппроксимирующей функции в том, что интерполяционная функция имеет те же значения в узлах интерполяции, что и фактически наблюдаемые в ходе реального эксперимента (рис. а), в то время как аппроксимирующая функция является лишь приближенной функциональной зависимостью, иногда говорят, эмпирической формулой (рис. б) Аппроксимирующие функции проще формулируются и выглядят сглажено, т.к. имеют меньшее число коэффициентов.

Способы построения интерполяционного полинома. Интерполирующую функцию ищут в виде полинома степени . Для каждого набора экспериментальных точек имеется только один интерполяционный многочлен, степени не больше . Рассмотрим канонический полином и интерполяционные многочлены Ньютона и Лагранжа.

Запишем вид канонического полинома степени в общем виде:

![]()

Выбор многочлена степени

основан на том факте, что через

точку проходит единственная кривая

степени

.

Составим систему линейных алгебраических

уравнений, в котором каждой точке

точку проходит единственная кривая

степени

.

Составим систему линейных алгебраических

уравнений, в котором каждой точке

соответствует

соответствует

:

:

Решая эту систему линейных алгебраических

уравнений, найдем коэффициенты

интерполяционного полинома

,

,

,

…

,

…

.

.

Интерполяция полиномом Лагранжа имеет

вид, где

– множитель Лагранжа:

– множитель Лагранжа:

Интерполяционный многочлен Ньютона имеет несколько форм, но для примера мы воспользуемся только одним из них.

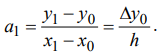

Первый интерполирующий полином Ньютона записывается в виде:

![]()

Исходя из того, что в узлах интерполяции, наблюдаемое табличное значение и результат вычисления полинома совпадают, получим формулу для нахождения первого коэффициента :

![]()

Обобщенная формула для нахождения всех коэффициентов имеет вид:

Тогда исходная формула принимает следующий вид:

Аппроксимации на основе ортогональных базисов. Ортогональная интерполяция – это тип метода интерполяции, который использует ортогональные полиномы1 для оценки неизвестных значений между известными точками данных.

Ортогональная интерполяция имеет ряд преимуществ перед другими методами интерполяции. Она эффективна с вычислительной точки зрения, может обрабатывать большие наборы данных и дает точные результаты даже при наличии шума или неравномерного распределения данных. Кроме того, ее можно расширить до более высоких измерений для интерполяции многомерных данных.

Примерами ортогональных базисных функций являются полиномы Лежандра, Чебышева и ряды Фурье.

Полиномы Лежандра – это

набор полиномов, ортогональных интервале

[-1;1], относительно своей весовой функции

.

Таким образом внутреннее произведение2

любых двух различных полиномов Лежандра

равно нулю. Первые несколько полиномов

Лежандра следующие:

.

Таким образом внутреннее произведение2

любых двух различных полиномов Лежандра

равно нулю. Первые несколько полиномов

Лежандра следующие:

Чтобы использовать полиномы Лежандра, необходимо определить степень аппроксимации полинома, от этого будет зависеть сложность функции и то, насколько точно будут аппроксимированы данные.

Определив степень полиномиального приближения, следует вычислить коэффициенты разложения полинома Лежандра с помощью метода наименьших квадратов. Это даст набор коэффициентов, которые можно использовать для построения аппроксимации полиномом Лежандра.

Понятие сплайна. В аппроксимации сплайн – это кусочно-определенная функция, которая строится путем подгонки полиномиальных сегментов гладким и непрерывным образом. Сплайны часто используются для аппроксимации сложных кривых или поверхностей и могут обеспечить более гибкое и точное представление, чем более простые методы интерполяции, такие как линейная или полиномиальная интерполяция.

1Ортогональные полиномы или ортогональные базисные функции, определены на интервале с некоторой ненулевой весовой функцией так, что их внутренне произведение равно нулю. Аналогично ортогональным векторам, образующим базис пространства.

2Внутреннее произведение

двух функций

и

на интервале [a, b] определяется как:

на интервале [a, b] определяется как:

.

Весовую функцию

.

Весовую функцию

используют, чтобы придать большее и

меньшее значение определенным частям

интервала. Внутреннее произведение

показывает степень сходства между двумя

функциями, основываясь на площади по

кривой двух функций на заданном интервале.

Аналогично скалярному произведению

векторов.

используют, чтобы придать большее и

меньшее значение определенным частям

интервала. Внутреннее произведение

показывает степень сходства между двумя

функциями, основываясь на площади по

кривой двух функций на заданном интервале.

Аналогично скалярному произведению

векторов.