- •6.3. Синхронна мережа Гопфілда

- •6.4. Неперервна мережа Гопфілда

- •6.5. Асоціативна мережа вsв

- •7. Синергетичний комп’ютер

- •8. Мережа хеммінга

- •9. Динамічні рекурсивні шнм

- •9.1. Структура дрм

- •9.2. Неперервні дрм

- •9.3. Дискретна дрм

- •9.3.2. Частково-рекурсивні мережі

- •9.3.3. Локально-рекурсивні мережі прямого поширення

- •9.4. Навчання дрм

- •9.4.1. Алгоритм зворотного поширення помилки

- •9.4.2. Адаптивний алгоритм навчання

- •10. Мережа векторного квантування

- •10.1. Структура мережі векторного квантування

- •10.2. Неконтрольоване навчання мережі вк

- •10.3. Контрольоване навчання мережі вк

- •10.3.1. Lvq1

- •10.3.2. Lvq2.1

8. Мережа хеммінга

Істотного скорочення витрат на пам’ять й обсяг необхідних обчислень можна досягти, якщо замість збереженого в пам’яті образу мережа видає тільки його номер. Таке спрощення мережі досягнуто в описаній Р. Ліппманом мережі Хеммінга [82].

Ця мережа заснована на обчисленні відстані Хеммінга між двійковими сигналами однакової довжини. Відстанню Хеммінга між двома векторами, поданими у двійковій формі, називається число позицій (бітів), у яких вони відрізняються. Мережа Хеммінга реалізує паралельне обчислення відстаней Хеммінга між пропонованим вхідним вектором і збереженими в пам’яті образами.

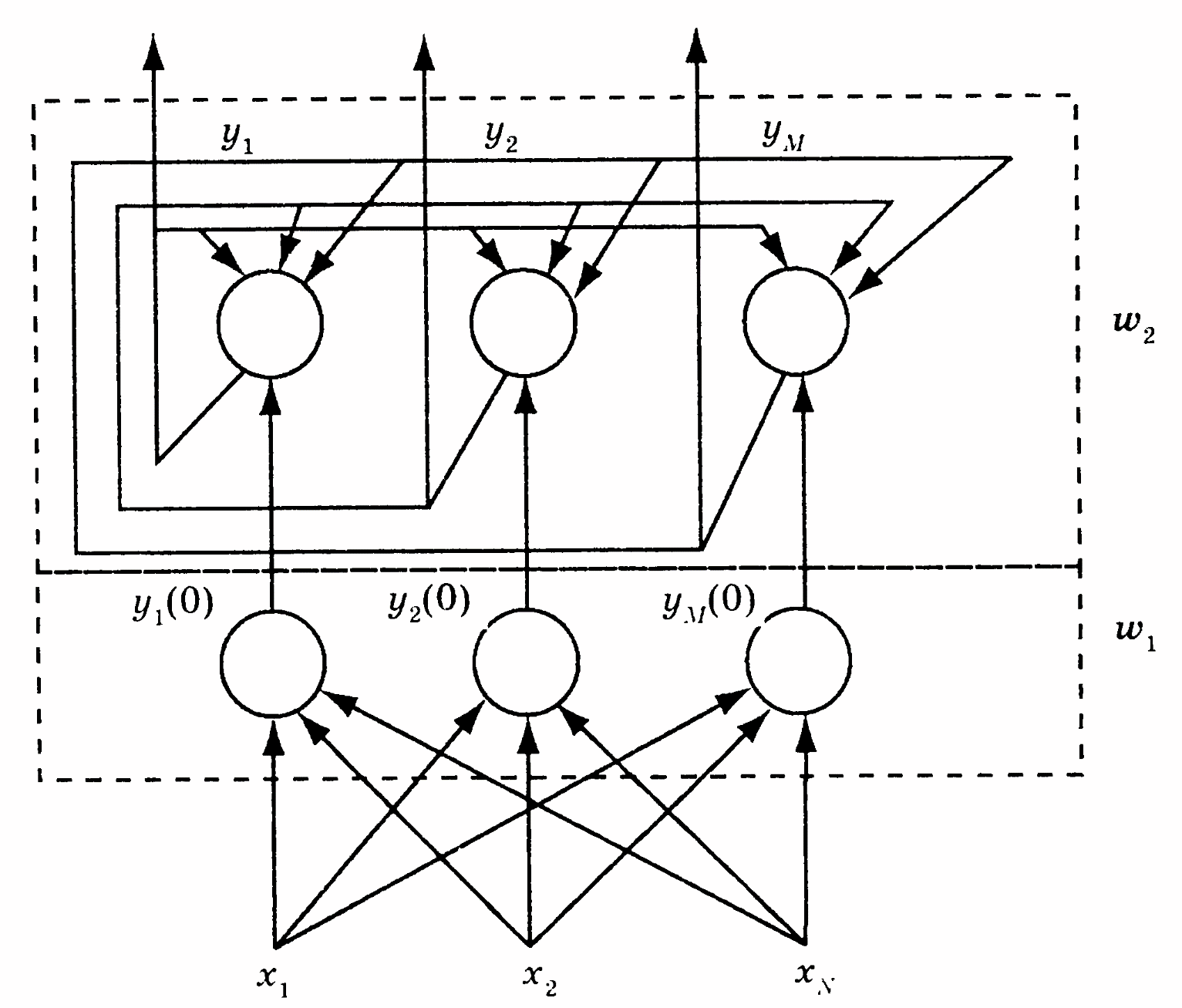

Мережа Хеммінга складається із двох шарів (рис. 8.1).

Рис. 8.1. Мережа Хеммінга

На відміну від мережі Гопфілда, ємність мережі Хеммінга визначається не розмірністю вхідного сигналу N, а кількістю нейронів у вихідному шарі М.

На

вхід мережі надходять двійкові біполярні

сигнали, тобто сигнали, що приймають

значення «+1» або «-1». Звичайні двійкові

сигнали, що приймають значення «+1» й

«0», перетворяться таким чином, щоб

значення «0» перетворилося в «-1». З цією

метою компонента нового вектора

перераховуються

за формулою

перераховуються

за формулою

.

.

Задача

мережі полягає в тому, щоб при поданні

їй деякого невідомого двійкового

вхідного образу х

вона

видавала асоційований з ним збережений

у мережі образ .

Отже, вона працює за принципом

асоціативної

нам'яті.

При

цьому на виході мережі з’являється

не сам асоціативний образ, а його номер

к

у

вигляді сигналу, що виникає на виході

k-го

нейрона

вихідного шару і має максимальне

значення, у той час як на виходах інших

нейронів сигнали будуть слабкими.

.

Отже, вона працює за принципом

асоціативної

нам'яті.

При

цьому на виході мережі з’являється

не сам асоціативний образ, а його номер

к

у

вигляді сигналу, що виникає на виході

k-го

нейрона

вихідного шару і має максимальне

значення, у той час як на виходах інших

нейронів сигнали будуть слабкими.

Мережа

Хеммінга складається із двох шарів,

перший з яких є мережею прямого поширення

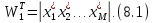

й характеризується ваговою матрицею

Вихідний сигнал цього шару реалізується відповідно до формули

де М — кількість збережених у пам’яті образів.

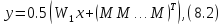

Отже, кожен компонент вихідного сигналу обчислюється за формулою

Як

уже було зазначено, компоненти векторів

йх

можуть

приймати значення «+1»

й «-1», причому знаки компонентів можуть

збігатися або не збігатися.

Якщо

кількість компонентів (біт), які не

збіглися, дорівнює H

то

H

є

хеммінговою

відстанню

цих

векторів. Отже, при H

неспівпадаючих

компонентах кількість співпадаючих

компонент дорівнює М - N,

а

скалярний добуток

йх

можуть

приймати значення «+1»

й «-1», причому знаки компонентів можуть

збігатися або не збігатися.

Якщо

кількість компонентів (біт), які не

збіглися, дорівнює H

то

H

є

хеммінговою

відстанню

цих

векторів. Отже, при H

неспівпадаючих

компонентах кількість співпадаючих

компонент дорівнює М - N,

а

скалярний добуток

дорівнюватиме

дорівнюватиме

Підстановка (8.4) в (8.3) дає

тобто

вихідний сигнал першого шару характеризує

кількість співпадаючих розрядів у

векторів (хеммінгова відстань)

йх.

Якщо Н

=

0, то

йх.

Якщо Н

=

0, то

=

М, тобто вектори

=

М, тобто вектори

йх

повністю збігаються. При Н

= М

вектори

йх

повністю збігаються. При Н

= М

вектори

й

х

повністю не збігаються.

й

х

повністю не збігаються.

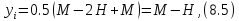

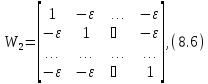

Вихідний

сигнал першого шару надходить на входи

М

нейронів другого шару, рекурсивного,

вагова матриця

якого

має вигляд

якого

має вигляд

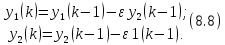

Нейрони цього шару, що називаються мережею МАХNЕТ, мають зворотні зв’язки, що й забезпечує рекурсивність шару. Тому вихідний сигнал всієї мережі описується співвідношенням

Отже, вихідний сигнал першого шару показує кількість бітів збігу пропонованого образу й збереженого, а вихідний сигнал всієї мережі, що з’являється після декількох ітерацій на виході одного нейрона другого шару, визначає номер збереженого образу, що найменше відрізняється від поданого.

Приклад

8.1.

Нехай мережа призначена для зберігання

двох образів (М = 2), тобто у

=

.

Компоненти

.

Компоненти

й

й обчислюються відповідно до (8.7)

обчислюються відповідно до (8.7)

Початкові

умови визначаються з початкових умов

вектора виходу першого шару

=

= ,скільки

він містить кількість бітів подібності

поданих образів.

,скільки

він містить кількість бітів подібності

поданих образів.

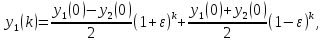

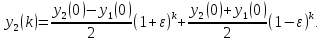

Розв’язок (8.8) має вигляд

Оскільки

>

0, другі доданки обох рівнянь із зростаннямk

збігаються до нуля. Якщо

>

0, другі доданки обох рівнянь із зростаннямk

збігаються до нуля. Якщо

,

тобто

,

тобто більше

подібний на поданий образ, то

більше

подібний на поданий образ, то ,

а

,

а

,.

Якщо

ж

,.

Якщо

ж

,

то навпаки. Це справедливо для будь-якої

кількості образівМ.

Отже,

вихід нейрона, вхідний сигнал якого

найбільшою мірою відповідає поданому

образу, із зростанням часу прагне до

нескінченності. Виходи ж інших

нейронів прямують

,

то навпаки. Це справедливо для будь-якої

кількості образівМ.

Отже,

вихід нейрона, вхідний сигнал якого

найбільшою мірою відповідає поданому

образу, із зростанням часу прагне до

нескінченності. Виходи ж інших

нейронів прямують

.

.

Приклад

8.2.

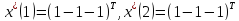

Розглянемо мережу Хеммінга, що має три

вхідних нейрони (N

= 3) і два вихідних (М = 2), що навчається

на векторах .

Нехай

.

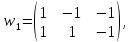

Нехай = 0,3. Тоді,

відповідно

до (8.1),

матриця

ваг матиме вигляд

= 0,3. Тоді,

відповідно

до (8.1),

матриця

ваг матиме вигляд

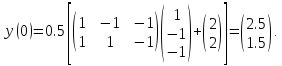

а

компоненти вихідного сигналу першого

шару при подачі сигналу

визначаються

з (8.3) (з урахуванням того, щоМ

= 2)

визначаються

з (8.3) (з урахуванням того, щоМ

= 2)

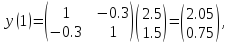

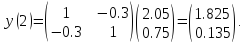

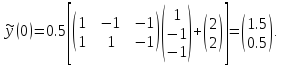

Після першої ітерації, відповідно до (8.7), на виході отримуємо

після другої –

Далі отримуємо, що перша компонента вектора вихідного сигналу у(і) на кожній наступній ітерації збільшується, а друга — зменшується (див. приклад 8.1).

Аналогічно

при подачі на вхід мережі

(2)

зростатиме друга компонента і

зменшуватиметься перша.

(2)

зростатиме друга компонента і

зменшуватиметься перша.

Нехай

на вхід мережі надходить образ x(3) =

,

що є спотвореним

,

що є спотвореним (1)

(біт, у якому відбулося спотворення,

підкреслений).

(1)

(біт, у якому відбулося спотворення,

підкреслений).

Тоді, відповідно до (8.5), на виході першого шару з’явиться сигнал

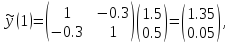

Після першої ітерації в рекурсивному шарі отримуємо

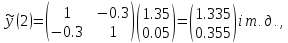

Після другої –

тобто

перша компонента вихідного сигналу

мережі збільшується, а друга

зменшується. Отже, поданий образ

мережа

розпізнає як

мережа

розпізнає як ,

тобто правильно. Зазначимо також, що

відстані Хеммінга між образомx(3)

і образами

,

тобто правильно. Зазначимо також, що

відстані Хеммінга між образомx(3)

і образами

і

і дорівнюватимуть

відповідно

дорівнюватимуть

відповідно =

1 й

=

1 й =

2. Отже, мережа сприйняла образx(3)

як накопичений нею раніше образ

=

2. Отже, мережа сприйняла образx(3)

як накопичений нею раніше образ

,що

знаходиться від x(3)

на мінімальній хеммінговій відстані.

,що

знаходиться від x(3)

на мінімальній хеммінговій відстані.

На завершення зазначимо, що при одній і тій самій ємності мереж мережа Хеммінга міститиме значно менше з’єднань між нейронами порівняно з мережею Гопфілда (у мережі Хеммінга залежність між кількістю нейронів і кількістю з’єднань лінійна, а в мережі Гопфілда — квадратична).

Контрольні запитання

Що являє собою модель мережі Хеммінга?

Як задається параметр є у мережі Хеммінга? На що впливає вибір його величини?

У чому основна відмінність мережі Хеммінга від мережі Гопфілда?