- •1Аннотация

- •2 Содержание задания

- •3 Теоретическая часть

- •3.1 Количественная оценка информации

- •3.2 Вычисление скорости передачи информации и пропускной

- •3.3 Определение избыточности сообщений. Оптимальное

- •4 Практическая часть

- •4.1 Содержание задания

- •4.2 Расчёт на основе исходных данных

- •4.2.1 Определение количества информации, соответствующего

- •4.2.2 Вычисление теоретической скорости передачи сообщений

- •4.2.3 Вычисление избыточности сообщений, составленных из

- •4.2.4 Построение оптимального кода сообщения

- •5 Заключение

- •6 Список литературы

5 Заключение

В процессе выполнения данной расчётно-графической работы был

синтезирован оптимальный неравномерный код. Данный код имеет

следующие свойства:

1. Код состоит из комбинаций различной длины;

2. Комбинации одинаковой длины не совпадают;

3. Никакие комбинации не являются началом более длинной

комбинации.

Данные условия являются условиями префиксности эффективного

кода, характеризующими его оптимальность.

В рамках данной расчётно-графической работы были произведены

расчёты количества информации, приходящегося на символ сообщения в

случае равновероятных и неравновероятных символов, определена

абсолютная недогруженность символов, теоретическая скорость передачи

данных и избыточность сообщений. Оптимальный код сообщения был

синтезирован на основе методики Шеннона – Фано.

Кодировка символов по методике Шеннона – Фано является

сравнительно оптимальной, так как символы, имеющие наибольшую

вероятность появления, будут иметь наименьшую длину кодового слова.

Необходимо отметить сходство метода Шеннона – Фано и более

актуального в настоящее время метода Хаффмана. Вместе с тем, метод

Шеннона – Фано является менее оптимальным, по отношению к методу

Хаффмана.

Алгоритм Шеннона – Фано, который был предложен Шенноном и

Фанов в 1948—49 гг. независимо друг от друга, так же как и метод Хаффмана основывается на статистических исследования, т. е. на числе вхождений символов в исходный текст. Таким образом, более вероятные символы кодируются малым числом бит, а менее вероятные — большим числом бит.

Несмотря на то, что данный имеет определённую избыточность, её

наличие практически не оказывает влияние на полученный результат.

6 Список литературы

1. Бауэр Ф. Л., Гооз Г. Информатика. Вводный курс: Пер. с нем. —

М.: Мир, 1990.

2. Колесник В. Д., Полтырев Г. Ш. Курс теории информации — М.:

Наука, 1982, 416 с.

3. Макаров Е. Инженерные расчёты в Mathcad 15 — Питер, 2011.

4. Использвание программных циклов в среде Mathcad —

Электронный ресурс, режим доступа: http://plasma.colorado.edu/

/mathcad/0_Essentials_Program_Loops.pdf

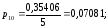

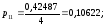

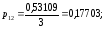

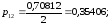

Приложение

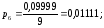

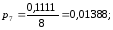

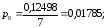

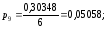

;

;

I

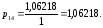

= k =14

=14 log214=14

log214=14 3,80735

= 53,3029

3,80735

= 53,3029 54

бит;

54

бит;

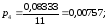

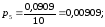

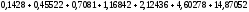

H=

=2,44827

=2,44827 3бит/символ

3бит/символ

I

=

Hmax=log2k = 3,80735бит4 бит.

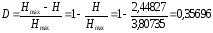

D

= (Hmax H)=3,80735

H)=3,80735 2,44827=1,35908

2,44827=1,35908 2

бит/символ

2

бит/символ

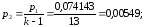

С= бит/c

бит/c