- •Обобщенная структура системы связи. 3.Характеристики систем связи.

- •Помехи в системах связи. Характеристики помех.

- •4, Информация. Понятие информации. Меры информации.

- •5. Мера Хартли

- •7.Вероятностный подход к измерению информации.

- •8. Статистическая мера количества информации.

- •Типичные сообщения, их свойства.

- •10. Семантический подход к оценке информации.

- •Энтропия дискретных сообщений.

- •Свойства энтропии.

- •Энтропия непрерывных сообщений.

- •14. Распределения с максимальной энтропией.

- •Непрерывные и дискретные сообщения. Общность и различие.

- •Характеристики случайных процессов.

- •18. Понятие стационарности случайного процесса (ссп).

- •Свойство эргодичности ссп.

- •20. Свойства корреляционной функции стационарного случайного процесса

- •23. Эффективная ширина спектра случайного процесса 21. Интервал корреляции.

- •Дискретизация по времени. Факторы, влияющие на выбор интервала дискретизации.

- •25. Теорема котельникова

- •26. Корреляционный критерий

- •Критерий наибольшего допустимого отклонения.

- •Оценка погрешности восстановления сигнала по дискретным отсчетам.

- •Функция отсчетов. Ее свойства.

- •Энтропия статистически зависимых сообщений.

- •31. Квантование по уровню

- •32. Тепловой, дробовый и фликкер шумы

- •Количество информации при наличии помех. 34. Как проявляется действие помех при передаче непрерывных и дискретных сообщений.

- •Скорость передачи информации.

- •Согласование источников сообщений с каналом связи.

- •Цели и задачи кодирования.

- •Оптимальное кодирование.

- •45. Критерий оптимальности кода.

- •Код Шеннона-Фано. Код Хаффмена.

- •Кодирование блоков сообщений.

Типичные сообщения, их свойства.

Все сообщения по характеру изменения во времени можно разделить на непрерывные и дискретные.

Непрерывные по времени сообщения отображаются непрерывной функцией времени. Дискретные по времени сообщения характеризуются тем, что поступают в определенные моменты времени и описываются дискретной функцией времени. Так как сообщения носят обычно случайный характер, то непрерывные сообщения описываются случайной функцией времени, а дискретные сообщения — как цепь случайных событий.

Сообщения можно также разделить на непрерывные и дискретные по множеству.

Непрерывные по множеству сообщения характеризуются тем, что функция, их описывающая, может принимать непрерывное множество значений (континуум значений) в некотором интервале.

Дискретные по множеству сообщения — это сообщения, которые могут быть описаны с помощью конечного набора чисел или дискретных значений некоторой функции.

Дискретности по множеству и времени не связаны друг с другом, Поэтому возможны следующие типы сообщений:

а) непрерывные по множеству и времени, или просто непрерывные (рис. 1.2);

б) непрерывные по множеству и дискретные по времени (рис. 1.3);

в) дискретные по множеству и непрерывные по времени (рис. 1.4);

г) дискретные по множеству и времени, или просто дискретные (рис. 1.5).

ИЗБЫТОЧНОСТЬ СООБЩЕНИЙ

Энтропия дискретных сообщений достигает максимума при равной вероятности элементов сообщений. Энтропия непрерывных сообщений также при определенных условиях достигает максимального значения. Таким образом можно говорить о сообщениях, являющихся оптимальными в смысле наибольшего количества передаваемой информации.

Однако условия, обеспечивающие максимум энтропии, выполняются далеко не всегда. Поэтому энтропия реальных сообщений зачастую оказывается меньше энтропии соответствующего ему оптимального сообщения. При одинаковом числе элементов количество информации в реальном сообщении будет меньше, чем в оптимальном.

Абсолютная избыточность сообщения Dабс характеризуется разностью между максимально возможным количеством информации Hmах и энтропией реального сообщения

Dабс = Hmах-H, (1-56)

а относительная избыточность соответственно

Dотн = (Hmах-H)/Hmах (1-57)

Избыточность сообщений приводит к увеличению времени передачи. Для уменьшения избыточности следует повышать информатив-ность элементов сообщения. В реальных системах для, повышения помехоустойчивости передаваемых сообщений избыточность вводят преднамеренно.

10. Семантический подход к оценке информации.

Семантические меры информации оценивают смысл, содержание информации, ее целесообразность и существенность. Содержательность события i выражается через функцию меры т (i) — содержательности его отрицания

cont (i) = m (~ i) = 1 — m (i), (I-58)

где cont (i) — содержательность события i; т — функция меры. ~ — знак отрицания.

Оценка содержательности базируется на математической логике, в которой логические функции истинности т (t) и ложности т (~ i) имеют формальное сходство с вероятностью события и его отрицания: т (i) + т (~ i) = 1 и 0 <= m (i) <= 1.

Логическая оценка количества информации имеет внешнее сходство со статистической

![]() где

Inf

— логическая оценка количества

информации.

где

Inf

— логическая оценка количества

информации.

Отличие логической оценки в том, что она учитывает меры истинности или ложности событий, а не вероятности их реализаций.

Существенность информации отражает степень важности информации о том или ином значении параметра X с учетом времени Т и пространства N.

Полезность информации для решения данной задачи можно оценивать по эффекту, который оказывает полученная информация на решение задачи. Если вероятность достижения цели увеличивается, тo информацию следует считать полезной. Можно также оценивать полезность информации числом попыток, которые совершает получатёль информации для достижения цели. При таких оценках информация может быть пустой, если она не изменяет вероятности или числа проб для достижения цели, положительной или отрицательной величиной.

Можно также оценивать ценность сообщений с помощью теории статистических решений. В этом случае во внимание принимается цель, с которой передается сообщение, т. е. учитываются результаты использования сообщений. Для оценки вводятся две характеристики: ценностная энтропия и ценность информации. При введении понятия ценностной энтропии рассматривается множество сообщений X и множество возможных решений Z. Вводится в рассмотрение также функция потерь R (x,z), определяющая потери, соответствующие каждому сообщению х и решению z. Если бы было известно предполагаемое к передаче сообщение, то каждый раз принималось бы решение, минимизирующее R (x, z). Если известно лишь распределение р (х), то выбирают некоторое конкретное правило решения G (х). Выбор решающего правила определяет величину потерь, соответствующую каждому значению сообщения. Под ценностной энтропией, понимают средние потери при определённой выбранной стратегии. Для дискретных сообщений ценностная энтропия Hц определится:

![]() где

λ

(х()

—

минимум функции потерь по z,

соответствующий данному xi.

где

λ

(х()

—

минимум функции потерь по z,

соответствующий данному xi.

Свойства энтропии дискретных сообщений

Формула (4.4) выражает энтропию дискретных сообщений.

![]()

Энтропия дискретных сообщений обладает следующими свойствами:

1. Энтропия есть величина вещественная, ограниченная и неотрицательная. Это свойство следует из выражения (4.4), если учесть, что вероятности p(xi) есть величины неотрицательные, заключенные в промежутке 0<=p(xi)<= 1.

2. Энтропия детерминированных сообщений равна нулю. Действительно, если заранее известно, какое будет событие, например х1 то вероятность этого события равна единице, а остальных — нулю, т. е. р(x1)=1; р(х2) = р(x2) = ••• = р(xn) = 0.

Запишем выражение, (4.4) в виде

![]()

Первый

член равен нулю, поскольку Iog21

= 0. Остальные члены также обращаются в

нуль при р (xi)

->

0. В самом деле, устремляя р

(xt)

к

нулю, получим

Введя

замену![]() и

раскрывая неопределенность по правилу

Лопиталя, получим

и

раскрывая неопределенность по правилу

Лопиталя, получим

![]()

3. Энтропия максимальна, если все события равновероятны.

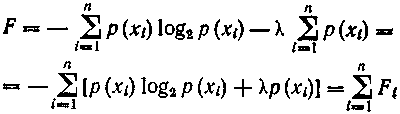

Нахождение оптимального значения вероятностей p(xi), при котором обеспечивается максимум энтропии, может быть произведено методом Лагранжа для отыскания условного экстремума. Для этого необходимо составить вспомогательную функцию F вида

![]() где

λ— множитель Лагранжа.

где

λ— множитель Лагранжа.

С

учетом того, чтопредставим вспомогательную

функцию

в виде![]()

и найдем максимум этой функции. Искомый максимум будет иметь место, когда

или

Величина вероятности p(xi) не зависит от номера , что может быть только тогда, когда все p(xi) равны между собой. Следовательно, энтропия максимальна при

![]()

что и требовалось доказать.

Максимальное значение энтропии

![]() (4.6)

(4.6)

Как видно из выражения (4.6), в случае равновероятных событий энтропия возрастает с увеличением количества событий.

4. Энтропия системы двухальтернативных событий может изменяться в пределах от нуля до единицы. Энтропия системы двух событий

![]()

Из последнего выражения видно, что энтропия равна нулю при

Р (x1) = 0; р (x2) = 1, или

p(x1) = 1; р(x2) = 0

Максимум энтропии будет иметь место, когда р (x1) = р (x2).

При этом максимальное значение энтропии

Таким

образом, можно утверждать, что одна

двоичная единица — это энтро пия системы двух равновероятных

независимых событий.

пия системы двух равновероятных

независимых событий.

На рис. представлена графически зависимость энтропии бинарных событий от вероятности одного из событий.