- •I. Основные понятия

- •1. Изображение объекта. Виды изображений.

- •2. Образ (класс).

- •9.Примеры задач распознавания.

- •I I Простейшие методы распознавания (сравнение с эталоном)

- •Вопрос 10. Общая характеристика простейших методов распознавания.

- •11. Метод совмещения с эталоном.

- •12. Метод зондов

- •22. Эвристический алгоритм максиминного расстояния.

- •23. Алгоритм к внутригрупповых средних.

- •24. Алгоритм isodata.

- •25. Достоинства и недостатки алгоритмов обучения без учителя.

- •V. Применение алгебры высказываний для решения задач распознавания

- •26. Изображающие числа и базис.

- •27. Восстановление булевой функции по изображающему числу.

- •28. Зависимость и независимость булевых функций.

- •30. Отыскание решений логического уравнения.

- •31. Техника решения логических уравнений с помощью булевых матриц.

- •32. Две задачи о замене переменных в булевых функциях.

- •33. Прямая и обратная логические задачи распознавания.

- •34. Пример логической задачи распознавания

- •37. Перцептрон и его мат. Модель

- •Вопрос 35. Алгоритм вычисления оценок (аво).

- •Вопрос 36. Основные идеи, лежащие в основе аво.

- •38. Алгоритм обучение перцептрона

- •39. Сходимость алгоритма обучения перцептрона. Теорема Новикова.

- •40. Итеративные процедуры распознав. На основе градиентных методов: минимизация одной ф-ии.

- •41. Итеративные процедуры распознав. На основе градиентных методов: совместная минимизация нескольких ф-ий.

- •42. Алгоритм обучения перцептрона как реализация спец. Стратегии совместной минимизации нескольких ф-ий с помощью градиентных методов.

- •43. Физическая интерпретация метода потенциальных ф-ий.

- •44. Кумулятивный потенциал. Алгоритм итеративного вычисления кумулятивного потенциала.

- •45. Теоремы о сходимости обучения классификации методом потенциальных функций.

- •46. Достоинства и недостатки распознающих процедур перцептронного типа.

- •VIII Стохастический подход к распознаванию образов

- •47. Элементы задачи решения.

- •48. Условный риск. Общий риск.

- •53. Схема доказательства оптимальности процедуры Неймана-Пирсона.

- •54 Обучение байесовской процедуры распознавания: оценка неизвестных параметров.

- •55. Оценка неизвестной плотности вероятности по априорной информации.

- •56. Оценка неизвестной плотности вероятности с использованием экспериментальных данных.

- •57 Правило ближайшего соседа как пример непараметрического метода

- •58. Основы мгуа.

- •59. Применение мгуа для решения задачи ро

- •70. Требование к вектору признаков

31. Техника решения логических уравнений с помощью булевых матриц.

Для решения логического уравнения нужно:

1)Транспонированную матрицу, состоящую из изображающих чисел коэффициентов одной части уравнения, умножить на матрицу, состоящую из изображающих чисел неизвестных этой же части уравнения. 2)Тоже самое проделать с другой частью уравнения.3)Полученные матрицы построчно сравниваем между собой, и если элементы в столбцах совпадают, то вносим в таблицу результатов соответствующие значения неизвестных, по отношению к базису коэффициентов.

32. Две задачи о замене переменных в булевых функциях.

Первая задача, Предположим, что задана некоторая функция F1 (А, В, С, ...) и совершается преобразование вида: A, B, C, … - элементарные высказывания заменяются на A = A (A, B, C, …),

B = B (A, B, C, …), C = C (A, B, C, …), …, (*) где A, B, C, … - новые переменные. Требуется найти функцию G1 (A, B, C, …) = F1 [A (A, B, C, … ),

B ( A, B, C, …), …].

Вторая задача обратна первой. Найти такое преобразование переменных вида (*), которое переводило бы функции Fk в функции Gk, то есть при всех k = 1, 2, … Fk [A (A, B, C, …); B (A, B, C, …); C (A, B, C, …); …] = Gk (A, B, C, …).

33. Прямая и обратная логические задачи распознавания.

Имеется априорная информация:

о взаимосвязях между признаками А1,…Аn

о взаимосвязях между индикаторами классов m.

о взаимосвязях между объектами и классами или между признаками и индикаторами.

Эта информация задана в виде логических уравнений

Фi(А1,…Аn)=1![]()

![]()

![]()

Прямая задача распознавания:

Требуется найти неизвестную функцию F(1,…,m):

неG(A1,…,An)+F(1,…,m)=1, где G(A1,…,An) – апостериорная информация

Обратная задача распознавания:

требуется определить множество априорных неизвестных посылок G(A1,…,An), из которых следуют некоторые данные вывода F(1,…,m), при условии, что признаки А1,…Аn и классы m. Связаны зависимостями (*), (**) и (***)

34. Пример логической задачи распознавания

Пусть объект характ-ся единственным бинарным признаком A1 (n=1).

m=2 : w1,w2=>Ω1, 2. Априорная информация (система (*)) :

- классы не могут иметь место одновременно: Ω1=не 2.

- значение признака однозначно определяет класс : A1= Ω1. Пусть об объекте известно: A1=0 не А1=1(**), G≡не А1. Тогда система (***) имеет вид :

(не не А1UF(Ω1, 2))=1& Ω1≡не 2& А1= Ω1. => F(Ω1, 2)=не А1(из1),

F(Ω1, 2)=не Ω1 (из 3)=> F(Ω1, 2)= 2.

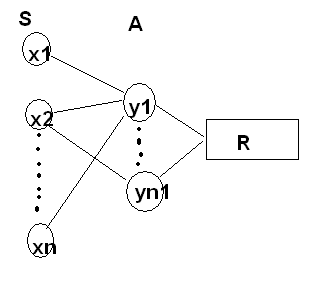

37. Перцептрон и его мат. Модель

Перцептрон-устройство,моделирующее работу человеческого мозга. Состоит из : а) S1,…, Sn – рецепторы (воспринимают сигналы из окруж-й среды).

б) A1,…,

An

– А-элементы

(каждый из них соединён с группой

s-элементов,

воспринимая их сигналы, выраб-т вых-й

сигнал, если общее воздействие s-э

превосходит нек-й заданный порог). в)

R-э

(воспринимает сигнал от А-э, выраб-т

вых-й сигнал, кот-й явл-ся линейной

комбинацией а-э).

![]()

Обучение перц-на свод-ся к установлению таких

значений wi, при кот-х маркир-я ОП правильно классиф-ся перц-м. Замечание:

различ-е модели перц-в отлич-ся друг от друга:

1)восприним-й способн-ю S-э.2)св-ми А-э. 3)системами соедин-я элементов. 4)кол-м слоёв элем-в. 5)проц-ми обучения перцепторна.

Матмодель перц-на: S-э поставим в соответ-е вектор x=(x1,…,xn); А-э –вектор y=(y1,…,yn1). y=(y1,…,yn1)T=φ(x)=(φ1(x),…,φn1(x))T.

Решение об отнесении х к одному из классов принимается так: 1) если ∑i=1n1 wiyi(в матр виде wTy)>0∑i=1n1 wi φi(x)>0=>x принадл-т w1. 2)если <0<0=>х прин-т w2. Геометричес-я интерпрет-я: если x€Xn, то wTφ(x)=0-определяет разделяющую гиперповерхность в пространстве Х. Если Х лежит по одну сторону раздел-й гиперпов-ти, то х€w1, и наоборот. x€Xn1 y€Yn1 , то wTy=0-ур-е плоскости, проход-й ч/з начало координат. Тогда решение: 2 полупрост-ва (для w1 и w2), простр-во Yn1 –спрямляющее пространство.