- •1. Основные определения.

- •2. Этапы обращения информации.

- •3. Понятие сигнала и его модели.

- •4. Формы представления детерминированных сигналов.

- •5. Представление сигнала в виде взвешенной суммы базисных функций. Понятие дискретного спектра сигнала и спектральной плотности.

- •6. Ортогональное представление сигналов.

- •7. Временная форма представления сигнала.

- •8. Частотная форма представления сигнала.

- •9. Спектры периодических сигналов.

- •10. Распределение энергии в спектре периодичного сигнала.

- •11. Спектры непериодических сигналов.

- •12. Распределение энергии в спектре непериодического сигнала. Равенство Парсеваля.

- •13. Соотношение между длительностью импульсов и шириной их спектра.

- •14. Спектральная плотность мощности детерминированного сигнала.

- •15. Функция автокорреляции детерминированного сигнала.

- •16. Случайный процесс как модель сигнала. Понятие ансамбля и пространства состояний. Виды случайных процессов.

- •17. Вероятностные характеристики случайного процесса.

- •18. Стационарные и эргодические случайные процессы.

- •19. Спектральное представление случайных сигналов.

- •20. Частотное представление стационарных случайных сигналов. Дискретные спектры.

- •21. Частотное представление стационарных случайных сигналов. Непрерывные спектры.

- •22. Основные свойства спектральной плотности.

- •23. Дискретизация непрерывных величин.

- •24. Квантование по времени. Теорема Котельникова.

- •25. Понятие модуляции.

- •26. Амплитудная модуляция.

- •27. Частотная модуляция.

- •28. Фазовая модуляция.

- •29. Модуляция импульсного тока.

- •30. Кодоимпульсные сигналы.

- •31. Многократная модуляция.

- •32. Количество информации в дискретных сообщениях. Энтропия дискретного источника.

- •33. Свойства энтропии.

- •34. Условия энтропии и ее свойства.

- •35. Передача информации от дискретного источника. Частное количество информации.

- •37. Частная условная энтропия. Условная энтропия источника. Апостериорная энтропия источника.

- •38. Количество информации в переданном сообщении дискретным источником.

- •39. Энтропия квантовой величины.

- •40. Количество информации в непрерывном сообщении. Априорная (безусловная) и апостериорная (условная) дифференциальные энтропии. Симметричность выражения количества информации.

- •43. Количество и скорость передачи информации при нормальном распределении сигнала и помехе (погрешности).

- •42. Количество информации, передаваемое за определенное время. Скорость передачи информации.

- •41. Количество передаваемой информации с учетом наличия аддитивной помехи.

- •44. Количество и скорость передачи информации при равномерном распределении сигнала и нормальном распределении помехи (погрешности).

- •45. Дифференциальная энтропия равномерно распределенной погрешности. Энтропийная погрешность.

- •46. Код, кодирование, кодовые сигналы.

- •47. Системы счисления.

- •48. Числовые коды.

- •49. Коды, не обнаруживающие возможных искажений.

- •50. Коды, обнаруживающие ошибки.

- •51. Информационная способность кода и избыточность.

- •52. Коды с коррекцией искажений.

35. Передача информации от дискретного источника. Частное количество информации.

Передача информации диктуется желанием устранить неопределенность относительно последовательности состояний, реализуемых некоторым источником информации.

Информация проявляется всегда в форме сигналов. Сигналы Z, поступающие с выхода первичного преобразователя источника информации на вход сигнала связи, принято называть сообщениями в отличие от сигнала “u”, формирующегося на входе линии связи.

Отдельные первичные сигналы с выхода источника дискретных сообщений называют элементами сообщений. Каждому элементу сообщения соответствует определенное состояние источника информации.

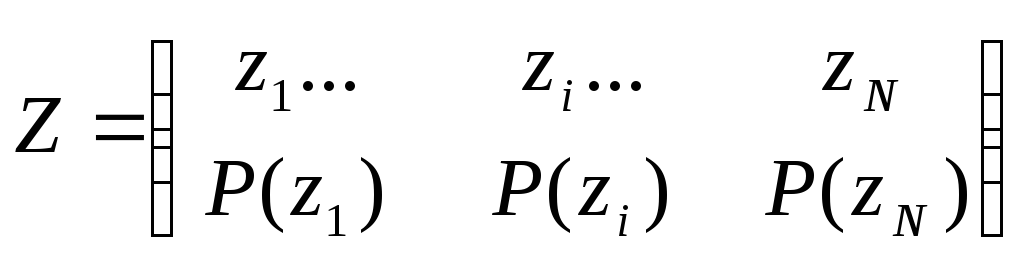

Основное понятие теории информации – количество информации – рассмотрим применительно к передаче отдельных статистически несвязанных элементов сообщения. Дискретный источник сообщений при этом полностью характеризуется ансамблем

Передача информации от дискретного источника.

Выясним на сколько изменится неопределенность относительно состояния источника сообщения при получении адресатом элемента сообщения с выхода канала связи. Алфавиты передаваемых и принимаемых элементов сообщений считаем идентичными.

Вследствие воздействия помех полученный (сигнал) элемент сообщения в общем отличается от переданного, поэтому принимаемые элементы сообщения обозначим другими буквами: 1, 2, …, i, …, N.

Априорная неопределенность (неопределенность до получения элемента сообщения) относительно источника сообщений не является полной. Предполагается, сто адресату известен алфавит элементов сообщения, а из прошлого опыта он знает вероятности их появления. Считая, что состояние источника реализуется независимо, априорная частотная неопределенность появления элемента сообщения Zi

![]()

где

![]() априорная

вероятность появления элемента сообщения

Zi.

априорная

вероятность появления элемента сообщения

Zi.

Предполагаются

также известными некоторые сведения

относительно помехи в канале связи.

Обычно считают, что между элементами

сообщения и помехой статистические

связи отсутствуют, искажения отдельных

элементов сообщения являются событиями

независимыми и адресату известна

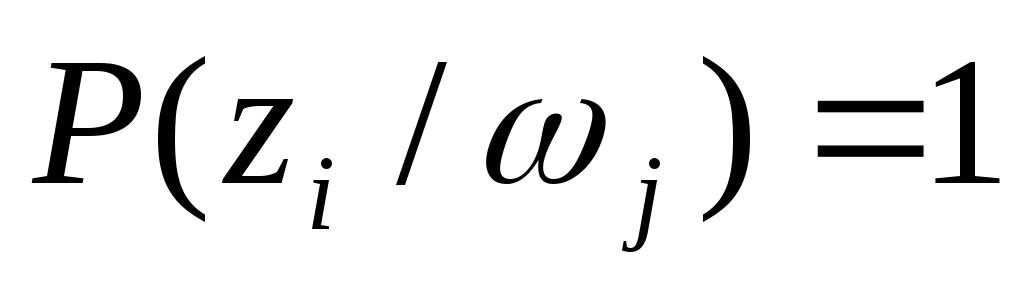

совокупность условных вероятностей

![]()

![]() того, что вместо элемента сообщения Zi

будет принят сигнал j,

т.е., что при получении сообщения j

исходной его причиной была передача

сообщения

Zi.

того, что вместо элемента сообщения Zi

будет принят сигнал j,

т.е., что при получении сообщения j

исходной его причиной была передача

сообщения

Zi.

При получении j

адресату становится известно значение

условной вероятности

![]() ,

называемой апостериорной вероятностью

реализации источником элемента сообщения

Zi.

Это позволяет найти апостериорную

частную неопределенность, остающуюся

у адресата относительно выдачи источников

элемента сообщения j

,

называемой апостериорной вероятностью

реализации источником элемента сообщения

Zi.

Это позволяет найти апостериорную

частную неопределенность, остающуюся

у адресата относительно выдачи источников

элемента сообщения j

![]() (28)

(28)

Поскольку получение информации связывается с уменьшением неопределенности, естественно определить частное количество информации I(Zi), получаемое при приеме элемента сообщения j относительно реализованного источником элемента сообщения Zi, как разность частных неопределенностей, имевшихся у адресата до и после получения элемента сообщения (априорной и апостериорной)

![]() (29)

(29)

36. Анализ формулы частного количества информации показывает

-

Частное количество информации растет с уменьшением априорной увеличением апостериорной вероятностей реализации элемента сообщения источником.

-

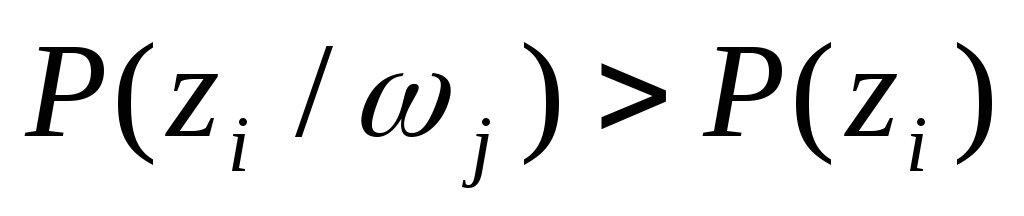

Частное количество информации может быть как положительным, так и отрицательным, а так же нулем. Если вероятность реализации источником элементов сообщения Zi увеличилась после приема элемента сообщения j , т.е.

,

то полученное количество информации

положительно. Если эта вероятность не

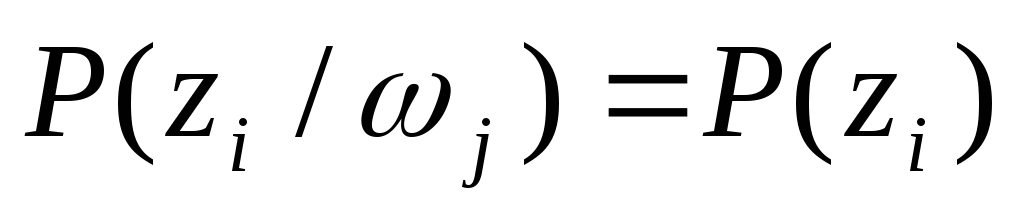

изменилась, т.е.

,

то полученное количество информации

положительно. Если эта вероятность не

изменилась, т.е.

,

то имевшая место неопределенность тоже

не изменилась и I(zi)=0.

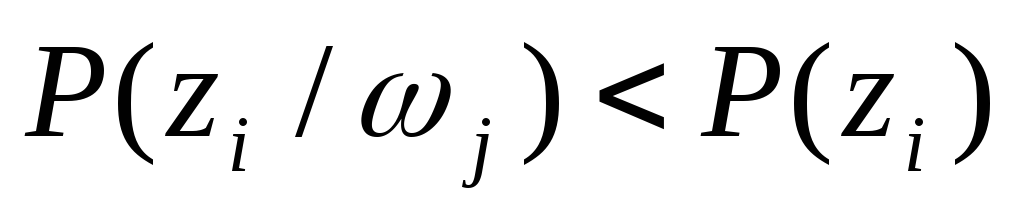

Cлучай

,

то имевшая место неопределенность тоже

не изменилась и I(zi)=0.

Cлучай

соответствует увеличению неопределенности

относительно реализации Zi

после получения элемента сообщения j

и, следовательно, частое количество

информации отрицательно, т.е. величина

дезинформации, внесенной помехами,

превышает величину информации, которую

несет переданное сообщение.

соответствует увеличению неопределенности

относительно реализации Zi

после получения элемента сообщения j

и, следовательно, частое количество

информации отрицательно, т.е. величина

дезинформации, внесенной помехами,

превышает величину информации, которую

несет переданное сообщение. -

В случае отсутствия помехи апостериорная вероятность

.

При этом частное количество информации

численно совпадают с частной априорной

неопределенностью реализации данного

элементе сообщения

Zi:

.

При этом частное количество информации

численно совпадают с частной априорной

неопределенностью реализации данного

элементе сообщения

Zi:

![]()

Это максимальное частное количество информации, которое можно получить от элементов сообщения Zi;

-

Частное количество информации относительно реализации источником элемента сообщения Zi, содержащееся в элементе сообщения j, равно частному количеству информации относительно j, содержащемуся в элементе сообщения Zi.

По теории Байеса вероятность совместного поступления событий Zi и j

![]()

Разделив все части

уравнения на произведение

![]() имеем

имеем

![]()

Поэтому можно записать

![]() (30)

(30)