- •1. Основные определения.

- •2. Этапы обращения информации.

- •3. Понятие сигнала и его модели.

- •4. Формы представления детерминированных сигналов.

- •5. Представление сигнала в виде взвешенной суммы базисных функций. Понятие дискретного спектра сигнала и спектральной плотности.

- •6. Ортогональное представление сигналов.

- •7. Временная форма представления сигнала.

- •8. Частотная форма представления сигнала.

- •9. Спектры периодических сигналов.

- •10. Распределение энергии в спектре периодичного сигнала.

- •11. Спектры непериодических сигналов.

- •12. Распределение энергии в спектре непериодического сигнала. Равенство Парсеваля.

- •13. Соотношение между длительностью импульсов и шириной их спектра.

- •14. Спектральная плотность мощности детерминированного сигнала.

- •15. Функция автокорреляции детерминированного сигнала.

- •16. Случайный процесс как модель сигнала. Понятие ансамбля и пространства состояний. Виды случайных процессов.

- •17. Вероятностные характеристики случайного процесса.

- •18. Стационарные и эргодические случайные процессы.

- •19. Спектральное представление случайных сигналов.

- •20. Частотное представление стационарных случайных сигналов. Дискретные спектры.

- •21. Частотное представление стационарных случайных сигналов. Непрерывные спектры.

- •22. Основные свойства спектральной плотности.

- •23. Дискретизация непрерывных величин.

- •24. Квантование по времени. Теорема Котельникова.

- •25. Понятие модуляции.

- •26. Амплитудная модуляция.

- •27. Частотная модуляция.

- •28. Фазовая модуляция.

- •29. Модуляция импульсного тока.

- •30. Кодоимпульсные сигналы.

- •31. Многократная модуляция.

- •32. Количество информации в дискретных сообщениях. Энтропия дискретного источника.

- •33. Свойства энтропии.

- •34. Условия энтропии и ее свойства.

- •35. Передача информации от дискретного источника. Частное количество информации.

- •37. Частная условная энтропия. Условная энтропия источника. Апостериорная энтропия источника.

- •38. Количество информации в переданном сообщении дискретным источником.

- •39. Энтропия квантовой величины.

- •40. Количество информации в непрерывном сообщении. Априорная (безусловная) и апостериорная (условная) дифференциальные энтропии. Симметричность выражения количества информации.

- •43. Количество и скорость передачи информации при нормальном распределении сигнала и помехе (погрешности).

- •42. Количество информации, передаваемое за определенное время. Скорость передачи информации.

- •41. Количество передаваемой информации с учетом наличия аддитивной помехи.

- •44. Количество и скорость передачи информации при равномерном распределении сигнала и нормальном распределении помехи (погрешности).

- •45. Дифференциальная энтропия равномерно распределенной погрешности. Энтропийная погрешность.

- •46. Код, кодирование, кодовые сигналы.

- •47. Системы счисления.

- •48. Числовые коды.

- •49. Коды, не обнаруживающие возможных искажений.

- •50. Коды, обнаруживающие ошибки.

- •51. Информационная способность кода и избыточность.

- •52. Коды с коррекцией искажений.

20. Частотное представление стационарных случайных сигналов. Дискретные спектры.

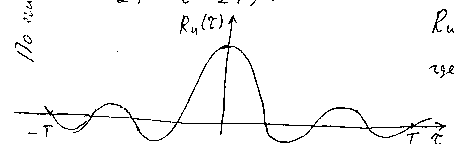

Корреляционную функцию Ru() (см. рис. 15) стационарного случайного процесса, заданного на конечном интервале времени [-T, T], можно разложить в ряд Фурье (15), условно считая ее периодически продолжающейся с периодом 4Т (при –T < t1, t2 < T, -2T<<2T):

![]() (91)

(91)

где k = k1, 1= / 2T;

По аналогии с (64)

Рис. 15

![]() (92)

(92)

Учитывая, что Ru() является четной функцией, имеем

![]() (93)

(93)

Положив = t1 – t2, находим

![]() (94)

(94)

что согласно (89) представляет собой каноническое разложение корреляционной функции. По нему, как было указано ранее, получаем разложение случайного процесса:

![]() , (95)

, (95)

причем

![]() (96)

(96)

Выражение (95) записано для случайного процесса с нулевой постоянной составляющей, что характерно для многих реальных сигналов. В общем случае в правую часть этого выражения необходимо добавить постоянную величину, соответствующую математическому ожиданию случайного процесса (mu). Корреляционная функция при этом не изменяется.

Очевидно, что при попарном объединении экспоненциальных составляющих с одинаковыми положительными и отрицательными индексами k каноническое разложение (95) приводится к тригонометрической форме.

Таким образом стационарный случайный процесс на ограниченном интервале времени можно представить совокупностью гармонических составляющих различных частот с амплитудами, являющимися некоррелированными случайными величинами, математические ожидания которых равны нулю.

![]() (96

а)

(96

а)

где

![]()

![]()

Н а

спектральной диаграмме такого процесса

каждой гармонике ставится в соответствие

вертикальный отрезок длина которого

пропорциональна дисперсии

ее амплитуды,

а расстояние на оси абсцисс отвечает

частоте. (рис. 16)

а

спектральной диаграмме такого процесса

каждой гармонике ставится в соответствие

вертикальный отрезок длина которого

пропорциональна дисперсии

ее амплитуды,

а расстояние на оси абсцисс отвечает

частоте. (рис. 16)

Рис. 16

Чтобы получить описание стационарного случайного процесса в точном смысле, т.е. справедливое для любого момента времени на бесконечном интервале -<t< необходимо перейти к интегральному каноническому разложению.

21. Частотное представление стационарных случайных сигналов. Непрерывные спектры.

Интегральное каноническое разложение для корреляционной функции получим из формулы (91) путем предельного перехода при Т. Увеличения интервала времени, на котором наблюдается случайный процесс, сопровождающийся уменьшением значений дисперсий, что следует из (92), а также сокращением расстояний между спектральными линиями, поскольку

![]() (97)

(97)

При достаточно большом, но конечном Т можно записать выражение для средней плотности распределения дисперсии по частоте:

![]() (98)

(98)

где

![]() - средняя плотность дисперсии на участке,

прилегающем к частоте k

- средняя плотность дисперсии на участке,

прилегающем к частоте k

Теперь можно преобразовать формулы (91) и (98) к виду. Dk подставляем из (92).

![]() (99)

(99)

![]() (100)

(100)

Переходя к пределу при Т, получаем

![]() (101)

(101)

где

![]() (102)

(102)

Т.к. величина

![]()

являлась не только дисперсией Dk

коэффициента разложения корреляционной

функции Ru(),

но и дисперсией D[Ck]

коэффициента разложения случайного

процесса U(t),

то величина Suu()d,

полученная в результате предельного

перехода при Т,

представляет собой дисперсию, приходящуюся

на спектральные составляющие стационарного

случайного процесса, занимающие

бесконечно малый интервал частот (,

+d).

Функцию Suu(),

характеризующую распределения дисперсии

случайного процесса по частотам, называют

спектральной

плотностью стационарного случайного

процесса U(t).

являлась не только дисперсией Dk

коэффициента разложения корреляционной

функции Ru(),

но и дисперсией D[Ck]

коэффициента разложения случайного

процесса U(t),

то величина Suu()d,

полученная в результате предельного

перехода при Т,

представляет собой дисперсию, приходящуюся

на спектральные составляющие стационарного

случайного процесса, занимающие

бесконечно малый интервал частот (,

+d).

Функцию Suu(),

характеризующую распределения дисперсии

случайного процесса по частотам, называют

спектральной

плотностью стационарного случайного

процесса U(t).

Выражение для интегрального канонического разложения корреляционной функции Ru(t) найдем, положив в формуле (101) t = t1 – t2 :

![]() (103)

(103)

Обозначив

![]() и повторив процедуру предельного

перехода при Т

для соотношения (95), получим каноническое

разложение стационарной случайной

функции

и повторив процедуру предельного

перехода при Т

для соотношения (95), получим каноническое

разложение стационарной случайной

функции

![]() :

:

![]() (104)

(104)

где дисперсией случайной функции G()d является функция Suu(w)dw.