- •1. Основные определения.

- •2. Этапы обращения информации.

- •3. Понятие сигнала и его модели.

- •4. Формы представления детерминированных сигналов.

- •5. Представление сигнала в виде взвешенной суммы базисных функций. Понятие дискретного спектра сигнала и спектральной плотности.

- •6. Ортогональное представление сигналов.

- •7. Временная форма представления сигнала.

- •8. Частотная форма представления сигнала.

- •9. Спектры периодических сигналов.

- •10. Распределение энергии в спектре периодичного сигнала.

- •11. Спектры непериодических сигналов.

- •12. Распределение энергии в спектре непериодического сигнала. Равенство Парсеваля.

- •13. Соотношение между длительностью импульсов и шириной их спектра.

- •14. Спектральная плотность мощности детерминированного сигнала.

- •15. Функция автокорреляции детерминированного сигнала.

- •16. Случайный процесс как модель сигнала. Понятие ансамбля и пространства состояний. Виды случайных процессов.

- •17. Вероятностные характеристики случайного процесса.

- •18. Стационарные и эргодические случайные процессы.

- •19. Спектральное представление случайных сигналов.

- •20. Частотное представление стационарных случайных сигналов. Дискретные спектры.

- •21. Частотное представление стационарных случайных сигналов. Непрерывные спектры.

- •22. Основные свойства спектральной плотности.

- •23. Дискретизация непрерывных величин.

- •24. Квантование по времени. Теорема Котельникова.

- •25. Понятие модуляции.

- •26. Амплитудная модуляция.

- •27. Частотная модуляция.

- •28. Фазовая модуляция.

- •29. Модуляция импульсного тока.

- •30. Кодоимпульсные сигналы.

- •31. Многократная модуляция.

- •32. Количество информации в дискретных сообщениях. Энтропия дискретного источника.

- •33. Свойства энтропии.

- •34. Условия энтропии и ее свойства.

- •35. Передача информации от дискретного источника. Частное количество информации.

- •37. Частная условная энтропия. Условная энтропия источника. Апостериорная энтропия источника.

- •38. Количество информации в переданном сообщении дискретным источником.

- •39. Энтропия квантовой величины.

- •40. Количество информации в непрерывном сообщении. Априорная (безусловная) и апостериорная (условная) дифференциальные энтропии. Симметричность выражения количества информации.

- •43. Количество и скорость передачи информации при нормальном распределении сигнала и помехе (погрешности).

- •42. Количество информации, передаваемое за определенное время. Скорость передачи информации.

- •41. Количество передаваемой информации с учетом наличия аддитивной помехи.

- •44. Количество и скорость передачи информации при равномерном распределении сигнала и нормальном распределении помехи (погрешности).

- •45. Дифференциальная энтропия равномерно распределенной погрешности. Энтропийная погрешность.

- •46. Код, кодирование, кодовые сигналы.

- •47. Системы счисления.

- •48. Числовые коды.

- •49. Коды, не обнаруживающие возможных искажений.

- •50. Коды, обнаруживающие ошибки.

- •51. Информационная способность кода и избыточность.

- •52. Коды с коррекцией искажений.

19. Спектральное представление случайных сигналов.

Аналогично представлению детерминированных сигналов совокупностью элементарных базисных сигналов поступают и в случае сигналов, описываемых случайными процессами.

Рассмотрим случайный

процесс U(t),

имеющий математическое ожидание mu(t).

Соответствующий центрированный случайный

процесс

![]() характеризуется в момент времени t1

центрированной случайной величиной

характеризуется в момент времени t1

центрированной случайной величиной

![]() :

:

![]() (86)

(86)

Центрированный

случайный процесс

![]() можно, как и ранее, выразить в виде

конечной или бесконечной суммы

ортогональных составляющих, каждая из

которых представляет собой неслучайную

базисную функцию k(t)

с коэффициентом Ck,

являющимся случайной величиной. В

результате имеем разложение центрированного

случайного процесса

можно, как и ранее, выразить в виде

конечной или бесконечной суммы

ортогональных составляющих, каждая из

которых представляет собой неслучайную

базисную функцию k(t)

с коэффициентом Ck,

являющимся случайной величиной. В

результате имеем разложение центрированного

случайного процесса

![]() :

:

![]() (87)

(87)

Случайные величины Ck называются коэффициентами разложения. В общем случае они статистически зависимы, и эта связь задается матрицей коэффициентов корреляции ||Rki||. Математические ожидания коэффициентов разложения равны нулю. Неслучайные базисные функции принято называть координатными функциями.

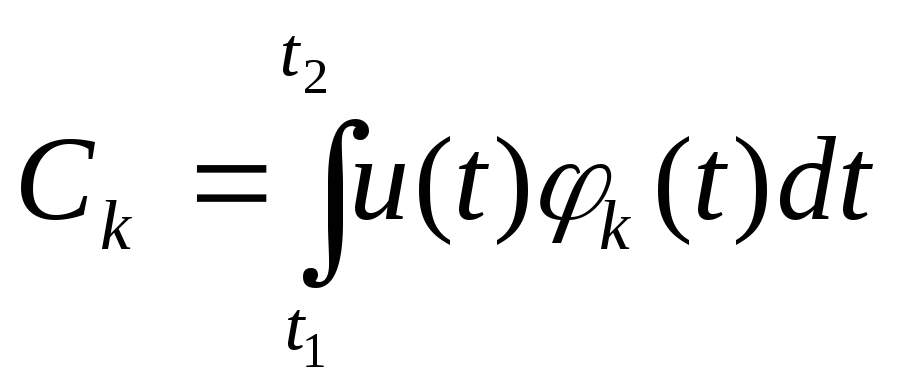

Для конкретной реализации коэффициенты разложения являются действительными величинами и определяются по формуле (7).

([7])

([7])

Предположив, что

![]() ,

детерминированную функцию mu(t)

в (86) на интервале –T<t<T

также можно разложить по функциям k(t),

представив в виде

,

детерминированную функцию mu(t)

в (86) на интервале –T<t<T

также можно разложить по функциям k(t),

представив в виде

![]() , (87а)

, (87а)

![]() . (87б)

. (87б)

Подставляя (87), (87а) в (86) для случайного процесса U(t) с отличным от нуля средним, получим

![]() . (87в)

. (87в)

Выражение случайного

процесса в виде (87в) позволяет существенно

упростить его линейные преобразования,

поскольку они сводятся к преобразованиям

детерминированных функций [mu(t),

![]() ],

а коэффициенты разложения, являющиеся

случайными величинами, остаются

неизменными.

],

а коэффициенты разложения, являющиеся

случайными величинами, остаются

неизменными.

Чтобы определить

требования к координатным функциям,

рассмотрим корреляционную функцию

процесса

![]() ,

заданную разложением

,

заданную разложением

![]() .

.

Так как Dk – дисперсия коэффициента Ck

![]()

то

![]() (88)

(88)

Соотношение (88) становится значительно проще, если коэффициенты {Ck} некоррелированы (Rkl=0 при kl, Rkl=Dk при k=l):

![]() . (89)

. (89)

В частности, при t1 = t2 = t получим дисперсию случайного процесса U(t)

![]() (90)

(90)

Поэтому целесообразно выбирать такие координатные функции, которые обеспечивают некоррелированность случайных величин {Ck}. Разложение (87), удовлетворяющее этому условию, называют каноническим разложением.

Доказано, что по известному каноническому разложению корреляционной функции случайного процесса можно записать каноническое разложение самого случайного процесса с теми же координатными функциями, причем дисперсии коэффициентов этого разложения будут равны дисперсиям коэффициентов разложения корреляционной функции.

Таким образом, при выбранном наборе координатных функций центрированный случайный процесс характеризуется совокупностью дисперсий коэффициентов разложения, которую можно рассматривать как обобщенный спектр случайного процесса.

В каноническом разложении (87) этот спектр является дискретным (линейчатым) и может содержать как конечное, так и бесконечное число членов (линий).

Однако используются и интегральные канонические разложения в форме (2). В этом случае мы имеем непрерывный спектр, представляемый спектральной плотностью дисперсий.

Основным препятствием к широкому практическому использованию канонических разложений случайных процессов является сложность процедуры отыскания координатных функций. Однако для ряда стационарных случайных процессов эта процедура вполне приемлема.