- •2. Нормальный закон распределения. Дисперсия. Ско.

- •3. Проверка данных на соответствие нормальному закону.

- •4. Средний уровень и вариация альтернативного признака.

- •9. Средняя и предельная ошибка выборки. Построение доверительных интервалов.

- •16. Веса агрегатных индексов.

- •20.Корреляционные поля

- •21. Корреляционно-регрессионный анализ.

- •27. Тенденции развития (тренды).

- •29. Сглаживание рядов динамики с помощью скользящей средней.

- •30. Аналитическое сглаживание (выравнивание) рядов динамики.

Закон и плотность распределения случайной величины. Показатели формы распределения.

Определение случайной величины. Многие случайные события могут быть оценены количественно как случайные величины. Случайной называют такую величину, которая принимает значения в зависимости от стечения случайных обстоятельств. Различают дискретные и непрерывные случайные величины.

Распределение дискретной случайной величины. Дискретная величина считается заданной, если указаны возможные ее значения и соответствующие им вероятности. Обозначим дискретную случайную величину х, ее значения х1, х2…, в вероятности: Р (х1) =р2, Р (х2) = р2 и т. д.

Совокупность х и Р называется распределением дискретной случайной величины.

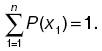

Так как все возможные значения дискретной случайной величины представляют полную систему, то сумма вероятностей равна единице:

Здесь предполагается, что дискретная случайная величина имеет n значений. Выражение называется условием нормировки.

Во многих случаях наряду с распределением случайной величины или вместо него информацию об этих величинах могут дать числовые параметры, получившие название числовых характеристик случайной величины. Наиболее употребительные из них: 1) математическое ожидание (среднее значение) случайной величины есть сумма произведений всех возможных ее значений на вероятности этих значений;

2) дисперсией случайной величины называют математическое ожидание квадрата отклонения случайной величины от ее математического ожидания.

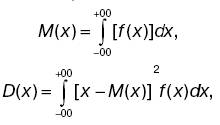

Для непрерывной случайной величины математическое ожидание и дисперсия записываются в виде:

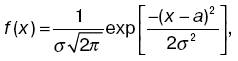

где f(x) – плотность вероятности или функция распределения вероятностей. Она показывает, как изменяется вероятность отнесения к интервалу dx случайной величины в зависимости от значения самой этой величины. Нормальный закон распределения. В теориях вероятностей и математической статистики, в различных приложениях важную роль играет нормальный закон распределения (закон Гаусса). Случайная величина распределена по этому закону, если плотность ее вероятности имеет вид:

где а = М(х) – математическое ожидание случайной величины;

σ – среднее квадратное отклонение; следовательно;

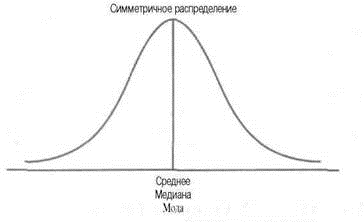

σ2– дисперсия случайной величины. Кривая нормального закона распределения имеет колоколообразную форму, симметричную относительно прямой х = а (центр рассеивания).

Формы распределения.

Любое реальное распределение можно изобразить схематически в виде кривой, воспроизводящей основные особенности данного распределения. Под кривой распределения понимается графическое изображение в виде непрерывной линии изменения частот, функционально связанных с изменением вариант.

Элементами распределения являются:

варианта

частота

В зависимости от вида кривых, изображающих распределение, выделяют несколько основных типов распределения:

одновершинные

многовершинные

К одновершинным относятся те, в которых один, обычно центральный вариант, имеет наибольшую частоту (плотность распределения). Частоты же остальных вариантов убывают по мере удаления от центрального.

Если частоты убывают слева и справа от центрального значения одинаково, то такие распределения называются симметричными.

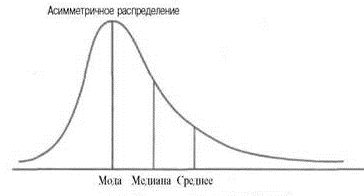

Если частоты убывают слева и справа от центра распределения с разной скоростью, то такие распределения называют асимметричными.

Многовершинные распределения — это распределения, в которых несколько центров, т. е. такие, у которых несколько максимумов частот.

Для однородных совокупностей, как правило, характерны одновершинные распределения.

Многовершинность распределения свидетельствует о неоднородности изучаемого явления. В этом случае необходимо произвести перегруппировку данных с целью выделения более однородных групп.

Выяснение общего характера распределения предполагает, наряду с оценкой его однородности, вычисление показателей асимметрии и эксцесса.

Кривые распределения бывают:

симметричными

асимметричными.

В зависимости от того, какая ветвь кривой распределения вытянута, различают:

правостороннюю асимметрию

левостороннюю асимметрию.

Для характеристики степени асимметрии двух или нескольких рядов пользуются коэффициентом асимметрии.

Для одновершинных распределений:

![]()

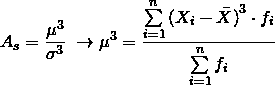

Более точным является коэффициент асимметрии, рассчитанный как отношение центрального момента третьего порядка (μ3) к среднеквадратическому отклонению в 3-й степени (Ϭ3):

Для симметричного распределения:

![]()

Соответственно, в симметричном распределении центральный момент 3-го порядка равен нулю (μ3=0), т. е. алгебраическая сумма отклонений отдельных значений признака (вариант), расположенных слева и справа от средней, равна нулю. График симметричного распределения симметричен относительно точки максимума.

Для несимметричных распределений центральные моменты нечетного порядка отличны от нуля:

2. Асимметрия положительна (As>0), если длинная часть кривой распределения расположена справа от моды (Мо). В этом случае соотношение между средней, медианой и модой нарушено:

![]()

As< 0.25 – слабая асимметрия

As= 0.25-0.5 – умеренная асимметрия

As> 0.5 – крайне асимметричное распределение

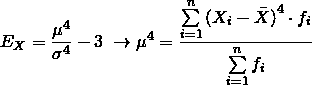

Для оценки «крутизны» (островершинности) распределения пользуются характеристикой – эксцессом.

Коэффициент эксцесса:

Для нормального распределения:

![]()

Выше нормального (островершинное распределение):

![]()

Ниже нормального (плосковершинное распределение):

![]()

2. Нормальный закон распределения. Дисперсия. Ско.

Дисперсия - средний квадрат отклонений индивидуальных значений признака от их средней величины.

Существует закон, связывающий три вида дисперсии. Общая дисперсия равна сумме средней из внутригрупповых и межгрупповых дисперсий:

Данное соотношение называют правилом сложения дисперсий. Согласно этому правилу, общая дисперсия, возникающая под действием всех факторов, равна сумме дисперсии, возникающей за счет группировочного признака.

Зная любые два вида дисперсий, можно определить или проверить правильность расчета третьего вида.

Правило сложения дисперсий широко применяется при исчислении показателей тесноты связей, в дисперсионном анализе, при оценке точности типической выборки и в ряде других случаев.

Свойства дисперсии:

1. Дисперсия постоянной величины равна нулю.

2. Уменьшение всех значений признака на одну и ту же величину А не меняет величины дисперсии. Значит средний квадрат отклонений можно вычислить не по заданным значениям признака, а по отклонениям их от какого-то постоянного числа.

3. Уменьшение всех значений признака в k раз уменьшает дисперсию в k2 раз, а среднее квадратическое отклонение - к раз. Значит, все значения признака можно разделить на какое-то постоянное число (скажем, на величину интервала ряда), исчислить среднее квадратическое отклонение, а затем умножить его на постоянное число.

4. Если исчислить средний квадрат отклонений от любой величины А, то в той или иной степени отличающейся от средней арифметической (X~), то он всегда будет больше среднего квадрата отклонений, исчисленного от средней арифметической. Средний квадрат отклонений при этом будет больше на вполне определенную величину - на квадрат разности средней и этой условно взятой величины.

Внутригрупповая и межгрупповая дисперсия.

Выделяют дисперсию общую, межгрупповую и внутригрупповую. Общая дисперсия s2 измеряет вариацию признака во всей совокупности под влиянием всех факторов, обусловивших эту вариацию.

Межгрупповая дисперсия (s2x) характеризует систематическую вариацию, т.е. различия в величине изучаемого признака, возникающие под влиянием признака-фактора, положенного в основание группировки.

Внутригрупповая дисперсия (s2i) отражает случайную вариацию, т.е. часть вариации, происходящую под влиянием неучтенных факторов и не зависящую от признака-фактора, положенного в основание группировки.

3. Проверка данных на соответствие нормальному закону.

С этого начинаются практически все виды стат. Анализа

Наиболее используемый критерий Пирсона, Романовского, Колмогорова

Все 3 критерия основываются на сравнении эмпирических и теоретических частот.

Теоретические частоты вычисляются так:

По исходным данным находят среднее (х ср) и СКО/дисперсию

Для каждой варианты вычисляются нормированные величины Ти=(Хи-Хср)/СКО

Находят значение нормальной функции фи(Ти)=1/корень2Пи*е в степени -Ти2/2

Вычисляют теоретические частоты фти=фи(Ти)*Nhi/СКО (N– объем совокупности,hi–длина интервала)

По пирсону: вычисляется хи2 =смм(фи-фти)2/фти на основе отклонения теоретических частот от эмпирических по таблице значений находится хи2крит для уровня значимости альфа=0,1 0,05 0,01

v– число степ свобод, к-число интервалов,v=к-3

уровень значимости альфа показывает вероятность принятия ошибочного решения

Сравнивая рачетные значения с критическими и получив хи2< хи2крит мы принимаем гипотезу вероятности с вероятностью Р=1-альфа

Критерий пирсона пригоден если –результаты наблюдений независимы, N>50, в каждом интервалеn>5

Критерий романовского также основан на расчете хи2

По этому критерию вычисляется величина С=|хи2-v|/корень 2Пи. Если С<3, то закон распределения эмпирических данных считается нормальным

Критерий согласия Колмогорова

Вычисляется величина Дмакс между накопленными эмпирическими и теоретическими частотами

Вычисляется лямда=Дмакс/кореньN

Находят вероятность Р(лямда) того, что исследуемые экспериментальные данные подчиняются нормальному закону распределения Р(лямда)принадлежит(0,1)