- •Аннотация

- •Введение

- •Термины и определения

- •Биометрические методы идентификации

- •Анатомия пальца человека

- •Общие сведения о преобразовании Габора

- •Обзор существующих методов генерации отпечатков пальцев

- •Обзор существующего программного обеспечения

- •Введение

- •Формализация алгоритма генерации искусственных биометрических образов

- •Roc-анализ

- •Математическая постановка задачи

- •Решение поставленной математической задачи

- •Введение

- •Разработка общей структуры по

- •Выбор языка программирования

- •Выбор типа оп и формирование глобальных признаков

- •Построение поля направлений

- •Построение шаблона

- •Применение фильтра Габора

- •Обрезание изображения

- •Введение

- •Расчёт трудоёмкости проекта

- •4.2.2 Построение сетевого графика

- •4.2.3 Диаграмма Гантта

- •4.2.4 Анализ структуры затрат проекта

- •4.2.5 Затраты на выплату заработной платы

- •4.2.6 Отчисления на социальные нужды

- •4.2.7 Материальные затраты

- •4.2.8 Прочие затраты

- •4.2.9 Затраты на организацию рабочих мест

- •4.2.10 Накладные расходы

- •4.2.11 Суммарные затраты на реализацию программного проекта

- •Исследование рынка

- •4.3.1 Планирование цены и прогнозирование прибыли

- •4.3.2 Сервисное обслуживание

- •4.3.3 Отчисления на социальные нужды

- •Введение

- •Конституция Российской Федерации

- •Доктрина информационной безопасности Российской Федерации

- •Федеральный Закон «Об информации, информационных технологиях и о защите информации»

- •Федеральный Закон «о персональных данных»

- •Постановление Правительства Российской Федерации «Об утверждении требований к защите персональных данных при их обработке в информационных системах персональных данных»

- •Гражданский Кодекс Российской Федерации

- •Уголовный Кодекс Российской Федерации

Введение

В конструкторской части приводится подробная формализация алгоритма генерации искусственных биометрических образов. Также описывается математическая постановка задачи.

Формализация алгоритма генерации искусственных биометрических образов

В данном дипломном проекте реализуется алгоритм генерации искусственных отпечатков пальцев на основе модели Шерлока и Монро с применением фильтра Габора.

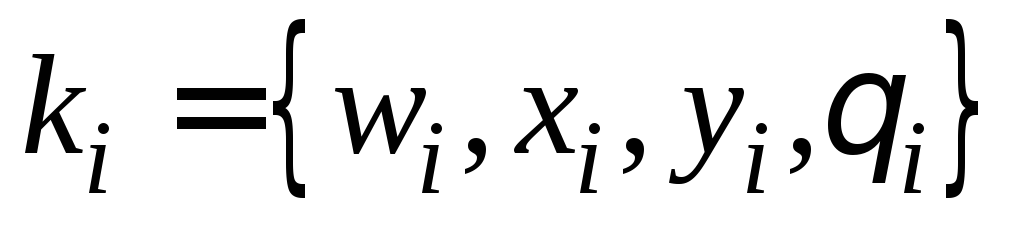

Пусть

![]() и

и![]() − горизонтальный и вертикальный размер

изображения соответственно, пусть

− горизонтальный и вертикальный размер

изображения соответственно, пусть![]() − разрешение изображения (в пикселях

на см) и пусть

− разрешение изображения (в пикселях

на см) и пусть![]() − набор

− набор![]() минуций

минуций![]() -го

шаблона отпечатка пальца, где каждая

минуция определяется, как

-го

шаблона отпечатка пальца, где каждая

минуция определяется, как![]() ,

где где

,

где где![]() -

тип точки,

-

тип точки,![]() -

координаты точки (в пикселях),

-

координаты точки (в пикселях),![]() -

ориентация (

-

ориентация (![]() ,

в радианах). Параметр

,

в радианах). Параметр![]() принимает значения: 01 – для точки

окончания гребня, 10 – для точки бифуркации

гребня, 00 – для других точек.

принимает значения: 01 – для точки

окончания гребня, 10 – для точки бифуркации

гребня, 00 – для других точек.

Обозначим ряд последовательных шагов, из которых состоит данный алгоритм:

Выбирается тип и формируются глобальные признаки отпечатка пальца (задаются позиции ядер и дельт);

На основе данных о глобальных признаках выстраивается поле направлений по модели Шерлока-Монро.

Ориентация

![]() для каждой точки

для каждой точки![]() определяется

по формуле:

определяется

по формуле:

,

,

где

![]() - комплексное число, состоящее из

- комплексное число, состоящее из![]() - координат точки, в которой вычисляется

направление папиллярных линий;

- координат точки, в которой вычисляется

направление папиллярных линий;![]() - количество дельт в отпечатке пальца;

- количество дельт в отпечатке пальца;![]() - количество островов в отпечатке пальца;

- количество островов в отпечатке пальца;![]() - комплексное число, состоящее из

- комплексное число, состоящее из![]() - координат

- координат![]() -ой

дельты отпечатка пальца;

-ой

дельты отпечатка пальца;![]() - комплексное число, состоящее из

- комплексное число, состоящее из![]() - координат

- координат![]() -го

острова отпечатка пальца;

-го

острова отпечатка пальца;![]() - функция, возвращающая фазу комплексной

переменной

- функция, возвращающая фазу комплексной

переменной![]() .

.

На основе поля направлений и частоты линий строится шаблон. Для этого задаются позиции ключевых точек (случайно или в соответствии с исходными данными). Для каждой минуции

в

позицию

в

позицию пустого изображения помещается растровый

прототип, соответствующий типу минуции;

пустого изображения помещается растровый

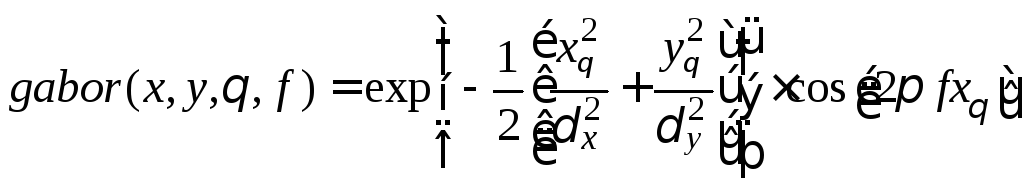

прототип, соответствующий типу минуции;Далее изображение в несколько итераций попиксельно обрабатывается фильтром Габора:

,

,

где

![]() ,

,![]() ;

;

![]() пространственное направление фильтра,

определяющее ориентацию фильтра

относительно осей

x

и y;

пространственное направление фильтра,

определяющее ориентацию фильтра

относительно осей

x

и y;

![]() и

и![]() – пространственные константы огибающей

Гаусса вдоль осей

– пространственные константы огибающей

Гаусса вдоль осей

![]() и

и![]() соответственно (корректируется в

зависимости от частоты так, что фильтр

не содержит более трёх эффективных

пиков);

соответственно (корректируется в

зависимости от частоты так, что фильтр

не содержит более трёх эффективных

пиков);![]() – частота синусоидальной плоскостной

волны.

– частота синусоидальной плоскостной

волны.

Параметр

определяется как

![]() с периодом

с периодом![]() =6,

7, 8, 9 пикселей. Этот диапазон изменений

позволяет охватить типичные частоты

хребтов, встречающиеся в отпечатках

пальцев человека;

=6,

7, 8, 9 пикселей. Этот диапазон изменений

позволяет охватить типичные частоты

хребтов, встречающиеся в отпечатках

пальцев человека;

После построения шаблона линий, он обрезается по выбранной форме отпечатка.

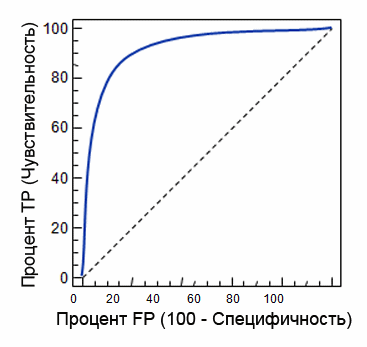

Roc-анализ

Пусть имеется два класса: с положительным исходом и с отрицательным исходом. ROC-кривая показывает зависимость количества верно классифицированных положительных примеров от количества неверно классифицированных отрицательных примеров. В терминологии ROC-анализа первые называются истинно положительным, вторые – ложно отрицательным множеством. При этом предполагается, что у классификатора имеется некоторый параметр, варьируя который, мы будем получать то или иное разбиение на два класса. Этот параметр часто называют порогом, или точкой отсечения (cut-off value). В зависимости от него будут получаться различные величины ошибок I и II рода. Для понимания сути ошибок I и II рода рассмотрим таблицу 1.

Таблица 1. Ошибки первого и второго рода.

|

|

Фактически | |

|

Модель |

Положительно |

Отрицательно |

|

Положительно |

TP |

FP |

|

Отрицательно |

FN |

TN |

TP (True Positives) – верно классифицированные положительные примеры (так называемые истинно положительные случаи);

TN (True Negatives) – верно классифицированные отрицательные примеры (истинно отрицательные случаи);

FN (False Negatives) – положительные примеры, классифицированные как отрицательные (ошибка I рода). Это так называемый "ложный пропуск" – когда интересующее нас событие ошибочно не обнаруживается (ложно отрицательные примеры);

FP (False Positives) – отрицательные примеры, классифицированные как положительные (ошибка II рода); Это ложное обнаружение, т.к. при отсутствии события ошибочно выносится решение о его присутствии (ложно положительные случаи).

Для нашей задачи положительным исходом будет класс гребней (черные пиксели в для изображения), отрицательным исходом – класс впадин (белые пиксели).

При анализе чаще оперируют не абсолютными показателями, а относительными – долями, выраженными в процентах:

Доля истинно положительных примеров:

![]() .

.

Доля ложно положительных примеров:

![]() .

.

Введем еще два определения: чувствительность и специфичность модели. Ими определяется объективная ценность любого бинарного классификатора.

Чувствительность – это и есть доля истинно положительных случаев:

![]() ,

,

Специфичность – доля истинно отрицательных случаев, которые были правильно идентифицированы моделью:

![]() ,

,

Заметим,

что

![]() .

.

Модель с высокой чувствительностью часто дает истинный результат при наличии положительного исхода (обнаруживает положительные примеры). Наоборот, модель с высокой специфичностью чаще дает истинный результат при наличии отрицательного исхода (обнаруживает отрицательные примеры). Если рассуждать в терминах нашей задачи:

Чувствительный тест характеризуется максимальным предотвращением пропуска гребня;

Специфичный тест диагностирует только истинные гребни. Это важно в случае, когда «гипердиагностика» не желательна.

ROC-кривая получается следующим образом:

1. Для каждого значения порога отсечения, которое меняется от 0 до 1 с шагом dx (например, 0.01) рассчитываются значения чувствительности Se и специфичности Sp. В качестве альтернативы порогом может являться каждое последующее значение примера в выборке.

2.

Строится график зависимости: по оси у

откладывается чувствительность Se,

по оси х

откладываем величину

![]() (сто процентов минус специфичность),

или, что то же самое, FPR – доля ложно

положительных случаев.

(сто процентов минус специфичность),

или, что то же самое, FPR – доля ложно

положительных случаев.

Рисунок 24. ROC-кривая

Для идеального классификатора график ROC-кривой проходит через верхний левый угол, где доля истинно положительных случаев составляет 100% или 1.0 (идеальная чувствительность), а доля ложно положительных примеров равна нулю. Поэтому чем ближе кривая к верхнему левому углу, тем выше предсказательная способность модели. Наоборот, чем меньше изгиб кривой и чем ближе она расположена к диагональной прямой, тем менее эффективна модель. Диагональная линия соответствует "бесполезному" классификатору, т.е. полной неразличимости двух классов.