- •Математичні методи

- •Мета застосування математичних методів у соціології: опис, пояснення та прогнозування соціальних процесів та явищ.

- •2. Логіка та основні етапи аналізу соціологічних даних.

- •3. Статистичні методи аналізу даних та задачі, що розв’язуються з їх застосуванням.

- •4. Вимірювання.

- •6. Шкала вимірювання, типи шкал.

- •Які математичні операції можна застосовувати до метричних ознак?

- •Які математичні перетворення можна застосовувати до порядкових ознак?

- •Які математичні операції можна застосовувати до номінальних ознак?

- •9. Характеристики форми розподілу.

- •10. Міри центральної тенденції та міри варіації.

- •11. Аналіз таблиць двомірного розподілу.

- •13. Обчислення коефіцієнту "хі-квадрат" Пірсона.

- •14. Коефіцієнти зв’язку, побудовані на основі "хі-квадрат".

- •18. Функціональний та кореляційних зв’язок.

- •19. Діаграма розсіяння.

- •20. Лінійний та нелінійних зв’язок.

- •21. Коефіцієнт кореляції Пірсона: правила обчислення та інтерпретації. Кореляційне відношення.

- •Як інтерпретуються коефіцієнти регресії в рівнянні лінійної регресії?

- •25. Лінійна парна регресія: побудова, запис та інтерпретація рівняння регресії. Множинна лінійна регресія, інтерпретація коефіцієнтів рівняння множинної лінійної регресії.

- •Запишіть загальний вигляд рівняння регресії.

- •Як інтерпретується коефіцієнт множинної кореляції?

- •Як інтерпретується коефіцієнт множинної кореляції?

- •27. Якість рівняння регресії, коефіцієнт детермінації.

- •Які Ви знаєте підходи до оцінювання якості рівняння регресії?

- •Як обчислюється і який зміст має коефіцієнт детермінації?

- •28. Класифікація статистичних мір за рівнем соціологічного вимірювання. Графічне представлення соціологічних даних: гістограма, полігон, огіва, кумулята. Графічне зображення даних

- •29. Діаграми: секторні, стовпчикові, рядкові.

- •30. Планування вибірки

- •31. Репрезентативність вибірки.

- •33. Обчислення обсягу вибірки за значенням припустимої похибки.

- •34. Проста випадкова вибірка

- •35. Багатоступенева вибірка.

- •37. Способи ремонту вибірки: відсікання, перезважування.

- •42. Поняття статистичної гіпотези.

- •43. Нульова та альтернативна гіпотези.

- •44. Помилки першого та другого роду.

- •45. Статистичні критерії.

- •46. Загальна процедура перевірки статистичних гіпотез.

- •47, 48, 49.Факторний аналіз. Застосування факторного аналізу в емпіричних соціологічних дослідженнях.

- •Задачи и условия факторного анализа

- •Процедура вращения. Выделение и интерпретация факторов

11. Аналіз таблиць двомірного розподілу.

Якім умовам повинна відповідати двовимірна таблиця для того, щоб можна було застосувати для її аналізу критерій Х2 ?

Він застосовується за таких умов:

- кількість об’єктів не менше ніж 100

- теоретичні частоти(очікувані) в кожні клітинці мають бути не меншими, ніж 5.

Як обчислюється число ступенів волі для двовимірної таблиці при оцінюванні значущості коефіцієнту 2 ?

Распределение χ2 (хи-квадрат) с n степенями свободы — это распределение суммы квадратов n независимых стандартных нормальных случайных величин.

Пусть

![]() —

совместно независимые стандартные

нормальные случайные величины, то есть:

—

совместно независимые стандартные

нормальные случайные величины, то есть:

![]() .

Тогда случайная величина

.

Тогда случайная величина

![]()

имеет распределение хи-квадрат с n степенями свободы, обозначаемое χ2(n).

12. Поняття статистичного зв’язку.

13. Обчислення коефіцієнту "хі-квадрат" Пірсона.

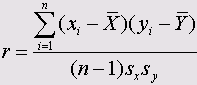

Коэффициент корреляции Пирсона

Данный коэффициент вычисляется по следующей формуле:

где xi и уi значения двух переменных, х- и у- их средние значения, a sx и sy их стандартные отклонения; n количество пар значений.

Пірсон:

Від -1 до 1. Додатнє значення – позитивний звьязок, відьємне – негативний. (зворотній). Позначається як R. Якщо воно = 0, нема лінійного звьязку. Якщо 1 – прямий функціональний. -1 – зворотній функціональний.

14. Коефіцієнти зв’язку, побудовані на основі "хі-квадрат".

Статистик говорит о корреляции между двумя переменными и указывает силу связи при помощи некоторого критерия взаимосвязи, который получил название коэффициента корреляции. Этот коэффициент, всегда обозначаемый латинской буквой R, может принимать значения между -1 и +1, причём если значение находится ближе к 1, то это означает наличие сильной связи, а если ближе к 0, то слабой.

Если коэффициент корреляции отрицательный, это означает наличие противоположной связи: чем выше значение одной переменной, тем ниже значение другой. Сила связи характеризуется также и абсолютной величиной коэффициента корреляции. Для словесного описания величины коэффициента корреляции используются следуюшие градации:

Значение

Интерпретация

до 0,2 Очень слабая корреляция

до 0,5 Слабая корреляция

до 0,7 Средняя корреляция

до 0,9 Высокая корреляция

свыше 0,9 Очень высокая корреляция

Метод вычисления коэффициента корреляции зависит от вида шкалы, к которой относятся переменные.

Переменные с интервальной и с номинальной шкалой: коэффициент корреляции Пирсона (корреляция моментов произведений).

По меньшей мере, одна из двух переменных имеет порядковую шкалу либо не является нормально распределённой: ранговая корреляция по Спирмену или т (тау) Кендала.

Одна из двух переменных является дихотомической: точечная двухрядная корреляция. Эта возможность в SPSS отсутствует. Вместо этого может быть применён расчёт ранговой корреляции.

Обе переменные являются дихотомическими: четырёхполевая корреляция. Данный вид корреляции рассчитываются в SPSS на основании определения мер расстояния и мер сходства.

Расчёт коэффициента корреляции между двумя недихотомическими переменными не лишён смысла только тогда, кода связь между ними линейна (однонаправлена).

К. Пірсона, або Х2 показує міру відхилення реальної таблиці від гіпотетичної

Х2 характеризує лише ступінь щільності зв’язку, а не його характер.

Може приймати позитивні значення і є МІРОЮ ВІДМІННОСТІ побудованої на емпіричних даних двовимірної таблиці частот від гіпотетичної. (гіпотетична – це така, яка мала б бути за умови, що дві змінні є статистично незалежними).

=== Зв’язок означає відмінність від статистичної незалежності.

=== Х2 перевіряє статистичну гіпотезу про відмінність двох таблиць.

Відкинути гіпотезу про відсутність відмінності емпіричної і гіпотетичної таблиц3і означає, прийняти рішення про наявність зв’язку між двома змінними.

Приклад:

АГА! БАЧИМО, ЩО пірсон х2 = 31.851, а сигнификанс допустимий(нижче0.05) Це означає, що є дуууже велика вірогідність сказати що змінні не є стат. Незалежними. А раз ми помилимось, коли так скажемо, то між ними є ЗВЬЯЗОК,

Ще мона дивитись на гутмана, крамера – тіж показники, але зі своїми забобонами…

15. Коефіцієнти асоціації та контингенції для таблиць 2*2.

16. Таблиці двовимірних та багатовимірних розподілів.

17. Стандартизація розподілу.