- •Теоретичні з викладками

- •3. Спільна ентропія двох джерел (а та b) дискретних залежних повідомлень та надати її аналіз.

- •4. Взаємна інформація двох джерел (а та b) дискретних залежних повідомлень. Основні властивості.

- •Схемні з викладками

- •2 Навести структурну або функціональну схему кодера та декодера ікм. Пояснити принцип роботи.

- •Задачі з викладками

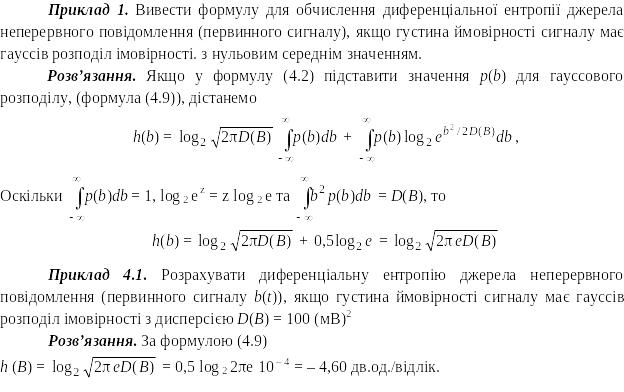

- •Привести інформаційні характеристики джерел неперервних повідомлень.

- •Вивести формулу епсилон-ентропії джерела неперервних повідомлень, якщо густина ймовірності джерела має гауссів розподіл та надати її аналіз.4

- •13.Пропускна здатність каналу з абгш. Надати її аналіз.

- •Пропускна здатність каналу дск. Надати її аналіз.

- •Пояснити принцип дії цифрових систем з передбаченням.

- •Теоретичні

- •16. Пояснити принцип кодування за методом дікм.

- •17. Як визначається інтервал дискретизації або частота дискретизації при кодуванні аналогових сигналів методом дікм?

- •18. Від чого залежить довжина коду при дікм?

- •19. Як визначається швидкість цифрового сигналу при кодуванні за методом дікм?

- •15. Обчислити пропускну здатність гауссового каналу із заданою смугою пропускання Fк, яким передається сигнал із потужністю Рs при спектральній густині потужності шуму в ньому n0.

- •Теоретичні з викладками

- •Задачі з викладками

Задачі з викладками

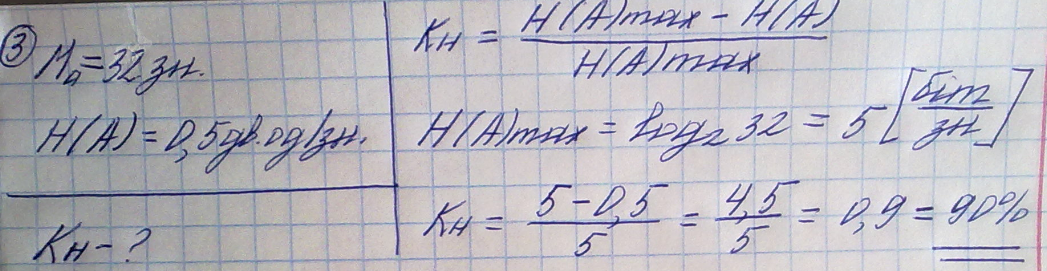

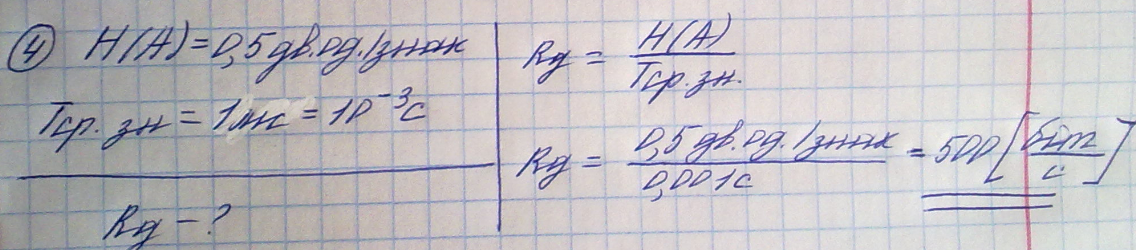

3. Джерело дискретних повідомлень видає повідомлення, використовуючи МА = 32 знаків. Ентропія джерела – 0,5 дв.од./знак. Обчислити коефіцієнт надмірності джерела.

Обчислити продуктивність джерела дискретних повідомлень, якщо його ентропія Н(A) = 0,5 дв.од./знак; середня тривалість знака – 1 мс.

Привести інформаційні характеристики джерел неперервних повідомлень.

Інформаційні характеристики джерел неперервних повідомлень: кількість інформації, диференціальна ентропія та її властивості, епсилон-ентропія та її властивості, надмірність, епсилон-продуктивність джерела. Для неперервного джерела епсилон-ентропія Hε(A), дв.од./відлік, обчислюється за формулою:

Hε(A) = h(A) – h(ε),

де h(А), диференціальна ентропія джерела дв.од./відлік (біт/відлік)

h (ε)

– диференціальна ентропія похибки

ε(tk) з густиною ймовірності

p(ε). Якщо p(ε) має гауссовий

розподіл імовірностей, то епсилон-ентропія

Hε(A) буде мати мінімальне

значення.

Диференціальна ентропія

неперервних джерел h(A)

обчислюється за формулою:

(ε)

– диференціальна ентропія похибки

ε(tk) з густиною ймовірності

p(ε). Якщо p(ε) має гауссовий

розподіл імовірностей, то епсилон-ентропія

Hε(A) буде мати мінімальне

значення.

Диференціальна ентропія

неперервних джерел h(A)

обчислюється за формулою:

Надмірність (надлишковість) джерела обчислюється:

Продуктивність неперервного джерела обчислюється за епсилон-ентропією:

R д = FдH (А)

R д = H (А)/Тд

де Fд – частота дискретизації .

Вивести формулу епсилон-ентропії джерела неперервних повідомлень, якщо густина ймовірності джерела має гауссів розподіл та надати її аналіз.4

Для неперервного джерела епсилон-ентропія Hε(A), дв.од./відлік, обчислюється за формулою:

Hε(A) = h(A) – h(ε),

Схема

Навести структурну або функціональну схему кодера та декодера ДМ. Пояснити принцип роботи цього пристрою.

Робота декодера ДМ зводиться до обчислення відліків передбачуваного сигналу.

На основі опису роботи кодера й декодера ДМ можна сформулювати особливості методів передавання із ДМ:

частота дискретизації дискретизатора fд у кілька разів більша за 2Fmax;

оскільки квантувач дворівневий, то n = 1, і R ц = fд;

оскільки n = 1, то відпадає необхідність синхронізації декодера.

При адаптивній дельта-модуляції (АДМ) може змінюватися крок квантування. Виконується це в такий спосіб. На виході кодера вмикається аналізатор послідовності двійкових символів. Якщо зустрілася послідовність 111 або 000, то крок квантування збільшується, щоб зменшити спотворення від перевантаження за нахилом. Якщо зустрілася послідовність 101 або 010, то крок квантування зменшується, щоб зменшити спотворення від шумів дроблення. Аналогічний аналізатор вмикається на вході декодера й у такий же спосіб змінюється крок квантування в декодері.

Задачі

Два джерела повідомлень A і B мають ентропії: Н(A), Н(A/B), Н(B), Н(B/A). Обчислити спільну ентропію цих двох джерел.

Спільна ентропія – середня кількість інформації, яку переносять повідомлення джерел A та B з врахуванням статистичної залежності між ними.

Спільна ентропія об’єднаного ансамблю AB двох джерел повідомлень A та B, визначається:

Нсп (AB) = Н(A) + Нум (B/A) =

= Н(B) + Нум (A/B) [дв.од./пов. (біт/пов.)]

Імовірності повідомлень ансамблю такі: Р(A); Р(B); Р(C); Р(D); Р(E); Р(F). Побудувати оптимальний нерівномірний двійковий код Хаффмена. Обчислити коефіцієнт стиснення повідомлень при використанні отриманого коду.

Приклад. Для заданого ансамблю повідомлення побудувати двійковий код Хафмана.

Розв'язок. Побудуємо дерево кодування для заданого ансамблю

Результати кодування

µ=

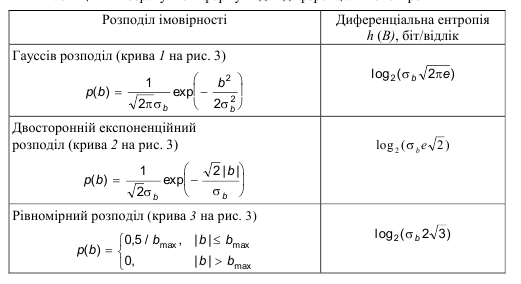

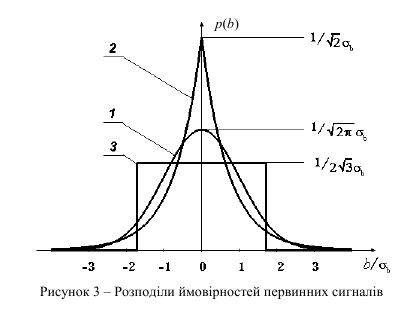

7.Вивести формулу епсилон-ентропії джерела неперервних повідомлень, якщо густина ймовірності джерела має двосторонній експоненційний розподіл, та надати її аналіз.

8.Вивести формулу епсилон-ентропії джерела неперервних повідомлень, якщо джерело має рівномірну густину ймовірності, та надати її аналіз.

епсилон - ентропія джерела HE(B) – мінімальна кількість інформації, що знаходиться в повідомленні В(t) ( прийнятому повідомленні ) відносно B(t) (переданому повідомленню) , при якому вони ще еквівалентні.

1)Епсилон-ентропія розраховується за формулою:

![]()

![]() (3.1)

(3.1)

h(B)-диференційна

ентропія

![]() -

умовна ентропія.

-

умовна ентропія.

Диференціальна

ентропія залежить від виду розподілу

імовірності P(b) та дисперсії сигналу

![]() .

Так, як за умовою задано гаусів розподіл,

то

.

Так, як за умовою задано гаусів розподіл,

то

![]() біт/відлік

(3.2)

біт/відлік

(3.2)

Так як

середнє значення первинного сигналу

дорівнює нулю, то

![]() .

Так як помилка відтворення на виході

системи передачі є гаусовою, то умовну

ентропію знайдемо за формулою :

.

Так як помилка відтворення на виході

системи передачі є гаусовою, то умовну

ентропію знайдемо за формулою :

![]() (3.3)

(3.3)

4.Навести структурну або функціональну схему кодера та декодера ДІКМ. Пояснити принцип роботи цього пристрою

4 Методи ДІКМ. Вони відносяться до методів передавання із завбаченням. При цифрових методах передавання частота дискретизації (1) вибирається з умови відсутності накладення складових спектра дискретного сигналу. При цьому відліки реальних аналогових сигналів є корельованими. Це дозволяє з тією чи іншою точністю завбачувати значення чергового відліку сигналу за його попередніми відліками. Ця можливість покладена в основу схем кодера і декодера ДІКМ, що наведені на рис. 4. Завбачники у кодері і декодері цілком ідентичні. Вони обчислюють похибку завбачення

d(kTд) = b(kTд)

–

,

(7)

,

(7)

де

– завбачений відлік, сформований

завбачником на основі N попередніх

відліків

.

У різних варіантах використання методу

ДІКМ число N знаходиться в межах від

1 до 6. Завбачник при N 2

виконується за схемою нерекурсивного

фільтра. У випадку N = 1 завбаченим

відліком

є попередній відлік

.

У різних варіантах використання методу

ДІКМ число N знаходиться в межах від

1 до 6. Завбачник при N 2

виконується за схемою нерекурсивного

фільтра. У випадку N = 1 завбаченим

відліком

є попередній відлік

.

.

У кодері похибка завбачення надходить на квантувач, аналогічний квантувачу ІКМ, а потім квантована похибка dкв(kTд) передається цифровим сигналом каналом зв’язку (на рис. 4 не показані кодер для представлення dкв(kTд) двійковим кодом і декодер для відновлення dкв(kTд) – вони включені до складу каналу зв’язку).

Похибка квантування при ДІКМ

кв(kTд)

=

– b(kTд)

= [

+ dкв(kTд)]

– [

+ d(kTд)]

= dкв(kTд)

– d(kTд),

(8)

– b(kTд)

= [

+ dкв(kTд)]

– [

+ d(kTд)]

= dкв(kTд)

– d(kTд),

(8)

визначатися тільки похибкою, внесеною квантувачем.

Розмах дискретного сигналу d(kTд) менший, ніж розмах сигналу b(kTд), тому число рівнів квантування L при незмінному кроці квантування буде меншим, ніж при ІКМ, а, отже, менше довжина коду n і швидкість цифрового сигналу R.

7.Імовірності повідомлень ансамблю такі: Р(A); Р(B); Р(C); Р(D); Р(E); Р(F). Побудувати оптимальний нерівномірний двійковий код Шеннона-Фано. Обчислити коефіцієнт стиснення повідомлень при використанні отриманого коду.

8.Довжину коду рівномірної ІКМ зменшили (збільшили) на один розряд. Визначити, як при цьому зміниться відношення сигнал/шум квантування.

8.У кодері, що входить до складу кодера ІКМ (рис. 2), числа i(kTд) представляються заданим двійковим кодом. Довжина коду

n = log2L.

а відношення сигнал/шум квантування

де KА – коефіцієнт амплітуди аналогового сигналу.

при збільшені або зменшені довжини коду на один розряд відбудуться прямопрпорційні зміни у відношенні сигнал-шум, так як де KА постійна велечина(константа)

7.Алгоритм стиснення за кодом Шеннона –Фано

1.Упорядкування (за убуванням)

2.Розділення на дві групи з рівними ймовірностями

3.Кодування груп

4.Циклічне продовження п2.п3

5.Код знака виписують зліва на право включаючи всі символи груп до ких належить знак коф.стиснення η=n/n

μ=3/2.35=1.28