- •1 Направления искусственного интеллекта и понятие иис – 2 ч. [1; 2; 9]

- •1.1 Основные направления искусственного интеллекта и их характеристика. (Гаврилова)

- •1.1.1 Основные направления искусственного интеллекта и их характеристика. (Андрейчикова)

- •1.2 Состояние работ в области экспертных систем и направлениям искусственного интеллекта. (Попов)

- •1.3 Понятие интеллектуальной информационной системы (иис). (Андрейчикова)

- •1.5 Классификация иис. (Андрейчикова)

- •2 Понятие экспертных систем. – 2 ч. [1; 2; 3; 9]

- •2.1 2.2 2.3 Экспертные системы (эс). Назначение экспертных систем. Формальные основы экспертных систем. (Попов)

- •Назначение экспертных систем

- •Формальные основы экспертных систем

- •3 Архитектура экспертных систем и этапы разработки - 2 ч. [2; 8; 9]

- •3.3 Этапы разработки экспертных систем. (Попов)

- •5 Методы и модели представления знаний. (Попов)

- •5.1 Формальная логическая модель представления знаний. (Попов)

- •5.2. Семантическая модель представления знаний. (Попов)

- •5.3 Фреймовая модель представления знаний. (Попов)

- •5.4 Продукционная модель представления знаний. (Попов)

- •5.6 Модель представления знаний: “прецеденты”.

- •5.5 Модель доски объявлений для представления знаний.

- •5.7 Гибридные модели представления знаний

- •6 Методы поиска решений в эс

- •7 Понятие и определение нечетких знаний – 2 ч. [3; 14]

- •7.1 Нечеткие знания

- •7.2 Понятие лингвистической переменной, определение ее значения

- •7.3 Понятие нечеткого множества

- •7.4 Определение нечеткого множества (через базовую шкалу и функцию принадлежности)

- •7.5 Понятие функции принадлежности

- •7.6 Операции с нечеткими знаниями

- •8 Стратегии получения знаний - 2 ч. [3]

- •8.1 Извлечение знаний из данных, приобретение знаний, формирование знаний. Теоретические аспекты извлечения знаний.

- •Теоретические аспекты извлечения знаний

- •Психологический аспект извлечения знаний

- •Лингвистический аспект извлечения знаний

- •Гносеологический аспект извлечения знаний

- •Теоретические аспекты структурирования знаний

- •Историческая справка

- •Иерархический подход

- •Традиционные методологии структурирования

- •Объектно-структурный подход (осп)

- •9 Проектирование экспертных систем - 2ч. [1; 3]

- •9.1 Этапы проектирования экспертной системы: идентификация, концептуализация, формализация, реализация, тестирование, опытная эксплуатация.

- •9.4 Технология проектирования и разработки промышленных эс.

- •9.5 Характеристика этапов разработки эс.

- •9.6 Технология быстрого прототипирования эс.

- •9.7 Характеристика стадий разработки прототипа эс.

- •10 Понятие нейроинформатики, история развития

- •Задача обучения нейронной сети на примерах.

- •12.1 Интерфейс вывода нейросетевого блока

- •12.2 Интерпретатор нейросетевого блока

- •12.3 Блок «Учитель» нейроимитатора

- •12.4 Блок «Оценка»

- •4.3.8. Конструктор нейронной сети

- •12.7 Блок «Констрастер»

- •4.3.9. Контрастер нейронной сети

- •42. Схема работы интеллектуального компонента прогнозирования временных рядов показателей.

- •44. Персептрон Розенблатта.

- •46.Карта самоорганизации Кохонена.

- •45 Многослойный перцептрон и его обучение

Задача обучения нейронной сети на примерах.

По своей организации и функциональному назначению искусственная нейронная сеть с несколькими входами и выходами выполняет некоторое преобразование входных стимулов - сенсорной информации о внешнем мире - в выходные управляющие сигналы. Число преобразуемых стимулов равно n - числу входов сети, а число выходных сигналов соответствуе числу выходов m. Совокупность всевозможных входных векторов размерности n образует1 векторное пространство X, которое мы будем называть признаковым пространством. Аналогично, выходные вектора также формируют признаковое пространство, которое будет обозначаться Y. Теперь нейронную сеть можно мыслить, как некоторую многомерную функцию F:X®Y, аргумент которой принадлежит признаковому пространству входов, а значение - выходному признаковому пространству.

При произвольном значении синаптических весовых коэффициентов нейронов сети функция, реализуемая сетью также произвольна. Для получения требуемой функции необходим специфический выбор весов. Упорядоченная совокупность всех весовых коэффициентов всех нейронов может быть представлена, как вектор W. Множество всех таких векторов также формирует векторное пространство, называемое пространством состояний или конфигурационным (фазовым2) пространством W. Задание вектора в конфигурационном пространстве полностью определяет все синаптические веса и, тем самым, состояние сети. Состояние, при котором нейронная сеть выполняет требуемую функцию, называют обученным состоянием сети W*. Отметим, что для заданной функции обученное состояние может не существовать или быть не единственным. Задача обучения теперь формально эквивалентна построению процесса перехода в конфигурационном пространстве от некоторого произвольного состояния w0 к обученному состоянию.

Требуемая функция однозначнно описывается путем задания соотвествия каждому вектору признакового пространства X некоторого вектора из пространства Y. В случае сети из одного нейрона в задаче детектирования границы, рассмотренной в конце третьей лекции, полное описание требуемой функции достигается заданием всего четырех пар векторов. Однако в общем случае, как например, при работе с видеоизображением, признаковые пространства могут иметь высокую размерность, поэтому даже в случае булевых векторов однозначное определение функции становится весьма громоздким3. Во многих практических случаях значения требуемых функций для заданных значений аргумента получаются из эксперимента или наблюдений, и, следовательно, известны лишь для ограниченной совокупности векторов. Кроме того, известные значения функции могут содержать погрешности, а отдельные данные могут даже частично противоречить друг другу. По этим причинам перед нейронной сетью обычно ставится задача приближенного представления функции по имеющимся примерам. Имеющиеся в распоряжении исследователя примеры соответствий между векторами, либо специально отобранные из всех примеров наиболее представительные данные называют обучающей выборкой. Обучающая выборка определяется обычно заданием пар векторов, причем в каждой паре один вектор соотвествует стимулу, а второй - требуемой реакции. Обучение нейронной сети состоит в приведении всех векторов стимулов из обучающей выборки требуемым реакциям путем выбора весовых коэффициентов нейронов.

Общая проблема кибернетики, заключающаяся в построении искусственной системы с заданным функциональным поведением, в контексте нейроных сетей понимается, как задача синтеза требуемой искусственной сети. Она может включать в себя следующие подзадачи: 1) выбор существенных для решаемой задачи признаков и формирование признаковых пространств; 2) выбор или разработка архитектуры нейронной сети, адекватной решаемой задаче; 3) получение обучаюшей выборки из наиболее представительных, по мнению эксперта, векторов признаковых пространств; 4) обучение нейронной сети на обучающей выборке.

Отметим, что подзадачи 1)-3) во многом требуют экспертного опыта работы с нейронными сетями, и здесь нет исчерпывающих формальных рекомендаций. Эти вопросы рассматриваются на протяжении всей книги в применении к различным нейросетевым архитектурам, с иллюстрациями особенностей их обучения и применения.

Основные достоинства и недостатки нейронных сетей по сравнению с обычными экспертными системами.

Важно отметить различие в характере неявных “знаний”, запомненных искусственной нейронной сетью, и явных, формальных “знаний”, заложенных в экспертных системах. Некоторые сходства и различия представлены в следующей таблице.

|

Экспертные системы (ЭС) |

Нейросетевые системы (НС) |

Источник знаний |

Формализованный опыт эксперта, выраженный в виде логических утверждений - правил и фактов, безусловно принимаемых системой |

Совокупный опыт эксперта-учителя, отбирающего примеры для обучения + индивидуальный опыт обучающейся на этих примерах нейронной сети |

Характер знаний |

Формально-логическое “левополушарное” знание в виде правил |

Ассоциативное “правополушарное” знание в виде связей между нейронами сети |

Развитие знаний |

В форме расширения совокупности правил и фактов (базы знаний) |

В форме дообучения на дополнительной последовательности примеров, с уточнением границ категорий и формированием новых категорий |

Роль эксперта |

Задает на основе правил полный объем знаний экспертной системы |

Отбирает характерные примеры, не формулируя специально обоснование своего выбора |

Роль искусственной системы |

Поиск цепочки фактов и правил для доказательства суждения |

Формирование индивидуального опыта в форме категорий, получаемых на основе примеров и категоризация образов |

Различия в характере экспертных и нейросетевых ситем обуславливают и различия в их сферах применения. Экспертные системы применяются в узких предметных областях с хорошо структурированными знаниями, наример в классификации неисправностей конкретного типа оборудования, фармокологии, анализе химсостава проб и т.д. Нейронные сети применяютмся кроме перечисленных областей и в задачах с плохо структурированной информацией, например при распознавании образов, рукописного текста, анализе речи и т.д.

11 Модели и схемотехника нейронных сетей -2 ч. [4; 7; 10]

11.1 Биологический и формальный нейрон.

Элементом клеточной структуры мозга является нервная клетка - нейрон. Нейрон выполняет прием, элементарное преобразование и дальнейшую передачу информации другим нейронам. Информация переносится в виде импульсов нервной активности, имеющих электрохимическую природу.

Рис. 3.1.Общая схема строения биологического нейрона.

Нейроны крайне

разнообразны по форме, которая зависит

от их местонахождения в нервной системе

и особенностей фунционирования. Тело

клетки содержит множество ветвящихся

отростков двух типов. Отростки первого

типа, называемые дендритами, служат в

качестве входных каналов для нервных

импульсов от других нейронов. Эти

импульсы поступают в тело клетки, вызывая

ее специфическое возбуждение, которое

затем распространяется по выводному

о тростку

второго типа - аксону.

тростку

второго типа - аксону.

Возбуждение нейрона в виде спайка передается другим нейронам, которые таким образом объединены в проводящую нервные импульсы сеть. Участки мембраны на аксоне, где размещаются области контакта аксона данного нейрона с дендритами другими нейронов, называются синапсами. В области синапса, имеющего сложное строение, происходит обмен информацией о возбуждении между нейронами. Синапсы влияют на силу импульса. Механизмы синаптической передачи достаточно сложны и разнообразны. Они могут иметь химическую и электрическую природу. В химическом синапсе в передаче импульсов участвуют специфические химические вещества - нейромедиаторы, вызывающие изменения проницаемости локального участка мембраны. В зависимости от типа вырабатываемого медиатора синапс может обладать возбуждающим (эффективно проводящим возбуждение) или тормозящим действием. Обычно на всех отростках одного нейрона вырабатывается один и тот же медиатор, и поэтому нейрон в целом функционально является тормозящим или возбуждающим. Это важное наблюдение о наличии нейронов различных типов в последующих главах будет существенно использоваться при проектировании искусственных систем. РИС

из лекции:

общее число нейронов в цент нерв с-ме 1010 – 1011. При этом каждый нейрон связан в среднем с 1000-10000 др. нейронами.

При прохождении синапса сила импульса меняется в опр. число раз – вес синапса. Импульсы, поступившие к нейрону одновременно по неск. дендритам суммируются. Если суммарный импульс превышает некот порог, нейрон возбуждается, формирует составной импульс и передает его далее по аксону. Веса синапсов м. изм-ся во времени, след. во времени мен-ся и поведение нейрона.

Формальный нейрон.

Исторически первой работой, заложившей теоретический фундамент для создания искусственных моделей нейронов и нейронных сетей, принято считать опубликованную в 1943 г. статью Уоррена С.Мак-каллока и Вальтера Питтса "Логическое исчислени идей, относящихся к нервной активности". Главный принцип теории Маккалока и Питтса заключается в том, что произвольные явления, относящиеся к высшей нервной деятельности, могут быть проанализированы и поняты, как некоторая активность в сети, состоящей из логических элементов, принимающих только два состояния ("все или ничего"). При этом для всякого логического выражения, удовлетворяющего указанным авторами условиям, может быть найдена сеть логических элементов, имеющая описываемое этим выражением поведение.

.4.1. Функциональная схема формального нейрона Маккалока и Пиитса

В качестве модели такого логического элемента, получившего в дальнейшем название "формальный нейрон", была предложена схема, приведенная на Рис. 4.1.

С современной точки зрения, формальный нейрон представляет собой математическую модель простого процессора, имеющего несколько входов и один выход. Вектор входных сигналов (поступающих через "дендриды") преобразуется нейроном в выходной сигнал (распространяющийся по "аксону") с использованием трех функциональных блоков: локальной памяти, блока суммирования и блока нелинейного преобразования.

Вектор локальной памяти содержит информацию о весовых множителях, с которыми входные сигналы будут интерпретироваться нейроном. Эти переменные веса являются аналогом чувствительности пластических синаптических контактов. Выбором весов достигается та или иная интегральная функция нейрона.

В блоке суммирования происходит накопление общего входного сигнала (обычно обозначаемого символом net), равного взвешенной сумме входов:

![]()

Фомальные нейроны могут быть объединены в сети путем замыкания выходов одних нейронов на входы других. Типы нелинейных переходных функций:

1) Пороговая функция (рассмотренная Маккалоком и Питтсом):

В модели Маккалока и Питтса отсутствуют временные задержки входных сигналов, поэтому значение net определяет полное внешненее возбуждение, воспринятое нейроном. Отклик нейрон далее описывается по принципу "все или ничего", т. е. переменная подвергается нелинейному пороговому преобразованию, при котором выход (состояние активации нейрона) Y устанавливается равным единице, если net>Q, и Y=0 в обратном случае. Значение порога Q (часто полагаемое равным нулю) также хранится в локальной памяти.

![]() -

значение порога

-

значение порога

2) Линейная функция, а также ее вариант - линейная функция с погашением отрицательных сигналов:

![]()

3) Сигмоидальная функция:

![]()

Как указывалось С.Гроссбергом, сигмоидальная функция обладает избирательной чувствительностью к сигналам разной интенсивности, что соответсвует биологическим данным. Наибольшая чувствительность наблюдается вблизи порога, где малые изменения сигнала net приводят к ощутимым изменениям выхода. Напротив, к вариациям сигнала в областях значительно выше или ниже порогового уровня сигмоидальная функция не чувствительна, так как ее производная при больших и малых аргументах стремится к нулю.

В последнее время также рассматриваются математические модели формальных нейронов, учитывающие нелинейные корреляции между входами. Для нейронов Маккалока и Питтса предложены электротехнические аналоги, позволяющие проводить прямое аппаратное моделирование.

11.4 Понятие схемотехники нейронных сетей. Элементы формального нейрона и их обозначение.

Для описания алгоритмов и устройств в нейроинформатике выработана специальная "схемотехника", в которой элементарные устройства – сумматоры, синапсы, нейроны и т.п. объединяются в сети, предназначенные для решения задач

Самый заслуженный и, вероятно, наиболее важный элемент нейросистем – это адаптивный сумматор. Адаптивный сумматор вычисляет скалярное произведение вектора входного сигнала x на вектор параметров . На схемах будем обозначать его так, как показано на рис. 1. Адаптивным называем его из-за наличия вектора настраиваемых параметров . Для многих задач полезно иметь линейную неоднородную функцию выходных сигналов. Ее вычисление также можно представить с помощью адаптивного сумматора, имеющего n+1 вход и получающего на 0-й вход постоянный единичный сигнал 0 и на выходе => 0+(х, ) – неоднородный адаптивный сумматор.

Нелинейный преобразователь сигнала изображен на рис. 3. Он получает скалярный входной сигнал x и переводит его в (x)= х/(k+|х|), где k- хар-ка, определяющая крутизну нелин-го преобраз-я.

Т

очка

ветвления служит для рассылки одного

сигнала по нескольким адресам (рис. 4).

Она получает скалярный входной сигнал

x и передает его всем своим выходам.

очка

ветвления служит для рассылки одного

сигнала по нескольким адресам (рис. 4).

Она получает скалярный входной сигнал

x и передает его всем своим выходам.

Р ис.

1. Адаптивный сумматор. Рис. 3. Нелин-й

преобраз-тель

ис.

1. Адаптивный сумматор. Рис. 3. Нелин-й

преобраз-тель

Рис. 4. Точка ветвления

с игнала.

игнала.

Рис. 6. Линейная связь (синапс) Рис. 5. Формальный нейрон

Стандартный формальный нейрон составлен из входного сумматора, нелинейного преобразователя и точки ветвления на выходе (рис. 5).

Линейная связь ‑ синапс – отдельно от сумматоров не встречается, однако для некоторых рассуждений бывает удобно выделить этот элемент (рис. 6). Он умножает входной сигнал x на "вес синапса" a.

Веса синапсов сети образуют набор адаптивных параметров, настраивая которые, нейронная сеть обучается решению задачи. Обычно на диапазон изменения весов синапсов накладываются некоторые ограничения, например, принадлежности веса синапса диапазону [-1,1].

11.5 Типы нейронных сетей и их обозначение.

Сеть- связанные м-у собой нейроны. Искусственная нейронная сеть – некот-е выч-е электр-е устр-ва обработки информации, состоящие из большого числа параллельно работиющих простых процессорных элементов – нейронов, связанных м/у собой линиями передачи информации – связями или синапсами.

Среди всего множества нейросетевых архитектур можно выделить две базовых архитектуры – слоистые и полносвязные сети.

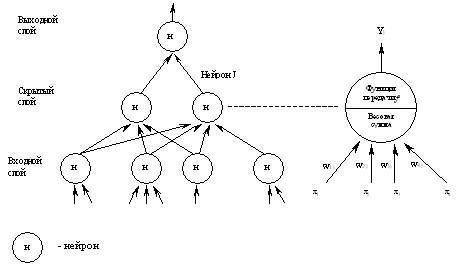

Рис. 7. Слоистая сеть

Слоистые сети: нейроны расположены в несколько слоев (рис. 7). Нейроны первого слоя получают входные сигналы, преобразуют их и через точки ветвления передают нейронам второго слоя. Далее срабатывает второй слой и т.д. до k-го слоя, который выдает выходные сигналы. Если не оговорено противное, то каждый выходной сигнал i-го слоя подается на вход всех нейронов i+1-го. Число нейронов в каждом слое может быть любым и никак заранее не связано с количеством нейронов в других слоях. Стандартный способ подачи входных сигналов: каждый нейрон первого слоя получает все входные сигналы. Особое распространение получили трехслойные сети, в которых каждый слой имеет свое наименование: первый – входной, второй – скрытый, третий – выходной.

Полносвязные сети: имеют один слой нейронов; каждый нейрон передает свой выходной сигнал остальным нейронам, включая самого себя. Выходными сигналами сети могут быть все или некоторые выходные сигналы нейронов после нескольких тактов функционирования сети. Все входные сигналы подаются всем нейронам.

Элементы слоистых и полносвязных сетей могут выбираться по-разному. Существует, впрочем, стандартный выбор – нейрон с адаптивным неоднородным линейным сумматором на входе (рис. 5).

Далее в работе будут рассматриваться только слоистые нейронные сети как наиболее оптимальные (по архитектуре) для решения задачи производства знаний из данных.

НС представляет собой модель, прототипом которой является биологическая нейронная сеть. Сегодняшние нейронные вычисления используют очень ограниченное множество понятий биологических нейронных сетей (см. табл.5.2.).

Таблица 5.2.

Некоторые аналогии и отношения между биологическими и искусственными нейронными сетями.

-

Биологические

Искусственные

Сома

Дендриты

Аксон

Синапс

Много нейронов (109)

Узел

Вход

Выход

Вес

Немного нейронов (от десятка до сотни тысяч)

Понятия используются для осуществления программной имитации массированных параллельных процессов, которые включают обрабатывающие элементы (также называемые искусственными нейронами), взаимосвязанными в архитектуру нейронной сети. Искусственный нейрон получает входные сигналы, являющиеся аналогами электрохимических импульсов, которые дендриты биологических нейронов получают от других нейронов.

Входные сигналы искусственного нейрона соответствуют сигналам, посылаемым от биологического нейрона через его аксон. Эти искусственные сигналы могут быть изменены таким же образом, как физические изменения происходят в синапсах.

Важно признать, что ИНС были первоначально предложены как способ моделирования деятельности человеческого мозга. Человеческий мозг имеет намного большую сложность, чем модель может выразить. Несмотря на обширные исследования в нейробиологии и физиологии, остаются важные вопросы о том, как работают мозг и разум человека. Это только одна причина, почему нейронные вычислительные модели не очень сходны с реальными биологическими системами. Тем не менее, исследования и разработки в области ИНС производят интересные и полезные системы, которые заимствуют некоторые черты.

Архитектура нейронной сети.

ИНС состоит из искусственных нейронов (или обрабатывающих элементов), организованных различными путями для формирования структуры сети.

На рис.5.9. представлена схема трех взаимосвязанных искусственных нейронов.

Каждый из нейронов получает входные сигналы, обрабатывает их и выдает простой выходной сигнал. Этот процесс показан на рис.5.10. Входным сигналом могут быть необработанные данные или выходные сигналы других нейронов. Выходной сигнал может быть конечным результатом или он может быть входным сигналом другого нейрона.

Рис.5.9. Три взаимосвязанных искусственных нейрона

Рис.5.10. Обработка информации в искусственном нейроне

Каждая ИНС состоит из набора нейронов, которые сгруппированы по слоям. Типичная структура ИНС показана на рис.5.11. Здесь представлены три слоя: входной, промежуточный (называемый скрытым слоем) и выходной. Между входным и выходным слоями может быть размещено несколько скрытых слоев.

Рис.5.11. Нейронная сеть с одним скрытым слоем

Как и биологические нейронные сети, ИНС могут быть организованы несколькими различными способами (топологическими или архитектурными), т.е. нейроны могут быть взаимосвязаны различными способами. Поэтому ИНС проявляются в различных конфигурациях.

При обработке информации, многие обрабатывающие элементы выполняют свои вычисления одновременно. Эта параллельная обработка имеет сходство с тем, как работает мозг, и отличается от последовательной обработки при традиционных вычислениях.

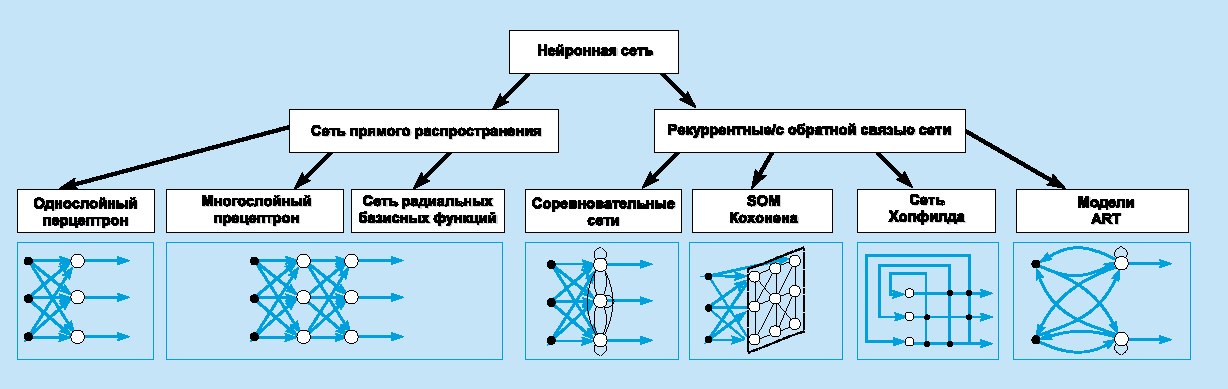

И НС

может рассматриваться как направленный

граф со взвешенными связями, в котором

искусственные нейроны являются узлами.

По архитектуре связей ИНС могут быть

сгруппированы в два класса (рис. 5.12):

сети прямого распространения, в которых

графы не имеют петель, и рекуррентные

сети, или сети с обратными связями.

НС

может рассматриваться как направленный

граф со взвешенными связями, в котором

искусственные нейроны являются узлами.

По архитектуре связей ИНС могут быть

сгруппированы в два класса (рис. 5.12):

сети прямого распространения, в которых

графы не имеют петель, и рекуррентные

сети, или сети с обратными связями.

Рис. 5.12 Систематизация архитектур сетей прямого распространения и рекуррентных (с обратной связью).

В наиболее распространенном семействе сетей первого класса, называемых многослойным перцептроном, нейроны расположены слоями и имеют однонаправленные связи между слоями. На рис. 5.12 представлены типовые сети каждого класса. Сети прямого распространения являются статическими в том смысле, что на заданный вход они вырабатывают одну совокупность выходных значений, не зависящих от предыдущего состояния сети. Рекуррентные сети являются динамическими, так как в силу обратных связей в них модифицируются входы нейронов, что приводит к изменению состояния сети.

11.6 Понятие логически прозрачных нейронных сетей.

Одним из основных недостатков нейронных сетей, с точки зрения многих пользователей, является то, что из обученной нейронной сети нельзя извлечь алгоритм решения задачи. Таким образом, нейронные сети позволяют получать неявные знания из данных. Однако, в 1995 году была сформулирована идея логически прозрачных сетей, то есть сетей, на основе структуры которых можно построить вербальное описание алгоритма получения ответа [42,111]. Это достигается при помощи специальным образом построенной процедуры контрастирования. Алгоритмы формирования логически прозрачных сетей представлены в работах [42,111,113]. После получения логически прозрачной нейронной сети наступает этап построения вербального описания (формирования явных знаний). Принцип построения вербального описания представлен в работе [111].

Сеть называется логически прозрачной, если на основе ее структуры можно построить вербальное описание алгоритма получения ответа.

Для получения ЛП НС используются 2 основных этапа:

1) Контрастирование НС – сведение ее связей до минимума для данных 2)Вербальное описание (формирование явных знаний).

12 Состав и структура нейросетевого интеллектуального блока - 2 ч. [5; 7]

Интерпретатор – преобразует выборку в тот вид, который понимает пользователь

Учитель – настраивает коэф-ты a1…a3, используя методы оптимизации

Оценка – блок определения ошибки сети

Конструктор – формирует структуру, начиная с минимальной до достаточной сложности, обеспечивающей требуемые параметры обучения

Контрастер – сводит число связей до минимально необходимого, но обеспечивающего заданную точность или оценку

Задачник – формирует выборки

П редобработчик

– фильтрует данные

редобработчик

– фильтрует данные

Интерфейс вывода – выдает информацию пользователю

Рис –структура нейросетевого блока