- •Оглавление

- •1. Асоціативне неконтрольоване навчання

- •3. Зміст звіту по практичній роботі

- •Варіанти завдань

- •Аудиторна робота

- •Результат роботи:

- •2. Конкурентні нейронні мережі («Шар і мапа Кохонена»)

- •3. Зміст звіту по практичній роботі

- •Варіанти завдань: кластеризація даних

- •Аудиторна робота

- •1 % Self Organizing Feature Maps sofm (Kohonen networks)

- •3. Конкурентні нейронні мережі («Бінарний класифікатор сигналів екг на основі lvq»)

- •3. Зміст звіту по практичній роботі

- •Варіанти завдань

- •Аудиторна робота

- •1. %Learning Vector Quantization

- •Література

- •4. Нейронні мережі Гросберга

- •Аудиторна робота

- •1. Leaky integrator

- •2. Shunting network demonstration

- •3. Перший та другий шари мережі Grossberg

- •4. Налаштування ваги

- •Art-1 мережі розпізнавання зображень ()

- •3. Зміст звіту по практичній роботі

- •Варіанти завдань: класифікація зображень

- •Аудиторна робота

- •Листинг программы (matlab)

- •Результаты работы программы

- •Мережa Хопфiлда як асоціативна пам'ять ()

- •Варіанти завдань

- •Аудиторна робота

- •7.Рбф-мережа (робота № 5)

- •Варіанти завдань

- •Подбор параметров радиальной функции для каждого радиального нейрона (центр delta и параметр ширины b)

- •Подбор параметров радиальной функции для каждого радиального нейрона (центр с и параметр ширины b)

- •Ортогонализация по методу наименьших квадратов:

- •Работа первого и второго слоев:

- •Адаптация нелинейных параметров радиальных функций всех нейронов первого слоя сети:

- •8.Мережа з використанням га

Оглавление

Оглавление 2

1. Асоціативне неконтрольоване навчання 3

Варіанти завдань 3

Аудиторна робота 5

2. Конкурентні нейронні мережі («Шар і мапа Кохонена») 20

Варіанти завдань: кластеризація даних 23

Аудиторна робота 23

3. Конкурентні нейронні мережі («Бінарний класифікатор сигналів ЕКГ на основі LVQ») 30

Варіанти завдань 31

Аудиторна робота 31

4. Нейронні мережі Гросберга 37

Аудиторна робота 37

4.ART-1 мережі розпізнавання зображень () 43

Варіанти завдань: класифікація зображень 44

Аудиторна робота 44

5.Мережa Хопфiлда як асоціативна пам'ять () 54

Варіанти завдань 54

Аудиторна робота 54

7. РБФ-мережа (робота № 5) 61

Варіанти завдань 61

8. Мережа з використанням ГА 70

Варіанти завдань: 70

Аудиторна робота 70

9. ANFIS-адаптована система нейро-нечіткого виведення 71

Варіанти завдань: задача екстраполяції даних на основі апроксимації відображення вхід-вихід 71

Аудиторна робота 71

1. Асоціативне неконтрольоване навчання

Мета роботи: ознайомитися з принципами функціонування одношарових мереж INSTAR і OUTSTAR, можливостями INSTAR щодо розв’язання задачі розпізнавання образів. Об’єкт дослідження: асоціативна мережа на основі неконтрольованого правила навчання.

Теми для опрацювання

1. Асоціативна мережа на основі неконтрольованого правила навчання.

Постановка задачі (згідно з індивідуальним завданням):

1. Класифікація векторів асоціатором у вигляді одношарових мереж INSTAR.

Порядок виконання роботи

1. Вивчити теоретичний матеріал.

2. Послідовно виконати такі завдання до практичної роботи:

А. Розв’язати задічу.

Б. В середовищі системи MatLab cпроектувати відповідну одношарову нейронну мережу INSTAR, визначивши її параметри.

3. Зміст звіту по практичній роботі

1. Назва і мета роботи.

2. Постановка задачі (завдання).

3. Приклад розв’язання завдання.

Задачі для самостійного розв’язання з теми 1

Варіанти завдань

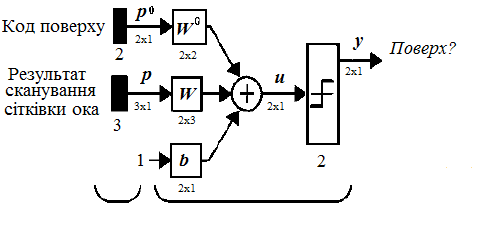

Мережу було встановлено на підйомник (рис. 1.1), який використовують три працівники.

Рис. 1.1.

Мережа

для підйомника:

![]()

Підйомник

має кнопки,

марковані

відповідно від «1»

до «4»

для чотириповерхового

будинку

з подвальним

поверхом.

Коли

працівник

входить

до

підйомника

на подвальному

поверсі,

система

сканує

сітківку

його ока та визначає,

яка

людина

ввійшла.

Далі

мережа обирає номер поверха,

на який

цей працівник найчастіше

піднімається

(має доступ).

Перший

вхід

мережі p0

вказує

номер

поверха,

якщо

було

натиснуто

кнопку:

![]() –

перший поверх,

–

перший поверх,

![]() –

другий поверх,

–

другий поверх,

![]() –

третій поверх,

–

третій поверх,

![]() –

четвертий поверх,

–

четвертий поверх,

![]() –

жодна з кнопок не натиснута. Вхідному

вектору р0

відповідають вагова матриця та вектор

зсуву

–

жодна з кнопок не натиснута. Вхідному

вектору р0

відповідають вагова матриця та вектор

зсуву

![]() .

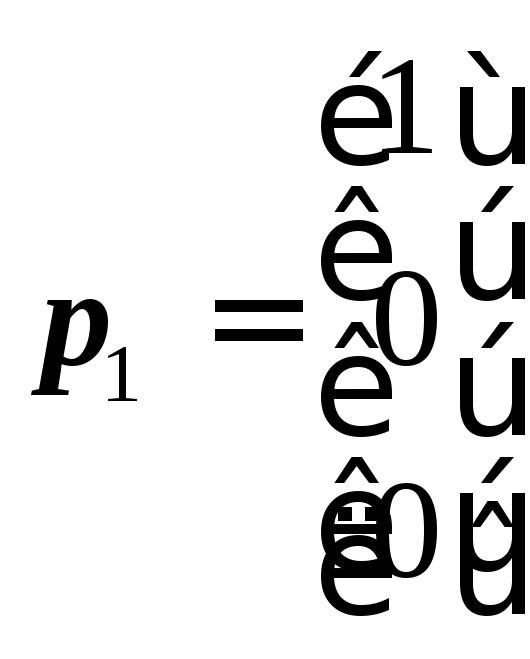

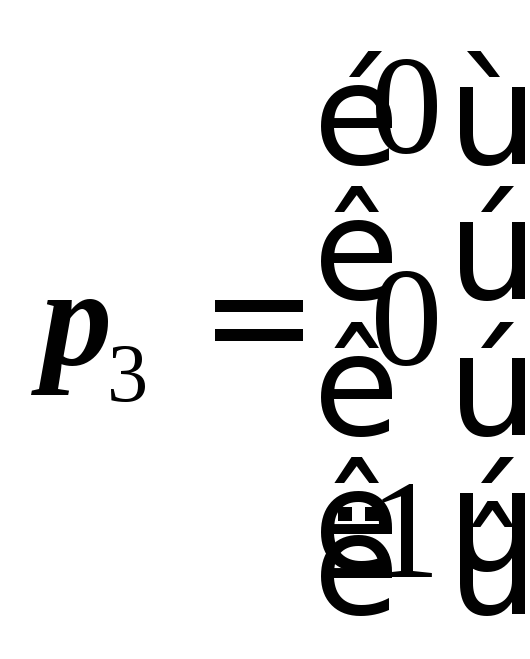

Другий вхід зображує трьох працівників

компанії:

.

Другий вхід зображує трьох працівників

компанії: –

1-й

працівник;

–

1-й

працівник;

–

2-й

працівник;

–

2-й

працівник; –

3-й працівник. Мережа вчиться

визначати

поверхи, яким надають перевагу працівники,

змінюючи

вагову

матрицю

за правилом

Інстар

з коефіцієнтом

навчання

a = 0,6.

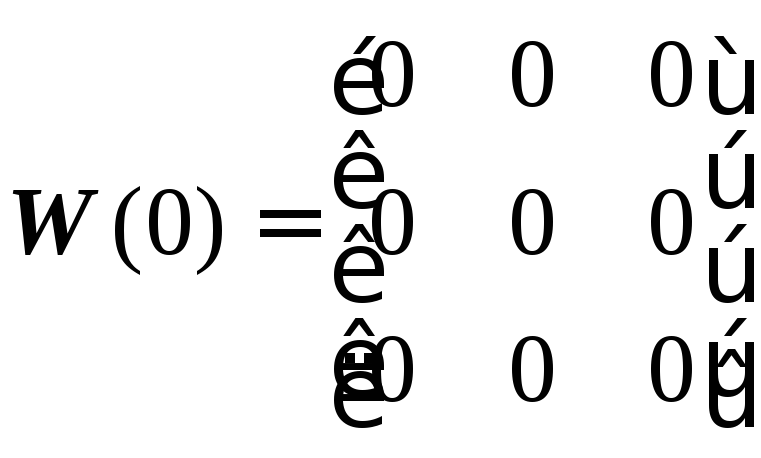

Початкове значення вагової матриці

–

3-й працівник. Мережа вчиться

визначати

поверхи, яким надають перевагу працівники,

змінюючи

вагову

матрицю

за правилом

Інстар

з коефіцієнтом

навчання

a = 0,6.

Початкове значення вагової матриці

.

.

І.

Використовуючи систему MatLab,

змоделювати мережу для такої

послідовності навчання:

![]() ,

,![]() ,

,![]() ,

,![]() ,

,![]() ,

,![]() (1-й працівник натиснув кнопку «4», 2-й–

кнопку «3», 3-й –

кнопку «1», 2-й –

кнопку «3», 3-й –

кнопку «2», 1-й –

кнопку «4»). Визначити кінцеве значення

вагової матриці.

(1-й працівник натиснув кнопку «4», 2-й–

кнопку «3», 3-й –

кнопку «1», 2-й –

кнопку «3», 3-й –

кнопку «2», 1-й –

кнопку «4»). Визначити кінцеве значення

вагової матриці.

ІІ. Продовжити моделювання мережі для таких випадків: 1-й працівник не натиснув кнопки, 2-й – не натиснув кнопки, 3-й – не натиснув кнопки.

ІІІ. Визначити:

1) який поверх вибрала мережа для кожного з працівників;

2) яким буде вигляд вагової матриці після багаторазового натискання працівниками таких кнопок: 1-й натиснув кнопку «3», 2-й – кнопку «2», 3-й – кнопку «4».

A.Розглянемо мережу Інстардля розпізнавання

образів:

![]() .

Послідовність навчання для заданої

мережі

.

Послідовність навчання для заданої

мережі

![]() ,

,![]() ,

,![]() ,

,![]() ,

,![]() ,

,![]() (1-й працівник натиснув кнопку «4», 2-й–

кнопку «3», 3-й –

кнопку «1», 2-й –

кнопку «3», 3-й –

кнопку «2», 1-й –

кнопку «4»). Визначити кінцеве значення

вагової матриці.

(1-й працівник натиснув кнопку «4», 2-й–

кнопку «3», 3-й –

кнопку «1», 2-й –

кнопку «3», 3-й –

кнопку «2», 1-й –

кнопку «4»). Визначити кінцеве значення

вагової матриці.

% Демонстрація роботи одношарової мережі Instar

clc; clear all;

trainSpeed = 0.6;

W0=[1 0 0; 0 1 0; 0 0 1];

W= [0 0 0;0 0 0; 0 0 0];

b= [-0.5; -0.5];

P=[1 0 0; 0 1 0; 0 0 1];

P0=[0 0; -1 -1; 1 -1; -1 1; 1 1];

P0=P0';

/* 4, 3, 1, 3, 2, 4

/* 1 2 3 2 3 1

% НАВЧАННЯ

for i=1:6

a=hardlim(W0*p0+W'*p+b);

a0=a;

W=W+trainSpeed*a*p;

if j==1

p0=1;j=2;

else

p0=0; j=1;

end;

end;