- •6.3. Синхронна мережа Гопфілда

- •6.4. Неперервна мережа Гопфілда

- •6.5. Асоціативна мережа вsв

- •7. Синергетичний комп’ютер

- •8. Мережа хеммінга

- •9. Динамічні рекурсивні шнм

- •9.1. Структура дрм

- •9.2. Неперервні дрм

- •9.3. Дискретна дрм

- •9.3.2. Частково-рекурсивні мережі

- •9.3.3. Локально-рекурсивні мережі прямого поширення

- •9.4. Навчання дрм

- •9.4.1. Алгоритм зворотного поширення помилки

- •9.4.2. Адаптивний алгоритм навчання

- •10. Мережа векторного квантування

- •10.1. Структура мережі векторного квантування

- •10.2. Неконтрольоване навчання мережі вк

- •10.3. Контрольоване навчання мережі вк

- •10.3.1. Lvq1

- •10.3.2. Lvq2.1

6.5. Асоціативна мережа вsв

На відміну від розглянутих вище статичних схем асоціативної пам’яті, ця мережа реалізує динамічну АП. Ця мережа, що є рекурсивною автоасоціативною пам’яттю, запропонована Дж. Ан- дерсоном й ін. [86]. Свою назву Brain-State-іn-а-Вох (BSB) вона отримала через те, що її стан обмежений гіперкубом [+1, -1] із центром на початку координат.

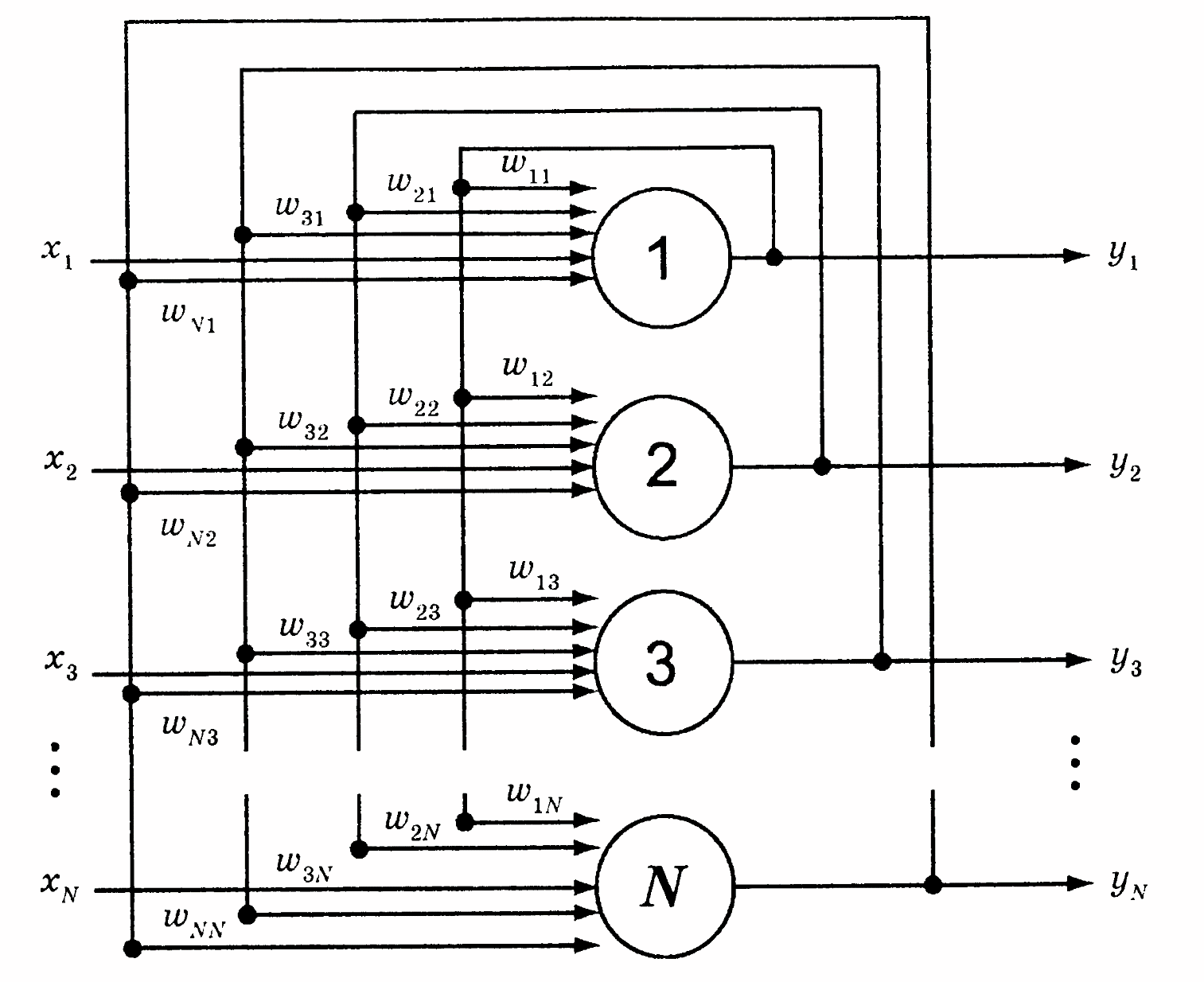

Структуру мережі В8В наведено на рис. 6.6.

Структура

й принцип роботи мережі ВЗВ аналогічні

структурі й принципу роботи мережі

Гопфілда. Як і мережа Гопфілда, ця мережа

є одношаровою. Основна відмінність у

тому, що в мережі ВЗВ допускається

наявність власних зворотних зв’язків

нейронів, тобто знімається обмеження ,

і крім того, можлива відсутність зв’язків

між окремими нейронами, тобто допускається

,

і крім того, можлива відсутність зв’язків

між окремими нейронами, тобто допускається .

.

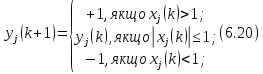

Як активаційні у мережі використовуються функції вигляду (2.8), тому у-й вихідний сигнал у момент часу (k + 1) визначається у такий спосіб:

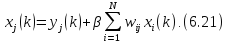

де

— j-й вхідний сигнал у момент часуk

— j-й вхідний сигнал у момент часуk

Тут

— мала додатна величина, що називається

параметром зворотного зв’язку.

— мала додатна величина, що називається

параметром зворотного зв’язку.

Наявність додатного зворотного зв’язку призводить до того, що подані на входи мережі сигнали підсилюються доти, поки всі нейрони не ввійдуть у насичення. Характерною рисою даної мережі є можливість роботи з аналоговими сигналами, які переводяться в бінарні форми.

У початковому стані мережа перебуває всередині одиничного гіперкуба, обмеженого вхідними біполярними сигналами. Динамічні властивості мережі забезпечує рекурсивна зміна її стану в напрямку ребер (граней) гіперкуба. Ці грані визначають атрак- тори нелінійної динамічної системи, що відповідають збереженим образам. Поява на вході мережі будь-якого сигналу призводить до того, що мережа з часом виявиться в одному з таких стійких станів, що визначає даний вхідний образ (сигнал) і що перебуває в деякій вершині гіперкуба.

Рис. 6.6. Структура мережі ВSВ

Для

навчання мережі використовується або

правило Гебба, або дельта-правило. Як

початкові значення ваг вибирають малі

випадкові величини .

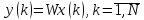

Метою навчання є знаходження матриці

синаптичних ваг W, що забезпечує існуванняN

стійких станів, таких, що

.

Метою навчання є знаходження матриці

синаптичних ваг W, що забезпечує існуванняN

стійких станів, таких, що

(6.22)

(6.22)

Для аналізу стійкості мережі В8В використовується той самий підхід, що й під час аналізу дискретної мережі Гопфілда. Локальні мінімуми енергетичної функції досягаються на грані гіперкуба й визначають стійкі стани мережі, що відповідають різним накопиченим образам.

ВSВ-модель, будучи асоціативною пам’яттю, вирішує по суті завдання кластеризації заданого масиву даних, оскільки вершини гіперкуба в процесі обробки інформації діють як точкові атрактори з вираженими областями притягання, які ділять N-вимірний простір ознак на відповідну множину добре визначених областей. Якщо центри-прототипи кластерів відомі заздалегідь, їх можна поєднати з вершинами гіперкуба, після чого В8В-модель може працювати взагалі без навчання тільки за рахунок автозбуждения, що викликається додатним зворотним зв’язком. При цьому пропоновані мережі образи автоматично «стягуватимуться» до найближчих вершин гіперкуба — центрів кластерів.

Контрольні запитання

Що являє собою модель Гопфілда? Яке значення має ця модель для подальшого розвитку ШНМ?

До чого призведе порушення обмеження на вибір елементів матриці ваг?

Поясніть суть алгоритму навчання мережі Гопфілда.

У чому особливості синхронної мережі Гопфілда?

Що являє собою неперервна мережа Гопфілда?

Що являє собою мережа ВSВ?

У чому відмінність мережі ВSВ від мережі Гопфілда?

Як відбувається навчання мережі ВSВ?