- •1. Определение информации.

- •2.Виды каналов передачи информации

- •18.Импульсные виды модуляции.

- •4.Фазы обращения информации.

- •6.Виды информации. Устранение избыточности информации.

- •5.Структура измерительной информационной системы

- •17.Комбинаторная мера.

- •3.Корреляционный метод фильтрации.

- •10.Демодуляция гармонических колебаний

- •7.Частотная фильтрация

- •9.Модуляция гармонических колебаний

- •8.Меры информации: структурные.

- •11.Статистические меры информации

- •12.Временное разделение каналов

- •13.Семантические меры информации

- •14.Временная фильтрация

- •15.Геометрическая мера

- •16.Квантование сигнала по времени.

- •19.Квантование сигналов по уровню.

- •20.Аддитивная мера Хартли.

- •21.Фильтрация сигналов.

- •22.Импульсные виды модуляции.

- •23. Вероятность и информация.

- •24.Частотное разделение каналов

- •25.Представление импульсных модулированных колебаний во временной и частотной областях

- •26.Энтропия, количество информации по Шеннону.

- •27.Амплитудная модуляция.

- •28.Сигналы и их характеристики.

- •Характеристики сигналов

- •29.Фазовое разделение каналов.

- •30.Виды модуляции: амплитудная балансная

- •31.Детерминированные колебания, их классификация.

- •32.Кодовое разделение каналов

- •33. Частотная модуляция

- •36.Корреляционное разделение каналов

- •34. Теорема Котельникова

- •35. Аналитическое описание периодических сигналов во временной и частотной областях

- •37. Фазовая модуляция

- •38. Аналитическое описание импульсных сигналов во временной и частотной областях.

- •41. Частотная фильтрация.

- •43 . Базисные функции.

- •45. Демодуляция чм гармонических колебаний

- •54) Корреляционная функция

- •48. Случайные величины и процессы

- •49. Частотно-импульсная модуляция. Спектр и полоса частот

- •51. Амплитудно-импульсная модуляция. Спектр и полоса частот

- •52) Передача информации

- •50. Эргодические процессы.

- •55) Широтно-импульсная модуляция. Спектр и полоса частот.

- •56) Угловые виды модуляции.

- •62. Спектр чим колебаний.

- •59. Аналитическое описание импульсных сигналов во временной и частотной областях.

- •57. Информационное содержание сигнала.

- •61. Способы повышения помехоустойчивости.

- •58. Спектры случайных колебаний.

16.Квантование сигнала по времени.

19.Квантование сигналов по уровню.

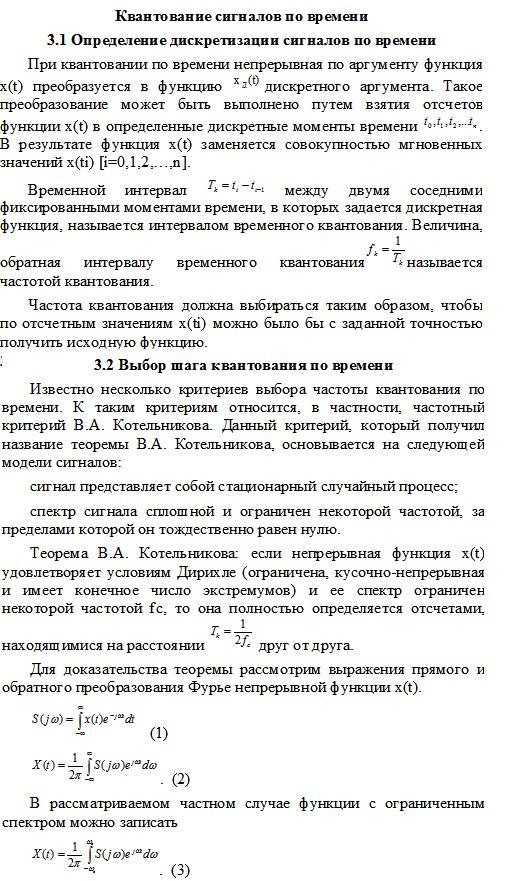

Квантование (англ. quantization) — в информатике разбиение диапазона значений непрерывной или дискретной величины на конечное число интервалов. Существует также векторное квантование — разбиение пространства возможных значений векторной величины на конечное число областей. Квантование часто используется при обработке сигналов, в том числе при сжатии звука и изображений. Простейшим видом квантования является деление целочисленного значения на натуральное число, называемое коэффициентом квантования.

Квантование по уровню состоит в преобразовании непрерывного множества значений сигнала x(t) в дискретное множество значений xk от ti.

Совместное применение операций дискретизации и квантования позволяет преоб-ть непрерывный сигнал x(t) в дискретный по координатам x и t → xk(ti).

Рассмотрим сущность понятия дискредитации применительно к детермированнной ф-ии. Дискредитация – реализация сигнала x(t) связана с заменой промежутка изменения независимой переменной некоторым множеством точек. x(t) – функция, описывающая сигнал; x(ti)–функция, описывающая сигнал, полученный в результате дискретизации, т.е. исходная функция x(t) заменяется совокупностью отдельных значений x(ti).

По значению x(ti) можно восстановить исходную функцию с некоторой погрешностью. Фун-я получ-ая в резул-те восстан-я наз-ся воспроизводящей: V(t).

20.Аддитивная мера Хартли.

Аддитивная мера

Эта мера предложена в 1928 году американским ученым Хартли, поэтому имеет второе название – мера Хартли. Хартли впервые ввел специальное обозначение для количества информации – I и предложил следующую логарифмическую зависимость между количеством информации и мощностью исходного алфавита:

I = l log h,

где I – количество информации, содержащейся в сообщении;

l – длина сообщения;

h – мощность исходного алфавита.

При исходном алфавите {0,1}; l = 1; h = 2 и основании логарифма, равном 2, имеем

I = 1*log22 = 1.

Данная формула даёт аналитическое определение бита (BIT - BInary digiT) по Хартли: это количество информации, которое содержится в двоичной цифре.

Единицей измерения информации в аддитивной мере является бит.

Пример 1. Рассчитать количество информации, которое содержится в шестнадцатеричном и двоичном представлении ASCII-кода для числа 1.

В соответствии с таблицей ASCII-кодов имеем: шестнадцатеричное представление числа 1 – 31, двоичное представление числа 1 – 00110001.

Тогда по формуле Хартли получаем:

для шестнадцатеричного представления I = 2log216 = 8 бит;

для двоичного представления I = 8 log22 = 8 бит.

Таким образом, разные представления ASCII-кода для одного символа содержат одинаковое количество информации, измеренной аддитивной мерой.

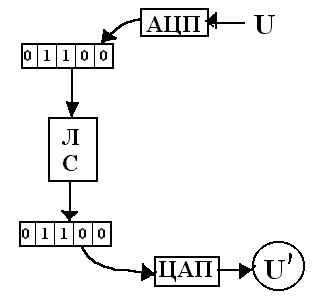

Аддитивная мера Хартли.

Глубина

h

числа

– количество элементов, знаков,

содержащихся в принятом алфавите.

Глубина числа соответствует основанию

системы счисления и кодирования.

В каждый данный момент реализуется только один знак из h возможных.

Длина l числа – количество повторений алфавита, необходимых и достаточных для представления чисел нужной величины. Длина числа соответствует разрядности системы счисления и кодирования.

При глубине h и длине l количество чисел выразится: Q=h l , т.е. емкость зависит экспоненциально от длины числа l.

Пример:

h=1 унарная система счисления. h=2двоичная система h=3…10

![]()

![]()

![]()

В следствии показательного закона зависимости Q от l, число Q не является удобной мерой для оценки информационной емкости, поэтому Хартли ввел аддитивную двоичную логарифмическую меру, позволяющую вычислять количество информации в двоичных единицах – битах. Для этого берется не само число Q, а его двоичный логарифм.

I = log2Q = log2h l = l×log2h,

где I – количество информации по Хартли.

Если длина числа l = 1 и принята двоичная система счисления, то

I=log221=1 (бит)

Это единица информации в принятой системе оценки. Она соответствует одному элементарному событию, кот. Может произойти (1) или нет (0). Аддитивная мера удобна тем, что она обеспечивает возможность сложения, а также пропорциональность количества информации длине числа l.