- •Ю.Н.Толстова

- •Isbn 5-89176-086-x10

- •Isbn 5-89176-086-x10 Содержание

- •Часть 1. Что такое анализ социологических данных? (методологический аспект)

- •Часть 2. Описательная статистика. Изучение связи между номинальными признаками

- •Введение

- •Часть 1. Что такое анализ данных? (Методологический аспект)

- •1. Поиск статистических закономерностей как основная цель, стоящая перед эмпирической социологией. Роль анализа данных в ее достижении

- •1.1. Эмпирическая основа для изучения социальных явлений

- •1.2. Понятие статистической закономерности. Роль статистических и нестатистических закономерностей в эмпирической социологии

- •1.3. Проблема соотнесения формального и содержательного при формировании представлений о закономерности в социологии

- •Формирование и операционализация понятий при анализе данных (на условном примере)*

- •1.4. Статистическая закономерность как результат "сжатия" исходных данных

- •1.5. Основные цели анализа данных

- •2. Математические методы как средство познания социальных явлений

- •2.1. Роль математизации научного знания

- •2.2. Априорная модель изучаемого явления. Эмпирическая и математическая системы.

- •2.3. Основные цели применения математических методов в социологии

- •3. Актуальность для социологии задач, решаемых математической статистикой

- •3.1. Основные задачи математической статистики с позиции потребностей социологии

- •3.2. Случайные величины и распределения вероятностей как основные объекты изучения математической статистики и эмпирической социологии

- •4. Математическая статистика и анализ данных: линия размежевания

- •4.1. Проблема соотношения выборки и генеральной совокупности.

- •4.2. Отсутствие строгих обоснований возможности применения конкретных методов математической статистики. Эвристичность многих алгоритмов анализа данных

- •4.3. Использование шкал низких типов

- •5. Специфика использования методов анализа данных в социологии

- •5.1. Необходимость соотнесения модели, "заложенной" в методе, с содержанием задачи

- •5.2. Связь разных этапов исследования друг с другом

- •5.3. Другие методологические принципы анализа социологических данных

- •Примечания к части I.

- •Часть 2. Описательная статистика. Измерение связи между номинальными признаками

- •1. Описательная статистика.

- •1.1. Одномерные частотные распределения.

- •1.1.1. Представление одномерной случайной величины в выборочном социологическом исследовании. Стоящие за ним модели

- •Пример таблицы сопряженности при наличии связи между признаками х и y

- •1.1.2. Проблема разбиения диапазона изменения признака на интервалы

- •1.1.3.Кумулята

- •1.1.4. Проблема пропущенных значений

- •1.2. Меры средней тенденции и отвечающие им модели

- •1.3. Меры разброса и отвечающие им модели

- •1.3.1. Необходимость введения мер разброса

- •1.3.2 Дисперсия. Квантильные размахи

- •1.3.3. Интуитивное представление о разбросе значений номинального признака.

- •1.3.4. Мера качественной вариации.

- •1.3.5. Определение энтропии. Ее “социологический” смысл. Энтропийный коэффициент разброса

- •2. Анализ связей между номинальными признаками

- •2.1. Анализ номинальных данных как одна из главных задач социолога

- •2.1.1. Роль номинальных данных в социологии

- •2.1.2. Соотношение между причинно-следственными отношениями и формальными методами их изучения

- •2.1.3. О понятии таблицы сопряженности.

- •Общий вид таблицы сопряженности

- •2.2. Классификация задач анализа связей номинальных признаков

- •2.2.1. Диалектика в понимании признака и его значений.

- •2.2. Классификация рассматриваемых задач и отвечающих им методов

- •2.2.3. Выделение двух основных групп методов анализа номинальных данных. Место рассматриваемых подходов в этой группировке

- •2.3. Анализ связей типа "признак-признак"

- •2.3.1. Коэффициенты связи, основанные на критерии "хи-квадрат"

- •2.3.1.1. Понимание отсутствия связи между признаками как их статистической независимости.

- •Пример таблицы сопряженности для двух независимых признаков

- •Второй пример таблицы сопряженности, частоты которой сравнительно мало отличаются от ситуации независимости признаков

- •2.3.1.2. Функция "Хи-квадрат" и проверка на ее основе гипотезы об отсутствии связи

- •2.3.1.3. Нормировка значений функции "Хи-квадрат”.

- •2.3.2. Коэффициенты связи, основанные на моделях прогноза

- •2.3.2.1. Выражение представлений о связи через прогноз

- •2.3.2.2. Коэффициенты, основанные на модальном прогнозе

- •Пример частотной таблицы, использованный для расчета коэффициента r

- •2.3.2.3. Общее представление о пропорциональном прогнозе

- •2.3.3. Коэффициенты связи, основанные на понятии энтропии

- •2.3.3.1. Условная и многомерная энтропия

- •2.3.3.2. Смысл энтропийных коэффициентов связи. Их формальное выражение

- •2.3.4. Коэффициенты связи для четырехклеточных таблиц сопряженности. Отношения преобладаний

- •2.3.5. Проблема сравнения коэффициентов связи

- •2.3.6. Учет фактической многомерности реальных связей. Многомерные отношения преобладаний

- •Актуальность многомерных связей в социологии.

- •Многомерные отношения преобладаний.

- •2.4. Связь типа "альтернатива-альтернатива"

- •2.4.1. Смысл локальной связи . Возможные подходы к ее изучению

- •2.4.2. Детерминационный анализ (да). Выход за пределы связей рассматриваемого типа

- •2.5. Анализ связей типа "группа альтернатив - группа альтернатив" и примыкающие к нему задачи

- •2.5.1. Классификация задач рассматриваемого типа

- •2.5.2. Анализ фрагментов таблицы сопряженности.

- •Разложение таблицы 20 на подтаблицы

- •Четырехклеточная таблица, получающаяся в результате деления диапазона изменения каждого признака на две части с помощью рассматриваемого алгоритма

- •2.5.3. Методы поиска сочетаний значений независимых признаков (предикторов), детерминирующих "поведение" респондентов

- •2.5.3.1. Понятие зависимой и независимых переменных. Общая постановка задачи.

- •2.5.3.2. Алгоритм thaid

- •2.5.3.3. Алгоритм chaid

- •2.5.4. Методы да, thaid, chaid с точки зрения поиска обобщенных взаимодействий

- •2.5.5. Поиск логических закономерностей: элементы исчисления высказываний; понятие закономерности; алгоритм поиска; его сравнение с да.

- •Элементы исчисления высказываний.

- •Логические закономерности, характеризующие заданный класс объектов.

- •Сравнение рассмотренного алгоритма с да.

- •2.5.6. Поиск логических закономерностей и теория измерений. Элементы узкого исчисления предикатов

- •Описание языка узкого исчисление предикатов

- •Интересующие социолога закономерности как формулы узкого исчисления предикатов

- •Вид искомых аксиом

- •2.6. Анализ связей типа "признак - группа признаков": номинальный регрессионный анализ (нра)

- •2.6.1. Общая постановка задачи

- •2.6.2. Повторение основных идей классического регрессионного анализа, рассчитанного на т. Н. "количественные" признаки

- •2.6.3. Дихотомизация номинальных данных. Обоснование допустимости применения к полученным дихотомическим данным любых "количественных" методов

- •2.6.4. Общий вид линейных регрессионных уравнений с номинальными переменными. Их интерпретация

- •2.6.5. Типы задач, решаемых с помощью нра. Краткие сведения о логит- и пробит- моделях регрессионного анализа

- •Приложения к части II Приложение I Разные способы расчета медианы и предполагаемые ими модели

- •Приложение 2 Схемы, иллюстрирующие предложенные в п. 2.2.2 и 2.2.3

- •Использованная в книге классификация рассмотренных методов анализа связей

- •Классификация рассмотренных методов на базе предположений о существовании латентных переменных.

- •Предметный указатель

- •Литература

1.3.5. Определение энтропии. Ее “социологический” смысл. Энтропийный коэффициент разброса

Понятие энтропии всем знакомо по философской, физической, научно-популярной, научно-фантастической литературе – рост энтропии приводит к тепловой смерти вселенной (напомним, что это утверждение связано с идеями статистической термодинамики) и т.д. Мы коснемся этого понятия в очень слабой степени, рассмотрев, как с его помощью характеризуется упомянутая мера неопределенности.

Известно, что степень неопределенности распределения некоторой случайной величины Y (точнее, меры той неопределенности, которую имеет исследователь в смысле знания значения Y для какого-либо случайно выбранного объекта), определяется с помощью энтропии этого распределения. Введем соответствующие определения.

Пусть случайная величина Y принимает конечное число значений 1,2, ..., k с вероятностями, равными, соответственно, Р 1, Р 2, ..., Рk. (Напомним, что вероятность какого-либо значения для выборки отождествляется с относительной частотой встречаемости этого значения). Введем обозначение:

Рj = P (Y = j)

Энтропией случайной величины Y (или соответствующего распределения; напомним, что случайная величина отождествляется с отвечающими ей распределением вероятностей) Y называется функция

![]() (основание

логарифма произвольно)

(основание

логарифма произвольно)

(Последняя формула обычно называется формулой Больцмана (Людвиг Больцман, 1844 - 1906 – австрийский физик, основатель статистической термодинамики). Именно формула, связывающая энтропию с термодинамической вероятностью, выгравирована на памятнике Больцману в Вене. Это соотношение дает статистическое обоснование второму началу термодинамики и является основой статистической физики.)

Чтобы лучше раскрыть смысл энтропии, представляется целесообразным пояснить, какого рода содержательные соображения о понятии неопределенности распределения могут навести на мысль об измерении этого понятия с помощью логарифма. Используем рассуждение из [Яглом, Яглом, 1969.С. 45].

Пусть некие независимые друг от друга признаки U и V принимают, соответственно, k и l равновероятностных значений. Рассмотрим, каким свойствам должна удовлетворять некая функция f, характеризующая неопределенность распределений рассматриваемых признаков. Ясно, что f = f (k) (т.е. рассматриваемая функция зависит от числа градаций того признака, неопределенность распределения которого она измеряет) и что f (1) = 0. Очевидно также, что при k l должно быть справедливо неравенство f (k) f (l). Число сочетаний значений рассматриваемых признаков равно произведению kl. Естественно полагать, что степень неопределенности двумерного распределения, f (kl) должна быть равна сумме неопределенностей соответствующих одномерных распределений, т.е. f (k l) = f (k) + f (l). Можно показать, что логарифмическая функция является единственной функцией аргумента k, удовлетворяющей условиям: f (k l) = f (k) + f (l), f (1) =0, f(k) f (l) при k l .)

Функция H (Y) и служит мерой неопределенности распределения Y.

(представляется очевидным, почему основание логарифма произвольно; как известно из школьной математики, от одного основания можно легко перейти к другому; все интересующие нас формулы при этом будут отличаться только на некоторый постоянный множитель, что несущественно для их интерпретации).

Чтобы лучше понять смысл энтропии, вникнем в смысл двух следующих ее свойств.

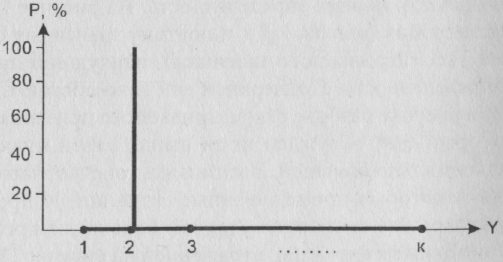

1) H (Y) 0. Равенство достигается тогда, когда Y принимает только одно значение. Это – ситуация максимальной определенности: случайным образом выбрав объект, мы точно можем сказать, что для него рассматриваемый признак принимает упомянутое значение. Распределение Y выглядит следующим образом:

Рис. 12. Пример распределения с нулевой энтропией

Единственная отличная от нуля вероятность здесь равна 1. Нетрудно проверить, что для такого распределения энтропия действительно равна нулю.

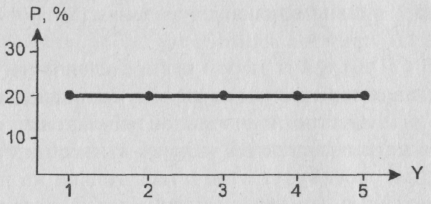

2) При фиксированном “k” значение энтропии максимально, когда все возможные значения Y равновероятны. Это – ситуация максимальной неопределенности. Предположим, например, что k=5. Тогда распределение Y для такой ситуации будет выглядеть следующим образом:

Рис. 13. Пример распределения с максимальной энтропией при заданном числе градаций признака

Ясно, что здесь Pj = 0,2. Нетрудно проверить, что значение энтропии при этом равно log 5, а в общем случае в ситуации полной неопределенности энтропия равна log k. Таким образом, чем больше градаций имеет рассматриваемый признак, тем в принципе большей энтропии может достичь отвечающее ему распределение.

Итак, на рис. 12 – минимальная (нулевая) энтропия, наилучший прогноз, полная определенность. На рис.13 – максимальная энтропия (равная log k и поэтому зависящая от числа градаций рассматриваемого признака), наихудший прогноз, полная неопределенность. Подчеркнем еще и то обстоятельство, что на первом рисунке разброс рассматриваемого признака (в том смысле, который был обсужден нами выше) равен нулю, а на втором – максимально большой. В жизни же, конечно, чаще всего встречаются некоторые промежуточные ситуации. И представляется очевидным, что энтропия будет тем больше, чем реальное распределение ближе к ситуации, отраженной на рис. 13, и тем меньше, чем оно ближе к ситуации, отраженной на рис. 12.

Поэтому будем считать интуитивно ясным тот факт, что энтропия может использоваться при оценке степени разброса значений номинального признака. Однако мы уже упоминали, что максимальное значение энтропии для распределения какого-либо признака зависит от числа его градаций. Следуя той же логике, что была использована нами выше, нетрудно придти к выводу, что сама энтропия, в силу сказанного, не может выступать в качестве меры разброса. Чтобы такое использование было правомерным, значение энтропии необходимо нормировать – поделить на величину максимальной энтропии. Так обычно и поступают: в качестве меры разброса используют энтропийный коэффициент

![]()

Подробнее об этом см. работу [Паниотто, Максименко, 1982].

В заключение параграфа отметим, что в том направлении науки, которое связано с моделированем социальных процессов, понятие энтропии занимает существенное место. Причины этого нетрудно понять. Скажем, известно, что общества слишком однородные, либо слишком разнородные не является устойчивымы. А однородность может оцениваться как раз с помощью энтропии. Правда, для того, чтобы энтропия могла “работать на прогноз”, необходимо решить серьезные содержательные вопросы и, в первую очередь, определить – для каких признаков энтропию надо измерять.