- •1.Назначение эс

- •Важность эс состоит в следующем

- •К неформальным задачам относятся такие, кот обладают одной или неск хар-ми:

- •Особенности неформальных задач

- •Формальные основы эс (хрень, но вдруг пригодится)

- •2.Архитектура эс

- •3.Этапы разработки эс

- •Требования

- •Технология разработки эс

- •4.Основные направления исскуственного интелекта

- •5. Состояние работ в области экспертных систем и направлениям искусственного интеллекта.

- •Состояние работ в области экспертных систем

- •Состояние работ по новым напр-ям искусственного интеллекта

- •6.Клас-ция эс

- •7. Клас-ция инструм-ных ср-в

- •8. Характеристики типов задач

- •9. Представление знаний в эс

- •10.Состав и организачия знаний в эс Круг задач решаемых при представлении знаний включает след положения

- •11.Модели представления знаний

- •12.Логическая модель предст-я зн-й

- •Осн. Понятия логики предикатов

- •13.Семантические сети

- •14.Фреймы

- •15.Правила продукции

- •16.Модель доски объявлений

- •17.Модель прецедентов

- •18.Методы поиска решений в эс

- •19.Стратегии поиска решений в эс

- •20.Эвристические методы поиска в эс

- •21. Понятие нейроинформатики, история развития

- •22. Биологический и формальный нейрон.

- •23.Элементы нейронных сетей их обозначение

- •24. Типы нейронных сетей их обозначение

- •25 Основные достоинства и недостатки нс по сравнению с эс

- •26. Состав и структура нейросетевого интеллектуального блока

- •28. Интерпретатор нейросетевого блока

- •29 Блок «Учитель» нейроимитатора

- •30 Блок «Оценка»

- •34. Задачник нейросетевого блока

- •40. Понятие логически прозрачных нейронных систем.

- •1) Контрастирование нс – сведение ее связей до минимума для данных 2)Вербальное описание (формирование явных знаний).

- •Метод дифференциального обучения Хэбба

- •Теорема об обучении персептрона.

- •45 Многослойный перцептрон и его обучение

- •Обучение методом обратного распространения ошибок.

- •Формула1.

- •Формула 2

- •Формула 3

- •46.Карта самоорганизации Кохонена.

- •47. Гибридные модели представления знаний

23.Элементы нейронных сетей их обозначение

Для описания алгоритмов и устройств в нейроинформатике выработана специальная "схемотехника", в которой элементарные устройства – сумматоры, синапсы, нейроны и т.п. объединяются в сети, предназначенные для решения задач

Самый заслуженный и, вероятно, наиболее важный элемент нейросистем – это адаптивный сумматор. Адаптивный сумматор вычисляет скалярное произведение вектора входного сигнала x на вектор параметров . Адаптивным называем его из-за наличия вектора настраиваемых параметров .. (рис1)

Нелинейный преобразователь сигнала изображен на рис. 3. Он получает скалярный входной сигнал x и переводит его в (x)= х/(k+|х|), где k- хар-ка, определяющая крутизну нелин-го преобраз-я.

Точка ветвления служит для рассылки одного сигнала по нескольким адресам (рис. 4). Она получает скалярный входной сигнал x и передает его всем своим выходам.

![]()

![]()

Рис. 1. Адаптивный сумматор. Рис. 3. Нелин-й преобраз-тель

![]()

Рис. 4. Точка ветвления

сигнала.

![]()

Рис. 6. Линейная связь (синапс) Рис. 5. Формальный нейрон

Стандартный формальный нейрон составлен из входного сумматора, нелинейного преобразователя и точки ветвления на выходе (рис. 5).

Линейная связь ‑ синапс – отдельно от сумматоров не встречается, однако для некоторых рассуждений бывает удобно выделить этот элемент (рис. 6). Он умножает входной сигнал x на "вес синапса" a.

Веса синапсов сети образуют набор адаптивных параметров, настраивая которые, нейронная сеть обучается решению задачи. Обычно на диапазон изменения весов синапсов накладываются некоторые ограничения, например, принадлежности веса синапса диапазону [-1,1].

24. Типы нейронных сетей их обозначение

Сеть- связанные м-у собой нейроны. Искусственная нейронная сеть – некот-е выч-е электр-е устр-ва обработки информации, состоящие из большого числа параллельно работиющих простых процессорных элементов – нейронов, связанных м/у собой линиями передачи информации – связями или синапсами.

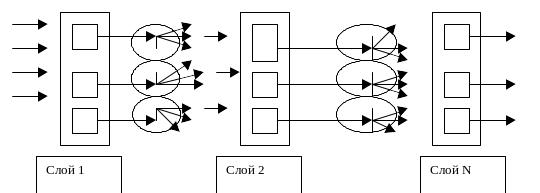

Среди всего множества нейросетевых архитектур можно выделить две базовых архитектуры – слоистые и полносвязные сети.

Рис. 7. Слоистая сеть

Слоистые сети: нейроны расположены в несколько слоев (рис. 7). Нейроны первого слоя получают входные сигналы, преобразуют их и через точки ветвления передают нейронам второго слоя. Далее срабатывает второй слой и т.д. до k-го слоя, который выдает выходные сигналы. Если не оговорено противное, то каждый выходной сигнал i-го слоя подается на вход всех нейронов i+1-го. Число нейронов в каждом слое может быть любым и никак заранее не связано с количеством нейронов в других слоях. Стандартный способ подачи входных сигналов: каждый нейрон первого слоя получает все входные сигналы. Особое распространение получили трехслойные сети, в которых каждый слой имеет свое наименование: первый – входной, второй – скрытый, третий – выходной.

Полносвязные сети: имеют один слой нейронов; каждый нейрон передает свой выходной сигнал остальным нейронам, включая самого себя. Выходными сигналами сети могут быть все или некоторые выходные сигналы нейронов после нескольких тактов функционирования сети. Все входные сигналы подаются всем нейронам.

Элементы слоистых и полносвязных сетей могут выбираться по-разному. Существует, впрочем, стандартный выбор – нейрон с адаптивным неоднородным линейным сумматором на входе (рис. 5).

Далее в работе будут рассматриваться только слоистые нейронные сети как наиболее оптимальные (по архитектуре) для решения задачи производства знаний из данных.