- •Предисловие

- •Лекция 1. Информация. Начальные понятия и определения

- •1. Информация и данные

- •2. Адекватность и формы адекватности информации

- •3. Качество информации

- •4. Понятие об информационном процессе

- •5. Формы представления информации

- •6. Преобразование сообщений

- •Лекция 2. Необходимые сведения из теории вероятностей

- •1. Понятие вероятности

- •2. Сложение вероятностей независимых несовместных событий

- •3. Умножение вероятностей независимых совместных событий

- •4. Нахождение среднего для значений случайных независимых величин

- •5. Понятие условной вероятности

- •6. Общая формула для вероятности произведения событий

- •7. Общая формула для вероятности суммы событий

- •Лекция 3. Понятие энтропии

- •1. Энтропия как мера неопределенности

- •2. Свойства энтропии

- •3. Условная энтропия

- •Лекция 4. Энтропия и информация

- •1. Объемный подход к измерению количества информации

- •2. Энтропийный подход к измерению количества информации

- •Лекция 5. Информация и алфавит

- •Лекция 6. Постановка задачи кодирования. Первая теорема Шеннона.

- •Лекция 7. Способы построения двоичных кодов. Алфавитное неравномерное двоичное кодирование сигналами равной длительности. Префиксные коды.

- •1. Постановка задачи оптимизации неравномерного кодирования

- •00100010000111010101110000110

- •2. Неравномерный код с разделителем

- •3. Коды без разделителя. Условие Фано

- •00100010000111010101110000110

- •00100010000111010101110000110

- •4. Префиксный код Шеннона–Фано

- •5. Префиксный код Хаффмана

- •Лекция 8. Способы построения двоичных кодов. Другие варианты

- •1. Равномерное алфавитное двоичное кодирование. Байтовый код

- •2. Международные системы байтового кодирования текстовых данных. Универсальная система кодирования текстовых данных

- •3. Алфавитное кодирование с неравной длительностью элементарных сигналов. Код Морзе

- •4. Блочное двоичное кодирование

- •101010111001100010000000001000000000000001

- •5. Кодирование графических данных

- •6. Кодирование звуковой информации

- •Лекция 9. Системы счисления. Представление чисел в различных системах счисления. Часть 1

- •1. Системы счисления

- •2. Десятичная система счисления

- •3. Двоичная система счисления

- •4. 8- И 16-ричная системы счисления

- •5. Смешанные системы счисления

- •6. Понятие экономичности системы счисления

- •Лекция 10. Системы счисления. Представление чисел в различных системах счисления. Часть 2.

- •1. Задача перевода числа из одной системы счисления в другую

- •2. Перевод q p целых чисел

- •3. Перевод p q целых чисел

- •4. Перевод p q дробных чисел

- •6. Перевод чисел между 2-ичной, 8-ричной и 16-ричной системами счисления

- •Лекция 11. Кодирование чисел в компьютере и действия над ними

- •1. Нормализованные числа

- •2. Преобразование числа из естественной формы в нормализованную

- •3. Преобразование нормализованных чисел

- •4. Кодирование и обработка целых чисел без знака

- •5. Кодирование и обработка целых чисел со знаком

- •6. Кодирование и обработка вещественных чисел

- •Лекция 12. Передача информации в линии связи

- •1. Общая схема передачи информации в линии связи

- •2. Характеристики канала связи

- •3. Влияние шумов на пропускную способность канала

- •Лекция 13. Обеспечение надежности передачи информации.

- •1. Постановка задачи обеспечения надежности передачи

- •2. Коды, обнаруживающие одиночную ошибку

- •3. Коды, исправляющие одиночную ошибку

- •Лекция 14. Способы передачи информации в компьютерных линиях связи

- •1. Параллельная передача данных

- •2. Последовательная передача данных

- •3. Связь компьютеров по телефонным линиям

- •Лекция 15. Классификация данных. Представление данных в памяти компьютера

- •1. Классификация данных

- •2. Представление элементарных данных в озу

- •Лекция 16. Классификация структур данных

- •1. Классификация и примеры структур данных

- •2. Понятие логической записи

- •Лекция 17. Организация структур данных в оперативной памяти и на внешних носителях

- •1. Организация структур данных в озу

- •2. Иерархия структур данных на внешних носителях

- •3. Особенности устройств хранения информации

- •Контрольные вопросы

- •Список литературы

2. Характеристики канала связи

Ограничим дальнейшее рассмотрение каналами связи, передача сообщений по которым осуществляется за счет электрических импульсов – с практической точки зрения (использование в компьютерных линиях связи) такие каналы связи представляют наибольший интерес.

Ширина полосы пропускания. Любой преобразователь, работа которого основана на использовании колебаний, может формировать и пропускать сигналы из ограниченной области частот. Весь доступный для использования частотный спектр разделен надиапазоны(ДВ, СВ, КВ1, КВ2, УКВ, ДМВ, МВ), в пределах которых каждая передающая станция занимает свойподдиапазон, чтобы не мешать вещанию других.

Интервал частот, используемый данным каналом связи для передачи сигналов, называется шириной полосы пропускания.

Для построения теории передачи информации

важна не сама ширина полосы пропускания,

а максимально возможное значение

![]() частоты из данной полосы, поскольку

именно этим значением определяется

возможная скорость передачи информации

по каналу связи.

частоты из данной полосы, поскольку

именно этим значением определяется

возможная скорость передачи информации

по каналу связи.

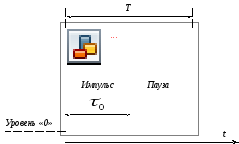

Длительность элементарного импульса. Длительность элементарного импульса может быть определена из следующих соображений. Если параметр сигнала меняется синусоидально, то за один период колебанийTсигнал будет иметь одно максимальное значение и одно минимальное. Аппроксимируем синусоиду прямоугольными импульсами (см.рис. 5) и за нулевой уровень сигнала примем минимальное значение сигнала. Получается, что сигнал (аппроксимированный) принимает всего два значения – максимальное (импульс) и минимальное (пауза).

Рис. 5. Аппроксимация периодического сигнала прямоугольными импульсами.

Импульс и паузу можно счистать элементарными сигналами; при выбранной здесь аппроксимации их длительности одинаковы:

![]() . (13.1)

. (13.1)

Таким образом, частота

![]() определяет минимальную длительность

определяет минимальную длительность

![]() элементарного сигнала (импульса или

паузы). Последовательность элементарных

сигналов связывают с определенными

кодами. Использовать сигналы большей,

чем

элементарного сигнала (импульса или

паузы). Последовательность элементарных

сигналов связывают с определенными

кодами. Использовать сигналы большей,

чем

![]() ,

длительности, в принципе, возможно,

однако это снизит скорость передачи

информации по каналу.

,

длительности, в принципе, возможно,

однако это снизит скорость передачи

информации по каналу.

Пропускная способность канала.

Если с передачей одного импульса,

длящегося

![]() ,

связано количество информации

,

связано количество информации![]() ,

то отношение

,

то отношение![]() к

к

![]() ,

очевидно, отражаетсреднее количество

информации, передаваемое по каналу за

единицу времени. Эта величина

называетсяпропускной способностью

канала:

,

очевидно, отражаетсреднее количество

информации, передаваемое по каналу за

единицу времени. Эта величина

называетсяпропускной способностью

канала:

![]() . (13.2)

. (13.2)

Если

![]() выражено в битах, а

выражено в битах, а

![]() – в секундах, то единицей измерения

величиныСявляетсябит/с.

Раньше эта единица называласьбод,

однако это название не прижилось и более

не используется. Производными единицами

являются:

– в секундах, то единицей измерения

величиныСявляетсябит/с.

Раньше эта единица называласьбод,

однако это название не прижилось и более

не используется. Производными единицами

являются:

![]() ,

,

![]() ,

,

![]() .

.

Величину

![]() можно установить из следующих соображений.

Если на один знак первичного алфавита

приходится количество информации

можно установить из следующих соображений.

Если на один знак первичного алфавита

приходится количество информации![]() ,

причем каждый знак этого первичного

алфавита кодируется количествомKзнаков вторичного алфавита (то есть

длина кода, другими словами, суммарное

количество импульсов и пауз, приходящееся

на знак первичного алфавита, равноK),

то, очевидно,

,

причем каждый знак этого первичного

алфавита кодируется количествомKзнаков вторичного алфавита (то есть

длина кода, другими словами, суммарное

количество импульсов и пауз, приходящееся

на знак первичного алфавита, равноK),

то, очевидно,

![]() . (13.3)

. (13.3)

Подстановка (13.3) в (13.2) дает:

![]() . (13.4)

. (13.4)

Величина

![]() определяется по формуле Шеннона:

определяется по формуле Шеннона:

![]() , (13.5)

, (13.5)

где

![]() – общее количество знаков в первичном

алфавите,

– общее количество знаков в первичном

алфавите,![]() – вероятность появления

– вероятность появления![]() -го

знака первичного алфавита в сообщении.

-го

знака первичного алфавита в сообщении.

Таким образом, окончательно получаем:

![]() . (13.6)

. (13.6)

Пример. Первичный алфавит состоит

из трех знаков с вероятностями

![]() ,

,

![]() ,

,

![]() .

Для передачи по каналу без помех

используется равномерный двоичный код.

Частота тактового генератора

.

Для передачи по каналу без помех

используется равномерный двоичный код.

Частота тактового генератора

![]() .

Какова пропускная способность канала?

.

Какова пропускная способность канала?

![]() .

.

Величина Kв случае двоичного кодирования (два вида знаков вторичного алфавита – импульсы и паузы) определяется так:

![]() ,

поэтому

,

поэтому![]() ,

так как длина кода – число целое.

,

так как длина кода – число целое.

![]() .

Следовательно, из (13.6) получаем:

.

Следовательно, из (13.6) получаем:

![]() .

.

Скорость передачи информации. Пусть по каналу связи за времяtпередано количество информацииI. Можно ввести величинускорости передачи информации J:

![]() . (13.7)

. (13.7)

Размерностью величины J,

как и величиныC,

являетсябит/с. Каково соотношение

этих характеристик? Так как![]() – это минимальная длительность

элементарного сигнала, тоC– это максимальная скорость передачи

информации по данной линии связи, то

есть

– это минимальная длительность

элементарного сигнала, тоC– это максимальная скорость передачи

информации по данной линии связи, то

есть![]() или

или![]() .

.

Максимальная скорость передачи информации по каналу связи равна его пропускной способности.