6.2. Регресійний аналіз

ОЗНАЧЕННЯ 6.1. Математичний метод, що забезпечує таку підгонку вибраної кривої, при якій експериментальні точки лягають на неї щонайкраще в сенсі критерію найменших квадратів, називається регресійним аналізом.

Загальний вигляд кривої найкращого наближення аналітик повинен вибрати за результатами вивчення діаграми розкиду. Використовуваний надалі математичний апарат повинен забезпечувати найкраще наближення кривої до експериментальних даних незалежно від того, наскільки добре вибраний тип кривої. Під наближенням кривої до експериментальних даних розуміється лише процес обчислення значень констант або параметрів таким чином, щоб сума квадратичних відхилень була мінімальною. Аналітик повинен заздалегідь вибрати найкраще апроксимуюче рівняння.

Детальний опис методів регресійного аналізу можна знайти у спеціальній літературі (наприклад, [3]). В даній лекції обмежимося обговоренням простого випадку, коли очікується, що є лінійною функцією однієї змінної .

Основна модель лінійного співвідношення між залежною змінною і незалежною змінною дається рівнянням

![]() ,

(6.1)

,

(6.1)

де

![]() — початкове

значення

;

— початкове

значення

;

![]() -

тангенс кута нахилу прямої;

-

тангенс кута нахилу прямої;

![]() -

випадкова похибка.

-

випадкова похибка.

Величини

,

![]() і

невідомі. Якщо ми маємо сукупність

даних, що складається з відповідних

значень

і

,

оцінки

і

невідомі. Якщо ми маємо сукупність

даних, що складається з відповідних

значень

і

,

оцінки

![]() і

необхідно отримати з цих даних. Для

цього скористуємося наступними

рівняннями:

і

необхідно отримати з цих даних. Для

цього скористуємося наступними

рівняннями:

,

(6.2)

,

(6.2)

.

(6.3)

.

(6.3)

ПРИКЛАД

6.1.

Нехай маємо чотири експериментальні

крапки (![]() )

і хочемо отримати лінійну апроксимацію

цієї сукупності даних. Відповідні

обчислення наведено в таблиці

6.1.

)

і хочемо отримати лінійну апроксимацію

цієї сукупності даних. Відповідні

обчислення наведено в таблиці

6.1.

Таблиця 6.1.

x |

y |

x2 |

xy |

|

|

0 |

1 |

0 |

0 |

2 |

4 |

4 |

8 |

|

2 |

3 |

4 |

6 |

|

3 |

5 |

9 |

15 |

|

Суммы |

7 |

13 |

17 |

29 |

У відповідності з (6.2) та (6.3) маємо

![]() ,

,

![]() .

.

Виходячи з цього, рівняння регресії буде мати вигляд

![]() .

.

6.3. Кореляція

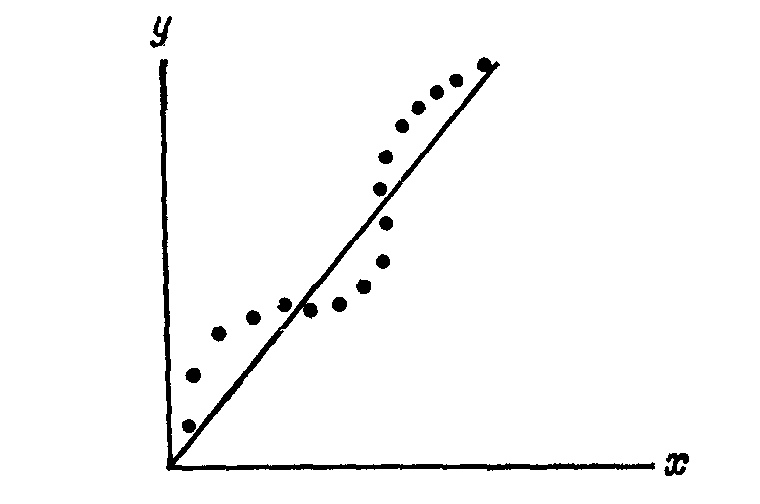

Слід відмітити той факт, що найкраще наближення обраної для апроксимації прямої (або кривій) до експериментальних даних зовсім не означає, що реально існуюча фізична залежність щонайкраще описується апроксимуючим рівнянням, відповідним саме цієї лінії. Математичні операції завжди лише наводять до значень параметрів, що забезпечують найкраще (у сенсі критерію найменших квадратів) наближення до рівняння вибраного вигляду. Наочний цьому приклад наведено рис. 6.5: тут можна бачити, що одержані експериментальні дані зовсім не відповідають лінійній залежності, хоча пряма підібрана так, що забезпечує найкраще наближення до цих даних.

Для оцінки того, наскільки добре обрана пряма (і відповідне їй рівняння) насправді узгоджується з експериментальними даними, необхідно практично використати кореляційні методи, математичний апарат яких було розглянуто у попередніх лекціях. Кореляційні методи надають можливість судити про те, наскільки тісно улягаються експериментальні точки на апроксимуючу криву. Якщо регресія визначає передбачуване співвідношення між змінними, то кореляція показує, наскільки добре це

Рис. 6.5

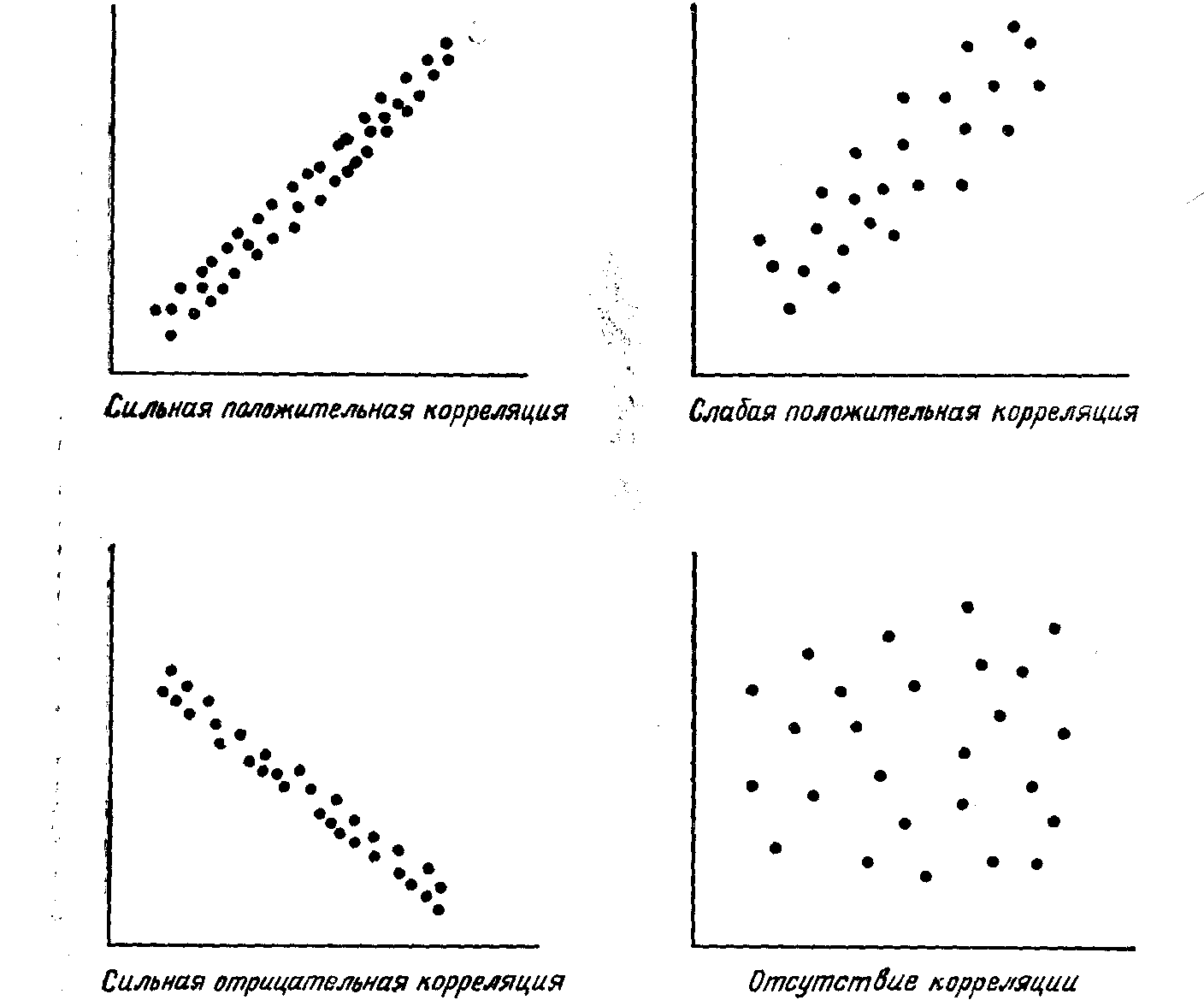

співвідношення відображує дійсність. Сильна кореляція між змінними означає, що ці зміни взаємозв'язані (рис. 6.6), проте необхідно мати на увазі, що це ще не доводить наявність причинно-наслідкового зв'язку між змінними. При регресійному аналізі передбачається наявність причинно-наслідкового зв'язку між залежною і незалежною змінними: при кореляційному аналізі таке допущення не робиться.

Часто розповідають історію, що про одному державному діячі, який виявив, що в його державі є вельми сильна кореляція між зростанням продажу пива і збільшенням доходів шкільних вчителів. Звідси він зробив вивід, що немає сенсу підвищувати вчителям зарплату, оскільки вони почнуть споживати більше пива. Ймовірно, він міг би виявити настільки ж сильну кореляцію між зростанням зарплати вчителів і ростом злочинності, числа незаконнонароджених і інфляції. Фактично він міг би знайти сильну кореляцію і зв'язати регресійною кривою будь-які два явища, які зростають більш менш однаковим чином.

У цьому жартівливому прикладі істотне те, що аналітик прийняв допущення (гіпотезу) про наявність причинно-наслідкового зв'язку між явищами, яке робиться при регресійному аналізі. Але в даному випадку це допущення може і не бути правильним. Кореляція говорить лише про те, наскільки тісно експериментальні точки лягають на апроксимуючу криву. Але вона не може сказати, чи справедливе основне допущення про наявність причинно-наслідкового зв'язку. Кореляційний аналіз показує лише ступінь відповідності одержаних даних гіпотезі, що прийнято.

Рис. 6.6

Коефіцієнт кореляції лежить в межах від — 1 до + 1. Коефіцієнт — 1 відповідає максимальною негативній кореляції, коли зменшується із збільшенням , а всі експериментальні точки лежать точно на кривій. Коефіцієнт 0 свідчить про повну відсутність кореляції, а коефіцієнт + 1 — відповідає максимальній позитивній кореляції. Всі ці крайні випадки зустрічаються дуже і дуже рідко; зазвичай коефіцієнт кореляції має деяке дробове значення, і його ще слід перевіряти на статистичну значущість.

Для

випадку простої лінійної регресійної

задачі (тобто для випадку, коли є одна

залежна і одна незалежна змінні, зв'язані

між собою лінійно) коефіцієнт кореляції

![]() обчислюється за формулою

обчислюється за формулою

(6.4)

(6.4)

Практичне застосування наведеної формули розглянемо на конкретному прикладі

ПРИКЛАД 6.2. Використовуючи дані з ПРИКЛАДУ 6.1, обчислимо коефіцієнт кореляції , як це показано в таблиці 6.2. У відповідності з формулою (6.4), маємо

![]() .

.

Таблиця 6.2

|

||||

X |

Y |

XY |

Х2 |

Y2 |

0 |

1 |

0 |

0 |

1 |

2 |

4 |

8 |

4 |

16 |

2 |

3 |

6 |

4 |

9 |

3 |

5 |

15 |

9 |

25 |

Суммы 7 |

13 |

29 |

17 |

51 |

Загальний

розкид

![]() визначається як

визначається як

![]() ,

тобто рівний сумі квадратів відхилень

від середнього значення

,

тобто рівний сумі квадратів відхилень

від середнього значення

![]() . Відношення цієї величини розкиду, що

обумовлюється запропонованим регресійним

рівнянням, до загального спостережуваного

розкиду називається коефіцієнтом

детермінації

і рівно квадрату коефіцієнту кореляції.

Таким чином, для наведеного прикладу,

в якому ми обчислили

= 0,969, коефіцієнт детермінації

. Відношення цієї величини розкиду, що

обумовлюється запропонованим регресійним

рівнянням, до загального спостережуваного

розкиду називається коефіцієнтом

детермінації

і рівно квадрату коефіцієнту кореляції.

Таким чином, для наведеного прикладу,

в якому ми обчислили

= 0,969, коефіцієнт детермінації

![]() .

Це означає, що в 93,9% випадків відхилення

при змінах

.

Це означає, що в 93,9% випадків відхилення

при змінах

![]() відповідає наведеному рівнянню.

відповідає наведеному рівнянню.

![]() .

.