- •Управляющие элементы nnTool

- •Многослойный персептрон

- •Алгоритм наискорейшего спуска

- •Алгоритм сопряженных градиентов

- •Подбор коэффициента обучения

- •7. Методы инициализации весов

- •Алгоритм обучения персептрона (Теорема о сходимости персептрона)

- •Алгоритм обратного распространения ошибки

- •Режимы обучения

- •Критерий останова (для прекращения корректировки весов)

- •Пример (Двухслойный персептрон. Исключающее или)

Пример (Двухслойный персептрон. Исключающее или)

P=[1 0 0 0 1 1 1 0 0 1;1 1 0 1 1 0 1 1 0 1]

P =

1 0 0 0 1 1 1 0 0 1

1 1 0 1 1 0 1 1 0 1

>> T=[0 1 0 1 0 1 0 1 0 0]

T =

0 1 0 1 0 1 0 1 0 0

>> net=newcf(P,T, [2 1])

net =

Neural Network object:

architecture:

numInputs: 1

numLayers: 3

biasConnect: [1; 1; 1]

inputConnect: [1; 1; 1]

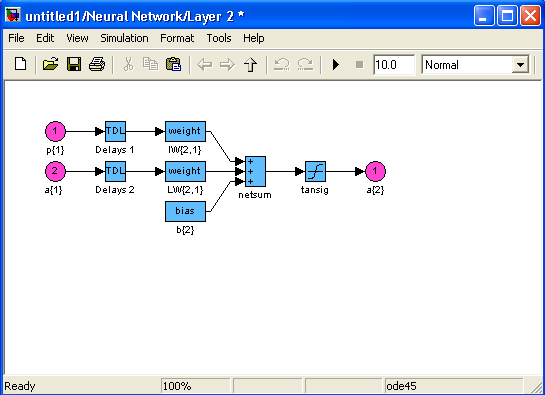

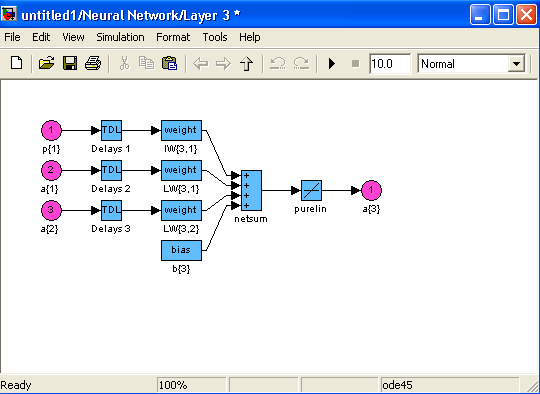

layerConnect: [0 0 0; 1 0 0; 1 1 0]

outputConnect: [0 0 1]

numOutputs: 1 (read-only)

numInputDelays: 0 (read-only)

numLayerDelays: 0 (read-only)

subobject structures:

inputs: {1x1 cell} of inputs

layers: {3x1 cell} of layers

outputs: {1x3 cell} containing 1 output

biases: {3x1 cell} containing 3 biases

inputWeights: {3x1 cell} containing 3 input weights

layerWeights: {3x3 cell} containing 3 layer weights

functions:

adaptFcn: 'trains'

divideFcn: 'dividerand'

gradientFcn: 'calcjx'

initFcn: 'initlay'

performFcn: 'mse'

trainFcn: 'trainlm'

parameters:

adaptParam: .passes

divideParam: .trainRatio, .valRatio, .testRatio

gradientParam: (none)

initParam: (none)

performParam: (none)

trainParam: .epochs, .goal, .max_fail, .mem_reduc,

.min_grad, .mu, .mu_dec, .mu_inc,

.mu_max, .show, .time

weight and bias values:

IW: {3x1 cell} containing 3 input weight matrices

LW: {3x3 cell} containing 3 layer weight matrices

b: {3x1 cell} containing 3 bias vectors

other:

userdata: (user information)

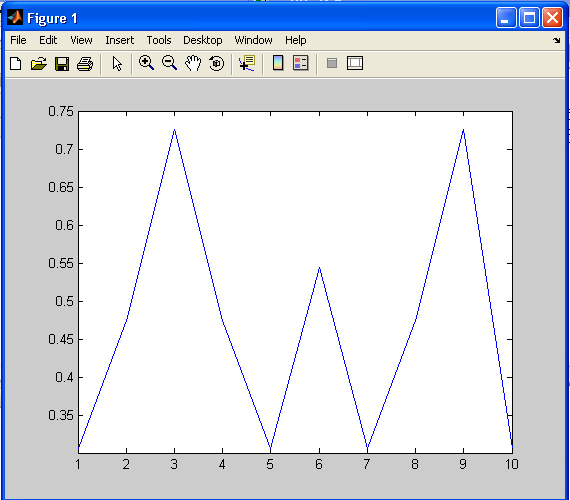

>> Y=sim(net,P)

Y =

Columns 1 through 7

0.2635 -0.7255 0.6022 -0.7255 0.2635 0.8672 0.2635 Columns 8 through 10 -0.7255 0.6022 0.2635

>> net.adaptParam.passes=100;

>> net=adapt(net,P,T);

>> Y=sim(net,P)

Y =

Columns 1 through 7

0.3059 0.4743 0.7256 0.4743 0.3059 0.5438 0.3059

Columns 8 through 10

0.4743 0.7256 0.3059

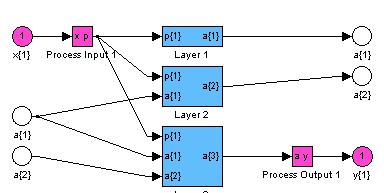

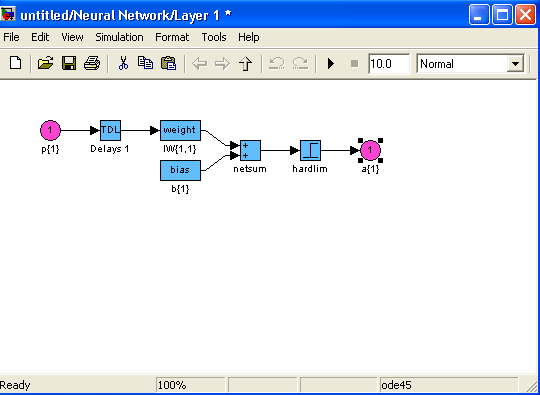

>> gensim(net)