- •Содержание

- •1. Классификация релейной защиты и автоматики 2

- •2. Моделирование 39

- •Введение. Общие сведения о релейной защите и автоматике элементов энергетических систем

- •Классификация релейной защиты и автоматики

- •Класс напряжения

- •Селективность.

- •2.1 Защита с абсолютной селективностью

- •2.1.1 Дифференциальная защита линий

- •2.3 Защита лэп 110-220 кВ

- •2.4 Защита лэп 500 кВ и выше.

- •Проблемы резервирования

- •Дальнее резервирование

- •Ближнее резервирование

- •Быстродействие

- •Классификация защит по быстродействию

- •Защиты I, II, III ступеней

- •Чувствительность. Коэффициент чувствительности для различных видов защит

- •Конструктивные особенности

- •Алгоритмическая база

- •Классические алгоритмы

- •Характеристики реле сопротивления

- •3. Пдэ 2001

- •1 Ступень 3 ступень

- •Оапв (однофазное автоматическое повторное включения).

- •Адаптивные алгоритмы

- •Алгоритмы существующих адаптивных защит (опф и вп)

- •7.2.1.1 Определение поврежденных фаз и вида повреждения (фазовый селектор)

- •Классификация устройств выбора поврежденных (особых) фаз

- •7.2.1.2 Адаптивный дистанционный принцип в диагностике лэп

- •Основные электрические величины и схемные модели лэп (имо лэп).

- •Целевые функции и критерии

- •7.2.2.1 Классификация целевых функций

- •7.2.2.2. Целевые функции типа параметра повреждения

- •7.2.2.3. Целевая функция для определения зоны и места повреждения лэп

- •7.2.2.4 Прямые целевые функции

- •7.2.2.5. Косвенные целевые функции

- •7.2.2.6. Граничные условия в месте повреждения

- •7.2.2.7. Целевые функции с учетом граничных условий повреждения

- •7.2.2.8. Дистанционные способы на основе косвенных критериев

- •Дистанционный способ для сетей с малыми токами замыкания на землю и сетей с изолированной нейтралью.

- •Устройства рз с одной подведённой величиной (простые реле)

- •Устройства рз с двумя подведёнными величинами

- •Пусковые органы защит

- •Интеллектуальные алгоритмы

- •Устройства рЗиА на основе искусственных нейронных сетей

- •Основные черты нейронных сетей

- •Формальный нейрон

- •Многослойный перцептрон

- •Этапы построения искусственных нейронных сетей

- •Методы обучения искусственных нейронных сетей

- •Применение нейронных сетей в задачах рЗиА

- •Нечёткая логика

- •Моделирование

- •Информационные параметры

- •Проблемы моделирования

- •Информации об объекте

- •Расчёт модели

- •2.4.2 Выбор места кз

- •2.4.3 Место установки защиты для выбора уставки

- •Имитационное моделирование

- •Моделирование трансформаторов и автотрансформаторов

- •Двухобмоточный трансформатор

- •Трехобмоточный трансформатор

- •Автотрансформатор

- •Схемы замещения трансформаторов нулевой последовательности

- •Моделирование реакторов

- •Моделирование нагрузки

- •Моделирование лэп (с точки зрения теории поля)

- •Система провод – провод

- •Система провод – земля

- •Трёхфазная одноцепная линия (без учёта троса)

- •Ёмкостная проводимость

- •Структура защит

- •4.1 Структура аналоговых защит

- •4.2 Структура цифровых защит

- •Аппаратная часть:

- •Программное обеспечение.

- •4.3 Входные преобразователи для микропроцессорной защиты

- •Входные преобразователи на основе датчика Холла

- •Катушка Роговского

- •4.4 Асутп. Особенности и функции

Методы обучения искусственных нейронных сетей

Методы обучения бывают с учителем и без учителя. Если сеть обучалась с учителем, то она способна к обобщениям. Большинство методов обучения итерационные (нет конкретной функции, с помощью которой можно получить желаемый результат). Теорема существования решения: нейронная сеть может решать любую задачу, если структура сети выбрана правильно.

Обучение с учителем. Оно предполагает, что для каждого входного вектора существует целевой вектор, представляющий собой требуемый выход. Вместе они называются обучающей парой. Обычно сеть обучается на некотором числе таких обучающих пар. Предъявляется выходной вектор, вычисляется выход сети и сравнивается с соответствующим целевым вектором, разность (ошибка) с помощью обратной связи подается в сеть и веса изменяются в соответствии с алгоритмом, стремящимся минимизировать ошибку. Векторы обучающего множества предъявляются последовательно, вычисляются ошибки и веса подстраиваются для каждого вектора до тех пор, пока ошибка по всему обучающему массиву не достигнет приемлемо низкого уровня.

Алгоритмы обучения с учителем:

1. Инициализация весов.

2. Передача образа.

3. Расчет ошибки.

4.

Изменение

![]() и

и![]() для уменьшения ошибки.

для уменьшения ошибки.

Обучение без учителя. Обучающее множество состоит лишь из входных векторов. Обучающий алгоритм подстраивает веса сети так, чтобы получались согласованные выходные векторы, т. е. чтобы предъявление достаточно близких входных векторов давало одинаковые выходы.

Применяются следующие методы безусловной оптимизации:

1. Стабилизирующие методы Ньютона, Гаусса – Ньютона, Левинберга – Маркардта.

2. Квазиньтоновские методы.

3. Методы сопряженных градиентов.

Скорость обучения показывает на сколько сильно корректируем веса на каждом этапе обучения. Нейронная сеть, таким образом, может обучаться последовательно.

Существуют генетические алгоритмы обучения (когда некоторую начальную форму размножают, делают мутации и выбирают наиболее успешное “потомство”) и методы имитации отжига (отжиг – закаливание металла. По аналогии, имитируют ослабление в связях).

Применение нейронных сетей в задачах рЗиА

Нейронные сети применяются для задач дистанционной защиты и задач фазовой селекции. Нейронная сеть дает частное решение нашей задачи.

Трудности применения:

– необходимо время для обучения и тестирования, внутренняя структура сети скрыта.

– для нейронных сетей нет гарантии обучения, не гарантированно достижение оптимального результата.

– нейронная сеть достаточно медленна в своей работе.

– нейронные сети применяются для автоматики не очень ответственных объектов.

– нейронная сеть в первую очередь математический аппарат.

Нечёткая логика

Один из видов диспертных систем. Она имеет запас знаний, опыта и на его основе делает выводы. Появилась в 50–х годах ХХ века.

Основной принцип: нельзя работать с фиксированными задачами, т.е. нельзя четко определить «да» или «нет».

Оперирует лингвистическими переменными. В нечеткой логике тот же набор операций «и» – логическое умножение, «не» – логическое вычитание, «или» – логическое сложение. Функции называются функциями принадлежности. Все функции заложены в пакет MATLAB.

Теорема FA: с помощь нечеткой логики можно сапроксимировать любую область.

Для каждой величины заводятся свои функции принадлежности.

Существуют процедуры обучения. С помощью нечеткой логики пытаются сапроксимировать уставки. Функция обучения не идеальна, особенно это проявляется при наложении альтернативного и отслеживаемого режима. В основном нечеткая логика применяется в управлении (например, трансформаторами).

М атематическая

теория множеств, предложенная Л. Заде

более четверти века назад, позволяет

описывать нечеткие понятия и значения,

оперировать этими значениями и делать

выводы, тем самым имитируя интеллектуальную

деятельность человека. В настоящее

время нечеткая логика (fuzzylogic) широко используется

в различных видах техники. Уже существуют

устройства, основанные на нечеткой

логике, позволяющие определять место

повреждения и вид короткого замыкания.

атематическая

теория множеств, предложенная Л. Заде

более четверти века назад, позволяет

описывать нечеткие понятия и значения,

оперировать этими значениями и делать

выводы, тем самым имитируя интеллектуальную

деятельность человека. В настоящее

время нечеткая логика (fuzzylogic) широко используется

в различных видах техники. Уже существуют

устройства, основанные на нечеткой

логике, позволяющие определять место

повреждения и вид короткого замыкания.

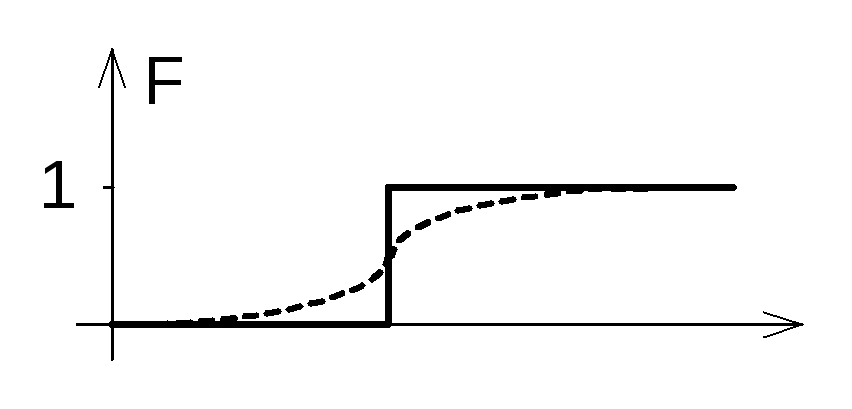

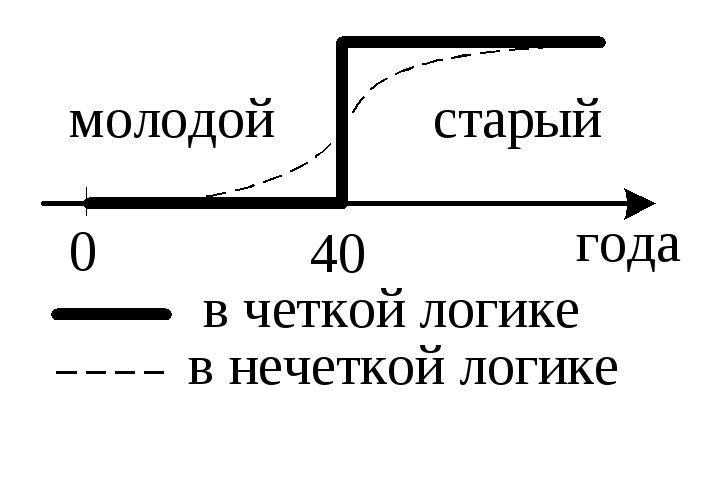

Основной принцип нечеткой логики: нельзя работать с фиксированными задачами, т.е. нельзя четко определить «да» или «нет». Рассмотрим это на примере, когда необходимо определить возраст человека (молодой он или старый). В четкой логике существует фиксированный возраст (в нашем случае 40 лет), который разграничивает понятия “молодой” и “старый”. В нечеткой логике на отметке 40 лет человек считается уже не молодым, но еще не старым.

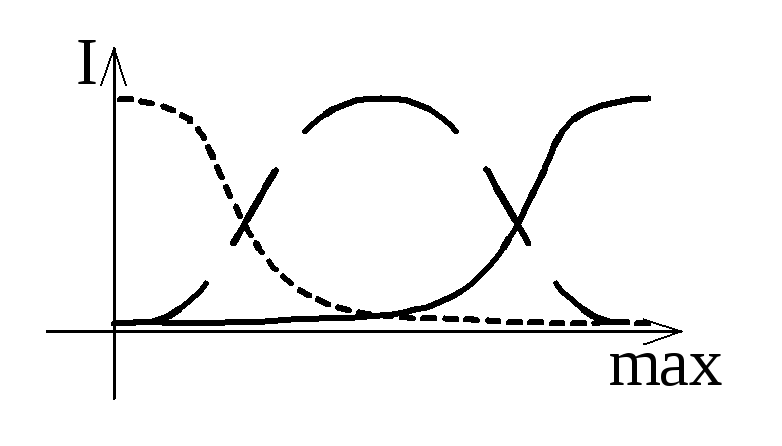

Нечеткая логика оперирует логистическими переменными. В нечеткой логике тот же набор операций «и» – логическое умножение, «не» – логическое вычитание, «или» – логическое сложение. Функции называются функциями принадлежности. Все функции заложены в пакете MATLAB.

В проблемной лаборатории РЗА ЧГУ разработан фазовый селектор на базе аппарата нечеткой логики. В качестве входных переменных использовались модуль отношения токов обратной и прямой последовательностей, а также угол между ними. Каждая переменная может принимать по два значения, определяемых соответствующими функциями принадлежности. Для настройки использовался образцовый массив входной и выходной информации. Образцовый объем данных был получен моделированием двухфазных коротких замыканий на линии 220 кВ, длиной 300 км и переходным сопротивлением до 250 Ом. При формировании массива учитывалась кривая предельной распознаваемости [2]. Процесс настройки FIS происходит значительно быстрее, чем похожая процедура обучения с учителем нейронной сети.

Существуют процедуры обучения. С помощью нечеткой логики пытаются сапроксимировать уставки. Функция обучения не идеальна, особенно это проявляется при наложении альтернативного и отслеживаемого режима. В основном нечеткая логика применяется в управлении (например трансформаторами).