- •Методы, основанные на критерии автоинформативности системы признаков

- •Метод главных компонент

- •Регрессионный анализ

- •Факторный анализ

- •Факторный анализ

- •2 Выбор формы связи

- •3 Аналитическое выражение связи

- •Стандартная методика проверки статистических гипотез

- •Нормальное распределение

- •28 И 27. Нужно искать в тетради! Статистические гипотезы

- •23. По тетради!

Факторный анализ

Факторный анализ (ФА), как и многие методы анализа многомерных данных, опирается на гипотезу о том, что наблюдаемые переменные являются косвенными проявления относительно небольшого числа неких скрытых (гипотетических) факторов. ФА, таким образом, это совокупность моделей и методов ориентированных на выявление и анализ скрытых (латентных) зависимостей между наблюдаемыми переменными. В контексте задач распознавания, наблюдаемыми переменными обычно являются признаки объектов.

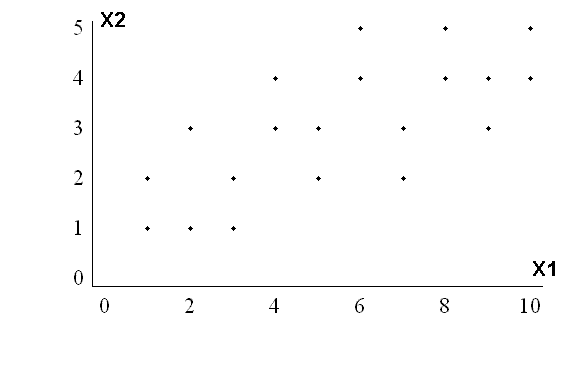

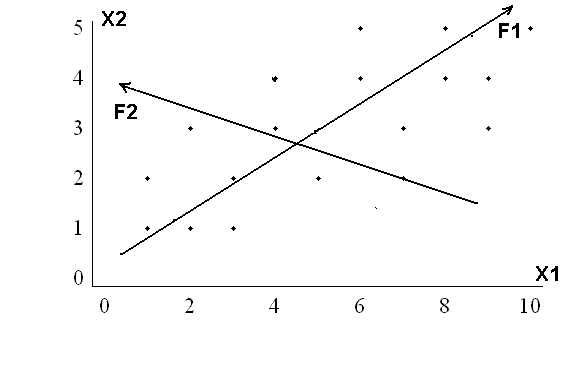

Предположим, что наблюдаемые объекты (автомобили) оцениваются двумя признаками: стоимостью автомобиля - x1 ( в десятках тысяч долларов) и длительностью рабочего ресурса двигателя - x2 ( в тысячах часов). При условии коррелированности x1 и x2 в системе координат существует направленное, плотное скопление точек (объектов).

Это позволяет формально провести через плотные скопления точек новые оси координат F1 и F2, которые в свою очередь коррелируют с x1 и x2. В общем случае максимальное число

новых осей будет равно числу элементарных признаков. Для нашего случая имеем:

F1 = b11*x1 + b12*x2 и F2 = b21*x1 + b22*x2

Модели с латентными переменными применяются при решении следующих задач:

понижение размерности признакового пространства,

классификация объектов на основе сжатого признакового пространства,

косвенной оценки признаков, не поддающихся непосредственному измерению,

преобразование исходных переменных к более удобному для интерпретации виду.

Например пусть исходная матрица X содержит по трем показателям (i =1,2,3) значения четырех (j=1,2,3,4) объектов:

x11 |

x12 |

x13 |

x41 |

x21 |

x22 |

x23 |

x42 |

x31 |

x32 |

x33 |

x43 |

Если значения матрицы нормировать (обозначим эту матрицу Z) и разделить на n -1 = 3, то получим оценку корреляционной матрицы:

R = (Z*Zт)/3

Целью факторного анализа является представление матрицы Z в виде:

Z3*4 = A3*m*Fm*4 ,

где m - количество факторов;

Fm*4 - матрица значений факторов (factor scores);

A3*m - матрица факторного отображения (factor pattern), элементы которой называются факторными нагрузками (factor loadings).

Пусть m=2, тогда матрица Z имеет вид:

a11*f11 + a12*f21 |

a11*f12 + a12*f22 |

a11*f13 + a12*f23 |

a11*f14 + a12*f24 |

a21*f11 + a22*f21 |

a21*f12 + a22*f22 |

a21*f13 + a22*f23 |

a21*f14 + a22*f24 |

a31*f11 + a32*f21 |

a31*f12 + a32*f22 |

a31*f13 + a32*f23 |

a31*f14 + a32*f24 |

Таким образом, отдельные наблюдения являются линейными комбинациями гипотетических, ненаблюдаемых или скрытых переменных, называемых факторами, которые не могут быть обнаружены непосредственно в процессе наблюдения.

В общем виде R = (Z*Zт)/(n - 1), где n - количество наблюдаемых объектов. Тогда, так как (A*F)т = Fт*Aт получим:

R = (Z*Zт)/(n - 1) = A*F*(A*F)т/(n - 1) = A*F*Fт*Aт/(n - 1)

Матрица F*Fт/(n - 1) является оценкой корреляционной матрицы факторов F. Если факторы некоррелируют, то F*Fт/(n - 1) = I - единичная матрица и, следовательно:

R = A*Aт

Выражения A*F*Fт*Aт/(n - 1) и R = A*Aт называют фундаментальной теоремой факторного анализа. Теорема утверждает, что корреляционная матрица исходных наблюдений может быть воспроизведена с помощью факторного отображения и корреляций между факторами. Обозначим G = F*Fт/(n - 1), тогда R = A*G*Aт. Для нашего примера имеем:

r11 |

r12 |

r13 |

|

a11 |

a12 |

|

g11 |

g12 |

|

a11 |

a21 |

a31 |

r11 |

r12 |

r13 |

= |

a21 |

a22 |

* |

g21 |

g22 |

* |

a12 |

a22 |

a32 |

r11 |

r12 |

r13 |

|

a31 |

a32 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

R |

|

= |

|

A |

* |

|

G |

* |

|

Aт |

|

При G = I (факторы некоррелируют) матрица R3*3 имеет вид:

(a11)2 + (a12)2 |

a11*a21 + a12*a22 |

a11*a31 + a12*a32 |

a11*a21 + a12*a22 |

(a21)2 + (a22)2 |

a21*a31 + a22*a32 |

a11*a31 + a12*a32 |

a21*a31 + a22*a32 |

(a31)2 + (a32)2 |

Из приведенного выше примера, что исходную оценку корреляционной матрицы R размером 3*3 можно восстановить используя матрицу A меньшего размера 3*2 .

Пусть имеется оценка корреляционной матрицы для четырех переменных:

1 |

0,72 |

0,45 |

0,045 |

0,72 |

1 |

0,4 |

0,04 |

0,45 |

0,4 |

1 |

0,025 |

0,045 |

0,04 |

0,025 |

1 |

Оценки коэффициентов корреляции можно воспроизвести с помощью следующего уравнения:

(0,81) |

0,72 |

0,45 |

0,045 |

|

0.9 |

|

|

|

|

|

0,72 |

(640) |

0,4 |

0,04 |

= |

0,8 |

* |

(0,9 |

0,8 |

0,5 |

0,05) |

0,45 |

0,4 |

(0,25) |

0,025 |

|

0,5 |

|

|

|

|

|

0,045 |

0,04 |

0,025 |

(0,003) |

|

0,05 |

|

|

|

|

|

|

R+ |

|

|

= |

A |

* |

Aт |

|

|

|

Вектор Aт = (0,9 0,8 0,5 0,05) представляет собой фактор, элементы которого - факторные нагрузки. Матрица R+ является матрицей воспроизведенных оценок коэффициентов корреляции. Диагональные элементы называются общностями. Их оценивание составляет первую проблему - проблему общности. Второй проблемой - проблемой факторов, является проблема оценивания Aт. Фактор называется генеральным (general factor), если все его нагрузки являются значимыми.

Содержательно, специфические факторы соответствуют необъясненной общими факторами изменчивости набора наблюдаемых переменных. Таким образом их можно рассматривать как случайную ошибку наблюдения или шум, не являющийся ценной информацией для выявления скрытых закономерностей и зависимостей. Важным предположением является независимость их между собой. Обычно, однако не всегда, общие факторы Fj предполагаются некоррелированными (ортогональными).

Целью ФА является выявление общих факторов Fj, и матрицы факторных нагрузок A таким образом, чтобы найденные общие факторы объясняли наблюдаемые данные наилучшим образом, то есть чтобы суммарная общность переменных была максимальна (а соответственно специфичность - минимальна).

Итак, в общем случае основные этапы факторного анализа следующие:

Нормирование значений исходных признаков (преобразование матрицы X в матрицу Z)

Преобразование исходной корреляционной матрицы исходных признаков R в матрицу воспроизведенных коэффициентов корреляции R+ в диагонали которой содержаться значения общностей.

Получение матрицы весовых коэффициентов A - весовые коэффициенты являются характеристиками статистической связи между исходными признаками и общими факторами.

Выбор одной матрицы A' из возможного множества матриц A с использованием вращения осей факторов.

Получение матрицы F - оценивание значений факторов.

45.

Корреляционный анализ решает две основные задачи:

Первая задача заключается в определении формы связи, т.е. в установлении математической формы, в которой выражается данная связь.

Это очень важно, так как от правильного выбора формы связи зависит конечный результат изучения взаимосвязи между признаками.

Вторая задача состоит в измерении тесноты, т.е. меры связи между признаками с целью установить степень влияния данного фактора на результат.

Она решается математически путем определения параметров корреляционного уравнения.

Затем проводятся оценка и анализ полученных результатов при помощи специальных показателей корреляционного метода (коэффициентов детерминации, линейной и множественной корреляции и т.д.), а также проверка существенности связи между изучаемыми признаками.