Книга по ЦОС в формате pdf

.pdf

Пример 18.3. В урне было 10 белых и 10 черных шаров. С вероят• ностью 1/4 из урны удалили 5 черных шаров. Какова вероятность того, что вынутый наугад из этой урны шар окажется белым.

Мы не знаем, удалены ли шары из урны или нет и должны делать гипотезы и рассматривать условные вероятности интересующего нас события. При условии A0(шары не были удалены) вероятность вынуть белый шар равна P (B|A0) = 10/20 = 1/2. При условии A1(шары были удалены) вероятность равна P (B|A1) = 10/15 = 2/3. Так как по условию задачи P (A1) = 1/4 и, следовательно P (A0) = 3/4, то согласно (18.2)

P (B) = P (B|A0)P (A0) + P (B|A1)P (A1) = |

1 |

|

3 |

|

2 |

|

1 |

|

3 |

|

1 |

|

13 |

|||||

|

· |

|

|

+ |

|

· |

|

|

= |

|

+ |

|

|

= |

|

|

. |

|

2 |

4 |

3 |

4 |

8 |

6 |

24 |

||||||||||||

Из формулы полной верояности (18.2) легко получить одну очень важ• ную формулу, известную как формула Байеса7. Выразим совмещение собы• тий P (B ∩ Ai) с помощью условных вероятностей. Имеем

P (Ai|B)P (B) = P (B|Ai)P (Ai).

Разделив обе части формулы на P (B) и подставив для P (B) ее выражение из формулы полной верояности (18.2) получим формулу Байеса

P (A |

| |

B) = |

P (B|Ai)P (Ai) . |

(18.3) |

i |

|

Pj=1 P (B|Aj )P (Aj ) |

|

|

|

|

m |

|

Эта формула имеет следующее истолкование и применение. Предпо• ложим, что случайное событие B зависит от некоторого случайного па• раметра, который определяется заданием полной системой событий {Ai}. Известны некоторые (априорные – заданные до опыта) вероятности собы• тий Ai. Нас интересует, какое из событий осуществилось Мы проводим экс• перимент и узнаем, что осуществилось событие B. Информация об этом дает возможность пересчитать вероятности Ai – получить апостериорные вероятности.

Пример 18.4. Зная вероятности появления различных болезней и вероятности появления отдельных симптомов при той или иной болезни врач может делать различные анализы, которые постепенно изменяют вероятности наличия этих болезней у пациента. Пусть при заболева• нии гриппом с вероятностью 0.6 можно заболеть гриппом A(GA), а с вероятностью 0.4 – гриппом B(GB). При этом реакция иммунофлуорес• ценции (RI) положительна с вероятностью 0.85 в случае гриппа A и с вероятностью 0.35 в случае гриппа B. Требуется оценить вероятность

7Thomas Bayes (1702-1761).

51

того, что больной гриппом болен гриппом A, если у него реакция поло• жительная.

Подставляя числа в формулу Байеса (18.3) получаем

P (A|RI |

+ |

) = |

|

0.85 × 0.6 |

|

|

= |

0.51 |

|

≈ 0.7846. |

|

|

0.85 |

× |

0.6 + 0.35 |

× |

0.4 |

0.51 + 0.14 |

|||||

|

|

|

|

|

|

|

|

|

|

||

и диагноз склоняется в сторону гриппа A.

18.3.Случайные величины. Математическое ожидание и дисперсия

Введем в рассмотрение функции от элементарных событий.

Пусть Ω = {ω} – множество элементарных событий. Заданная на Ω функция f : Ω → R1 называется случайной величиной.

Случайные величины ξ и η называются независимыми, если для лю• бых a, b R1 независимы события ξ = a и η = b, то есть если

P (ξ = a, η = b) = P (ξ = a) × P (η = b).

Из этого определения следует, что для независимых случайных вели• чин независимы любые события ξ A и η B.

Легко определить и взаимную независимость нескольких случайных

величин. |

|

|

Величина |

X |

X |

|

||

|

Eξ = ξ(ω)pω = |

a × P (ξ = a) |

|

ω |

a |

называется математическим ожиданием случайной величины ξ.

Замечание 18.2. Математическое ожидание похоже на центр тя• жести системы материальных точек – если считать вероятности зна• чений случайной величины массами точек, то получается в точности та же формула.

Теорема 18.1. Справедливы следующие свойства математического ожидания:

1)Если P (ξ = a) = 1, то Eξ = a.

2)Если ξ и η – две случайные величины, то E(ξ + η) = Eξ + Eη.

3)Если η = bξ, где b R1, то Eη = bEξ.

Доказательство. Все три свойства очевидным образом следуют из определения.

52

Математическое ожидание квадрата отклонения случайной величины от ее математического ожидания называется дисперсией этой случайной величины:

Dξ = E(ξ − Eξ)2. |

(18.4) |

Замечание 18.3. Дисперсия характеризует разброс случайной вели• чины вокруг ее математического ожидания. Продолжая аналогии с ме• ханикой можно заключить, что дисперсия – это момент интерции си• стемы материальных точек.

Если в (18.4) раскрыть скобки, то получится еще одно выражение для

дисперсии:

Dξ = Eξ2 − (Eξ)2.

Теорема 18.2. Справедливы следующие свойства дисперсии:

1)Если P (ξ = a) = 1, то Dξ = 0.

2)Если η = ξ + a,где a R1, то Dξ = Dη.

3)Если η = bξ, где b R1, то Dη = b2Dξ.

4)Если η и ξ – две независимые случайные величины, то

D(ξ + η) = Dξ + Dη.

Доказательство. Первые три свойства очевидны. Докажем четвер• тое. По определению дисперсии

D(ξ + η) = E(ξ + η − E(ξ + η))2 = E(ξ − Eξ + η − Eη)2 =

=E(ξ − Eξ)2 + 2E((ξ − Eξ)(η − Eη)) + E(η − Eη)2 =

=Dξ + Dη + 2(Eξη − EξEη).

Осталось показать, что Eξη − EξEη = 0. Действительно

X |

|

X |

Eξη = |

abP (ξ = a, η = b) = abP (ξ = a)P (η = b) = |

|

a,b |

X |

a,b |

X |

|

|

= |

aP (ξ = a) bP (η = b) = EξEη. |

|

a |

b |

|

Замечание 18.4. Величина m(ξ, η) = Eξη − EξEη может служить показателем зависимости случайных величин. Очевидно, что

m(ξ, η)

−1 6 ρ(ξ, η) = √DξDη 6 1.

53

Этот коэффициент ρ(ξ, η) называется коэффициентом корреляции этих случайных величин. Предельные значения он принимает, когда случайные величины связаны линейной зависимостью.

18.4.Схема Бернулли

Рассмотрим последовательность независимых одинаково распределен• ных случайных величин

δ1, δ2, . . . , δn, . . . ,

каждая из которых принимает два значения: 1 с вероятностью p и 0 с вероятностью q = 1 − p. Такая вероятностная схема называется схемой Бернулли.

Случайная величина ξn, получающаяся при сложении n таких случай• ных величин δi, имеет распределение, называемое распределением Бернул• ли. Его легко найти: для того, чтобы ξn = k нужно, чтобы ровно k из случайных величин δ1, . . . , δn принимали значение 1, а остальные должны равняться нулю. Вероятность этого события при фиксированных местах единиц и нулей равна pkqn−k, и если учесть все Cnk положений этих мест,

получим

P (ξn = k) = Cnkpkqn−k

Для того, чтобы подсчитать математическое ожидание и дисперсию для распределения Бернулли воспользуемя свойствами математического ожидания и дисперсии, в силу которых

X |

X |

|

Eξn = Eδi, Dξn = Dδi. |

||

i 1:n |

i 1:n |

|

Очевидно, что |

|

|

Eδi = Eδi2 = p, Dδi = p − p2 |

= pq, |

|

и следовательно, |

|

|

Eξn = np, |

Dξn = npq. |

|

19.Вокодеры

Термин ”вокодер“, впервые введенный Дадли [5] в 1939 году, пред• ставляет собой сокращение словосочетания ”kодер голоса“ (voice coder). Голосовой тракт человека представляет собой неоднородную акустическую трубу, простирающуюся от голосовой щели до губ. Одной из основных про• блем являлось разделение функции возбуждения (частоты основного тона)

54

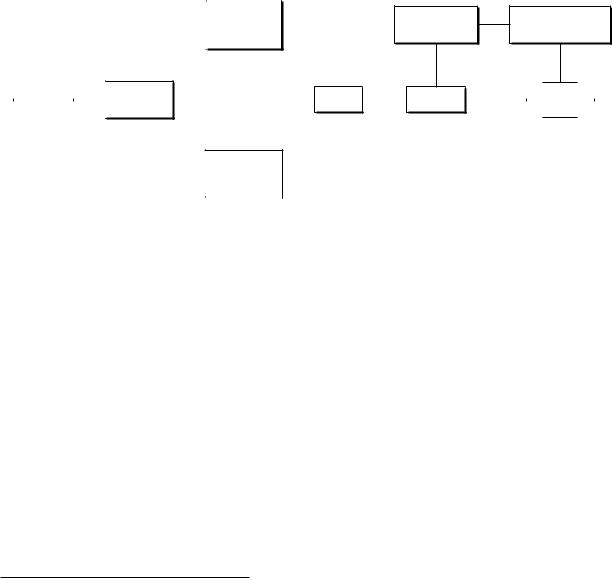

от состояния голосового тракта (формантной структуры8 ). Эти задача была решена применением методов линейного предсказания речи (Linear Predictive Coding - LPC). На следующем рисунке представлена структур• ная схема LPC-вокодера, возбуждаемого квазипериодическим сигналом.

|

|

|

|

|

|

|

Анализ |

|

|

|

|

|

|

|

|

|

параметров |

|

|

|

|

|

|

|

|

|

фильтра |

|

|

|

|

|

|

|

|

|

:: |

F |

|

|

|

|

|

|

|

|

v |

F |

|

|

|

|

|

|

|

v |

|

F |

|

|

|

|

|

|

|

v |

|

F |

|

|

|

|

|

|

|

v |

|

F |

|

|

|

|

|

|

|

v |

|

F |

|

|

|

|

|

|

|

v |

|

F |

|

|

|

|

|

|

|

v |

|

F |

|

|

|

|

|

|

vv |

|

F |

||

Входной |

|

|

Пред. |

|

|

|

F"" |

||

ON |

ML |

|

// |

|

|

|

|

Кодер |

|

HI |

JK |

|

|

обработка |

|

|

|

|

|

сигнал |

|

|

|

|

|

xxx<< |

|||

|

|

|

|

|

HHH |

|

|||

|

|

|

|

|

|

||||

|

|

|

|

|

|

H |

|

x |

|

|

|

|

|

|

|

H |

|

x |

|

|

|

|

|

|

|

H |

|

x |

|

|

|

|

|

|

|

H |

|

x |

|

|

|

|

|

|

|

H |

|

x |

|

|

|

|

|

|

|

|

H$$ |

xx |

|

|

|

|

|

|

|

|

Оценивание |

|

|

|

|

|

|

|

|

|

основного |

|

|

|

|

|

|

|

|

|

тона |

|

|

|

|

|

|

|

|

|

|

|

|

Сигнал

возбуждения

OO

// Декодер

// Декодер

// Синтезирующий фильтр

ONВыходнойML HI JK

сигнал

Структурно вокодер состоит из двух частей. Первая часть анали• затор, функции которого заключаются в выделении текущих параметров речевого сигнала и их упаковке в кадр соответствующего формата.

Сигнал обрабатывается кадр за кадром, причем длина фрагментов мо• жет быть переменной. На каждом кадре выполняется оценивание периода основного тона одновременно с классификацией ”тон-шум“. Проводится анализ коэффициентов фильтра линейного предсказания и определяется коэффициент усиления σ, представляющего собой некоторую функцию от энергии речевого сигнала. Далее следует процедура кодирования получен• ных при анализе данных.

Вторая часть синтезатор по принятому кадру восстанавливает с некоторой ошибкой параметры текущего фрагмента сигнала и с их помо• щью воспроизводит синтетическую речь.

Кодовые символы декодируются с целью получения оценок парамет• ров основного тона и коэффициентов фильтра линейного предсказания. За• тем формируется сигнал возбуждения на основе переданных параметров

8Формантами называют устойчивые виды резонансных колебаний голосового трак• та. С точки зрения ДПФ, форманты – это максимумы спектра соответствующего глас• ного звука. Заметим, что при восприятии звуков на слух основную роль играют только первые три форманты. В следующей таблице приведены формантные частоты (в гц.) некоторых гласных звуков английского языка.

Звук |

Типичное слово |

F1 |

F2 |

F3 |

|

|

|

|

|

i |

beet |

270 |

2290 |

3010 |

a |

hot |

730 |

1090 |

2440 |

u |

food |

440 |

1020 |

2240 |

e |

bet |

530 |

1840 |

2480 |

55

основного тона и признака ”тон-шум“. Далее сигнал возбуждения поступа• ет на синтезирующий фильтр. Коэффициент усиления σ используется до и после синтеза для согласования энергии синтезированной речи с энергией реального речевого сигнала.

Замечание 19.1. В данной схеме не учитываются ошибки канала связи (кодер → декодер), но защита от ошибок в канале требует суще• ственного увеличения скорости передачи информации.

В качестве предваритeльной обработки речевого сигнала xn обычно используется предискажение (дифференцирование) с помощью фильтра первого порядка с характеристикой 1 − µz−1. Дифференцирование сигна• ла необходимо для подчеркивания формант. Оптимальное значение µ в смысле максимизации равномерности спектра на выходе предискажающе• го фильтра будет следующим

r1 µ = r0,

где ri коэффициенты автокорреляции в (19.1).

Важным моментом является преобразование найденных коэффициен• тов фильтра линейного предсказания в форму, позволяющую их оптималь• ное кодирование. В противном случае, после декодирования не гарантиро• вана устойчивость работы синтезирующего фильтра.

Можно отметить возможность использования кодовой книги для ко• дирования и декодирования коэффициентов фильтра линейного предска• зания. Для работы синтезатора основного тона иногда используют адап• тивную кодовую книгу.

Введем следующие обозначения: xn последовательность отсчетов входного речевого сигнала, ai коэффициенты фильтра линейного пред• сказания. Для общей модели линейного предсказания подробно исследова• ны два случая:

Автокорреляционный метод. Решается система

XM

air|i−j| = −rj , j = 1, 2, . . . , M, |

(19.1) |

|

i=1 |

|

|

где |

N −1−i |

|

|

|

|

ri = |

X |

|

xnxn+i, i > 0, |

(19.2) |

|

n=0

56

при этом N длина кадра. Погрешность предсказания имеет вид

XM

en = xn + |

aixn−i, |

n = 0, 1, . . . , N + M − 1. |

(19.3) |

|

i=1 |

|

|

Ковариационный метод. Решается система |

|

||

M |

|

|

|

X |

aicij = −c0j , |

j = 1, 2, . . . , M, |

(19.4) |

i=1 |

|

|

|

где |

N −1 |

|

|

|

|

||

|

X |

|

|

|

cij = |

xn−ixn−j . |

(19.5) |

|

n=M |

|

|

Погрешность предсказания имеет вид |

|

||

M |

|

|

|

X |

aixn−i, n = M, M + 1, . . . , N − 1. |

|

|

en = xn + |

(19.6) |

||

i=1

Для вывода систем (19.1) и (19.4) использовался критерий минимума суммы квадратов погрешности предсказания en.

Замечание 19.2. Основную вычислительную нагрузку в LPC-воко• дерах несет оценивание периода основного тона и классификация ”тон• шум“, т. е. различения звонких и глухих звуков. Кроме того, качество синтезируемого речевого сигнала очень сильно зависит от правильности решения задачи оценивания. Один из наиболее известных алгоритмов ре• шения этой задачи описан в [6].

20.Адаптивный линейный сумматор

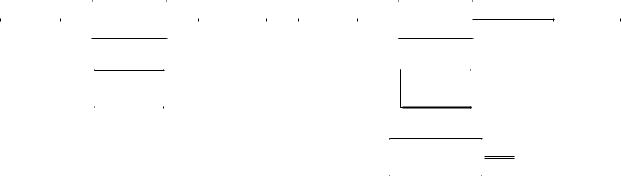

Адаптивные системы можно разделить на системы без обратной связи и с обратной связью. Оба принципа адаптации показаны на следующем рисунке.

|

|

|

|

|

|

|

|

|

|

Устройство |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Устройство |

|

|

|

|

|

|

|

|

||||||

|

|

Входной |

|

|

|

Выходной |

|

Входной |

|

|

|

|

|

|

|

|

|

Выходной |

|||||||||||||||||||||

ON |

|

ML |

|

// |

|

|

|

|

|

/ON/ |

|

ML |

ON |

|

ML |

|

|

// |

|

|

|

|

|

|

|

|

• |

/ON/ |

|

ML |

|||||||||

HI |

|

JK |

|

|

|

обработки |

|

HI |

|

JK |

HI |

|

JK |

|

|

|

|

обработки |

|

|

|

|

|

HI |

|

JK |

|||||||||||||

|

|

сигнал |

|

|

|

|

сигнал |

|

сигнал |

|

|

|

|

|

|

|

|

|

|

сигнал |

|||||||||||||||||||

|

|

|

|

IIII |

|

|

|

|

OO |

|

|

|

|

|

|

|

|

888 |

|

|

|

|

|

|

|

|

OO |

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||

|

|

|

|

|

|

|

IIII |

|

|

|

|

|

|

|

|

|

|

888 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||

|

|

|

|

|

|

|

|

|

I$$ |

|

|

|

|

|

|

|

|

|

|

|

|

|

888 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Доп. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Алгоритм |

|

|

|

|

|

|

|

|

|

|||||||||||

|

|

|

|

|

Алгоритм |

|

|

|

|

|

|

|

|

|

|

|

8 |

|

|

|

|

|

|

|

|

|

|

||||||||||||

|

|

ON |

|

ML |

|

|

|

// адаптации |

|

|

|

|

|

|

|

|

|

|

|

88 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||

|

|

HIданныеJK |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

адаптации |

|

|

|

|

|

|

|

|||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

888 |

888 |

|

OO |

|

|

|

|

|

|

|

|||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

88 |

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Доп. |

|

|

|

Вычисление |

|

|

|

|

|

|

|||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

ON |

ML |

|

|

|

// характеристик |

k |

s |

|

|

|

|

|||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

• |

|

|

|

|||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

HIданныеJK |

|

|

|

|

|

|

|

|||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

57

Обратная связь показана двойной линией.

Под алгоритмом адаптации как правило понимают адаптивный линей• ный сумматор одно из фундаментальных понятий адаптивной обработ• ки сигналов. Схема одного из вариантов адаптивного сумматора показана на следующем рисунке

z−1 |

|

z−1 |

|

//yk−1 |

|

|

|

|

z−1 |

|

//yk−2 |

|

|

|

z−1 |

|

|

|

|

|

|

|

|

|

z−1 |

|

|

|

//yk−L |

|

||||||||||||||||||||||||

|

//yk |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

//· · · |

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

× |

|

|

|

|

|

× |

|

|

|

|

|

|

|

|

× |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

× |

|

|

|||||||||||

89:;?>=< |

|

|

|

|

|

89:;?>=< |

|

|

|

|

|

|

|

|

89:;?>=< |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

89:;?>=< |

|

|

||||||||||||

w |

|

0k X |

|

|

|

|

|

w |

|

1k |

V |

|

|

|

|

|

w |

|

2k |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

w |

|

Lk |

|

|||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||||

|

|

|

|

X |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Q |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||

|

|

|

|

|

XX |

|

|

|

|

|

|

|

V |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||

|

|

|

|

|

|

X |

|

|

|

|

|

|

|

V |

|

|

|

|

|

|

|

|

|

|

Q |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

X |

|

|

|

|

|

|

|

V |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||

|

|

|

|

|

|

|

|

XXXX |

|

|

|

|

VVV |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||

|

|

|

|

|

|

|

|

|

|

XXXX |

|

|

|

|

VVV |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||

|

|

|

|

|

|

|

|

|

|

|

|

XXX |

|

|

|

VV |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

X |

|

|

|

|

V |

|

|

|

|

|

|

|

|

|

Q |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

X |

|

|

|

|

V |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

XXXX |

|

|

|

|

VVV |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

XXXX |

|

|

|

|

|

|

VVV |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

XXX |

|

|

|

|

VV |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

X |

|

|

|

|

V |

|

|

|

|

Q |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

X |

|

|

|

|

V |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

XXXX |

|

VVV |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

XXXX |

VVV |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

XXX |

|

|

VV |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

X |

|

|

V |

|

|

|

Q |

|

|

|

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

X |

|

|

V |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

XX |

|

|

V |

|

|

Q |

|

|

|

|

|

|

|

|

|

|

||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

XX |

|

VV |

|

|

|

Q |

|

|

|

|

|

|

|

|

|

||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

XXX VV |

|

Q |

|

|

|

|

|

|

|

|||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

X |

|

V |

|

Q |

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

XXVVQ |

|

|

|

|

|

|

|||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

XXVQ |

|

|

|

|

|

|||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

XXV(( |

|

|

|

|

|

||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

,*,* |

Σ |

xbk |

|||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

@ABCGFED |

|

// |

|||

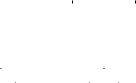

Это схема с одним входом с элементами задержки. Часто такую структуру называют адаптивным трансверсальным фильтром. Обозначим через

Wk = (w0k, w1k, . . . , wLk), Yk = (yk, yk−1, . . . , yk−L)

векторa весовых коэффициентов и входного (наблюдаемого) сигнала в мо• мент времени k. Тогда значения выходного сигнала адаптивного сумматора в момент времени k выражаются формулой

XL

xk = |

wikyk−i = hWk, Yki = WkT Yk. |

(20.1) |

b |

i=0 |

|

Рассмотрим принцип работы данной схемы и изучим влияние зависи• мости вектора Wk от индекса времени k. Адаптивный линейный сумматор можно использовать в системах как с обратной, так и без обратной связи. В системе без обратной связи процесс изменения весовых коэффициентов в явном виде не зависит от выходного сигнала и определяется только вход• ным сигналом и состоянием окружающей среды (дополнительные парамет• ры).

Однако в системе с обратной связью вектор весовых коэффициентов зависит от выходного сигнала, а также от других данных, под которыми будем понимать полезный отклик или обучающий сигнал.

В процессе адаптации с функциональной обратной связью вектор весо• вых коэффициентов линейного сумматора корректируется таким образом, чтобы выходной сигнал xbk имел наилучшее приближение к полезному от• клику. Для этого выходной сигнал сравнивается с полезным откликом, фор• мируется сигнал ошибки и затем корректируется вектор весовых коэффи• циентов, минимизирующий сигнал ошибки. В подавляющем большинстве

58

практических приложений процесс адаптации направлен на минимизацию среднеквадратического значения (или средней мощности) сигнала ошибки. На следующем рисунке показан способ получения сигнала ошибки за счет введения полезного отклика. Для формирования сигнала ошибки ǫk выход• ной сигнал xbk просто вычитается из полезного (опорного) сигнала xk.

z−1 |

//yk |

|

z−1 |

//yk−1 |

|

|

z−1 |

|

//yk−2 |

|

|

z−1 |

|

|

|

//· · · |

|

|

z−1 |

|

|

//yk−L |

|

|

|

|

|

|

|

|

||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

× |

|

|

|

× |

|

|

|

|

|

|

|

× |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

× |

|

|

|

|

|

|

|

|

|

|||||||||

89:;?>=< |

|

|

|

89:;?>=< |

|

|

|

|

|

|

|

89:;?>=< |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

89:;?>=< |

|

|

|

|

|

|

|

|

|

||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Опорный |

||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||||

w0k X |

|

|

|

w1k |

|

|

|

|

|

|

|

w2k |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

wLk |

|

ON |

ML |

|||||||||||||||||

|

|

|

UU |

|

|

|

|

|

|

P |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

HI |

JK |

|||||||||||||||||||||||

|

|

|

XXX |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

сигнал |

|||||||||||

|

|

|

|

X |

|

|

|

|

|

U |

|

|

|

|

|

|

|

|

|

|

P |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

X |

|

|

U |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||

|

|

|

|

|

|

XXXX |

|

|

|

UUU |

|

|

|

|

|

|

|

PP |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||

|

|

|

|

|

|

|

XXX |

|

|

|

|

|

UU |

|

|

|

|

|

|

|

|

P |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||

|

|

|

|

|

|

|

|

|

X |

|

|

|

|

U |

|

|

|

|

|

|

P |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||

|

|

|

|

|

|

|

|

|

|

XXX |

|

|

|

|

UU |

|

|

|

|

|

|

|

PP |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||

|

|

|

|

|

|

|

|

|

|

|

|

X |

|

|

|

|

|

U |

|

|

|

|

|

|

|

|

P |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|

|

|

|

X |

|

|

|

|

|

U |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

XXXX |

|

|

|

|

UUU |

|

|

|

|

|

PP |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

+ |

xk |

||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

XXXX |

|

|

|

UUU |

|

|

|

|

PP |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

XXXX |

|

UUU |

|

|

PP |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

X |

|

|

|

U |

|

|

P |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

XX |

|

|

U |

|

|

P |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

X |

|

|

U |

|

|

P |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

X |

|

|

U |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

XXXXUUU |

PP |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

XX |

|

U |

|

P |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

XXUU |

|

P |

|

|

|

|

|

k |

|

|

|

|

|

|

|||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

XXU |

|

P |

|

|

|

|

|

|

|

|

|

|

|

|

|||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

XXUU |

P |

|

|

|

|

x |

|

|

|

|

|

|

|

|||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

XU'' |

b |

|

|

|

|

|

|

//ǫk |

|||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

X+*+* |

|

|

|

|

|

|

|

||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

@ABCGFED |

|

|

|

|

/@ABCGFED/ |

|

|

|||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Σ |

|

− |

|

|

Σ |

|

|

|

|||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Источник полезного сигнала xk определяется кокретным применением адаптивного сумматора. Будем считать, что такой сигнал уже имеется. Из (20.1) следует, что сигнал ошибки фильтра в момент времени m определя• ется как

ǫm = xm − xbm = xm − WmT Ym = xm − hWm, Ymi. |

(20.2) |

21.Рекурсивный метод наименьших квадратов (RLS)

Из (20.2) получаем мгновенное квадратичное значение сигнала ошиб•

ки

ǫm2 = xm2 + hWm, Ymi2 − 2xm hWm, Ymi. |

(21.1) |

Процесс адаптации основан на минимизации среднего квадрата ошиб• ки. Считаем, что весовые коэффициенты не корректируются, т. е. случай• ными величинами являются только входной и опорный сигналы. Тогда из (21.1) имеем

E{ǫm2 } = E{xm2 } − 2hWm, E{Ym xm}i + hE{YmYmT }Wm, Wmi = |

(21.2) |

= rxx − 2hWm, ryxi + hRyy Wm, Wmi, |

|

где Ryy = E{YmYmT } есть корреляционная матрица входного сигнала, а ryx = E{Ym xm} – кросс-корреляционыый вектор входного и опорного сиг• налов.

59

Мгновенное значение корреляционной матрицы входного сигнала есть

Ryy (m) = Ym Y T = |

ym−1ym |

ym2 −1 |

. . . ym−1ym−L . |

|||||

|

y |

ym2 |

ymym−1 |

. . . ymym−L |

|

|||

|

. y y |

.y |

. . .. |

y2 . |

|

|||

m |

|

. |

. |

. |

. |

. |

|

|

b |

|

. |

. |

|

. |

|

|

|

|

m−L m−1 |

|

|

− |

|

|||

m−L m |

|

|

m |

L |

|

|||

Корреляционная матрица входного сигнала есть математическоен ожи• дание мгновенных значений корреляционной матрицы, то есть

Ryy = |

{ byy ( |

m |

)} |

. |

(21.3) |

|

E R |

|

Корреляционная матрица Ryy и ее собственные оказываются важными со• ставляющими процесса адаптации. Рассмотрим некоторые способы получе• ния оценки Ryy . Допустим, что мы наблюдаем за адаптивной системой в течении N моментов времени. Тогда простейшая оценка

1 |

N −1 |

|

|

|

|

X b |

|

Ryy ≈ |

N |

m=0 Ryy (m). |

(21.4) |

Иногда используют оценку с экспоненциальным окном ”забывания“, пере• считывая ее в каждый новый момент наблюдения m

Ryy ≈ λRyy + Ym YmT , |

(21.5) |

где λ (0, 1) коэффициент ”забывания“.

Обозначим через λmax и λmin наибольшее и соответственно наимень• шее собственные числа корреляционной матрицы Ryy . Скорость сходимо• сти рассматриваемых ниже адаптивных алгоритмов пропорциональна раз• маху корреляционной матрицы ρ

ρ= λmax. λmin

Таким образом, получив оценку корреляционной матрицы наблюдаемого сигнала Ryy и вычислив ее собственные числа, можно оценить скорость сходимости процесса адаптации.

Квадратная матрица A называется положительно определенной, если

hAX, Xi > 0, при kXk > 0. |

(21.6) |

Легко показать, что положительно определенная матрица является невы• рожденной. Действительно, предположим, что положительно определен• ная матрица A вырождена. Тогда существует вектор X, такой что

AX = 0, kXk > 0.

60