- •1. Особенности экспертных систем, архитектура

- •2. Области применения эс

- •3. Основные модели бз экспертных систем

- •4. Способы учёта неопределенности данных экспертных систем

- •Классическая вероятность

- •Аксиомы теории вероятности

- •Апостериорная вероятность

- •Априорная вероятность

- •Субъективная вероятность

- •5. Основные положения маи: шкала, правила оценки согласованности, формирование интегральной оценки.

- •6.Понятие нечётких величин, алгоритм нечёткого управления, метод Такаги-Сугена. Нечеткие множества

- •Нечеткие сети tsk (Такаги-Сугено-Канга)

Субъективная вероятность

При определении вероятности события применяется также еще один тип вероятности, который называется субъективной вероятностью. Понятие субъективной вероятности распространяются на события, которые не являются воспроизводимыми, и не имеют исторической основы, с помощью которой можно было бы осуществлять экстраполяцию. Такую ситуацию можно сравнить с бурением нефтяной скважины на новой площадке. Однако оценка субъективной вероятности, сделанная экспертом, лучшая, по сравнению с полным отсутствием оценки. Субъективная вероятность, фактически, представляет собой убеждение или мысль, выраженную в виде вероятности, а не объективное значение вероятности, основанное на аксиомах и эмпирических измерениях. Убеждения и мнения экспертов выполняют важную роль в экспертных системах.

5. Основные положения маи: шкала, правила оценки согласованности, формирование интегральной оценки.

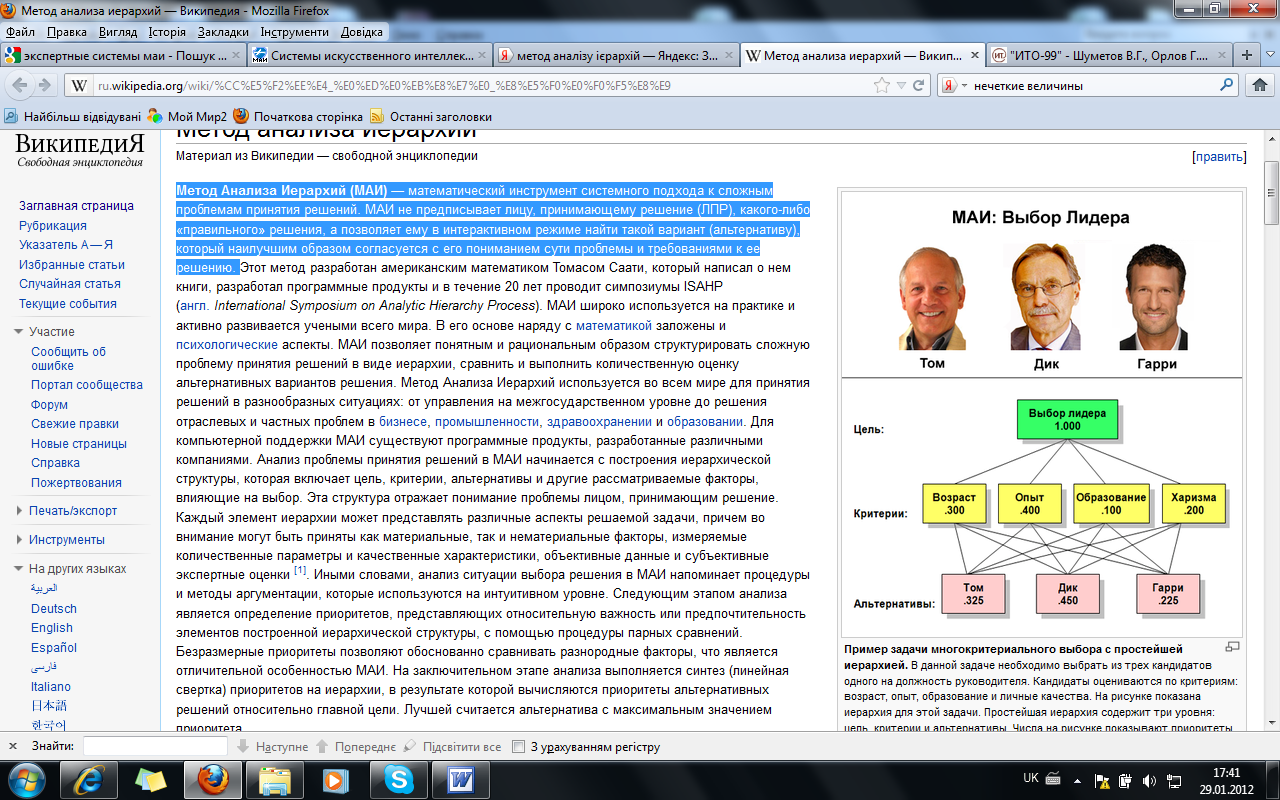

Метод Анализа Иерархий (МАИ) — математический инструмент системного подхода к сложным проблемам принятия решений. МАИ не предписывает лицу, принимающему решение (ЛПР), какого-либо «правильного» решения, а позволяет ему в интерактивном режиме найти такой вариант (альтернативу), который наилучшим образом согласуется с его пониманием сути проблемы и требованиями к ее решению.

Порядок применения Метода Анализа Иерархий:

Построение качественной модели проблемы в виде иерархии, включающей цель, альтернативные варианты достижения цели и критерии для оценки качества альтернатив.

Определение приоритетов всех элементов иерархии с использованием метода парных сравнений.

Синтез глобальных приоритетов альтернатив путем линейной свертки приоритетов элементов на иерархии.

Проверка суждений на согласованность.

П

ринятие

решения на основе полученных результатов.

[9]

ринятие

решения на основе полученных результатов.

[9]

6.Понятие нечётких величин, алгоритм нечёткого управления, метод Такаги-Сугена. Нечеткие множества

Понятие нечетких множеств (fuzzy sets) как

обобщение обычных (четких) множеств

было введено Л.Заде в 1965 г.. Традиционный

способ представления элемента множества

![]() состоит

в применении характеристической функции

состоит

в применении характеристической функции

![]() ,

которая равна 1, если элемент принадлежит

множеству

,

или равна 0 в противном случае. В нечетких

системах элемент может частично

принадлежать любому множеству. Степень

принадлежности множеству

,

представляющая собой обобщение

характеристической функции, называется

функцией принадлежности

,

причем

,

которая равна 1, если элемент принадлежит

множеству

,

или равна 0 в противном случае. В нечетких

системах элемент может частично

принадлежать любому множеству. Степень

принадлежности множеству

,

представляющая собой обобщение

характеристической функции, называется

функцией принадлежности

,

причем

![]() ,

и

,

и

![]() означает

отсутствие принадлежности

означает

отсутствие принадлежности

![]() множеству

,

а

множеству

,

а

![]() -

полную принадлежность. Конкретное

значение функции принадлежности

называется степенью или коэффициентом

принадлежности.

-

полную принадлежность. Конкретное

значение функции принадлежности

называется степенью или коэффициентом

принадлежности.

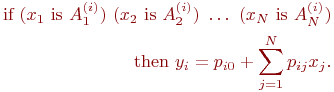

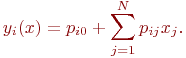

Нечеткие сети tsk (Такаги-Сугено-Канга)

Схема вывода в модели TSK при использовании

![]() правил

и

правил

и

![]() переменных

переменных

![]() имеет

вид

имеет

вид

![]()

Условие

![]() реализуется

функцией фазификации

реализуется

функцией фазификации

![]()

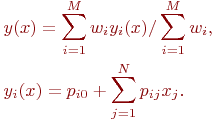

При правилах агрегированный выходной результат сети имеет вид

|

(1) |

Веса

![]() интерпретируются

как значимость компонентов

интерпретируются

как значимость компонентов

![]() .

Тогда формуле (1) можно поставить в

соответствие многослойную нейронную

сеть рис. 3.

.

Тогда формуле (1) можно поставить в

соответствие многослойную нейронную

сеть рис. 3.

Рис. 3. Нечеткая нейронная сеть TSK

1. Первый слой выполняет фазификацию

каждой переменной. Это параметрический

слой с параметрами

![]() ,

подлежащими адаптации в процессе

обучения.

,

подлежащими адаптации в процессе

обучения.

2. Второй слой выполняет агрегирование

отдельных переменных, определяя

результирующее значение коэффициента

принадлежности

![]() для

вектора

(непараметрический

слой).

для

вектора

(непараметрический

слой).

3. Третий слой - генератор функции TSK, рассчитывает значения

В этом слое также производится умножение

![]() на

,

сформированные в предыдущем слое. Здесь

адаптации подлежат веса

на

,

сформированные в предыдущем слое. Здесь

адаптации подлежат веса

![]() ,

определяющие функцию следствия модели

TSK.

,

определяющие функцию следствия модели

TSK.

4. Четвертый слой составляют два

нейрона-сумматора, один из которых

рассчитывает взвешенную сумму сигналов

![]() ,

а второй - сумму весов

,

а второй - сумму весов

![]() (непараметрический

слой).

(непараметрический

слой).

5. Пятый слой из одного нейрона - это нормализующий слой, в котором выходной сигнал сети агрегируется по формуле (1).

Таким образом, в процессе обучения происходит уточнение параметров только первого (нелинейного) и третьего (линейного) слоев.