- •7 Регресійний аналіз

- •7.1 Попередній аналіз даних

- •7.2 Припущення, які використовує регресійний аналіз

- •7.3 Вибір вигляду функції для монотонних процесів

- •7.4 Метод найменших квадратів для оцінки параметрів функції регресії

- •Властивості регресії

- •7.5 Оцінка якості моделі

- •7.6 Критерій Фішера для оцінки адекватності моделі

- •7.7 Перевірка значущості коефіцієнтів регресії

- •7.8 Функції Excel для побудови регресійних залежностей

- •Розв’язання

- •7.9 Парна регресія в матричній формі

- •7.10 Метод найменших квадратів при оцінюванні параметрів поліномів

- •Розв’язання

- •7.11 Множинний регресійний аналіз

- •7.11.1 Матричний спосіб оцінки параметрів множинної регресії

- •7.11.2 Перевірка значущості коефіцієнтів регресії

- •7.11.3 Перевірка якості моделі. Скоригований коефіцієнт детермінації

- •7.11.4 Парна й часткова кореляції

- •Розв’язання.

- •7.12 Методи побудови багатофакторної регресійної моделі

- •7.12.1 Вибір "найкращого" рівняння регресії

- •7.12.2 Метод усіх можливих регресій

- •7.12.3 Метод виключень

- •7.12.4 Кроковий регресійний метод

- •Питання і завдання до розділу 7

- •Лабораторна робота Тема. Парний регресійний аналіз

- •Лабораторна робота Тема. Множинний регресійний аналіз

- •8 Дисперсійний аналіз

- •8.1 Однофакторний дисперсійний аналіз

- •Розв’язання.

- •Питання і завдання до розділу 8

- •Лабораторна робота Тема. Однофакторний дисперсійний аналіз

- •9 Ранговий аналіз

- •9.1 Коефіцієнт рангової кореляції Кенделла (Кендалла)

- •9.2 Коефіцієнт рангової кореляції Спірмена

- •Розв’язок.

- •9.3 Коефіцієнт конкордації

- •Питання і завдання до розділу 9

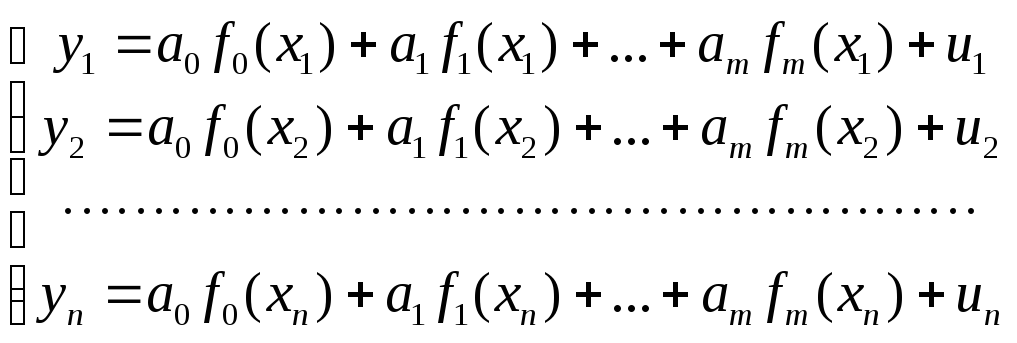

7.9 Парна регресія в матричній формі

Нехай є вибірка з n спостережень (x1, y1), (x2, y2), ..., (xn, yn) для змінних Y і Х. Рівняння регресії шукаємо у вигляді

![]() ,

i = 1,

2, ..., n

(7.9)

,

i = 1,

2, ..., n

(7.9)

або в розгорнутому вигляді

.

(7.10)

.

(7.10)

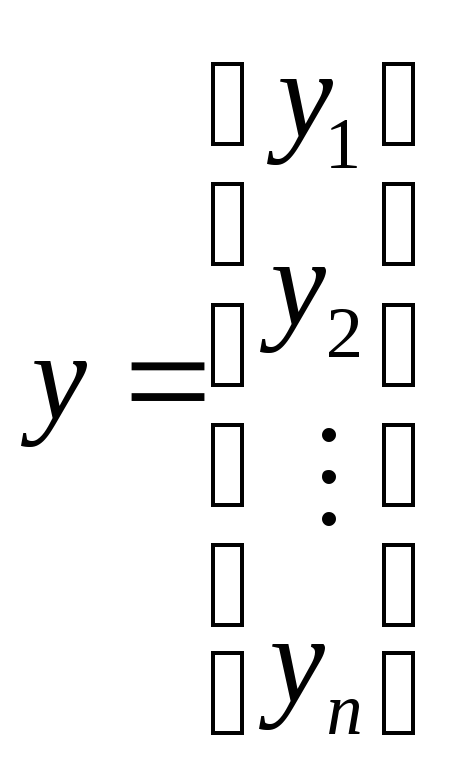

Розглянемо вектори-стовпці

,

,

,

,![]()

і

матрицю розмірності n![]() (m+1):

(m+1):

.

.

Тоді, відповідно до правил множення й додавання матриць, матричний запис системи рівнянь (7.10) набуває вигляду

![]() .

(7.11)

.

(7.11)

Припустимо,

що n >

m+1, тобто число спостережень

перевищує число параметрів моделі. У

протилежному випадку неможлива оцінка

параметрів. Вважаємо також, що функції

f0(x)=1,

f1(x),

..., fm

(x) -

лінійно незалежні. У цьому випадку ранг

(число лінійно незалежних рядків або

стовпців) матриці

![]() дорівнює

m+1.

дорівнює

m+1.

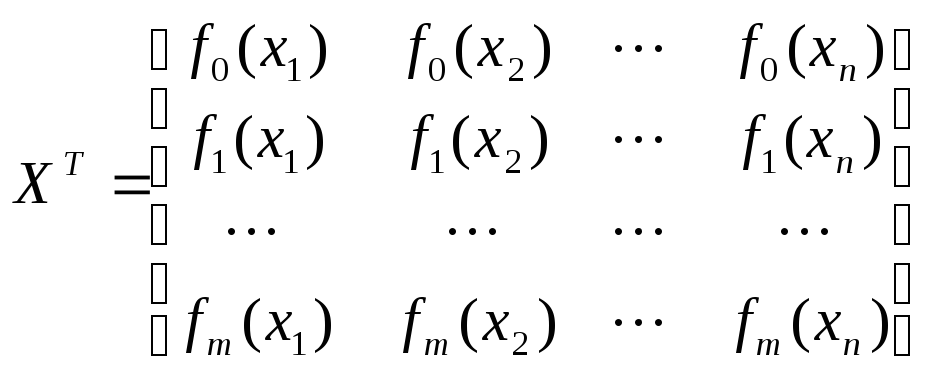

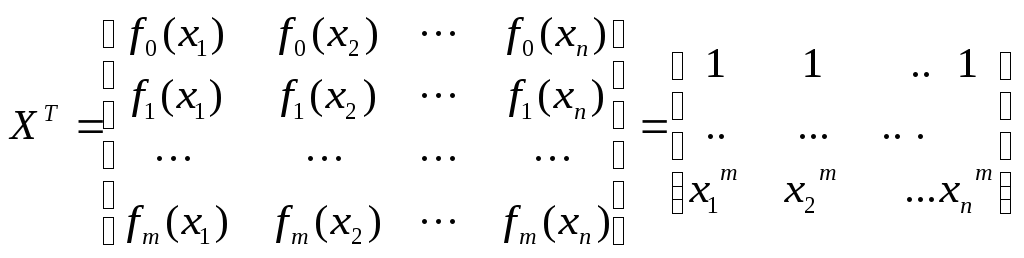

Ранг транспонованої матриці

також

дорівнює

m+1,

причому її розмірність (m+1)![]() n

. Добуток матриць

n

. Добуток матриць

![]() і

і

![]() є

симетрична матриця розмірності

(m+1)(m+1):

є

симетрична матриця розмірності

(m+1)(m+1):

(7.12)

(7.12)

Її ранг

дорівнює m+1,

тобто визначник

![]() Це означає, що матриця

Це означає, що матриця

![]() є невиродженою, отже, існує обернена

матриця

є невиродженою, отже, існує обернена

матриця

![]() ,

що відіграє основну роль у процедурі

оцінювання.

,

що відіграє основну роль у процедурі

оцінювання.

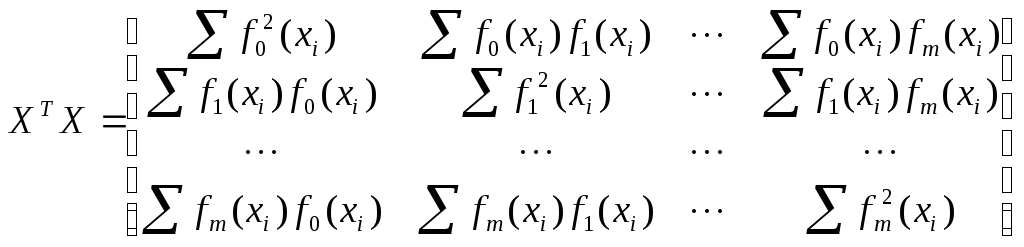

Неважко

помітити, що матриця

![]() є

матрицею системи нормальних рівнянь,

з якої визначається вектор

є

матрицею системи нормальних рівнянь,

з якої визначається вектор

![]() ,

компонентами якого є

Мнк-оцінки

параметрів а0,

а1,

..., аm

моделі (7.9). Вектор-стовпець правих частин

системи можна подати у вигляді

,

компонентами якого є

Мнк-оцінки

параметрів а0,

а1,

..., аm

моделі (7.9). Вектор-стовпець правих частин

системи можна подати у вигляді

![]() ,

тому матричний запис

цієї системи наступний:

,

тому матричний запис

цієї системи наступний:

![]() .

(7.13)

.

(7.13)

Помножимо

ліву й праву частини (7.13) ліворуч на

обернену матрицю

![]() .

Оскільки

.

Оскільки

![]() – одинична матриця

порядку m+1, за властивостями одиничної

матриці з (7.13) маємо

– одинична матриця

порядку m+1, за властивостями одиничної

матриці з (7.13) маємо

![]() .

.

7.10 Метод найменших квадратів при оцінюванні параметрів поліномів

Якщо аналіз діаграми розсіювання дозволить висунути гіпотезу про поліноміальний зв'язок між змінними Y і X:

![]() ,

(7.14)

,

(7.14)

то

в цьому випадку функція помилок є

квадратичною функцією параметрів

a0,...,am,

a часткові похідні

![]() – лінійні щодо параметрів.

– лінійні щодо параметрів.

Для того щоб знайти a0, ..., am , використовується МНК.

Умова

![]() (

(![]() ) дозволяє одержати систему рівнянь:

) дозволяє одержати систему рівнянь:

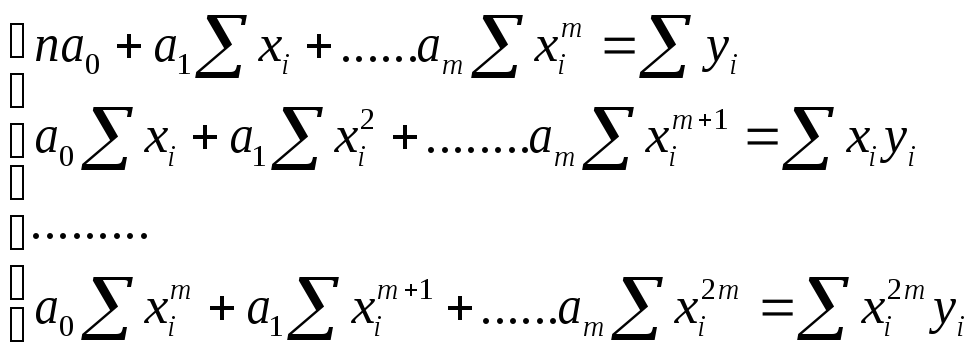

.

.

Система містить m+1 рівняння з m+1 невідомим. Якщо m< n-1, то система має єдиний розв’язок.

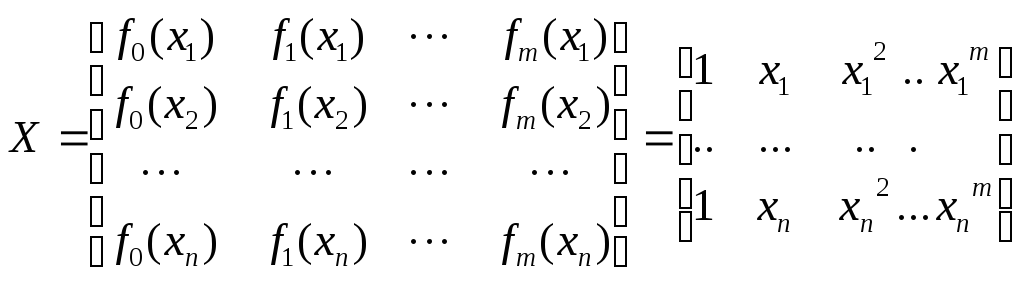

Запишемо систему рівнянь у матричному вигляді. Розглянемо вектори-стовпці

,

,

![]()

і

матрицю розмірності n![]() (m+1):

(m+1):

,

,

.

.

Вектор-стовпець

правих частин системи рівнянь можна

представити у вигляді

![]() ,

тому матричний запис

цієї системи такий:

,

тому матричний запис

цієї системи такий:

![]() .

.

Помножимо

ліву й праву частини ліворуч на обернену

матрицю

![]() .

Одержимо

.

Одержимо

![]() .

(7.15)

.

(7.15)

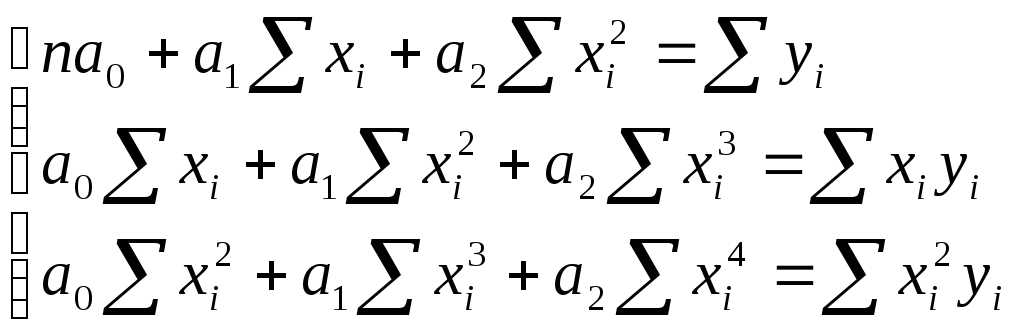

У випадку

параболічної регресії

![]() система має вигляд

система має вигляд

.

.

У

статистиці використовують правило

вибору ступеня полінома (7.14), яке базується

на визначенні величини кінцевих різниць

(якщо x змінюється з постійним кроком)

або розділених різниць (якщо крок

![]() const).

const).

Кінцева різниця 1-го порядку

![]() ,

, ![]() .

.

Розділена різниця

![]() ,

,

![]() ,

, ![]() .

.

Якщо перші різниці постійні, то для моделі обирається поліном першого ступеня.

Якщо перші різниці не постійні, але варіюються з незначними відхиленнями, і середнє арифметичне двох різниць настільки мале, що ним можна знехтувати, то перші різниці вважаються практично рівними.

Аналогічно, якщо аналізуються другі різниці, і ми прийдемо до висновку, що вони практично рівні, то для відображення ряду емпіричних даних використовують поліном другого ступеня й т.д.

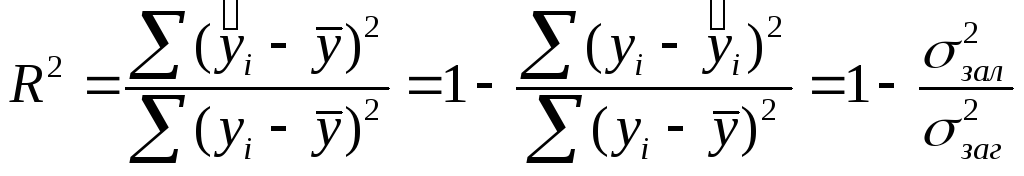

Коефіцієнт детермінації R2 розраховується так, як і для лінійної регресії:

.

.

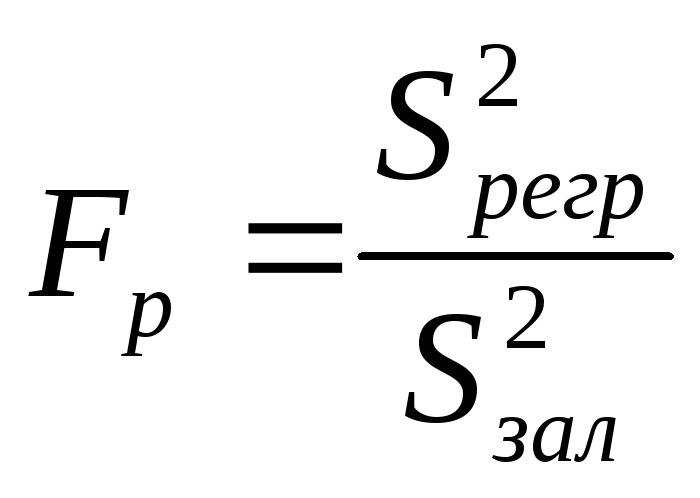

Адекватність

моделі. Розраховуємо

критеріальне значення

та критичне значення

та критичне значення

![]() ,

де

,

де

![]() ;

;

![]() ;

α – рівень значущості; k

– кількість параметрів моделі, n

– кількість спостережень.

;

α – рівень значущості; k

– кількість параметрів моделі, n

– кількість спостережень.

Значення Fкр обчислюємо за допомогою функції FРАСПОБР(α; k-1; n-k). Якщо Fp>Fkp – модель адекватна.

Приклад. Нехай для деякого підприємства відомі середні витрати на рекламу (Y тис. грн) за останні n місяців (Х).

|

X |

1 |

2 |

3 |

4 |

5 |

6 |

7 |

8 |

9 |

|

Y |

35,4 |

34,2 |

33,6 |

32,1 |

32,7 |

33,8 |

35,6 |

37,2 |

38,8 |

Необхідно:

-

записати систему рівнянь для визначення невідомих параметрів рівняння поліноміальної регресії другого порядку

=a0+a1x+a2x2

;

=a0+a1x+a2x2

; -

знайти параметри регресії;

-

обчислити коефіцієнт лінійної кореляції;

-

знайти коефіцієнт детермінації;

-

оцінити адекватність моделі за критерієм Фішера при рівні значущості α=0,01;

-

побудувати графік;

-

зробити прогноз витрат на рекламу до кінця року.