- •1:В чём заключается идея коннективизма?

- •2 И 3:из чего состоит биологический нейрон?

- •4:Классическая модель формального нейрона

- •5:Что такое функция активации?

- •7:Что такое сигмаидальный нейрон?

- •8:Адалайн-нейтрон

- •9:Паде-нейрон

- •10: История развития нейрокопьютера

- •15:Однослойные нейронные сети

- •16:Многослойные нейронные сети Ответ: многослойные искусственные нейронные сети

- •Нелинейная активационная функция

- •17:Сети с обратными связями Ответ: Сети с обратными связями

- •18:Нейроэмулятор

- •19: Нейрочипы: анализ и сравнительные характеристики

- •20: Нейрокомпьютеры, реализованные на базе пцос и плис

- •21:Однослойный персептрон

- •23:Многослойный персептрон

- •Вопрос 25:аглоритм обратного распространения ошибки

- •34 Радиальные сети

- •35:Обучение радиальной сети

- •36: Рекуррентные нейронные сети

- •38: Обучение сети Хопфилда

- •42:Персептронная сеть с обратной связью

- •44,Алгоритмы обучения

- •Алгоритм нейронного газа

- •50:Методы редукции нейронной сети

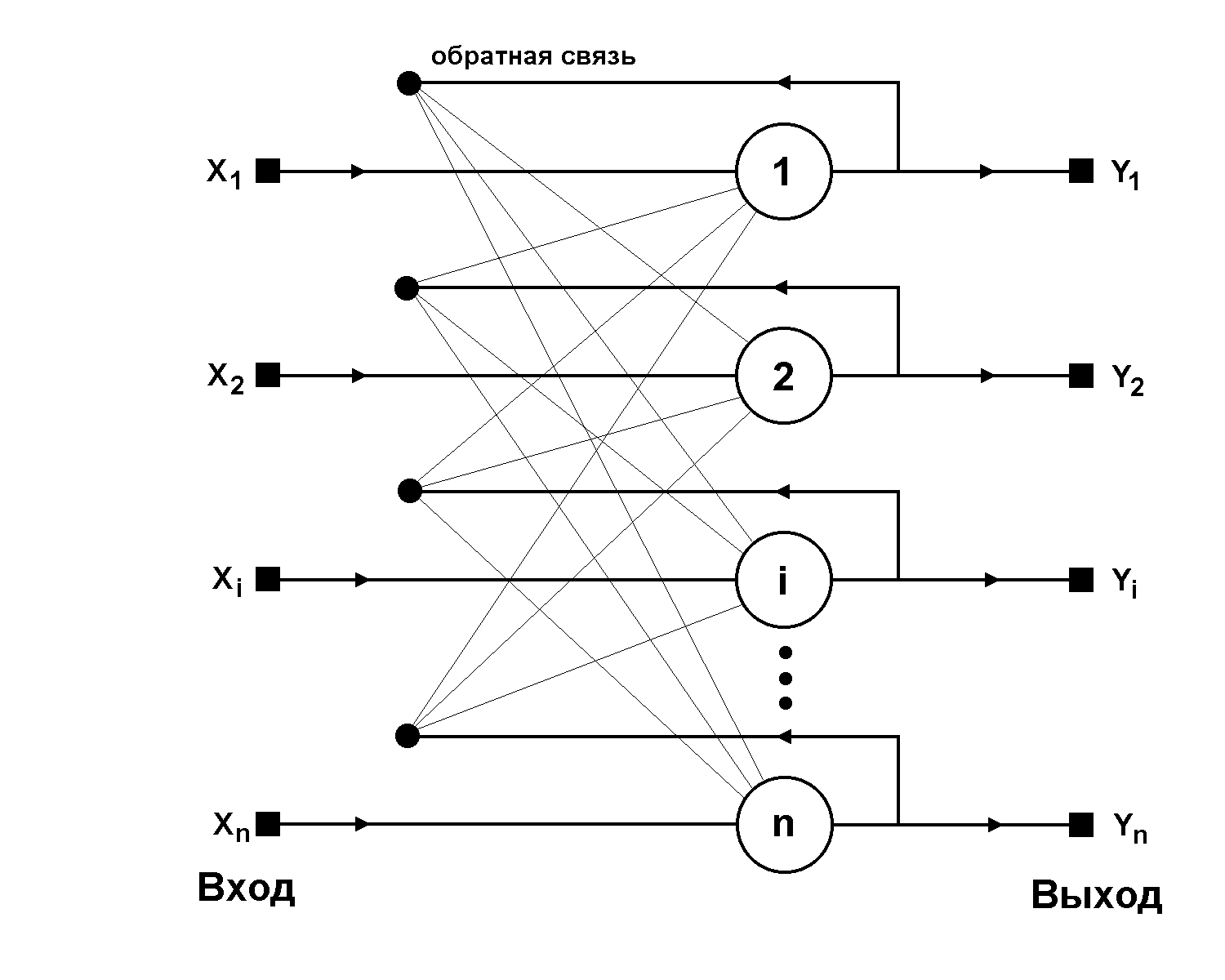

36: Рекуррентные нейронные сети

Ответ: Рекуррентные нейронные сети - это наиболее сложный вид нейронных сетей, в которых имеется обратная связь. При этом под обратной связью подразумевается связь от логически более удалённого элемента к менее удалённому. Наличие обратных связей позволяет запоминать и воспроизводить целые последовательности реакций на один стимул. С точки зрения программирования в таких сетях появляется аналог циклического выполнения, а с точки зрения систем — такая сеть эквивалентна конечному автомату. Такие особенности потенциально предоставляют множество возможностей для моделирования биологических нейронных сетей. Но, к сожалению, большинство возможностей на данный момент плохо изучены в связи с возможностью построения разнообразных архитектур и сложностью их анализа.

Рекуррентные сети с единичной задержкой

Как правило все они базируются на многослойном перцептроне, который становится в это время очень популярным. Такие сети по своему устройству и разнообразию становятся много проще своих предшественников, но зато они приспособлены для решения задачи запоминания последовательностей без проблем с устойчивостью. Это достигается тем, что сигнал с выходного слоя имея только единичную задержку поступает на дополнительные входы (сеть Джордана), и не поступает на первоначальные входы (как в сети Хопфилда) - из-за чего не происходит смешивания сигналов и нет вопроса с устойчивостью. Сеть Элмана отличается лишь тем, что сигнал с внутреннего слоя поступает на дополнительные входы. Такие дополнительные входы называют контекстом, которые служат для хранения информации о предыдущем стимуле, благодаря чему реакция сети теперь зависит не только от текущего стимула, но и предыдущего.

37: Нейро́нная сеть Хопфилда — полносвязная нейронная сеть с симметричной матрицей связей. В процессе работы динамика таких сетей сходится (конвергирует) к одному из положений равновесия. Эти положения равновесия являются локальными минимумами функционала, называемого энергией сети (в простейшем случае — локальными минимумами отрицательно определённой квадратичной формы на n-мерном кубе). Такая сеть может быть использована как автоассоциативная память, как фильтр, а также для решения некоторых задач оптимизации. В отличие от многих нейронных сетей, работающих до получения ответа через определённое количество тактов, сети Хопфилда работают до достижения равновесия, когда следующее состояние сети в точности равно предыдущему: начальное состояние является входным образом, а при равновесии получают выходной образ.

38: Обучение сети Хопфилда

Правило обучения для сети Хопфилда опирается на исследования Дональда Хебба (D.Hebb, 1949), который предположил, что синаптическая связь, соединяющая два нейрона будет усиливатьося, если в процессе обучения оба нейрона согласованно испытывают возбуждение либо торможение. Простой алгоритм, реализующий такой механизм обучения, получил название правила Хебба. Рассмотрим его подробно.

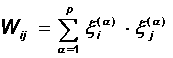

Пусть задана обучающая выборка образов , = 1..p. Требуется построить процесс получения матрицы связей W, такой, что соответствующая нейронная сеть будет иметь в качестве стационарных состояний образы обучающей выборки (значения порогов нейронов T обычно полагаются равными нулю).

В случае одного обучающего образа правило Хебба приводит к требуемой матрице:

![]()

Покажем, что состояние S= является стационарным для сети Хопфилда с указанной матрицей. Действительно, для любой пары нейронов i и j энергия их взаимодействия в состоянии достигает своего минимально возможного значения Eij = -(1/2) i j i j = -1/2.

При этом Е -полная энергия равна E = -(1/2) N 2, что отвечает глобальному минимуму.

Для запоминания других образов может применяется итерационный процесс:

![]()

который приводит к полной матрице связей в форме Хебба:

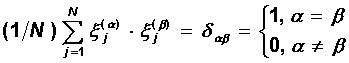

Устойчивость совокупности образов не столь очевидна, как в случае одного образа. Ряд исследований показывает, что нейронная сеть, обученная по правилу Хебба, может в среднем, при больших размерах сети N, хранить не более чем p 0.14 N различных образов. Устойчивость может быть показана для совокупности ортогональных образов, когда

В этом случае для каждого состояния произведение суммарного входа i-го нейрона hi на величину его активности Si = i оказывается положительным, следовательно само состояние является состоянием притяжения (устойчивым аттрактором):

![]()

Таким образом, правило Хебба обеспечивает устойчивость сети Хопфилда на заданном наборе относительно небольшого числа ортогональных образов. В следующем пункте мы остановимся на особенностях памяти полученной нейронной сети.

39:

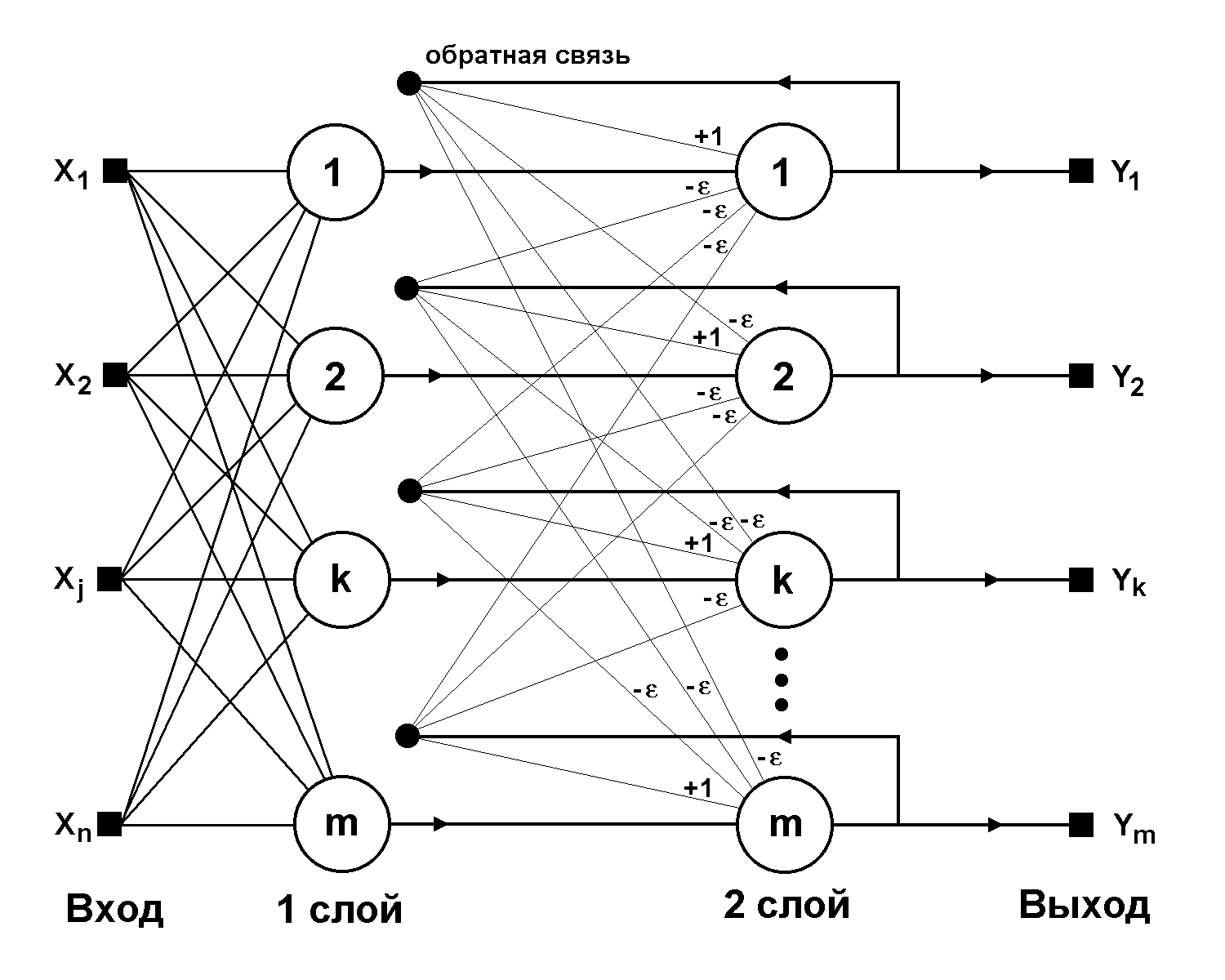

Когда нет необходимости, чтобы сеть в явном виде выдавала образец, то есть достаточно, скажем, получать номер образца, ассоциативную память успешно реализует сеть Хэмминга. Данная сеть характеризуется, по сравнению с сетью Хопфилда, меньшими затратами на память и объемом вычислений, что становится очевидным из ее структуры (рис. 3).Сеть состоит из двух слоев. Первый и второй слои имеют по m нейронов, где m – число образцов. Нейроны первого слоя имеют по n синапсов, соединенных со входами сети (образующими фиктивный нулевой слой). Нейроны второго слоя связаны между собой ингибиторными (отрицательными обратными) синаптическими связями. Единственный синапс с положительной обратной связью для каждого нейрона соединен с его же аксоном.Идея работы сети состоит в нахождении расстояния Хэмминга от тестируемого образа до всех образцов. Расстоянием Хэмминга называется число отличающихся битов в двух бинарных векторах. Сеть должна выбрать образец с минимальным расстоянием Хэмминга до неизвестного входного сигнала, в результате чего будет активизирован только один выход сети, соответствующий этому образцу.