- •Калининград – 2011 Содержание

- •Тема 1. Введение. Эконометрика и эконометрическое моделирование.

- •Тема 2. Временные ряды4.

- •Тема 3. Парная регрессия и корреляция.

- •3.1. Корреляционный анализ

- •Коэффициент парной корреляции

- •Множественный коэффициент корреляции

- •Частный коэффициент корреляции

- •Пример 3.1. Вычисление коэффициентов парной, множественной и частной корреляции.

- •3.2. Регрессионный анализ

- •Оценка параметров регрессионного уравнения

- •Матричная форма записи

- •Решение

- •Анализ статистической значимости параметров модели парной регрессии

- •Интервальная оценка параметров модели

- •Прогнозирование с применением уравнения регрессии

- •Решение:

- •1. Построение линейной модели парной регрессии

- •2. Построение степенной модели парной регрессии

- •3. Построение показательной функции

- •4.Построение гиперболической функции

- •Расчет прогнозного значения результативного показателя:

- •Тема 4. Множественная регрессия.

- •Оценка качества модели регрессии.

- •Использование многофакторных моделей для анализа и прогнозирования развития экономических систем.

- •Построение точечных и интервальных прогнозов на основе регрессионной модели. Какие факторы влияют на ширину доверительного интервала?

- •Коэффициент детерминации:

- •Тема 5. Системы линейных одновременных уравнений.

- •Тема 6. Многомерный статистический анализ

- •Факторный анализ

- •Кластерный анализ

- •Дискриминантный анализ

- •Постановка задачи дискриминантного анализа

- •Алгоритм выполнения дискриминантного анализа

- •4. Рассчитывается объединенная ковариационная матрица по формуле: .

- •Литература по теме 6.

- •Задание для выполнения контрольной работы по дисциплине Задача 1.

- •Приложения

- •Приложение 2. Значения t-критерия Стьюдента при уровне значимости 0,10; 0,05; 0,01 (двухсторонний)

- •Приложение 3. Критические границы отношения r/s

- •Приложение 4. D-статистика Дарбина - Уотсона: d1 и d2, уровень значимости в 5%

- •Основная

- •Дополнительная

- •Правила построения арпсс-моделей

3.2. Регрессионный анализ

Регрессионный анализ предназначен для исследования зависимости исследуемой переменной от различных факторов и отображения их взаимосвязи в форме регрессионной модели.

В регрессионных моделях зависимая (объясняемая) переменная Y может быть представлена в виде функции f (X1, X2, X3, … Xm), где X1, X2, X3, … Xm - независимые (объясняющие) переменные, или факторы. В качестве зависимой переменной может выступать практически любой показатель, характеризующий, например, деятельность предприятия или курс ценной бумаги. В зависимости от вида функции f (X1, X2, X3, … Xm) модели делятся на линейные и нелинейные. В зависимости от количества включенных в модель факторов Х модели делятся на однофакторные (парная модель регрессии) и многофакторные (модель множественной регрессии).

Связь между переменной Y и m независимыми факторами можно охарактеризовать функцией регрессии Y= f (X1, X2, X3, … Xm), которая показывает, каково будет в среднем значение переменной yi, если переменные xi примут конкретные значения.

Данное обстоятельство позволяет использовать модель регрессии не только для анализа, но и для прогнозирования экономических явлений.

Линейная парная регрессия

Под линейностью здесь имеется в виду, что переменная y предположительно находиться под влиянием переменной x в следующей зависимости:

![]() ,

(3.6)

,

(3.6)

где

![]() - постоянная величина (или свободный

член уравнения),

- постоянная величина (или свободный

член уравнения),

![]() -

коэффициент регрессии, определяющий

наклон линии, вдоль которой рассеяны

данные наблюдений. Это показатель,

характеризующий изменение переменной

-

коэффициент регрессии, определяющий

наклон линии, вдоль которой рассеяны

данные наблюдений. Это показатель,

характеризующий изменение переменной

![]() ,

при изменении значения

,

при изменении значения

![]() на единицу. Если

на единицу. Если

![]() - переменные

- переменные

![]() и

и

![]() положительно коррелированные, если

положительно коррелированные, если

![]()

0 – отрицательно коррелированны;

0 – отрицательно коррелированны;

![]() -

независимые одинаково распределенные

случайные величины – остаток с нулевым

математическим ожиданием (

-

независимые одинаково распределенные

случайные величины – остаток с нулевым

математическим ожиданием (![]() )

и постоянной дисперсией (

)

и постоянной дисперсией (![]() ).

Она отражает тот факт, что изменение

).

Она отражает тот факт, что изменение

![]() будет неточно описываться изменением

Х – присутствуют другие факторы,

неучтенные в данной модели.

будет неточно описываться изменением

Х – присутствуют другие факторы,

неучтенные в данной модели.

Оценка параметров регрессионного уравнения

Дня оценки параметров

регрессионного уравнения наиболее

часто используют метод наименьших

квадратов (МНК), который минимизирует

сумму квадратов отклонения наблюдаемых

значений

![]() от

модельных значений

от

модельных значений

![]() .

.

Согласно принципу

метода наименьших квадратов, оценки

![]() и

и

![]() находятся путем минимизации суммы

квадратов

находятся путем минимизации суммы

квадратов

![]()

по всем возможным

значениям

![]() и

и

![]() при заданных (наблюдаемых) значениях

при заданных (наблюдаемых) значениях![]() .

Задача сводится к известной

математической задаче поиска точки

минимума функции двух переменных. Точка

минимума находится путем приравнивания

нулю частных производных функции

.

Задача сводится к известной

математической задаче поиска точки

минимума функции двух переменных. Точка

минимума находится путем приравнивания

нулю частных производных функции

![]() по переменным

по переменным

![]() и

и

![]() .

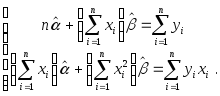

Это приводит к системе нормальных

уравнений

.

Это приводит к системе нормальных

уравнений

![]()

![]()

решением которой и

является пара

![]() ,

,

![]() .

Согласно правилам вычисления

производных имеем

.

Согласно правилам вычисления

производных имеем

![]()

![]()

![]()

![]()

так что искомые значения

![]() ,

,

![]() удовлетворяют соотношениям

удовлетворяют соотношениям

![]()

![]()

Эту систему двух уравнений можно записать также в виде

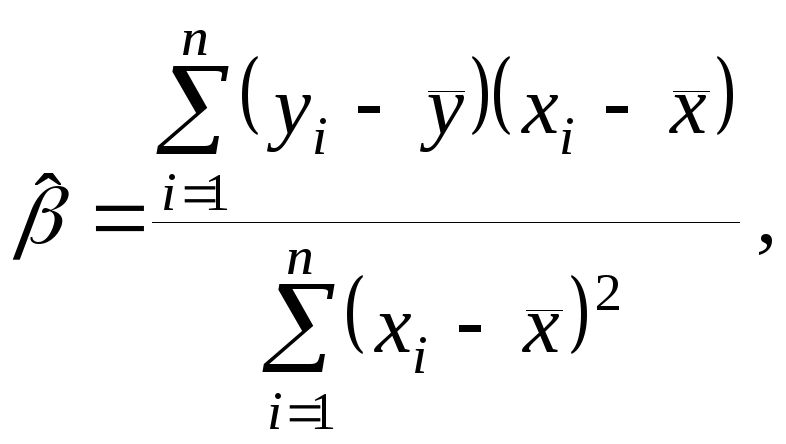

Эта система является системой двух линейных уравнений с двумя неизвестными и может быть легко решена, например, методом подстановки. В результате получаем

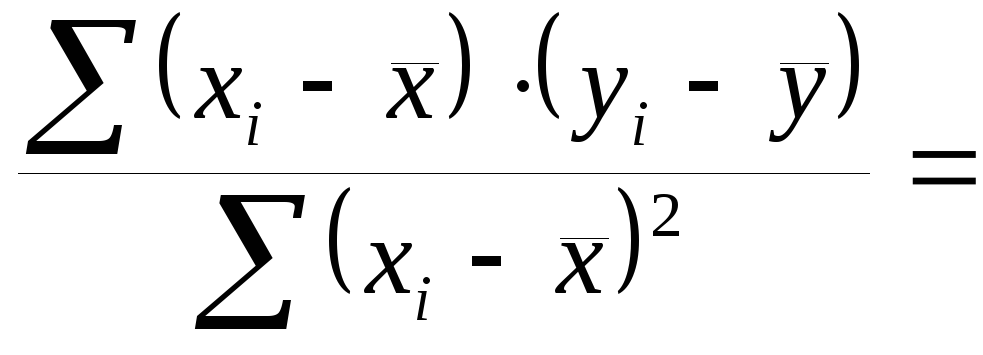

![]() (3.7)

(3.7)

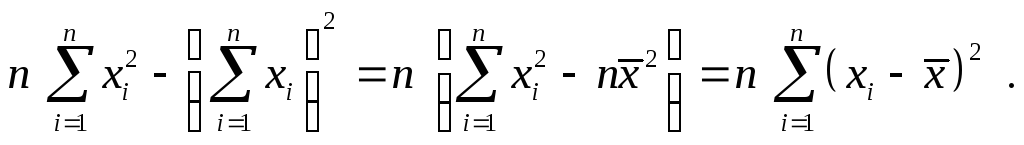

Такое решение может существовать только при выполнении условия

![]()

что равносильно отличию от нуля определителя системы нормальных уравнений. Действительно, этот определитель равен

Последнее условие

называется условием идентифицируемости

модели наблюдений

![]() ,

и означает, что не все значения

,

и означает, что не все значения

![]() совпадают между собой. При нарушении

этого условия все точки

совпадают между собой. При нарушении

этого условия все точки

![]() ,

лежат на одной вертикальной прямой

,

лежат на одной вертикальной прямой

![]()

Оценки

![]() и

и

![]() называют оценками наименьших

квадратов. Обратим еще раз внимание

на полученное выражение для

называют оценками наименьших

квадратов. Обратим еще раз внимание

на полученное выражение для

![]() .

Нетрудно видеть, что в это выражение

входят уже знакомые нам суммы квадратов,

участвовавшие ранее в определении

выборочной дисперсии

.

Нетрудно видеть, что в это выражение

входят уже знакомые нам суммы квадратов,

участвовавшие ранее в определении

выборочной дисперсии

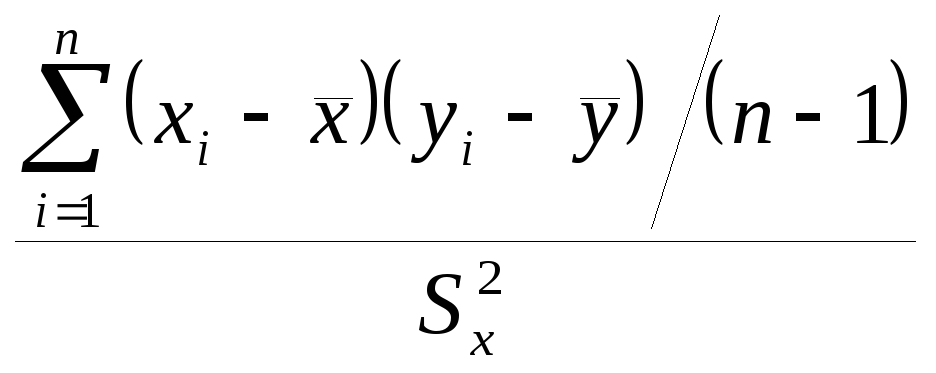

![]()

и выборочной ковариации

![]()

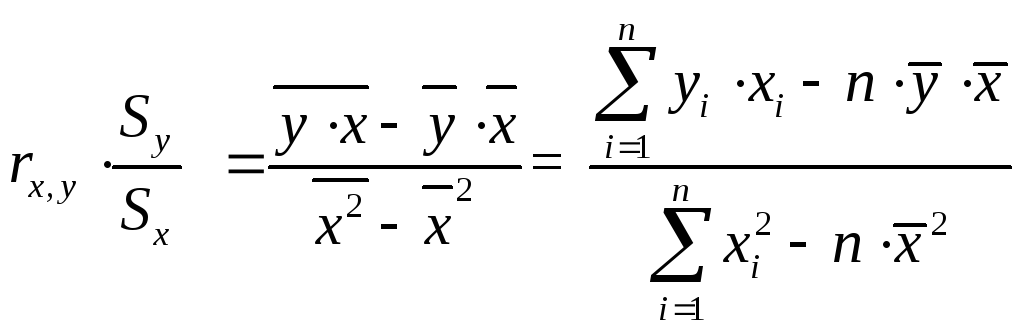

![]() так что, в этих терминах,

так что, в этих терминах,

![]() =

=![]() =

=![]()

=

=

=

(3.8)

(3.8)