- •Информатика Информация, сигнал, сообщение

- •Собственная информация

- •Формула Шеннона

- •Формула Хартли

- •Единицы измерения информации

- •Свойства энтропии

- •Пример.

- •Пропускная способность канала связи

- •Дискретный канал без помех

- •Дискретный канал с помехами

- •Избыточность источника сообщений

- •Пример.

- •Кодирование информации

- •Равномерное кодирование

- •Эффективное кодирование

- •Основные принципы эффективного кодирования:

- •Метод Шеннона - Фано

- •Метод Хаффмана

- •Кодирование информации для канала с помехами

- •Контроль по четности

- •Элементы, образующие логический базис

- •Элемент «не»реализует операцию «логическое отрицание». Элемент имеет один вход и один выход. На выходе сигнал «1» имеет место в случае, если на входе будет сигнал «0».

Пример.

Сравнить неопределенность (энтропию), приходящуюся на букву источника информации (алфавита русского языка), характеризуемого ансамблем, представленным в таблице, с неопределенностью, которая бала бы у того же источника при равновероятном использовании букв.

При

одинаковых вероятностях появления всех

m = 32 букв алфавита неопределенность,

приходящаяся на одну букву, характеризует

энтропия Hmax = log m = log 32 = 5 бит. Энтропия

источника, характеризуемого заданной

таблицей: ![]() -0,064 log 0,064 -0,015log0,015 - ... - 0,143log0,143

4,43 бит.

-0,064 log 0,064 -0,015log0,015 - ... - 0,143log0,143

4,43 бит.

Таким образом, неравномерность распределения вероятностей использования букв снижает энтропию источника с 5 до 4,42 бит.

|

Буква |

Вероят-ность |

Буква |

Вероят-ность |

Буква |

Вероят-ность |

Буква |

Вероят-ность |

|

а |

0,064 |

й |

0,010 |

т |

0,056 |

ы |

0,016 |

|

б |

0,015 |

к |

0,029 |

у |

0,021 |

э |

0,003 |

|

в |

0,039 |

л |

0,036 |

ф |

0,02 |

ю |

0,007 |

|

г |

0,014 |

м |

0,026 |

х |

0,09 |

я |

0,019 |

|

д |

0,026 |

н |

0,056 |

ц |

0,04 |

пробел |

0,143 |

|

е,ё |

0,074 |

о |

0,096 |

ч |

0,013 |

|

|

|

ж |

0,008 |

п |

0,024 |

ш |

0,006 |

|

|

|

з |

0,015 |

р |

0,041 |

ш |

0,003 |

|

|

|

и |

0,064 |

с |

0,047 |

ъ,ь |

0,015 |

|

|

Пропускная способность канала связи

пропускная способность канала связи – это наибольшая возможная скорость передачи информации по данному каналу

Дискретный канал без помех

Если помехи в канале отсутствуют

Пусть

по каналу без помех передаются двоичные

символы ![]() и

и ![]() ,

вероятность появления нуля равна

,

вероятность появления нуля равна ![]() ,

а единицы

,

а единицы ![]() .

.

Тогда

![]() и

и ![]() .

Максимум достигается при

.

Максимум достигается при ![]() .

.

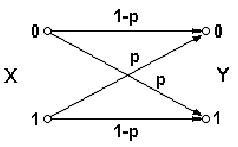

Дискретный канал с помехами

Пусть

требуется определить пропускную

способность канала связи, по которому

передаются независимые двоичные символы

со скоростью ![]() .

И пусть в результате действия помех

каждый символ превращается в противоположный

с вероятностью p.

Тогда вероятность правильного приема

равна 1-p.

Канал такого типа называется двоичным

симметричным каналом без памяти.

.

И пусть в результате действия помех

каждый символ превращается в противоположный

с вероятностью p.

Тогда вероятность правильного приема

равна 1-p.

Канал такого типа называется двоичным

симметричным каналом без памяти.

![]() .

.

Если

шумы в канале отсутствуют, то ![]() и пропускная способность максимальна:

и пропускная способность максимальна:

![]() .

Если

.

Если ![]() ,

то

,

то ![]() также максимальна. Минимальное значение

пропускная способность имеет при

также максимальна. Минимальное значение

пропускная способность имеет при ![]() .

.

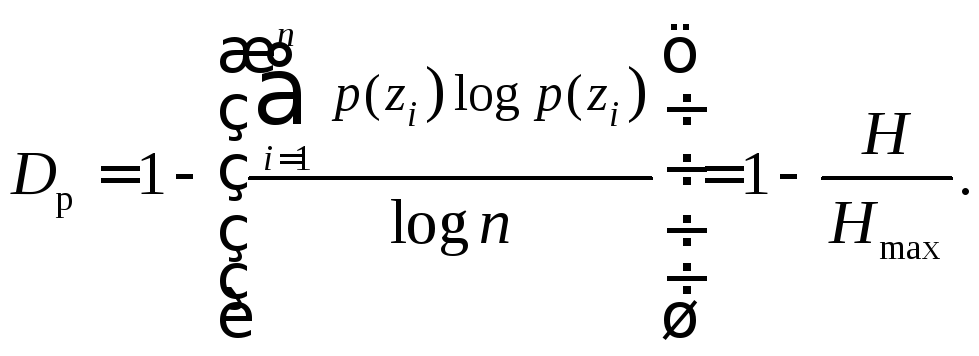

Избыточность источника сообщений

Очевидно, что над алфавитом объема n может быть построено nk слов длины k. Тогда в русском алфавите имеется 33 слова длины 1, 332=1089 двухбуквенных слов, 333=35937 трехбуквенных слов, 334=1185923 четырехбуквенных слов. Всего слов, длина которых не превышает 4, насчитывается 1222982. Этого более чем достаточно, чтобы закодировать все слова русского языка. Тем не менее, слова русского языка по числу символов часто значительно превышают четырехбуквенные. Таким образом, естественный язык уже на уровне отдельных слов обладает большой избыточностью.

Итак, избыточные сообщения – это сообщения, которые для представления информации используют больше символов, чем это минимально необходимо.

Очевидно, что чем больше избыточность, тем более устойчиво сообщение к различным помехам.

Пример.«В словох всо глосноо зомононо боквой о».

С другой стороны, избыточность ведет к уменьшению скорости передачи сообщений (или к увеличению объема памяти).

Избыточность

естественного языка характеризуется

энтропией его алфавита ![]() :

неравномерность распределения символов

ведет к тому, что энтропия алфавита

уменьшается по сравнению с максимально

возможной:

:

неравномерность распределения символов

ведет к тому, что энтропия алфавита

уменьшается по сравнению с максимально

возможной: ![]() .

Чем меньше

.

Чем меньше ![]() ,

тем больше избыточность.

,

тем больше избыточность.

Информационная избыточность показывает относительную недогруженность на символ алфавита и является безразмерной величиной:

![]()

где

![]() —коэффициент сжатия(относительная

энтропия). Важно понимать, что

—коэффициент сжатия(относительная

энтропия). Важно понимать, что![]() и

и![]() берутся относительно одного и того же

алфавита.

берутся относительно одного и того же

алфавита.

Кроме общего понятия избыточности существуют частные виды избыточности.

Избыточность, обусловленная неравновероятным распределением символов в сообщении:

Информационная избыточность – обычно явление естественное, заложена она в первичном алфавите. Избыточность не является признаком несовершенства источника. Избыточность характеризует физические свойства источника.