- •4. Основные сведения о нейронных сетях

- •4.1. Введение

- •Каждый нейрон, входящий в нейронную сеть и представленный на рис. 1 в виде кружка, участвует в преобразовании входных сигналов, так что выходной сигнал зависит от алгоритма работы всех нейронов.

- •4.2. Модель нервной клетки (нейрона)

- •Лекция 24

- •4.3. Математическая модель нейрона

- •4.4. Многослойная нейронная сеть

- •4.5. Обучение нейронной сети

- •Лекция 25

- •4.6. Обратное распространение ошибки

- •Лекция 26

- •Если q – й нейрон расположен в k–ом скрытом слое (рис. 8), то согласно (17а) при замене r на q , 2 на k, 1 на k-1 и I на r,

- •4.7. Аппроксимация функций (моделирование) с помощью нейронных сетей (персептронов)

- •Нейронная сеть с радиальными базисными функциями

- •Cтруктура нейронной сети с радиально базисными функциями (рбф сети)

- •Методы обучения рбф сети

- •Лекция 27

- •Моделирование (идентификация) нелинейных динамических процессов (объектов)

- •3. Применение нейронных сетей (нс) для управления

- •3.1. Нейросетевые адаптивные системы управления

- •3.1.1. Нейросетевая технология адаптивной линеаризации обратной связью

- •3.1.2. Нейросетевое прямое и косвенное адаптивное управление на основе желаемой (эталонной) модели

- •Лекция 28

- •5. Синтез нейронных нечетких сетей

- •5.1. Введение

- •Адаптивные нейронные нечеткие системы инференции (anfis)

- •Структура anfis

- •Алгоритм обучения anfis

- •Генетические алгоритмы

- •Лекция 29

- •Генетические нечеткие системы (Извлечение нечетких знаний с помощью генетических алгоритмов)

- •Проектирование нечетких систем

- •Классификация генетических нечетких систем

- •4.6. Обратное распространение ошибки

Проектирование нечетких систем

Нечеткие системы (независимо от того, являются ли они нечеткими моделями или нечеткими контроллерами) (рис. 6) включают два главных компонента:

Базу знаний (БЗ), в которой хранятся доступные или приобретенные знания о задаче, требующей решения, в форме нечетких правил;

Механизм инференции, использующий методы нечетких рассуждений, базирующиеся на базе правил и входных сигналах, для получения выходного сигнала системы.

Оба этих компонента должны быть спроектированы так, чтобы построить систему для конкретного приложения:

БЗ формируют из знаний экспертов или путем обучения с помощью машинных методов;

Механизм инференции строят путем выбора нечетких операторов для каждого компонента (конъюнкция, импликация, дефаззификация и т.п.).

В ряде случаев операторы также параметризуются и могут быть настроены автоматическими методами.

Рис. 7

Проектирование БЗ затрагивает две подзадачи:

1. Определение базы данных (БД):

Универсум для переменных;

Масштабирующие коэффициенты или функции;

Гранулированность (число лингвистических терм) для каждой переменной;

Функции принадлежности, описывающие термы.

2. Составление базы правил (БП): формулировка базовых правил.

Как уже отмечено, существуют два различных метода для проектирования базы знаний (БЗ): информация от экспертов и с помощью машинных методов обучения на основе численной информации, полученной с помощью нечеткого моделирования или путем симуляции проектируемой системы управления.

Классификация генетических нечетких систем

С точки зрения оптимизации, чтобы найти соответствующую нечеткую систему, надо ее представить как эквивалентную параметрическую структуру и затем определить значения параметров, обеспечивающих оптимум для конкретной функции приспособленности. Поэтому первый шаг в проектировании ГНЛС решить вопрос о том, какая часть нечеткой системы подлежит оптимизации путем кодирования ее параметров в хромосомы. В этом разделе мы представим классификацию ГНЛС, соответствующую различным частям нечеткой системы, кодируемым с помощью генетической модели.

Обычно методы проектирования ГНЛС разделяют на два процесса, настройка (т.е. адаптация) и обучение. При этом будем исходить из факта, существует или нет исходная БЗ, включая БД и БП. Тогда в рамках ГНЛС мы вводим следующее деление.

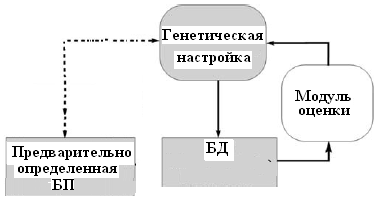

Генетическая настройка. Если существует БЗ, мы применяем процесс генетической настройки для улучшения свойств нечеткой системы , но не изменяем БП. Т.е. мы настраиваем параметры НЛС с целью улучшения ее свойств, сохраняя неизменной БП.

Генетическое обучение. Вторая возможность обучать компоненты БП, к которым можно отнести адаптацию механизма инференции. Т.е. мы затрагиваем обучение компонентов БП, наряду с другими компонентами НЛС.

Генетическая настройка базы данных. Осуществляется путем определения предварительно вида и параметров масштабирующих функций входа и выхода, а также функций принадлежности, и затем настройки этих параметров и тем самым изменения формы масштабирующих функций и функций принадлежности с помощью ГА (рис. 8).

Рис. 8

Генетическое обучение базы правил. Генетическое обучение БП предполагает предопределенное множество функций принадлежности в БД, к которым правила обращается посредством лингвистических терм.

Рис. 9

Когда рассматривается задача обучения базы правил, открывается широкий диапазон возможностей. Имеется три главных подхода: питтсбургский, мичиганский и итеративный методы обучения. Питтсбургский и мичиганский подходы являются наиболее распространенными методами для обучения правил, разработанные в области ГА. Первый из них характеризуется представлением всего набора (совокупности) правил как генетического кода (хромосомы), «хромосома=набор правил», сохраняя неизменной популяцию кандидатов на роль правил и, используя селекцию, и генетические операторы для создания новых поколений наборов правил. Мичиганский подход рассматривает другую модель, в которой члены популяции являются отдельными правилами, «хромосома=правило» и набор правил представляется всей популяцией. В третьем случае, итеративном методе с помощью хромосом кодируют отдельные правила, и новое правило настраивается и добавляется в набор правил, итеративным способом.