- •1. Основы теории спроса и предложения. Условия достижения рыночного равновесия

- •2. Теория фирмы: производство и его факторы, производственная функция, виды продукта и их взаимосвязь.

- •3. Издержки фирмы и принцип альтернативности затрат. Доходы и прибыль фирмы: понятие и основные виды. Экономическая и бухгалтерская прибыль.

- •4. Типы конкуренции и структура рынка. Рынок совершенной конкуренции и его особенности.

- •5. Рыночное поведение конкурентной фирмы. Максимизация прибыли и определение оптимального объема выпуска в краткосрочном и долгосрочном периоде.

- •6. Понятие и основные признаки монополии, условия максимизации прибыли и социальные последствия.

- •7. Монополистическая конкуренция: понятие, основные признаки, условия максимизации прибыли в краткосрочном и долгосрочном периоде.

- •8. Олигополия: понятие и ее основные характеристики. Стратегическое поведение фирмы в условиях олигополистического рынка.

- •9. Рынок труда в условиях совершенной и несовершенной конкуренции: понятие, основные характеристики, условия равновесия.

- •10. Заработная плата как цена труда и ее формы. Дифференциация заработной платы. Инвестиции в человеческий капитал.

- •11. Особенности функционирования рынка труда в Республике Беларусь.

- •12. Рынок капитала и его структура. Рынок капитальных благ и инвестиции.

- •13. Равновесие рынка капитала: спрос фирмы на капитальные ресурсы, роль процентной ставки, особенности формирования предложения капитала.

- •14. Рынок земли: неэластичность спроса, предложение земли и его ограниченность, достижение равновесия.

- •15. Земельная рента как плата за использование земли. Рента и арендная плата. Цена земли.

- •16. Формирование рынка земли в Республике Беларусь.

- •II. Макроэкономика

- •17. Роль макроэкономических показателей. Измерение внп и ввп. Методы расчета ввп. Номинальные и реальные показатели.

- •18. Индексы цен Пааше и Ласпейреса. Дефлятор внп и индекс потребительских цен. Измерение инфляции (дефляции), дизинфляции (рефляции, гиперинфляции).

- •19. Модель совокупного спроса и совокупного предложения. Макроэкономическое равновесие в модели ad-as.

- •20. Макроэкономическое равновесие на товарном рынке в модели совокупных доходов и расходов. Основы кейнсианской теории. Функции потребления, сбережений и инвестиций в модели Кейнса.

- •37. Доходы населения и проблемы их распределения. Кривая Лоренца

- •38. Модели социальной политики. Государственная политика перераспределения доходов и ее направления

- •39.Понятие и модели внутреннего и внешнего макроэкономического равновесия (модель «доходы-расходы», модель Манделла-Флемминга). Адаптация открытой экономики к экзогенным шокам.

- •40. Макроэкономическая политика в открытой экономике. Инструменты макроэкономической корректировки

- •41. Понятие трансформационной экономики, ее основные черты и особенности. Белорусская модель трансформации экономики

- •42. Роль государства в трансформационной экономике. Особенности государственной политики в трансформационной экономике.

- •43. Основные направления рыночных преобразований: (реформирование отношений собственности, либерализация экономики, структурная перестройка национальной экономики, институциональные преобразования).

- •III. Международная экономика

- •44. Международная экономика и структура мирового хозяйства. Формы международных экономических связей. Современные тенденции развития мирового хозяйства.

- •45. Международное разделение труда и факторы производства. Транснационализация мировой экономики. Интеграционные процессы.

- •46. Национальное и международное регулирование мирохозяйственных связей. Международные экономические и валютно-финансовые организации.

- •47. Возникновение и генезис теории международной торговли. Современные теории международной торговли.

- •48. Торговая политика и ее виды (протекционизм и либерализация торговли). Инструменты торговой политики. Тарифные и нетарифные методы регулирования.

- •1. Тарифные методы регулирования

- •2. Не тарифные методы регулирования

- •2.(А) Экономические методы регулирования

- •2. (Б). Административные методы регулирования

- •49. Миграция труда и движение капитала. Международный кредит: виды, механизм предоставления и современные тенденции.

- •50. Мировая валютная система: понятие и этапы эволюции. Роль международных валютно-финансовых организаций в мировой валютной системе.

- •51. Валютный рынок и валютное регулирование: понятие, виды и режимы валютных курсов.

- •52. Республика Беларусь в международной экономике: место в международном разделении труда, стратегия вхождения в мировую экономику.

- •IV. История денег и финансов

- •53. Закономерности развития денежных систем античности. Развитие денежного обращения в XVI-XVII вв.

- •54. Развитие кредитных денег XVII-XIX вв. Возникновение и деятельность центральных банков до начала XX века.

- •55. Причины и закономерности развития фондового рынка XVII - н. XX вв.

- •56. Причины и закономерности финансовых кризисов в XVIII-первой половине XX вв. Преодоление Великой Депрессии и ее последствия.

- •57. Парижская, Генуэзская, Бреттон-Вудская и Ямайская валютные системы и их роль для денежного обращения.

- •V. Деньги, кредит, банки. Монетарная политика

- •62. Валютное и инфляционное таргетирование

- •63. Валютный курс, его сущность, виды и основные методы определения. Основные факторы, влияющие на валютный курс. Валютное регулирование и его направления

- •64. Денежно-кредитная политика центрального банка и ее основные инструменты

- •65. Сущность денег и их основные функции. Конвертируемость национальных валют, ее основные формы, условия и проблемы

- •66. Понятие и характеристика устойчивости денежного обращения, денежной массы, денежной базы и скорости обращения денег

- •67. Принципы измерения и структура денежной массы. Механизм формирования денежного предложения

- •68. Основы безналичного денежного обращения. Безналичные и наличные расчеты, принципы их организации. Виды и формы расчетов

- •69. Налично-денежный оборот и механизм организации кассовых операций в национальной экономике

- •70. Необходимость и сущность кредита, его принципы и функции. Условия возникновения кредитных отношений

- •71. Сущность банковского процента, его виды и механизмы функционирования. Процентная политика коммерческих банков.

- •72. Ипотечный кредит, условия развития, роль и особенности предоставления.

- •73. Денежно-кредитные реформы, их цели, задачи и методы проведения. Содержание и назначение денежных реформ.

- •74. Коммерческие банки, их признаки, принципы функционирования и основные функции. Финансовые риски в деятельности коммерческого банка.

- •75. Центральный банк, его статус, цели и функции. Денежно-кредитная политика центрального банка.

- •1. Изменение минимальной резервной нормы.

- •2. Изменение учетной ставки.

- •3. Операции на открытых рынках.

- •76. Национальный банк Республики Беларусь и его роль в развитии национальной экономики.

- •VI. Аналих банковских рисков

- •VII. Платежные системы

- •86. Место и роль платежной системы в экономике государства. Принципы построения платежных систем.

- •87. Организация межбанковских расчетов и платежная система.

- •88. Роль и функции центрального банка страны в платежной системе Республики Беларусь.

- •89. Риски в платежной системе и механизмы управления ими.

- •90. Банковские пластиковые карты как инструмент оказания электронных банковских услуг. Электронные системы расчетов.

- •VIII. Мировая банковская система

- •91. Типология кредитно-финансовых систем. Особенности кредитно-финансовых систем в 90-е гг. Хх в. И началеХxi в.

- •92. Формирование и развитие инвестиционного банкинга в 90-е гг. Хх в. И начале хxi в.

- •93. Основные направления осуществления международной банковской деятельности. Секьюритизация и ее влияние на банковскую деятельность

- •94. Формы осуществления международной банковской деятельности и операции банков на мировом кредитном рынке

- •95. Финансовые потоки в мировой банковской системе и операции банков на мировом фондовом рынке

- •96. Регулирование мировой кредитно-финансовой системы. Посткризисный подход к системе глобальной финансовой стабильности

- •IX. Международные финансовые рынки

- •97. Международные финансовые рынки: понятие, функции, институциональная организация и инструментарий. Глобализация мировых финансовых рынков.

- •2. Респределительная.

- •98. Модели развития фондовых рынков (англо-американская, германская, японская) и их применимость для Республики беларусь.

- •99. Рынок производных финансовых инструментов: структура, виды инструментов, влияние на мировую финансовую систему.

- •100. Риски при осуществлении операций на международном финансовом рынке: понятие, виды, оценка.

- •101. Общая характеристика системы управления международными финансовыми рисками.

- •1. Игнорирование (непринятие) риска.

- •3. Компенсацию (принятие) риска

- •X. Рынок ценных бумаг. Фондовые биржи

- •102. Технический и фундаментальный анализ на рынке ценных бумаг: основные различия.

- •103. Рынок ценных бумаг и его классификация. Инфраструктура рынка ценных бумаг. Функции рынка ценных бумаг.

- •104. Понятие листинга, сущность и процедура его прохождения.

- •105. Понятие, правовое положение биржи, членство в бирже. Порядок заключения сделок по купле-продаже ценных бумаг на бирже.

- •106. Профессиональная деятельность на рынке ценных бумаг и ее виды.

- •107. Фондовые индексы: понятие и виды. Стоимостная оценка облигаций на рынке ценных бумаг.

- •108. Рейтинги и рейтинговые агенства рынка ценных бумаг. Раскрытие информации на рынке ценных бумаг.

- •109. Преимущества и недостатки биржевого и внебиржевого рынка ценных бумаг.

- •110. Депозитарная система Республики Беларусь и направления ее развития.

- •111. Виды биржевых услуг, оказываемых фондовой биржей.

- •XI. Опционы и фьючерсы

- •112. Рынок деривативов: сущность, назначение и основные сегменты.

- •113. Содержание и виды деривативов (форварды, фьючерсы, опционы, свопы).

- •114. Основные стратегии работы с деривативами (хеджирование, арбитраж, спекуляции).

- •115. Спекулятивные стратегии с применением деривативов (фьючерсов и опционов).

- •116. Спекулятивные опционные позиции. Хеджирование опционами: виды и методы.

- •117. Хеджирование: сущность, виды, методы. Хеджирование фьючерсами: виды и методы.

- •118. Опционные контракты: содержание, виды, применение.

- •119. Валютный арбитраж: сущность, условия, методы осуществления.

- •120. Свопы: сущность, виды, применение.

- •121. Особенности ценообразования на рынке опционов.

- •XII. Банковский бухгалтерский учет

- •122. Роль бухгалтерского учета и отчетности в банках в проведении денежно-кредитной политики государства и функционировании деятельности банка и банковской системы.

- •124. Организационные и методологические особенности бухгалтерского учета и отчетности в банках.

- •128. Синтетический учет в банках. Основная форма синтетического учета (назначение, содержание).

- •129. Бухгалтерский учет кредитных операций банка.

- •XIII. Статистика

- •137. Статистический анализ инфляции. Дефлятор ввп, индексы потребительских цен, индекс покупательной способности денег.

- •138. Статистический анализ финансов предприятия: источники информации и основные показатели.

- •139. Статистический анализ выполнения государственного бюджета. Влияние изменения налоговой базы и налоговой ставки.

- •XIV. Эконометрика

- •141. Модель множественной линейной регрессии

- •142. Нелинейные эконометрические модели

- •143. Динамические эконометрические модели

- •XV. Ценообразование

- •144. Ценообразование в условиях совершенной конкуренции и рынка чистой монополии.

- •145. Ценообразование в условиях олигополии и монополистической конкуренции.

- •146. Функции цены и основные ценообразующие факторы. Классификация видов цен, структура и элементы цены.

- •147. Механизм ценообразования и характеристика основных стратегий ценообразования в компаниях.

- •148. Основные методы ценообразования и их характеристика (затратный, нормативно-параметрический, договорно-контрактный, рыночный и административный).

- •XVI. Налоговая и бюджетная системы

- •150. Бюджетная система и устройство государства. Принципы построения бюджетной системы. Система межбюджетных отношений.

- •151. Государственные доходы, их основные виды и источники формирования. Государственные расходы и принципы их финансирования.

- •153. Бюджетный дефицит и сбалансированность государственного бюджета. Способы финансирования дефицита государственного бюджета.

- •154. Государственный кредит в системе финансовых отношений, его основные виды. Взаимосвязь бюджетного дефицита и государственного кредита.

- •155. Государственный долг и основные методы управление им. Управление государственным долгом в Республике Беларусь.

- •156. Налоговая система Республики Беларусь: принципы построения, структура, основные направления развития. Пересмотреть!!!

- •157. Налоговая политика государства и направления ее реализации. Основные пути реформирования налоговой системы Республики Беларусь.

- •158. Налог на добавленную стоимость: экономическая сущность, особенности его исчисления. Налог на добавленную стоимость в Республике Беларусь.

- •162. Налог на прибыль и доходы: экономическая сущность, значение и роль в системе налогообложения. Порядок взимания налога на прибыль и доходы в Республике Беларусь.

- •163. Налогообложение доходов от предпринимательской деятельности в Республике Беларусь: основные системы налогообложения и эффективность их использования.

- •164. Подоходный налог с физических лиц, его роль в налоговой системе государства. Особенности взимания подоходного налога в Республике Беларусь.

- •165. Основные виды налогов, взимаемые с доходов банков, особенности их исчисления.

- •166. Налоги и отчисления, относимые на расходы банков: основные виды и порядок их исчисления.

- •XVII. Инвестиционный менеджмент

- •167. Понятие инвестиций и инвестиционного проекта, их классификация. Инвестиционный анализ и его виды.

- •168. Инвестиционный проект в системе экономических отношений. Жизненный цикл инвестиционного проекта.

- •169. Бизнес-план инвестиционного проекта и его структура. Эффективность инвестиционного проекта и ее виды.

- •170. Статические методы анализа эффективности инвестиций.

- •171. Учет фактора времени в анализе эффективности инвестиций.

- •172. Денежный поток от инвестиционного проекта и его прогнозирование. Финансовая рента.

- •173. Цена капитала инвестиционного проекта и модели ее определения.

- •174. Метод чистой текущей стоимости как дисконтный метод анализа эффективности инвестиций.

- •175. Метод индекса рентабельности как дисконтный метод анализа эффективности инвестиций. Метод модифицированной внутренней нормы прибыли.

- •176. Метод внутренней нормы прибыли как дисконтный метод анализа эффективности инвестиций.

- •177. Метод динамического срока окупаемости как дисконтный метод анализа эффективности инвестиций..

- •179.Анализ инвестиционных проектов в условиях инфляции.

- •180. Типы финансирования инвестиционных проектов. Формы финансирования инвестиционных проектов.

- •XVIII. Корпоративные финансы

- •Корпорация как форма бизнеса и участник рынка капитала. Потоки денежных средств корпорации.

- •Прикладные аспекты теоретических разработок современных корпоративных финансов

- •Принципы оценки финансовых активов в корпоративном управлении

- •Использование методов дисконтирования денежных потоков (dcf- модель) в оценке инвестиционной стоимости ценных бумаг.

- •Модель оценки доходности активов у. Шарпа, ее эмпирическая проверка, современное состояние и значение.

- •187. Арбитражная модель оценки активов с. Росса, ее преимущества и недостатки

XIV. Эконометрика

141. Модель множественной линейной регрессии

На любой экономический показатель практически всегда оказывает влияние не один, а несколько факторов. Например, спрос на некоторое благо определяется не только ценой данного блага, но и ценами на замещающие и дополняющие блага, доходом потребителей и многими другими факторами. В этом случае рассматривается множественная регрессия

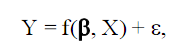

![]()

Уравнение множественной регрессии может быть представлено в виде

где Х=(Х1, Х2, …Хм) – вектор независимых (объясняющих) переменных, β – вектор параметров (подлежащих определению), ε – случайная ошибка (отклонение), У – зависимая (объясняемая)переменная. Предполагается, что для данной генеральной совокупности именно функция f связывает исследуемую переменную У с вектором независимых переменных Х.

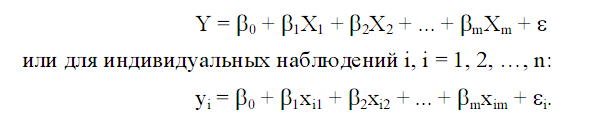

Рассмотрим самую употребляемую и наиболее простую из моделей множественной регрессии- модель множественной линейной регрессии.

Теоретическое линейное уравнение регрессии имеет вид:

Здесь

![]() неизвестных параметров,

неизвестных параметров,

![]() называется j-м теоретическим

коэффициентом регрессии (частичным

коэффициентом регрессии). Он характеризует

чувствительность величины У к изменению

Хj.Другими словами, он

отражает влияние на условное математическое

ожидание

называется j-м теоретическим

коэффициентом регрессии (частичным

коэффициентом регрессии). Он характеризует

чувствительность величины У к изменению

Хj.Другими словами, он

отражает влияние на условное математическое

ожидание

![]() зависимой переменной У объясняющей

переменной Хj при условии,

что все другие объясняющие переменные

модели остаются постоянными. β0 –

свободный член, определяющий значение

У, в случае, когда все объясняющие

переменные Хj равны нулю.

зависимой переменной У объясняющей

переменной Хj при условии,

что все другие объясняющие переменные

модели остаются постоянными. β0 –

свободный член, определяющий значение

У, в случае, когда все объясняющие

переменные Хj равны нулю.

После выбора линейной функции в качестве модели зависимости необходимо оценить параметры регрессии.

Пусть имеется n

наблюдений вектора объясняющих переменных

![]() и зависимой переменной У

и зависимой переменной У

![]()

Для того, чтобы однозначно

можно было бы решить задачу отыскания

параметров

![]() ( т.е. найти некоторый наилучший вектор

β) должно выполняться неравенство

n>=m+1. Если

это неравенство не будет выполняться,

то существует бесконечно много различных

векторов параметров, при которых линейная

формула связи между Х и У будет абсолютно

точно соответствовать имеющимся

наблюдениям. При этом, если n=m+1,

то оценки коэффициентов вектора β

рассчитываются единственным образом

– путем решения системы m+1

линейного уравнения:

( т.е. найти некоторый наилучший вектор

β) должно выполняться неравенство

n>=m+1. Если

это неравенство не будет выполняться,

то существует бесконечно много различных

векторов параметров, при которых линейная

формула связи между Х и У будет абсолютно

точно соответствовать имеющимся

наблюдениям. При этом, если n=m+1,

то оценки коэффициентов вектора β

рассчитываются единственным образом

– путем решения системы m+1

линейного уравнения:

![]()

Например, для однозначного

определения оценок параметров

![]() определяют такую плоскость

определяют такую плоскость

![]() в трехмерном пространстве, которая

пройдет именно через имеющиеся три

точки. С другой стороны, добавление в

выборку к имеющимся трем наблюдениям

еще одного приведет к тому, что четвертая

точка

в трехмерном пространстве, которая

пройдет именно через имеющиеся три

точки. С другой стороны, добавление в

выборку к имеющимся трем наблюдениям

еще одного приведет к тому, что четвертая

точка

![]() практически наверняка будет лежать вне

построенной плоскости (и, возможно,

достаточно далеко). Это потребует

определенной переоценки параметров.

Таким образом, вполне логичен следующий

вывод:

практически наверняка будет лежать вне

построенной плоскости (и, возможно,

достаточно далеко). Это потребует

определенной переоценки параметров.

Таким образом, вполне логичен следующий

вывод:

Если число наблюдений больше

минимально необходимого, т.е. n>m+1,

то уже нельзя подобрать линейную форму,

в точности удовлетворяющую всем

наблюдениям, и возникает необходимость

оптимизации, т.е. оценивания параметров

![]() при которых формула дает наилучшее

приближение для имеющихся наблюдений.

при которых формула дает наилучшее

приближение для имеющихся наблюдений.

В данном случае число ν=n-m-1 называется числом степеней свободы.

МНК – метод наим квадратов.

Суть в минимизации квадратов отклонений

наблюдаемых значений зависимой переменной

У от ее значения

![]() ,

получаемых по уравнению регнессии.

Предпосылки МНК

,

получаемых по уравнению регнессии.

Предпосылки МНК

1. Мат ожидание случ отклонения e равно нулю для всех наблюдений

2.гомоскедастичность (постоянство дисперсий отклонений)

3. отсутствие автокорреляции

4. случайное отклонение должно быть независимо от объясняющих переменных

5модель явл линейной отн параметров

6. отсутствие мультиколлинеарности

7. ошибки е имеют нормальное распределение