- •Введение

- •1. Основные понятия. Количественная мера информации

- •Понятие информации

- •1.2. Количественная мера информации для равновозможных событий

- •1.3. Количественная мера информации для разновозможных событий (сообщений). Энтропия источника дискретных (цифровых) сообщений

- •1.4. Свойства энтропии источника дискретных сообщений

- •1.5. Энтропия источника совместных сообщений

- •1.6. Определение количества информации источника дискретных сообщений при неполной достоверности результатов опыта

- •1.7. Некоторые свойства количественной меры информации источника дискретных сообщений при неполной достоверности результатов опыта

- •1.9. Избыточность источника сообщений

- •1.10 Энтропия источника при наличии коррелятивных связей между двумя соседними символами

- •Контрольные вопросы

- •2. Информационные характеристики непрерывных (аналоговых) источников информации

- •2.1. Понятие о непрерывных (аналоговых) источниках информации

- •2.2. Энтропия непрерывного источника информации. Количество информации в одном замере непрерывной случайной величины

- •2.3. Примеры вычисления энтропии непрерывных источников информации

- •2.4. Количество информации, содержащееся в одном замере непрерывной случайной величины при неполной достоверности результатов измерения

- •Контрольные вопросы

- •3. Понятие о пропускной способности каналов и скорости передачи информации

- •3.1. Пропускная способность дискретного (цифрового) канала

- •3.2. Пропускная способность непрерывных (аналоговых) каналов

- •3.3. Определение пропускной способности непрерывного канала

- •3.4 Основные теоремы Шеннона

- •3.5 Энтропия источника при наличии коррелятивных связей между двумя соседними символами

- •4 Помехоустойчивое кодирование

- •Коды с обнаружением и исправлением ошибок. Код хемминга

- •Исправляющая способность кода хемминга

- •Контрольные вопросы

- •Библиографический список

- •Лабораторная работа №4 код хемминга

- •1.1. Понятие информации ...................................................................... 1

- •Контрольная работа № 1

- •Контрольная работа № 2

Исправляющая способность кода хемминга

Если

имеется n

символов, то вероятность правильного

приема этих символов равна

![]() ,

где р –

вероятность искажения одного символа.

,

где р –

вероятность искажения одного символа.

Вероятность

появления однократной ошибки

![]() .

.

Вероятность ошибочного приема кодовой комбинации:

![]() ;

;

![]() ;

;

![]() .

.

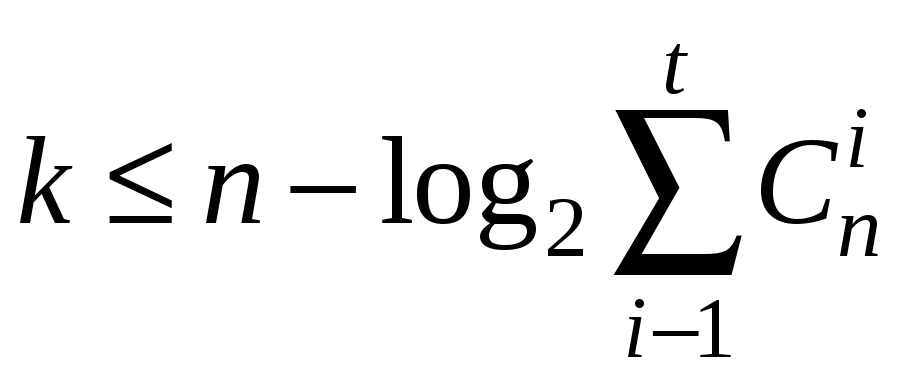

Для

исправления ошибки кратности больше 1

необходимо выполнение условия

,

где t

– кратность ошибки.

,

где t

– кратность ошибки.

Эти

выражения справедливы при вероятности

![]() .

.

Контрольные вопросы

-

Приведите структурную схему цифрового канала.

-

Как определяются скорость передачи и пропускная способность цифровых каналов без помех?

-

Приведите примеры вычисления скорости передачи и пропускной способности цифровых каналов.

-

Какое кодирование называется эффективным?

-

Как осуществляется построение кода Шеннона - Фано?

-

Приведите примеры построения кода Шеннона - Фано.

-

Пропускная способность цифровых каналов с шумами.

-

Приведите модель двоичного канала с шумами.

-

Пропускная способность аналоговых каналов.

-

Определите скорость передачи и пропускную способность аналогового канала.

-

Сравнение идеального канала по Шеннону и реальных информационных каналов.

Библиографический список

-

Душин В.К. Теоретические основы информационных процессов и систем: учебник. – М.: Издательско-торговая корпорация «Дашков и Кº», 2003. – 348 с.

-

Кудряшов Б.Д. Теория информации: учебник для вузов. – СПб.: Питер, 2009. – 320 с.

-

Вентцель Е.С., Овчаров Л.А. Теория вероятностей и ее инженерные приложения. – М.: Высшая школа, 2010. – 480 с.

-

Нечаев Г.И. Прикладная теория информации: учебное пособие. – Рязань: РГРТУ, 2015.

Лабораторная работа №4 код хемминга

1

С и м в о л ы и с х о д н о й к о д о в о й

к о м б и н а ц и и

2

О п р е д е л е н и е п р о в е р о ч н ы х

э л е м е н т о в

3

О п р е д е л и т ь с и м в о л ы п о м е х

о у с т о й ч и в о й к о д о в о й

к

о м б и н а ц и и

4

В ы п о л н е н и е п р о в е р о к н а п р

и е м н о й с т о р о н е .

О

П Р Е Д Е Л Е Н И Е С И Н Д Р О М А О Ш И Б

К И

4.1

С л у ч а й о т с у т с т в и я и с к а ж е

н и я с и м в о л о в п р и п е р е д а ч е

Д

е с я т и ч н о е п р е д с т а в л е н и е

с и н д р о м а о ш и б к и

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

В

е к т о р с и м в о л о в к о д о в о й к о

м б и н а ц и и п р и н я т о й б е з о ш и

б о к

4.2

С л у ч а й н а л и ч и я и с к а ж е н и я

с и м в о л о в п р и п е р е д а ч е

з

а д а н и е н о м е р а с и м в о л а , к о т

о р ы й и с к а ж а е т с я п р и п е р е д

а ч е

и

с к а ж е н н а я к о д о в а я к о м б и н

а ц и я

5

В ы п о л н е н и е п р о в е р о к н а п р

и е м н о й с т о р о н е .

О

П Р Е Д Е Л Е Н И Е С И Н Д Р О М А О Ш И Б

К И

6

Д е с я т и ч н о е п р е д с т а в л е н и

е с и н д р о м а о ш и б к и

7

И с п р а в л е н и е и с к а ж е н н о г о

с и м в о л а

8

В п . 4.2 з а д а т ь н о м е р и р с к а ж

е н н о г о с и м в о л а n=7

В

ы п о л н и т ь п у н к т ы 5, 6 и 7. П р о в

е р н и т ь н а л и ч и е

и

с п р а в л е н и я и с к а ж е н н о г о с

и м в о л а

9

З а д а т ь э л е м е н т ы и с х о д н о

й к о д о в о й к о м б и н а ц и и

В

ы п о л н и т ь п у н к т ы 2-7.

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

ОГЛАВЛЕНИЕ

Введение ...................................................................................................... 1

1. Основные понятия и количественная мера информации ................... 1