- •Кластеры (Зубанов с. 260)

- •Кластеры: доступность данных

- •Наращиваемость.

- •Архитектура кластера с сетевой балансировкой нагрузки

- •Модель без общих компонентов

- •Модель 1. Высокая доступность и статическая балансировка нагрузки

- •Прежде чем начать

- •3. Не менее 2 сетевых плат в каждом компьютере. Узлы в кластере должны быть связаны между собой надежным каналом — интерконнектом (interconnect), по которому они обмениваются информацией о своем со-

- •Что такое кластер

- •Предназначение кластеров

- •Как устроен кластер

Модель без общих компонентов

В этой модели каждая система кластера владеет подмножеством ресурсов кластера. В каждый момент времени только одна система имеет доступ к определенному ресурсу, хотя при сбоях другая динамически определяемая система может вступить во владение этим ресурсом. Запросы от клиентов автоматически перенаправляются к системам, владеющим необходимым ресурсом. Например, если запрос клиента содержит обращение к ресурсам, которыми владеют несколько систем, одна система выбирается для обслуживания запросов (ее называют хост-система). Она анализирует запрос и передает подзапросы соответствующим системам. Те выполняют полученную часть запроса и результат возвращают хост-системе, которая формирует окончательный результат и отсылает его клиенту.

Одиночный системный запрос к хост-системе описывает высокоуровневую функцию, порождающую системную активность, а внутрикластерный трафик не генерируется, пока не будет сформирован конечный результат. Использование приложения, распределенного между несколькими системами кластера, позволяет преодолеть технические ограничения, присущие одному компьютеру. Модели с общим диском и без общих компонентов можно применять в пределах одного кластера. Некоторые программы наиболее просто используют возможности кластера в рамках модели с общим диском. К таким приложениям относятся задачи, требующие интенсивного доступа к данным, а также задачи, которые трудно разделить на части. Приложения, для которых важна наращиваемость, должны использовать модель без общих компонентов.

Модели кластеров серверов в Windows 2000

Текущая реализация кластеров серверов для Windows 2000 Advanced Server поддерживает работу двух связанных между собой особым образом серверов. При этом серверы не имеют общих компонентов. К обоим серверам подключен кворумный (quorum) диск. В любой момент времени он доступен только одному из серверов кластера. Если на одном из серверов происходит сбой или он отключается, второй начинает исполнять его функции и подключается к кво-румному диску. Кластеризация также балансирует нагрузку — распределяет процессы меду серверами. Кластеры Windows 2000 по принципу настройки можно разделить на 5 моделей:

-

высокая доступность и статическая балансировка нагрузки; -

«горячий резерв и максимальная доступность;

-

частичная кластеризация;

-

только виртуальный сервер (без переключения);

-

гибридная.

Кластеры серверов, собранные на базе Windows 2000 Datacenter Server позволяют объединять до 4 серверов. Они обеспечивают работу «каждый с каждым* или каскадное переключение.

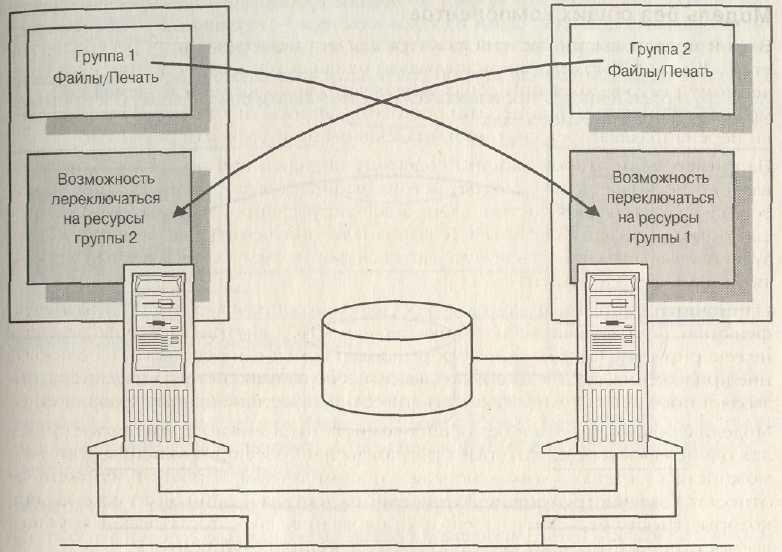

Модель 1. Высокая доступность и статическая балансировка нагрузки

В этой модели обеспечивается высокая доступность, приемлемая производительность при одном неработающем узле и высокая — при обоих работающих, а также максимальное использование аппаратных ресурсов

Конфигурация

модели 1.

Конфигурация

модели 1.

В этой модели каждый узел предоставляет в сеть собственный набор ресурсов в виде виртуальных серверов, к которым имеют доступ клиенты. Производительность каждого узла выбрана таким образом, что обеспечивается оптимальная производительность для ресурсов, но лишь до тех пор, пока оба узла работоспособны. При переключении исполнения всех кластерных ресурсов на один сервер в случае сбоя другого, производительность резко падает, однако все ресурсы по-прежнему остаются доступными для клиентов.

Эта модель может применяться в случае совместного использования файлов и принтеров. На каждом узле создаются независимые группы с файловыми и принтерными ресурсами. При сбое одного из узлов, все управление его ресурсами берет на себя оставшийся. После восстановления работы узла он возвращает себе свою часть работы. В результате клиенты имеют постоянный доступ как ко всем файловым ресурсам кластера, так и ко всем очередям печати.

Рассмотрим еще один пример: на почтовом сервере предприятия работает Microsoft Exchange. В пиковые моменты нагрузки сервер не справляется и отключается. Поскольку почта должна функционировать непрерывно, можно

предложить такое решение. Сервер с Microsoft Exchange объединяется в кластер с сервером, на котором в нормальном режиме работает приложение доступа к данным. При сбое почтового сервера его роль временно принимает на себя второй сервер кластера, и сразу после перезагрузки основного почтового сеп-вера вся работа по обработке почты вновь передается ему. Аналогично может выполняться переключение программы работы с базами данных.

Модель 2, «Горячий резерв» и максимальная доступность

В этой модели обеспечивается максимальная доступность и производительность, но достигается это за счет вложений в оборудование, простаивающее большую часть времени. Один из узлов кластера — первичный — обслуживает всех клиентов, второй же используется как «горячий резерв».

Возможность

переключаться

на

службы

группы

1

Модель с горячим, резервированием.

первом, и обеспечивает производительность, максимально близкую к производительности первичного узла.

Эта модель лучше всего подходит для наиболее важных приложений в организации. Так, это может быть SQL-сервер, обслуживающий тысячи клиентов и предоставляющий доступ к жизненно важной информации. При этом стоимость узла, дежурящего в режиме «горячего резерва», все равно гораздо ниже потерь, возможных в случае прекращения доступа к данным

Модель 3. Частичная кластеризация

Данная модель позволяет задействовать на серверах кластера приложения, для которых не будет выполняться переключение при сбое. Ресурсы таких приложений располагаются не на общем диске, а на локальном диске сервера. При сбое сервера эти приложения становятся недоступными.

Использовать эту модель можно, когда приложения, работающие на одном из серверов кластера, нужны не так часто и их постоянная доступность не столь важна — это может быть бухгалтерское приложение или расчетная задача

Модель частичной кластеризации.

Иногда модель переключения, обеспечиваемая Windows 2000 Server, не годится для некоторых приложений. (В случае с некоторой расчетной задачей переключение с узла на узел все равно прервет процесс вычислений.) Для таких приложений надо использовать иные, специфичные для них механизмы обеспечения бесперебойной работы.

Модель 4. Только виртуальный сервер (без переключения)

Строго говоря, эту модель трудно назвать кластером. В ней используется только один сервер, переключение которого при сбое не выполняется. С другой стороны, все ресурсы организованы так, что для пользователя они предстают в виде ресурсов разных виртуальных серверов. Поэтому вместо поиска нужных ресурсов на различных серверах в сети пользователь осуществляет доступ только к одному.

При сбое сервера кластерное ПО запускает нужные службы в указанном порядке сразу после перезагрузки.

В будущем такой узел можно соединить с другим для организации полноценного кластера.

Модель 5. Гибридное решение

Эта модель — гибрид предыдущих — позволяет задействовать преимущества всех моделей в одной. При достаточном запасе мощности можно обеспечить разные сценарии переключения при сбое.

На рисунке показан пример гибридного решения, в котором на обоих узлах кластера имеются переключаемые ресурсы, непереключаемые приложения и сервисы, а также виртуальные серверы

Установка кластера серверов

Установить ПО поддержки кластеризации просто. Но, как и в любом деле, здесь лучше семь раз отмерить, т. е. перед установкой ПО надо тщательно соблюсти начальные условия и соответствующим образом сконфигурировать серверы.